简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

没有特别需求最新版本的话,ubuntu上可以apt安装:配置token api,这里实用了 Kimi2.6:效果测试:安装 js 和 npm:如果本地node -v 显示版本号低于18,需要调整js版本,参考:删除 sudo which node 出来的 js ,这个版本是使用 apt 安装的 js:安装js和 npm:重新安装 npm:安装 claude code:存储环境变量:https://

单缝衍射 = 均匀长条矩形光源上无穷多相干子波的干涉叠加。"衍射"与"干涉"并非两类不同现象,而是相干叠加的两种数学实现离散相干源 → 人们习惯称"干涉"连续相干源 → 人们习惯称"衍射"这种统一性在费曼的路径积分表述中达到极致:光子从源到屏的所有可能路径(连续无穷多条)的相位叠加,自然同时包含了干涉与衍射。

SHARP(Scalable Hierarchical Aggregation and Reduction Protocol)是由 Mellanox(现为NVIDIA的一部分)开发的一种网络通信算法,用于优化和加速在高性能计算(HPC)和大规模数据中心环境中的集群通信。SHARP 是一种集合通信优化技术,特别是在执行大规模并行计算时,如在深度学习训练和大数据分析中常见的那样。

【代码】ubuntu 22.04 LTS openai triton 安装。

本前言介绍 AMBA 4 高级可扩展接口(AXI4)协议规范。关于本书反馈五个独立通道中的每一个都包含一组信息信号,并使用双向 VALID 和 READY 握手机制。信息源使用 VALID 信号来指示通道上何时有有效数据或控制信息可用。目的地使用 READY 信号来指示其何时可以接受数据。读数据通道和写数据通道还包括一个 LAST 信号,用于指示事务内最后一个数据项的传输何时进行。图示展示了进入和

mesa3d 18.5 for ubuntu 16.04$ ./configure --with-llvm-prefix=/usr/lib/llvm-8/ --with-gallium-drivers=radeonsi --with-dri-driver=radeonvim ./configure# implicit-function ...$make#sudo make installinxi

AMD Instinct MI300 系列 GPU 基于专为高性能计算(HPC)、人工智能(AI)和机器学习(ML)工作负载打造的 AMD CDNA 3 架构。该系列 GPU 具备卓越的可扩展性和计算性能,可适配从单台服务器到全球最大百亿亿级超级计算机的全场景部署。MI300 系列引入了,该芯片集成 GPU 计算单元与底层缓存层级。下图展示了 MI300 系列中单个 XCD 的结构:(图示:XCD

这里是大语言模型直接理解/处理 NeRF 神经网络的权重参数,而非通过渲染中介,那么LLaNA 系列(尤其是 NeurIPS 2024 的原始论文和 2025 年的空间感知扩展)是目前最直接、最权威的学术来源。该方向属于新兴的领域,将训练好的神经网络权重本身视为一种可与语言对齐的数据模态。

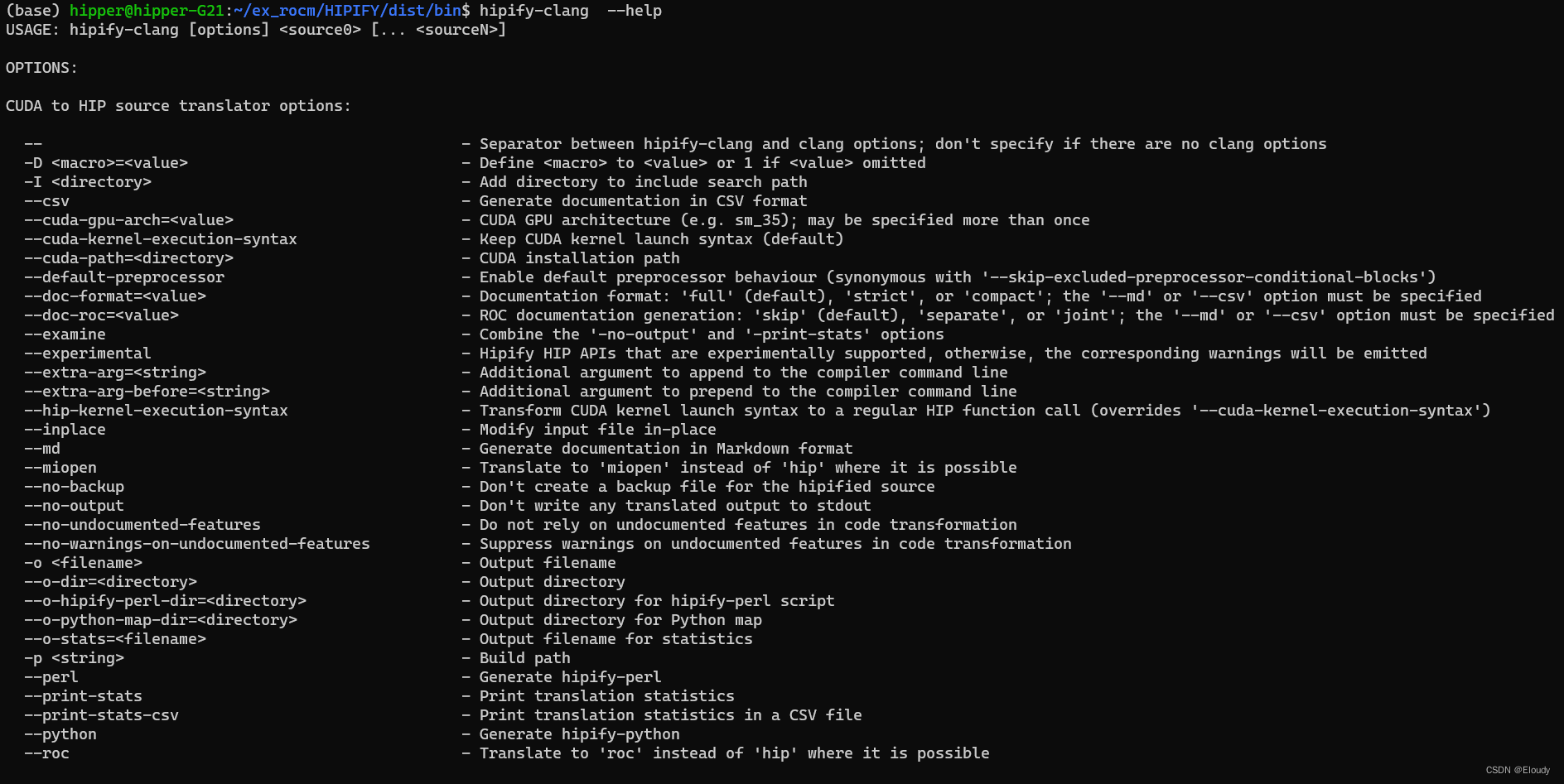

此时 hipify-clang 会被安装到 HIPIFY/dist/bin 中,未完待续 ... ...

这些说明已使用版本 12.6 和 13.0 进行了测试,但其他 CUDA 12 或 13 版本应该也能工作,只要主机系统上的 CUDA 运行时版本与构建使用的 CUDA 版本匹配,并且主机系统上安装的驱动程序支持该 CUDA 版本。如果你的系统不在我们官方包支持列表中(例如,因为你希望在使用旧版 C 标准库的操作系统上使用 CUDA-Q),请仔细遵循本指南,不要跳过任何步骤,从源码构建并安装 CU