简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

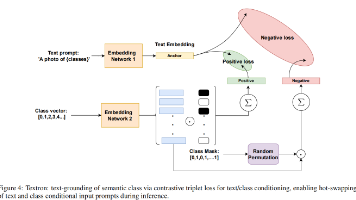

本文介绍一篇生成式视觉/医学图像方向有意思的论文:。它的核心问题不是单纯“生成一张图”,而是。这类问题在医学影像、手术场景、遥感、自动驾驶等领域很重要,因为这些领域最昂贵的往往不是原始图像,而是高质量、专家标注的像素级 mask。论文明确指出,现有生成模型多数只生成图像或只生成 mask,缺少对“成对图像-mask”的统一生成能力,也缺少灵活的文本/类别条件控制能力。

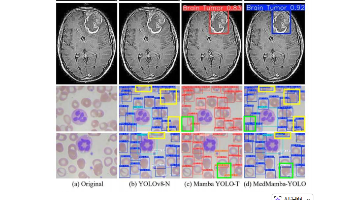

通过阅读上述代码实现,我们可以发现 MedMamba-YOLO 的改进并非盲目的模块堆砌。CPIB 的通道交叉保证了微弱特征不丢失,MSF-FPN 与 SAVSSB 通过跨尺度连接与“CNN + Mamba”的互补机制构建了强大的时空感知能力,而 HMDA 进一步实现了对尺度变化的自适应兼容。理解这套设计逻辑,对改进其他工业视觉模型同样具有极高的参考价值。

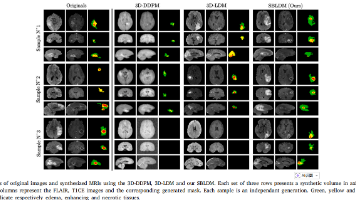

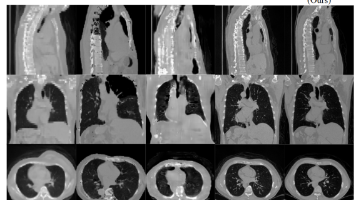

在算力与数据双重受限的情况下,如何通过先验知识(医学影像的切片连续性)与任务分解(全局结构生成+局部细节超分)来榨干扩散模型的潜力。这不仅对医疗影像领域的同行极具启发性,其源码中的设计模式(特征聚合、局部裁剪细化流)也可广泛应用于卫星遥感、材料切片等其他含有三维空间结构但难以获得海量3D数据的场景中。

GuideGen 通过的组合,实现了全躯干 CT 与掩码的渐进式生成。数学原理、潜空间建模、mask-prompt 对齐和可学习下采样等技术保证了生成数据的结构与语义一致性,为医学影像 AI 数据增强提供了可行的解决方案。

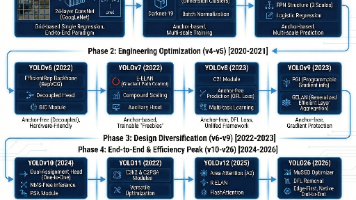

本文系统地梳理了从2016年诞生到2026年预见性的十年演进历程。文章核心聚焦于从传统的“分治法”向的哲学转变,详细解析了各代版本如何通过优化主干网络、引入及后续转向,在检测精度与推理速度之间寻找动态平衡。技术演进的主线涵盖了、梯度信息保护以及最终消除与极致推理效率发展的未来工业趋势。

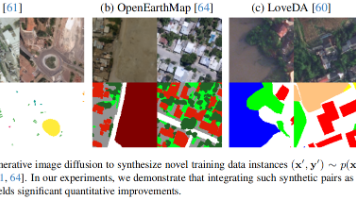

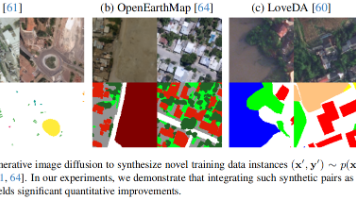

SatSynth最重要的贡献,不是提出了一个特别复杂的网络结构,而是提出了一种清晰的数据生成范式:用diffusion model学习图像和语义标签的联合分布,生成新的image-mask pairs,再作为数据增强用于下游semantic segmentation。它证明了三件事:第一,diffusion model可以不只生成图像,也可以生成与图像匹配的语义mask。第二,合成image-ma

SatSynth最重要的贡献,不是提出了一个特别复杂的网络结构,而是提出了一种清晰的数据生成范式:用diffusion model学习图像和语义标签的联合分布,生成新的image-mask pairs,再作为数据增强用于下游semantic segmentation。它证明了三件事:第一,diffusion model可以不只生成图像,也可以生成与图像匹配的语义mask。第二,合成image-ma

Med3D-JADE 的价值,不在于它只是又提出了一个医学扩散模型,而在于它明确指出了医学数据增强中的一个关键问题:**医学分割缺的不是更多“看起来不同”的图像,而是更多“结构上不同且标注对齐”的样本。**从这个角度看,Med3D-JADE 是一个有启发性的工作。它通过 MAISI 预训练能力、双分支 latent diffusion、VJA 跨模态注意力,把 3D CT 和 segmentati

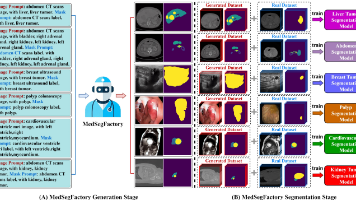

MedSegFactory 通过共享权重的双流架构与 JCA 机制,巧妙解决了医学图像合成中“缺标注”和“难对齐”的痛点。这种将文本提示直接转化为成对可用数据的范式,为降低医学 AI 研发门槛提供了一个极具实用价值的基础工具。

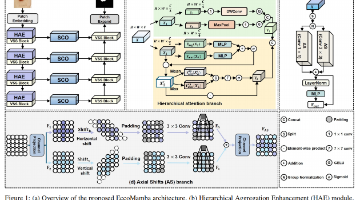

EccoMamba 是一篇围绕 Mamba 医学图像分割缺陷进行结构性修补的论文:用 HAE 增强多尺度语义与边界表达,用 SCO 修复方向偏置和空间不连续,在多个医学分割数据集上取得了较强 DSC 表现;但它并非所有指标全面领先,尤其 HD95 和轻量化方面仍有改进空间。