简介

截至目前,GitCode平台已汇聚了超过600万的注册用户,月日均新增用户超 2.5万,月活用户达120万 ,已经成为颇具影响力的开源社区。

擅长的技术栈

可提供的服务

GitCode是新一代由AI驱动的开源开发者平台。平台集成了先进的代码托管服务,支持全面的版本控制、分支管理和协作开发功能。开发者可以通过GitCode便捷地上传、管理和分享代码仓库,享受无缝的协同开发体验。平台还提供了丰富的开源组件库和多样化的开发工具,无论是个人项目还是企业级应用,GitCode都能为用户提供安全、稳定和高效的代码托管解决方案,助力开发者实现卓越的代码管理与协作。

提升兼容性并解决已知问题。

大家好,它将语音理解、音频推理与生成统一建模,在音频理解、语音识别、跨语种翻译、情感与副语言解析、语音对话等任务中表现突出,并率先支持语音原生的 Tool Calling 能力,可实现联网搜索等操作。一句话总结,Step-Audio 2 mini “模型现已上线 GitCode、Hugging Face 等平台,欢迎大家下载、试用并反馈。

百度文心多模态思考模型 ERNIE-4.5-VL-28B-A3B-Thinking 正式开源,GitCode 同步发布,快来体验!ERNIE-4.5-VL-28B-A3B-Thinking 是在 ERNIE-4.5-VL-28B-A3B 基础上训练的深度思考模型,在能力上实现了显著提升。模型具备领先的文档与图表理解能力,在理科与文科综合推理、通用视觉推理等任务中表现优异,展现出更强的跨模态推理与问

猫哥带来的鸿蒙 PC 三方库迁移实战分享,从环境搭建、方案选型到 AI 提效,以 pngquant 完整演示了移植全流程。猫哥梳理了鸿蒙 PC 开发所需的五种环境(Windows 宿主WSL、虚拟机 Linux、云服务器、鸿蒙 PC 本机、Docker 容器),逐一说明了各自的核心定位和关键优势。他强调 AI 的价值在于“压缩信息检索和反复试错的时间”,而非替代对交叉编译原理的理解。他不仅讲清了各

猫哥带来的鸿蒙 PC 三方库迁移实战分享,从环境搭建、方案选型到 AI 提效,以 pngquant 完整演示了移植全流程。猫哥梳理了鸿蒙 PC 开发所需的五种环境(Windows 宿主WSL、虚拟机 Linux、云服务器、鸿蒙 PC 本机、Docker 容器),逐一说明了各自的核心定位和关键优势。他强调 AI 的价值在于“压缩信息检索和反复试错的时间”,而非替代对交叉编译原理的理解。他不仅讲清了各

猫哥带来的鸿蒙 PC 三方库迁移实战分享,从环境搭建、方案选型到 AI 提效,以 pngquant 完整演示了移植全流程。猫哥梳理了鸿蒙 PC 开发所需的五种环境(Windows 宿主WSL、虚拟机 Linux、云服务器、鸿蒙 PC 本机、Docker 容器),逐一说明了各自的核心定位和关键优势。他强调 AI 的价值在于“压缩信息检索和反复试错的时间”,而非替代对交叉编译原理的理解。他不仅讲清了各

作者:Daniil A. Boiko1,Robert MacKnight1,Ben Kline2,Gabe Gomes基于 Transformer 技术的大语言模型(LLMs)在多个领域已取得显著进展,例如自然语言处理、生物学、化学和计算机编程。本文展示了由 GPT-4 驱动的人工智能系统 Coscientist 的开发与能力。Coscientist 能自主设计、规划并执行复杂的实验,它整合了大语

去年,我们和很多开发者朋友一起,在直播间里聊开源、聊 AI、聊技术浪潮,也聊那些真正发生在一线的判断、焦虑和机会。《开源友的聊》第一季,见证了许多关于“开源时代”的真实讨论。

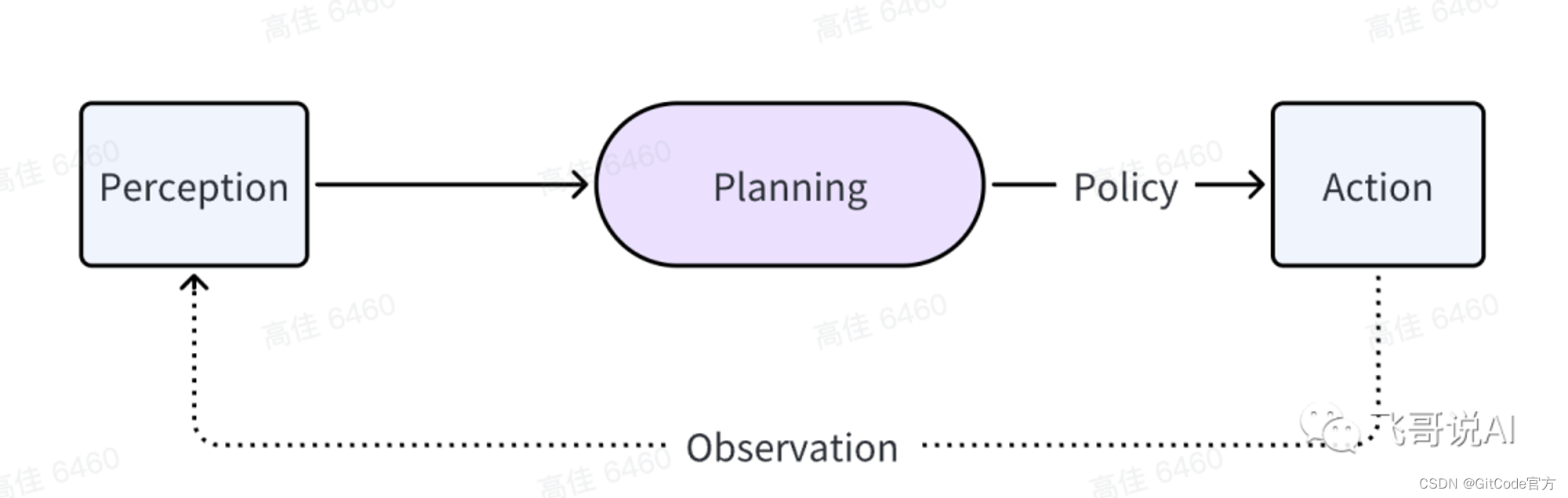

代理(Agent)这个词来源于拉丁语“agere”,意为“行动”。现在可以表示在各个领域能够独立思考和行动的人或事物的概念。它强调自主性和主动性[1]。智能代理/智能体是以智能方式行事的代理;Agent感知环境,自主采取行动以实现目标,并可以通过学习或获取知识来提高其性能 [8]可以把单个Agent看成是某个方面的专家。Agent:P(感知)→ P(规划)→ A(行动)感知(Perception)

筛选符合征文方向、原创要求及基本质量(字数、格式、自查分数、社区引导添加等)的作品,未通过初审的稿件,工作人员将反馈未通过原因,可按要求修改后重新提交复审;投稿作品的版权归属创作者本人或团队,若因内容涉及任何法律纠纷(如版权、侵权等),将由创作者自行承担全部责任,与 AtomGit 开源社区无关;分享实操干货、共筑生态,扫描活动群二维码进群投稿交流、赢取激励,AtomGit 与开发者携手共建新生态