简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

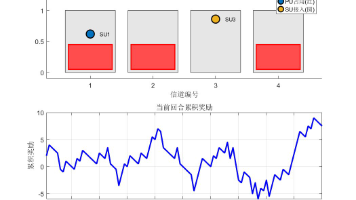

摘要:本文提出一种基于深度Q网络(DQN)的动态多信道协作感知方法,用于认知无线电频谱资源优化。系统包含N个次级用户和K个信道,通过设计N×K×T维状态空间和K+1维动作空间,采用双DQN网络结构进行训练。奖励函数综合考虑传输成功、主用户碰撞和次级用户冲突三个因素。MATLAB仿真实现了集中训练-分布执行的协作流程,包含状态矩阵构建、动作选择、奖励计算等核心模块。实验结果表明该方法能有效提升频谱利

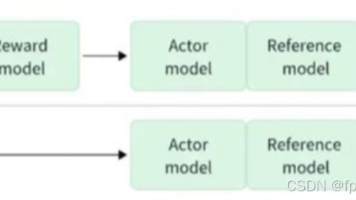

摘要:本文系统分析了直接偏好优化(DPO)算法的理论机制与应用特点。首先介绍了DPO在大模型对齐中的核心地位,重点解析了其梯度更新机制:通过隐式奖励函数和Sigmoid动态系数调节,实现优质回答强化与劣质回答抑制的平衡。与基于PPO的RLHF相比,DPO通过超参数β间接控制探索性,而RLHF采用显式熵正则项主动调节多样性。最后详细阐述了DPO参数更新的完整流程,包括隐式奖励计算、动态系数调节和梯度

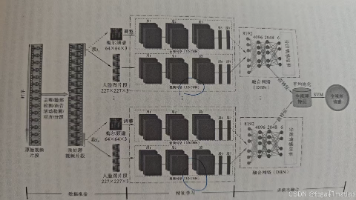

本文提出了一种基于深度学习的视听情感融合算法,通过结合音频和视觉信息实现更准确的情感识别。研究首先介绍了双通道理论、互补性和冗余性原理作为理论基础,然后详细阐述了音频特征(MFCC、韵律特征)和视觉特征(面部动作单元、深度特征)的提取方法,以及时序特征的LSTM处理。在模型架构方面,采用了2D-CNN、3D-CNN和注意力融合策略,并提供了MATLAB实现代码。实验结果表明,该多模态融合方法能够有

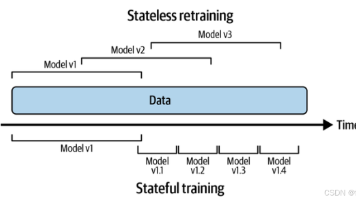

无状态训练和有状态训练是机器学习中的两种不同训练方法。无状态训练假设每个训练样本独立,模型在处理每个样本时不依赖之前的信息,适用于处理独立同分布的数据,如图像分类。有状态训练则保留并利用之前样本的信息,适用于处理序列数据或具有上下文相关性的数据,如语言模型。无状态训练模型结构简单,训练速度快,易于并行化;而有状态训练模型结构复杂,训练速度慢,但能更好地捕捉数据中的长期依赖关系。两种方法的选择取决于

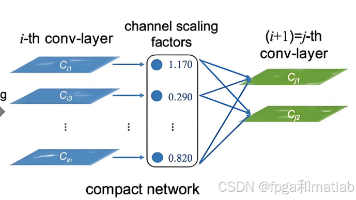

随着深度学习模型在计算机视觉、自然语言处理等领域的广泛应用,模型规模呈指数级增长。例如,GPT-4参数量达到1.8万亿,这对计算资源和部署环境提出了严峻挑战。权重剪枝(Weight Pruning)作为模型压缩的核心技术,通过删除冗余参数实现模型轻量化,同时保持性能稳定。

无标签数据(Unlabeled Data)指未被人工标注或缺乏明确语义信息的数据。例如,一段未标注情感倾向的文本、一张未标记物体类别的图像,或一组未分类的传感器信号。这些数据本身仅包含原始特征(如像素值、文本词汇、时间序列等),但缺乏与特定任务直接相关的监督信号(如分类标签、回归目标)。无标签数据规模通常远超有标签数据,传统算法(如基于全连接层的神经网络)需消耗大量计算资源。半监督学习或自监督学习

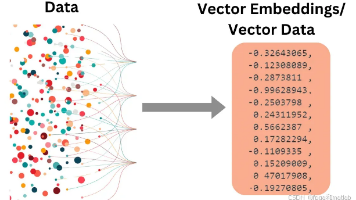

例如,在一个简单的文本分类任务中,将输入句子中的每个单词通过预训练的词嵌入模型转换为向量,然后将这些向量拼接或平均等方式组合起来,作为后续神经网络层的输入。例如,在图像识别中,对于图像中的不同区域或特征,可以学习一种嵌入表示,使得相似的区域在嵌入空间中距离较近,不同的区域距离较远。:学习到的表征可以作为特征用于各种分类任务。例如,在自然语言处理的循环神经网络(RNN)或长短期记忆网络(LSTM)中

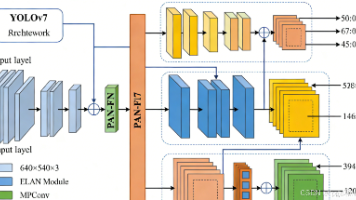

2025年度FPGA技术开发工作总结 本年度聚焦图像无线传输、视觉识别和智能通信三大方向,完成了多项FPGA开发项目。在YOLOv7视觉识别项目中,采用INT8量化、网络剪枝和层融合技术,实现了30fps的实时检测性能;图像无线传输项目通过OFDM+32QAM+Turbo码方案,达成600米1080P高清传输;智能通信预研项目创新性地将深度学习应用于信道估计,MSE达-26.8dB。全年技术突破包

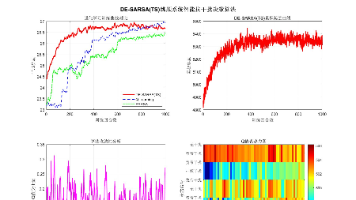

本文提出了一种基于DE-SARSA(TS)的智能跳频抗干扰决策算法,通过整合Dyna架构、期望时序差分学习和汤普森采样三种机制,有效解决了复杂电磁环境下的自适应抗干扰问题。算法采用64维离散动作空间建模跳频参数,利用ExpectedSARSA方法降低估计方差,结合Dyna模型加速学习收敛。仿真实验表明,该算法能自主优化跳频速率、带宽和序列模式,在多种干扰共存场景下显著提升通信系统的生存能力。MAT

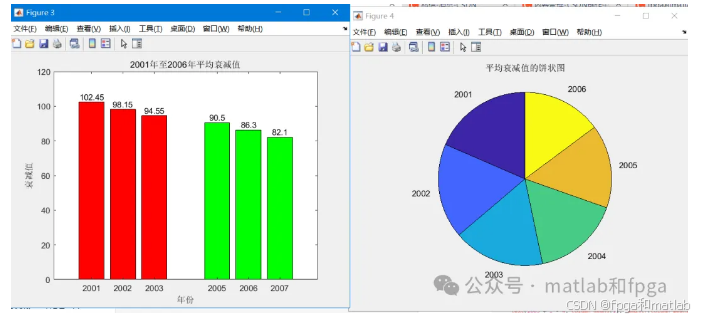

这可就给那些没什么电脑操作基础,尤其是对编程一窍不通的朋友们带来了不小的困扰,他们在使用这些工具的时候,往往会觉得困难重重,不知道从哪儿下手。接下来呢,咱们就简单地唠唠,怎样利用如今方便好用的 AI 工具,来帮一帮那些不会编程的朋友们轻松地制作出各种各样的统计图表呀。而对于那些要求更高、更专业一些的情况呢,人们往往就得借助编程工具了,像 MATLAB、VC 之类的。跟进一步,如果需要更复杂的图,比