简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

随着互联网的蓬勃发展,中国互联网公司逐渐从形成了一个不成文的“30岁定律”,一时间,“程序员30岁危机”成为行业热议话题。但无奈的是,大环境形成的潮流不易逆转,个人也只能选择适应。奋斗的中年程序员们,倍感职业生涯的无奈和迷茫。

AI智能体通过感知环境、自主决策和执行任务,突破传统大模型仅限于语言交互的局限。例如,当用户指令“订一张明天去北京的机票”时,智能体不仅理解语义,还能自动调用航班查询接口、完成支付并同步至日程系统。这种能力使其在客服、医疗、智能制造等领域展现出颠覆性潜力。然而,智能体的开发长期受制于接口碎片化与工具兼容性难题。开发者需为不同数据源编写适配代码,导致60%的开发周期浪费在系统对接上。这一痛点催生了M

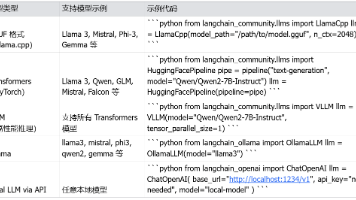

本文通过高考信息查询智能助手案例,对比手写代码与LangChain、QwenAgent、AgentScope三大框架在业务编排、模型调用、工具集成、上下文记忆及多智能体协作方面的差异。框架显著降低开发门槛,提升效率,而手写代码则提供更高灵活性。根据需求提供选型建议:LangChain适合单体智能体,Qwen-Agent适合基于Qwen模型的助手,AgentScope适合多智能体协作系统,手写代码适

Agent Zero是一款突破传统"工具箱"模式的革命性AI Agent框架,实现了有机生长的"有机体"架构。其核心技术包括动态工具生成、三层记忆系统、多智能体协作和可扩展插件架构。通过"计算机作为工具"的范式,Agent Zero能自主编写代码完成任务,并具备从经验中学习的能力。该框架在软件开发、数据分析、系统管理等领域表现出色,为AI Agent的发展开辟了新方向,是开发者深入了解AI Age

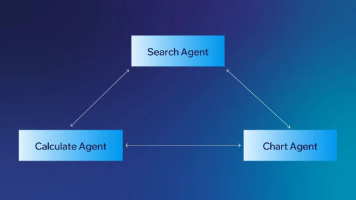

本文详解了多智能体系统(MAS)这一新AI架构,包括LLM智能体的四种类型及三种核心多智能体架构(网络型、主管型、层级型)。通过"公司运营"例子解释各类架构的工作原理、优缺点和适用场景,提供了架构选择建议和入门学习框架推荐。多智能体系统通过AI智能体协作,解决了单一模型处理复杂任务的局限,是当前AI发展的重要方向。

上下文工程是策划和维护LLM推理过程中最优信息集合的策略,区别于提示工程。由于AI注意力有限,存在上下文衰减问题,需精简信息并精准投放。实践策略包括:素材精简、按需即时检索信息,以及处理长任务的三种方法:上下文压缩、结构化笔记和子智能体架构。通过这些方法,可以有效解决AI"失忆"和长任务处理难题,提升AI协作效率。

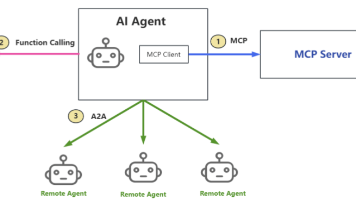

文章探讨AI Agent如何将大模型从"思想巨人"转变为"万能助手"。通过MCP、Function Calling和A2A三大技术,大模型能感知环境、使用工具、执行任务。MCP实现工具发现与调用,Function Calling指导模型何时调用工具,A2A实现多智能体协作。这些技术让大模型克服传统规则局限,处理非结构化任务,使通用人工智能成为可能。

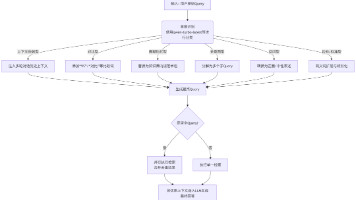

Query改写是RAG系统中提升检索效果的关键步骤。用户的自然提问与知识库组织方式存在差异,直接检索会导致召回失败、精度失败或上下文低效。通过补充细节、更换说法、多角度提问等方法,将用户查询转化为更匹配知识库的形式,可显著提升检索准确率。文章详细介绍了五种Query改写类型及意图识别技术,强调Query改写是保障RAG系统可靠性的"第一道防线"。

LangMem是为大型语言模型应用设计的结构化记忆模块,通过类型化记忆槽位、具名记忆主体和可检索记忆,解决LLM在多轮对话和多智能体推理中的记忆问题。它实现了短期记忆、长期记忆、智能体行为和用户反馈的存储与检索,并通过自我反思功能不断进化,使LLM应用具备"不会遗忘"的智能记忆能力,提升长时间跨度内的推理能力。

让我们从基础开始。在这个语境中,工作流(Workflow)是一个逐步的蓝图,决定了 AI 智能体如何思考、规划、行动和学习。它将像 GPT-5 这样的静态模型转变为一个可以规划旅行、编写代码、搜索网络甚至自我调试的系统。