简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

更多数据集,请访问OpenDataLab官网

MinerU是一个基于PyTorch的深度学习模型运行程序,PyTorch支持多种加速方式,如CUDA和MPS,以提升运行速度。PyTorch是MinerU的核心库,必须安装,而torchvision作为辅助库,建议安装以支持图像处理任务。对于NVIDIA显卡用户,需安装NVIDIA显卡驱动和CUDA-Toolkit以启用GPU加速;而MacOS用户则可通过MPS加速。Anaconda作为Pyth

随着共建“一带一路”进入高质量发展阶段,全球开发者对于多语言模型训练的需求不断增长,上海AI实验室联合大模型语料数据联盟成员发布了,为多语言大模型训练提供高质量数据支撑,助力全球开发者构建跨语言智能工具与应用。)现面向全社会开放多语言课题合作及应用案例征集,并提供丰富、多维的资源支持,欢迎大家报名。发布以来,吸引众多开发者积极下载、使用。围绕该语料库的开源应用,上海人工智能实验室联合大模型语料数据

导言:从科学文献 PDF 文档中提取作者、年份、摘要等元数据,构建高效索引与分析,并以此激活海量文档价值,能够直接帮助研究者、图书馆、企业及数据库平台等实现更高效的文献管理、资源数字化、AI知识库构建与数据聚合分析等。然而,面对排版复杂、元素多样的科学文献,如何客观地评估模型的元数据提取能力?为此,上海人工智能实验室 OpenDataLab 团队推出了科学文献元数据提取评测集,该基准旨在建立客观、

本地升级,即可使用

NanaDraw是一款AI驱动的科研职场绘图神器,能够快速生成可编辑的学术配图。它支持四种智能模式(自动/草稿/生成/组装),200+内置学术风格,1000+专业图标素材,通过自然语言指令即可生成流程图、机制图等专业图表。独特优势在于生成后仍可自由编辑每个元素,支持导出SVG/PNG/PPT等高清格式,完美解决论文配图卡顿、AI生图不可调等痛点。适用于科研论文、基金标书、职场汇报等场景,实现AI生

更多数据集,请访问OpenDataLab官网

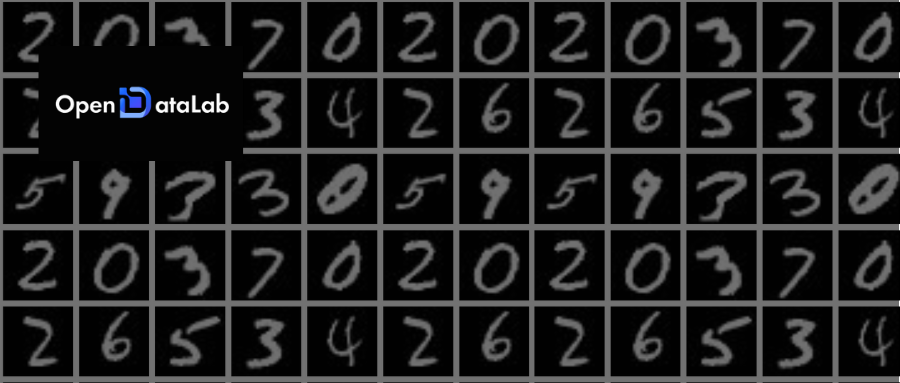

就像无数人从敲下“Hello World”开始代码之旅一样,许多研究员从“MNIST数据集”开启了人工智能的探索之路。

面对个人电脑或云盘里堆积如山的各类文件,每次填报表单、汇总信息时,是不是都感觉像大海捞针一样耗时费力?其实,不仅我们觉得头疼,连 OpenClaw/Agent 也觉得棘手。当 OpenClaw 面对多份、动辄上百页的 PDF,需要快速找到关键信息时,它会怎么做?在没有工具的情况下,OpenClaw 需要一页一页啃文档,甚至重复“造轮子”。这种纯靠“硬读”来尝试完成任务的方式,不仅效率低,而且成本很

极简上手:一键安装 + 自然语言指令,小白也能快速操作高保真解析:公式、表格关键信息 1:1 还原批量高效:论文批量处理,大幅提升效率开箱即用:输出格式标准,直接对接知识库等应用场景。