简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

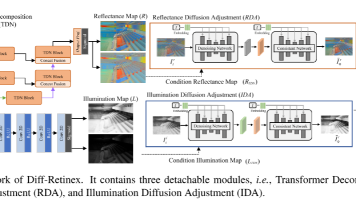

在本文中,我们重新思考了低光照图像增强任务,提出了一种兼具物理可解释性和生成能力的扩散模型,称为Diff-Retinex。我们的目标是整合物理模型与生成网络的优点,并通过生成网络补充甚至推断低光照图像中缺失的信息。因此,Diff-Retinex将低光照图像增强问题转化为Retinex分解和条件图像生成两个部分。在Retinex分解阶段,我们结合Transformer中注意力机制的优势,精心设计了R

这是一个“做—反馈—再做—再改进”的学习过程。

wandb (Weights & Biases) 是机器学习 / 强化学习领域最主流的 实验跟踪、可视化与协作平台,自动记录超参数、损失曲线、准确率、GPU / 内存占用、代码版本等所有训练细节。原项目的batch_size是128,感觉过大的话可以自行调整,在train/lewm.yaml里对batch_size进行修改即可。当然,WandB需要科学上网,如果服务器的条件不允许的话,也可以去tr

假设你没有见过犰狳和穿山甲。现在左边给了你四张图,并告诉你了左边两张是犰狳,右边两张是穿山甲。现在给你一张新的图,你可以仅通过已知的四张图判断,新的图是犰狳还是穿山甲吗?大多数人可能分不清犰狳和穿山甲,但是只要给出四张图片,都能进行正确的分类。既然人只要四张图片就能做出分类,那计算机是否可以呢?这里的。数据集只有四张图片,每个类只有两张图片。这么小的数据集,不足以拿去训练一个完整的神经网络。而少样

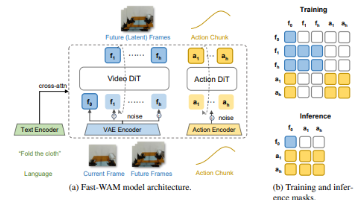

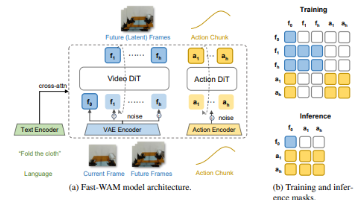

世界动作模型(WAM)作为具身控制领域中视觉 - 语言 - 动作(VLA)模型的一种极具潜力的替代方案应运而生,其核心是显式建模视觉观测在动作作用下的演变规律。现有绝大多数 WAM 均遵循范式,迭代式视频去噪过程会产生巨大的测试时延,但对于实现优秀动作性能是否真正必要,这一问题仍不明确。本文研究:WAM 在测试阶段是否需要显式未来想象,还是其性能增益主要来自训练阶段的视频建模?我们提出架构,在训练

世界动作模型(WAM)作为具身控制领域中视觉 - 语言 - 动作(VLA)模型的一种极具潜力的替代方案应运而生,其核心是显式建模视觉观测在动作作用下的演变规律。现有绝大多数 WAM 均遵循范式,迭代式视频去噪过程会产生巨大的测试时延,但对于实现优秀动作性能是否真正必要,这一问题仍不明确。本文研究:WAM 在测试阶段是否需要显式未来想象,还是其性能增益主要来自训练阶段的视频建模?我们提出架构,在训练

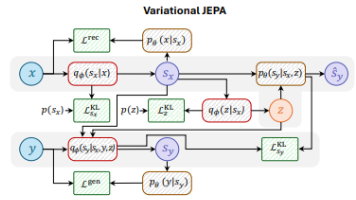

联合嵌入预测架构(JEPA)常被视为基于似然的自监督学习的非生成式替代方法,其核心是在表示空间中进行预测,而非在观测空间中做重构。本文提出,这种与概率生成建模的割裂大多是表述层面的,而非结构层面的:标准 JEPA 的设计 —— 耦合编码器与上下文到目标的预测器 —— 与对一类耦合隐变量模型做变分推断得到的变分后验、学习到的条件先验高度吻合;标准 JEPA 可被看作一种确定性特例,其正则化依赖架构与

让机器人在多样环境中执行各类任务,是机器人学习领域的核心挑战。尽管视觉 - 语言 - 动作(VLA)模型在通用机器人技能学习中展现出潜力,但要充分发挥其能力,仍需解决动作表示与高效训练方面的局限。当前 VLA 模型往往聚焦于视觉 - 语言模型(VLM)组件的规模扩展,而动作空间表示仍是关键瓶颈。本文提出DexVLA框架,旨在提升 VLA 模型在跨多机器人本体、复杂长时域任务中的效率与泛化能力。De

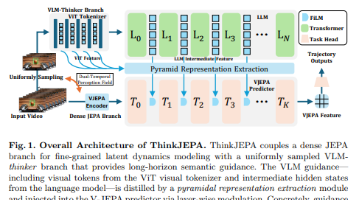

近期潜在世界模型(如 V-JEPA2)在从视频观测预测未来世界状态方面展现出可观能力。然而,基于短观测窗口的稠密预测会限制时序上下文,并使预测器偏向局部、低层次的外推,难以捕捉长时程语义,降低下游任务实用性。相比之下,视觉 - 语言模型(VLM)通过对均匀采样帧进行推理,具备强大的语义锚定与通用知识建模能力,但因计算驱动的稀疏采样、语言输出瓶颈(将细粒度交互状态压缩为文本导向表示),以及适配小样本

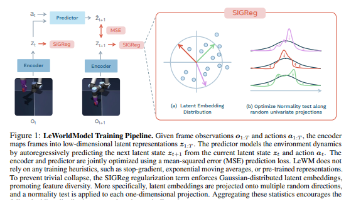

联合嵌入预测架构(JEPA)为在紧凑隐空间中学习世界模型提供了极具潜力的框架,但现有方法仍不稳定,需依赖复杂的多损失项、指数移动平均、预训练编码器或辅助监督来避免表征坍缩。本文提出,首个仅用即可从原始像素端到端稳定训练的 JEPA:下一时刻嵌入预测损失,以及强制隐嵌入服从高斯分布的正则项。与现有唯一端到端方案相比,可训练损失超参数从 6 个降至 1 个。LeWM 仅 1500 万参数,单 GPU