简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文系统梳理了GPT-4o之后多模态生成的三大技术路线:1)纯自回归(AR)路线通过统一token化处理图文数据,架构简洁但生成效率低;2)纯扩散路线采用并行去噪生成,图像质量高但推理能力较弱;3)混合路线结合AR的语义规划和扩散的生成优势,成为当前主流方案。文章对比了各路线代表模型的技术特点、优势短板及适用场景,建议研究者从混合架构入手,重点关注tokenization、跨模态注意力和训练数据三

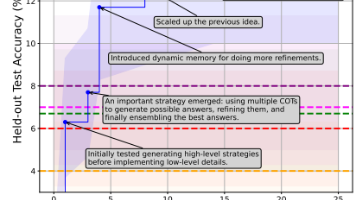

本文提出"智能体系统自动设计"(ADAS)新范式,通过元智能体搜索算法实现智能体架构的自动化优化。该算法在代码空间中进行迭代探索,利用基础模型作为元智能体编程新的智能体,并基于不断增长的存档优化设计。实验表明,该方法在逻辑推理、数学、阅读理解和科学问题等多个领域显著优于人工设计的智能体,平均性能提升13.6-25.9%,同时展现出强大的跨领域和跨模型迁移能力。研究为智能体技术的

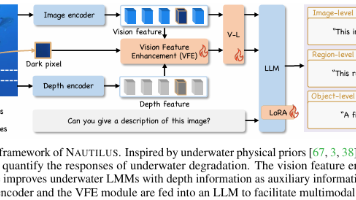

摘要:论文提出NAUTILUS模型,用于解决水下图像颜色失真、细节模糊等问题。通过构建145万问答对的大规模水下多任务数据集NautData,并设计基于物理先验的视觉特征增强(VFE)模块,该模型能在特征层面逆向修复水下图像退化信息。实验表明,NAUTILUS在目标检测、分类等8项任务上性能显著提升,尤其在恶劣水下环境中表现出强鲁棒性。该研究为水下智能探索提供了新基准,其可解释的物理建模方法和即插

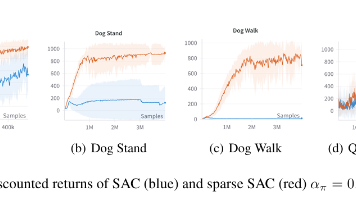

布朗大学与AWS团队在ICLR2025发表的研究提出新理论框架,从流形几何角度分析连续强化学习中的策略学习动态。研究发现,神经网络策略生成的状态分布存在于低维流形中,其维度与动作空间同阶。基于此,团队提出局部流形学习层,在MuJoCo等复杂控制任务中验证了性能提升。该研究首次系统揭示了连续RL训练的几何本质,为高维控制任务提供了新的优化思路和理论基础。

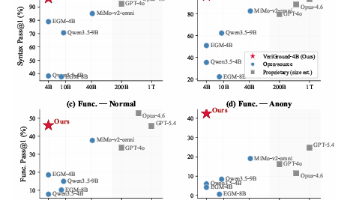

本文揭示了多模态大语言模型(MLLM)在"视觉到代码"任务中存在"海市蜃楼"缺陷:模型会绕过视觉输入,依赖文本提示中的语义信息生成代码模板,而非真正理解电路图。研究提出VeriGround解决方案,通过标识符匿名化训练数据和决策聚焦偏好对齐算法(D-ORPO),强制模型学习视觉拓扑结构。实验表明,4B参数的VeriGround在匿名化测试中功能正确率达42.

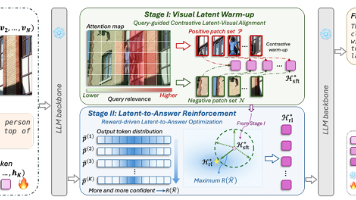

多模态大模型训练中存在"沉默视觉潜变量"问题:模型为走捷径会抑制视觉推理能力。最新研究提出推理阶段优化方案,通过"预热-强化"两阶段操作,在不修改模型参数的情况下唤醒被压抑的视觉潜能。该方法首先提升潜变量语义质量,再通过置信度递进奖励机制强制模型使用潜变量,在多个基准测试中性能显著提升(最高达14%),且计算效率优于传统方法。这一发现为提升多模态模型推理能力

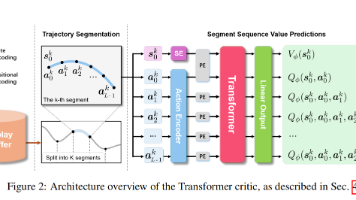

Transformer与强化学习(RL)的融合正成为决策智能领域的研究热点。这一新范式通过Transformer强大的时序建模能力,有效解决了传统RL在长时序依赖、离线数据利用率、安全约束平衡等方面的难题。目前研究聚焦三大方向:离线RL的序列化建模、安全约束的动态适配以及情景RL的效率优化。两篇代表性论文展示了该方向的创新成果:《Constrained Decision Transformer》通

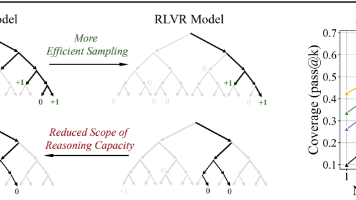

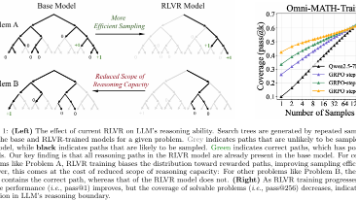

本研究通过系统实验深入探讨了强化学习(RL)在提升大语言模型(LLMs)推理能力方面的实际效果。研究发现,尽管当前强化学习与验证器结合(RLVR)的方法被广泛采用,但其对模型推理能力的提升本质上并未超越基线模型自身的能力边界。实验结果表明,强化学习训练过程中产生的性能增益主要源于对特定任务模式的适应和优化,而非真正增强了模型的底层推理机制。研究团队通过多维度评估揭示了这一现象,并指出当前RL方法在

【摘要】清华大学团队研究发现,当前强化学习(RL)技术并未真正提升大语言模型的推理能力。通过pass@k评估方法(采样1024次),实验表明RL训练后的模型在数学、编程等任务中并未超越基础模型的能力边界,反而缩小了问题解决范围。研究揭示RL仅优化了已有知识的输出效率,却牺牲了基础模型原有的多元解决能力。相比之下,知识蒸馏能真正扩展模型能力。该成果对当前过度依赖RL提升模型性能的做法提出了重要警示,

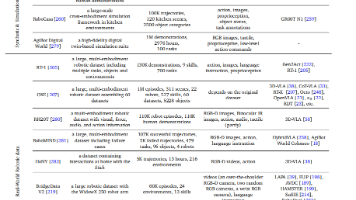

本文提出了视觉-语言-动作(Vision-Language-Action,VLA)模型的一致性框架,核心概念是“行动标记”(Action Token)。将视觉特征与语言指令转换为可执行的中间表示,并根据标记序列驱动动作执行。作者从八种标记形式入手:自然语言子任务、代码标记、物体可供性、轨迹表示、目标状态、潜在向量、原始控制命令与推理链,系统梳理了各类方法的发展脉络及性能表现。论文还讨论了数据规模、