简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

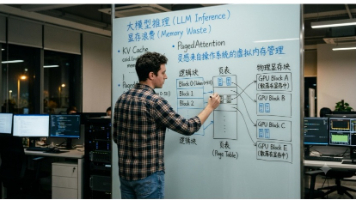

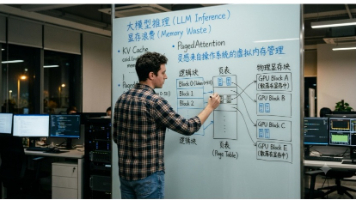

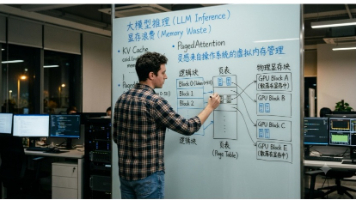

大模型推理中的显存浪费问题,被一种借鉴操作系统思路的技术有效缓解了。在生成式AI领域,大语言模型的参数量和上下文长度持续增长。开发者将模型部署到生产环境时,常常遇到两个现实问题:推理成本高,以及显存溢出(OOM)。GPU 数量增加,吞吐量却未必成比例提升。vLLM 是当前比较流行的大模型推理加速框架之一。很多开发者切换到vLLM后,发现系统吞吐量有明显提升。据官方基准测试,相比 HuggingFa

大模型推理中的显存浪费问题,被一种借鉴操作系统思路的技术有效缓解了。在生成式AI领域,大语言模型的参数量和上下文长度持续增长。开发者将模型部署到生产环境时,常常遇到两个现实问题:推理成本高,以及显存溢出(OOM)。GPU 数量增加,吞吐量却未必成比例提升。vLLM 是当前比较流行的大模型推理加速框架之一。很多开发者切换到vLLM后,发现系统吞吐量有明显提升。据官方基准测试,相比 HuggingFa

大模型推理中的显存浪费问题,被一种借鉴操作系统思路的技术有效缓解了。在生成式AI领域,大语言模型的参数量和上下文长度持续增长。开发者将模型部署到生产环境时,常常遇到两个现实问题:推理成本高,以及显存溢出(OOM)。GPU 数量增加,吞吐量却未必成比例提升。vLLM 是当前比较流行的大模型推理加速框架之一。很多开发者切换到vLLM后,发现系统吞吐量有明显提升。据官方基准测试,相比 HuggingFa

在云原生技术日益普及的当下,Nginx、Docker、Kubernetes 等基础设施的配置文件编写已成为运维工程师与后端开发者的日常痛点。这些配置不仅语法繁杂,且对安全性、性能参数有着极高的要求。手动编写不仅效率低下,且极易引入人为错误。随着大语言模型(LLM)能力的爆发,利用 AI 辅助生成高质量配置代码已成为必然趋势。本文将详细阐述如何利用 Rust 语言的高性能与安全性,结合 GLM-5

长连接技术能够保持服务器与企业微信网关之间的持续会话,避免了频繁握手带来的网络开销,确保了在复杂群聊环境中,AI助手能够秒级响应成员的指令。当操作者输入指令,要求总结特定群组在特定时间段内的工作进展时,AI 会执行多步操作:首先检索相关群聊消息,接着利用其 235B 的大参数量进行语义分类,区分出“待办事项”、“已完成工作”以及“潜在风险”。这不仅是工具的升级,更是办公范式的重塑。针对非管理员身份

最近做项目的时候,发现单纯的地图坐标展示已经不能直接满足复杂的业务需求了。我们需要一个更实用的系统,不仅能查地图,还能做语义分析,直接搞定出差、旅游的行程规划。这次开发,我把腾讯位置服务和AI大模型结合到了一起。后端写了一套接口,把地图的坐标获取、路线计算和大模型的自然语言理解对接上,初步跑通了这套服务。这里把整个项目的工程实现和底层逻辑记录下来。我们直接从平台接入的控制台配置开始,顺便聊聊每一块

为了展示 OPS-CV 中算子是如何被形式化定义的,以下代码展示了一个典型的图像处理算子(如Resize)在底层 C++ 接口中的原型声明与校验逻辑。这部分代码属于算子开发层,用于指导系统如何构建图和分配内存。// 定义 Resize 算子的原型// 继承自 Operator 类,注册输入输出端口和属性.INPUT(x, TensorType({DT_FLOAT, DT_FLOAT16, DT_U

代码采用面向对象设计,封装了内存初始化、数据搬运和计算逻辑。

在云原生技术日益普及的当下,Nginx、Docker、Kubernetes 等基础设施的配置文件编写已成为运维工程师与后端开发者的日常痛点。这些配置不仅语法繁杂,且对安全性、性能参数有着极高的要求。手动编写不仅效率低下,且极易引入人为错误。随着大语言模型(LLM)能力的爆发,利用 AI 辅助生成高质量配置代码已成为必然趋势。本文将详细阐述如何利用 Rust 语言的高性能与安全性,结合 GLM-5

在云原生技术日益普及的当下,Nginx、Docker、Kubernetes 等基础设施的配置文件编写已成为运维工程师与后端开发者的日常痛点。这些配置不仅语法繁杂,且对安全性、性能参数有着极高的要求。手动编写不仅效率低下,且极易引入人为错误。随着大语言模型(LLM)能力的爆发,利用 AI 辅助生成高质量配置代码已成为必然趋势。本文将详细阐述如何利用 Rust 语言的高性能与安全性,结合 GLM-5