简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

MP 神经元数学模型是一个包含输入,输出与计算功能的模型。输入:权重:每个输入都就有一个权重。一个神经网络的训练算法就是让权重的值调整到最佳,以使得整个网络的预测效果最好。计算:下图展示了 2 个计算功能。输出:下图可见,z 是在 a 和 w 的线性加权和叠加了一个函数 g 的值。在 MP 模型里,函数 g 是 sgn 函数(取符号函数)。下面对神经元模型的图进行一些扩展。将 sum 函数与 sg

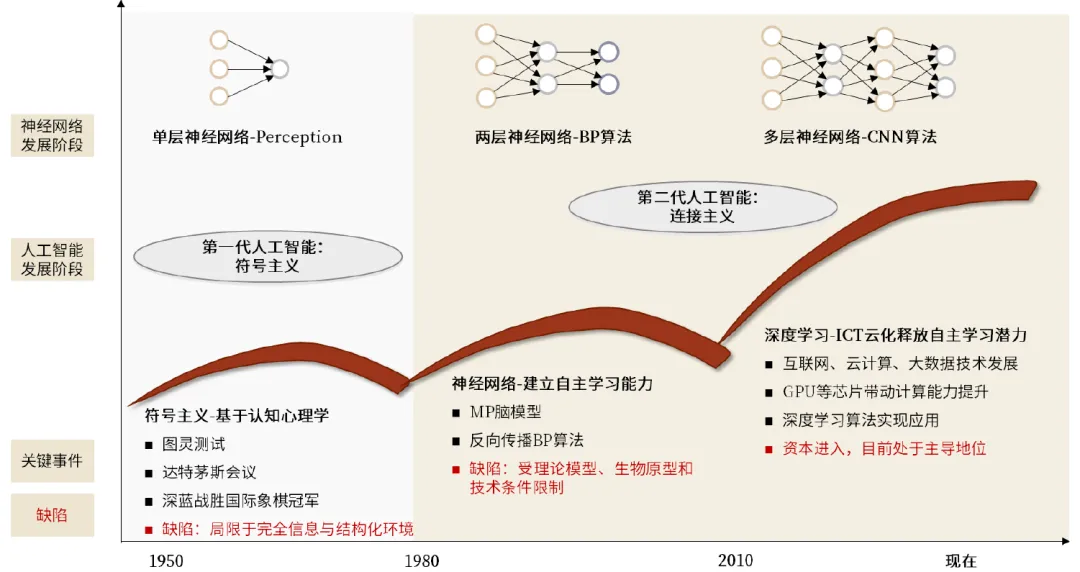

核心思想是:认为人的智能归结为人脑的高层活动的结果,强调智能活动是由大量简单的单元通过复杂链接后并行运行的结果。弗兰克·罗森布拉特(Frank Rosenblatt)基于 MP 模型再进一步发明并在 IBM-704 计算机上实现了一种新的神经元数学模型,称为感知机模型(Perceptron),现在也将其称为一种单层神经网络,是神经网络和支持向量机的基础,作为早期神经网络研究的一个重要里程碑。即:感

这意味着用于描述样本的特征需要由专家设计,算法性能依赖于人工设计和抽取这些特征的准确度,以便使模型能够完成特定的任务,因此它的应用受到了很大的限制。其中,“阈值逻辑”、“Hebb 学习率”,前 2 个理论解决了单个神经元层面的建模问题,来自于对大脑神经元的生理学研究,共同构成了 “感知机” 的理论基础,在 1950s 提出;所以,和 MP 模型一样,感知机模型也是一个应用于线性分类场景的 “二分类

例如:句子 The animal didn’t cross the street because it was tired,其中 it 和 animal 的关联必然最大,其权重也最大,it 的语音单元必然包含 animal 的信息,如此的 Decoder 就知道了代词 it 指代的是名称 animal 而不是其他词,翻译为 “动物”。由于深度神经网络中每一层的输入都是上一层的输出,因此多层传递下,

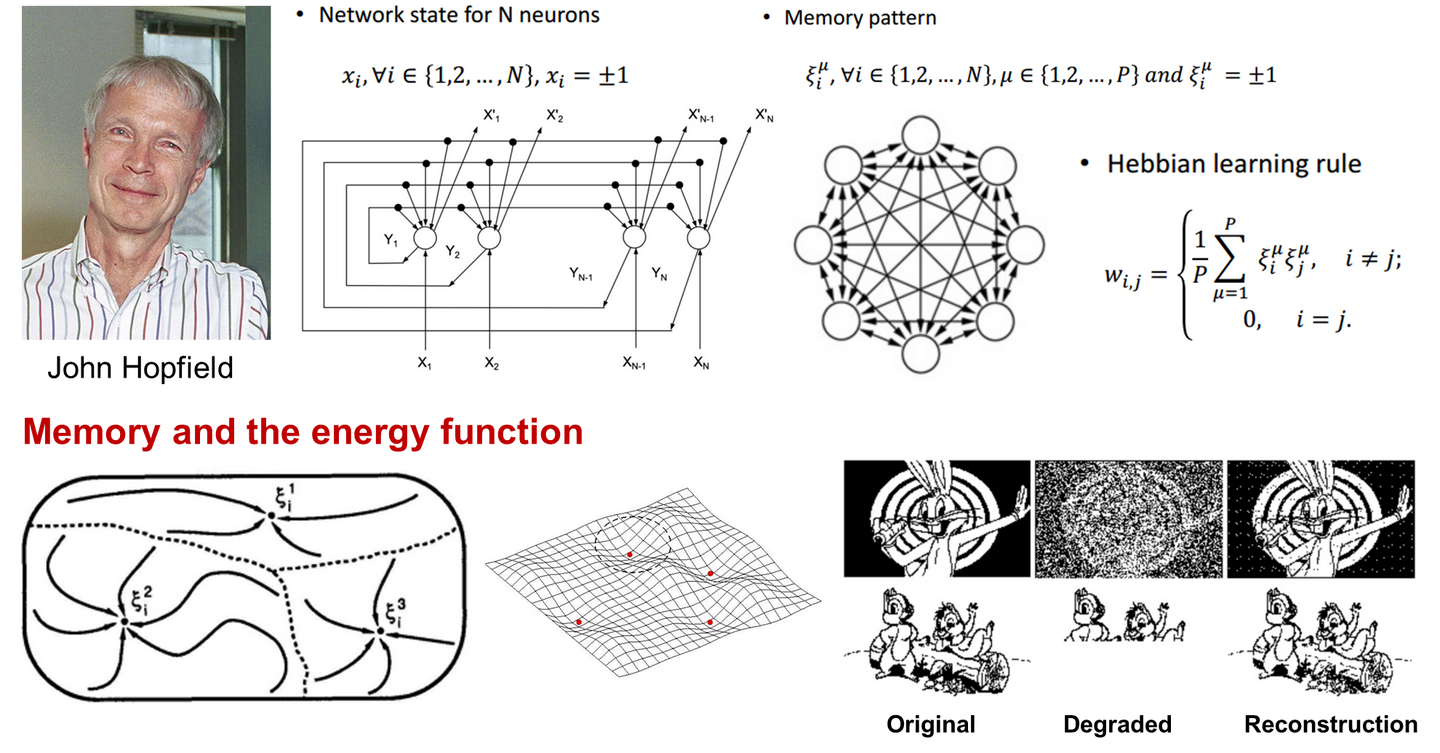

约翰·霍普菲尔德(John Hopfield)文学士、物理学博士,研究领域横跨物理学、分子生物学、神经科学、计算机科学,是一名以推动跨学科交叉融合而闻名于世的科学家,其推动了物理学与生命科学、人工智能的交叉融合,被誉为 “扩展统计物理学边界的先驱”,获得了 2024 年的物理学诺贝尔奖。霍普菲尔德早期是理论物理学家,专注于固体物理和量子力学,研究电子行为与能量状态,在激化子、长程电子输运等方面有极

Trainium1 于 2020 年发布,使用 NeuronCore-v2 核心,是一款用于专注于 AI/ML 训练的加速芯片,支持 BF16 和 FP32 进行高精度训练,以及支持 TF32、FP16 和 INT8 以提高效率,还配备了专用的集合通信库芯片。可用于训练数十亿参数的大模型。2024 年,AWS 宣布了下一代 Trainium3 芯片,采用 3nm(纳米)制程,预计将比 Traini

目录文章目录目录混合云与分布式云AWS 重塑混合云,向分布式云进军混合云与分布式云早在 2017 年的时候,云计算行业开始意识到了多云和混合云将会是未来发展的主流趋势。因为随着浩浩荡荡的第一波上云浪潮翻过之后,企业用户开始意识到单纯的公有云或私有云都无法很好的满足企业生产业务需求的方方面面,而混合云结合了私有云与公有云的优势,逐渐成为了企业 IT 能力适应企业业务发展的积极方向。最典型的方面就是

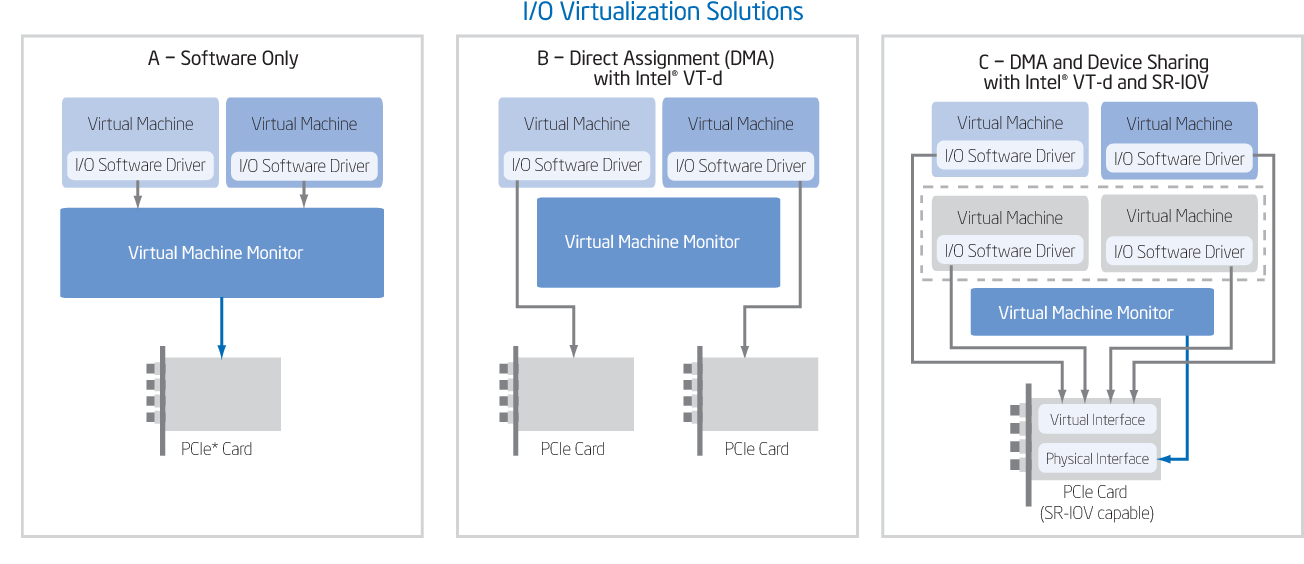

通过标签机制,可以实现 VEB、Director IO 和 VEPA 的混合部署方案,借助多通道技术,管理员可以根据网络安全、性能以及可管理等方面的需求,灵活的选择虚拟机与外部网络的接入方案(VEB、Director IO 或 VEPA)。如下图 Intel x710 VEB 所示,VMM 通过 PF 来管理 VEB 的配置,在启用了 VEB 的场景中,VEB 将 PF 和所有的 VFs 都连接了

目录文章目录目录OpenShift 核心概念容器(Container)镜像(Image)用户(User)项目(Project)容器沙箱(Pod)部署(Deployment)服务(Service)路由(Router)持久化存储(Persistent Storage)模板(Template)构建(Build)和镜像流(ImageStream)OpenShift 核心业务流程以应用为中心应用构建流程应用