简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍在BitaHub平台上使用swift工具库微调Llama3-8B模型的完整流程。首先配置环境并安装swift框架,加载OpenO1-SFT数据集进行训练。通过LoRA技术高效微调模型,详细说明了训练参数设置。训练完成后,将LoRA权重与原模型合并,并进行推理测试。结果显示微调后的模型在问答和推理任务中表现良好,验证了方法的有效性。本教程提供了从环境配置到模型部署的全流程指南,帮助开发者快速

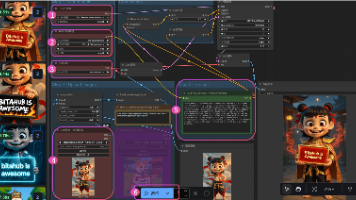

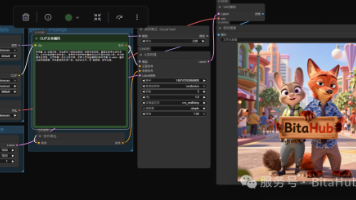

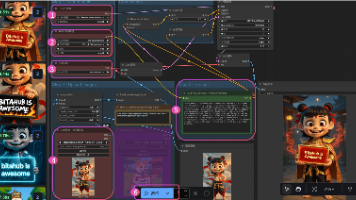

摘要:本教程介绍如何在BitaHub平台部署ComfyUI并运行FLUX.1KontextDev多模态图像生成模型。首先需准备模型权重、文本编码器和VAE文件,按指定目录存放。通过创建虚拟环境、安装依赖并启动ComfyUI服务后,用户可加载预置工作流模板,配置扩散模型、文本编码器、VAE及输入图像,使用英文提示词进行图像生成与编辑。该方案提供云端可视化操作界面,降低复杂AI创作门槛,充分发挥FLU

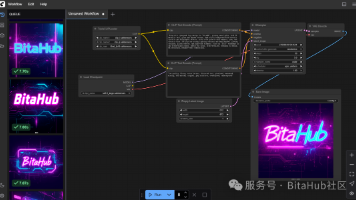

摘要: 本教程介绍如何在BitaHub平台部署ComfyUI并运行StableDiffusion3.5 Large模型,构建云端AI绘图系统。内容包括:准备工作(克隆ComfyUI、下载模型文件)、环境配置(创建虚拟环境、启动服务)、工作流搭建(加载模型、设置提示词、采样生成图像)以及调试优化。通过模块化节点连接,用户可灵活控制81亿参数的专业级SD3.5模型,无需本地配置即可生成高质量图像,适合

阿里巴巴通义实验室开源轻量级AI生图模型Z-Image-Turbo,仅6B参数却实现20B级模型的性能。该模型采用创新的S3-DiT单流架构,将文本、语义和图像信息统一处理,解决了传统双流架构的算力浪费问题。在4090/A100显卡上,1080P图3秒生成,4K图15秒完成,显存占用降低40%。模型还具备92%的中文理解率和稳定的极速采样能力,兼容主流框架并采用Apache2.0开源许可。教程详细

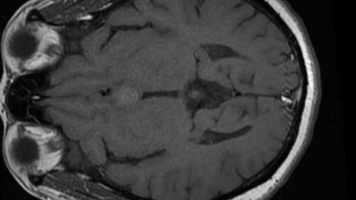

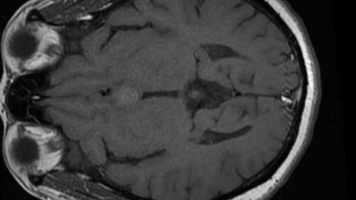

本文介绍了在医疗影像分析中使用MedGemma-4B模型进行脑部MRI分类任务的微调方法。首先加载并预处理脑肿瘤MRI数据集,将其转换为适合模型训练的对话格式。通过LoRA微调技术,仅训练少量参数就使模型准确率从基础模型的33%大幅提升至92%。教程详细展示了从数据准备、模型配置到训练评估的全流程,证明了MedGemma在医学图像分类任务中的强大潜力,为医疗AI应用提供了高效精准的解决方案。

提供了80个招股说明书的pdf文件和金融数据库,需要回答相关的问题。因为只是做rag,我么只使用pdf文档数据和相关问题。这个大模型既可以使用本地大模型,也可以使用大模型api服务。下面也给出了二者的代码##定义本地模型,下面代码可以主流的LLM模型,可以换不同模型对比效果# 基于本地 Qwen2 自定义 LLM 类print("正在从本地加载模型...")print("完成本地模型的加载")@p

本文介绍了一个基于DeepSeek-R1模型和LangChain框架的本地知识库问答系统实现方案。该系统通过Ollama框架管理本地大语言模型,利用Chroma向量数据库存储PDF文档的向量化表示,构建了完整的检索增强生成(RAG)流程。项目实现了从环境配置、模型加载、文档处理到问答交互的全过程,特别强调了本地化部署在数据安全和成本控制方面的优势。通过Gradio提供的Web界面,用户可直接与本地

本文介绍了在医疗影像分析中使用MedGemma-4B模型进行脑部MRI分类任务的微调方法。首先加载并预处理脑肿瘤MRI数据集,将其转换为适合模型训练的对话格式。通过LoRA微调技术,仅训练少量参数就使模型准确率从基础模型的33%大幅提升至92%。教程详细展示了从数据准备、模型配置到训练评估的全流程,证明了MedGemma在医学图像分类任务中的强大潜力,为医疗AI应用提供了高效精准的解决方案。

摘要:本教程介绍如何在BitaHub平台部署ComfyUI并运行FLUX.1KontextDev多模态图像生成模型。首先需准备模型权重、文本编码器和VAE文件,按指定目录存放。通过创建虚拟环境、安装依赖并启动ComfyUI服务后,用户可加载预置工作流模板,配置扩散模型、文本编码器、VAE及输入图像,使用英文提示词进行图像生成与编辑。该方案提供云端可视化操作界面,降低复杂AI创作门槛,充分发挥FLU

本文介绍在BitaHub平台上使用swift工具库微调Llama3-8B模型的完整流程。首先配置环境并安装swift框架,加载OpenO1-SFT数据集进行训练。通过LoRA技术高效微调模型,详细说明了训练参数设置。训练完成后,将LoRA权重与原模型合并,并进行推理测试。结果显示微调后的模型在问答和推理任务中表现良好,验证了方法的有效性。本教程提供了从环境配置到模型部署的全流程指南,帮助开发者快速