简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

其次,他揭示了模型“求快”的默认性格需通过“惯用性”提示词加以约束,并惊叹于Opus 4.5与GPT 5.2在Bug定位上的惊人能力,但也警示,过度依赖AI会导致开发者心智模型保真度快速衰减,进而缩短代码库的“品质半衰期”;软件工程的核心始终在于:与团队协作来深入理解问题的本质,编写代码将解决方案落地,排查并修复 Bugs,同时随着问题的变化持续迭代优化方案。据我观察,即使有最好的提示词工程支持,

本文作者深耕人工智能领域多年,洞见独到。文中系统性地介绍了四种常见的 Compound AI Systems 部署模式:RAG 系统、Conversational AI 系统、Multi-Agent 系统和 CoPilot 系统。作者阐明了这些部署模式的工作原理、模块间的交互方式,并深入探讨了“Agentic”理念、模块化设计的优势等核心概念,为读者构建 Compound AI Systems 提

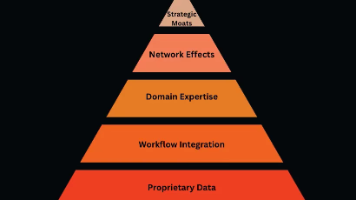

唯有当你的模型性能超越业界公开的、性能最好的开源模型,且能在数小时(而非数周)内完成重新训练时,优势才会真正显现。人工智能并非灵丹妙药 —— 尤其是在那些因过去妥协或短视决策累积许多落后技术架构、设置许多机械死板的操作规范、拥有过度保守的官僚体系的传统企业内部。我们今天为大家带来的文章,作者的观点是:真正的 AI 护城河需要系统性地构建六层递进式能力,从技术底座到战略壁垒,缺一不可。例如,Zill

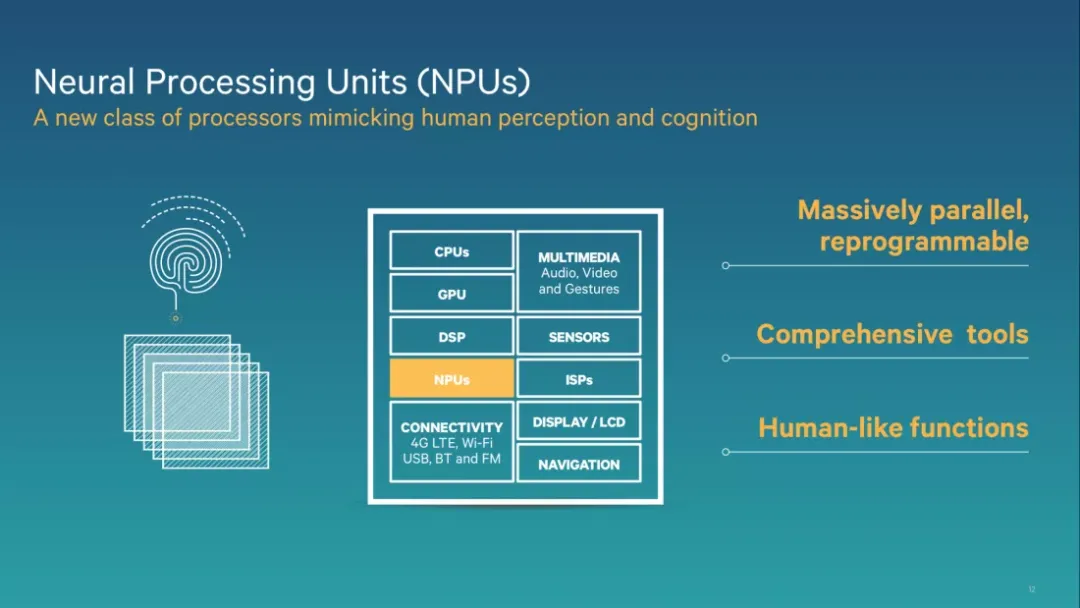

随着2024年被业界誉为“AI PC元年”,各大笔记本电脑厂商纷纷推出搭载NPU的全新AI PC,而在介绍产品性能时,“NPU”一词频频被提及。但NPU和我们所熟知的GPU之间的区别究竟是什么?我们今天为大家分享的这篇文章将和大家一起初探NPU vs GPU。简而言之,NPU专为加速AI任务而设计,包括深度学习和推理,能够高效地处理大量数据,并利用专用存储器快速执行复杂的AI算法。与GPU相比,N

UB-PMC 包含真实的科学图表,而 Synth 则是生成的模拟图表。ChartDETR 等先进方法结合了 CNN 和 Transformer,实现了端到端的数据提取,而 FR-DETR 等模型则优化了流程图和树状图的结构提取,但处理复杂连接线的挑战依然存在。最初,这一领域依赖于基于规则的方法,但现在,深度学习技术的应用,如使用边界框和图像分割,极大地提升了检测的精确度和速度。但当遇到科学和专利文

为确保本文自成体系并阐明 GRPO 的理论基础,我们将首先介绍强化学习的基础概念,重点解析强化学习(RL)及基于人类反馈的强化学习(RLHF)在 LLM 训练中的核心作用。接着我们将探讨不同的强化学习范式,包括基于价值的强化学习、基于策略的强化学习和 Actor-Critic 强化学习,回顾经典算法如置信域策略优化(TRPO)和近端策略优化(PPO),最后解析 GRPO 带来的优化创新。在 GRP

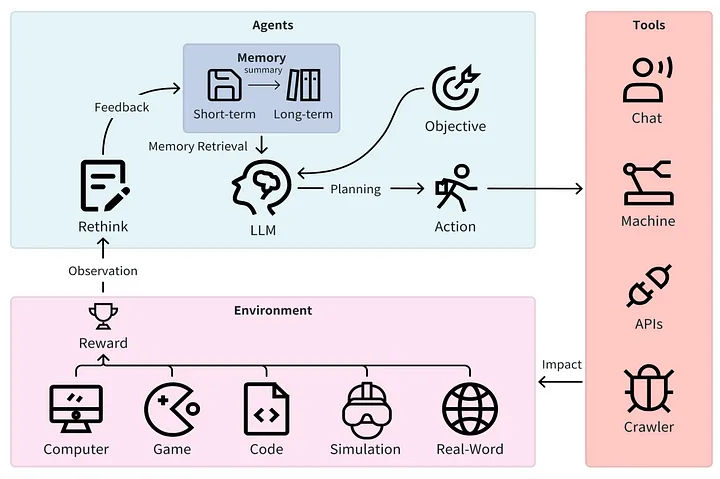

本文作者通过对五大多智能体 AI 框架的比较,提出了一个关键观点:不同的 AI 框架适用于不同的场景和需求,选择的关键在于精准匹配项目特点和技术路线。OpenAI 最近发布了 Swarm,我得说,对于想要入门 Multi-AI agent 框架的新手来说,这可能是目前最易用的选择。最新亮相的是微软推出的 Magnetic-One(这是微软的第二个框架),其目标是对现有的 AutoGen 框架进行简

编者按:大语言模型可以提供许多创意性内容,如写诗、写小说等。那么到底应该如何评估大语言模型生成的创意性内容的水平呢?本文探讨了GPT-2到GPT-4的创造性,并分析了这些模型在不同创造性测试中的表现。作者使用了三种测试来衡量模型的创造性:Remote Associates Test、Alternate Uses Task和Divergent Association Task,并发现越新的模型在所有

实际上,在今年 1 月发布时(早于 Llama 4、Gemma 3 和 Qwen 3),OLMo 2 系列模型正处于计算效率与性能的帕累托前沿【译者注:“帕累托前沿”(Pareto Frontier)是一个起源于经济学和优化理论的重要概念,它描述的是一种最优状态,在这种状态下,任何一方的利益或某个目标的提升都无法不以牺牲其他方利益或其他目标的下降为代价。今天我们为大家带来的这篇文章,作者的核心观点

编者按:目前大语言模型主要问答、对话等场景,进行被动回答。是否可以将大模型应用于推荐系统,进行主动推送呢?这篇文章回顾了可以将大模型作为推荐系统的理论基础,并重点描述了基于英文和阿拉伯语的购物数据集微调T5-large模型,探索将LLMs用作推荐系统的实践。同时本文还介绍了LLMs作为推荐系统的优点和缺点,并提出建议和可行的方向。以下是译文,Enjoy!