简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Spaces 使得开发者可以快速将我们的模型部署为可交互的 web 应用,且无需担心后端基础设施或部署的复杂性。下图看连接上了已经,但是问题是在VS code软件中不能打开终端,应该如下图所示 右机在浏览器打开 这样就在浏览器中就可以看见终端打开了(或者是你在GitHub codespace进VS code会跳出来一个新的窗口,在新的窗口中也可以打开终端)注意到在CodeSpace平台上是没有GP

Lagent 是一个轻量级开源智能体框架,旨在让用户可以高效地构建基于大语言模型的智能体。同时它也提供了一些典型工具以增强大语言模型的能力。Arxiv 搜索Bing 地图Google 学术搜索Google 搜索交互式 IPython 解释器IPython 解释器PPTPython 解释器。

Einops主要用于简化和优化深度学习中的张量操作,使得代码更加易读和高效。Protobuf则是一个强大的序列化工具,适合需要高效、可靠地传输和存储结构化数据的应用场景。环境激活后,命令行左边会显示当前(也就是llamaindex。

LangGPT 是的简称,中文名为结构化提示词。LangGPT 是一个帮助你编写高质量提示词的工具,理论基础是我们提出的一套模块化、标准化的提示词编写方法论——结构化提示词。我们希望揭开提示工程的神秘面纱,为大众提供一套可操作、可复现的提示词方法论、工具和交流社群。我们的愿景是让人人都能写出高质量提示词。

在本节中,我们批判性地评估了大型语言模型(LLMs)后训练方法中的未解决问题和潜在发展轨迹,分析基于OpenAI的o1 [41] 和DeepSeek-R1 [28] 的发布所带来的变革性进展。这些模型利用大规模强化学习(RL),重新定义了推理基准,但它们的出现放大了后训练技术中持续存在的局限性的紧迫性。以下小节概述了六个关键的开放问题,每个问题都强调了其对领域发展的至关重要性和解决的紧迫性,以及推

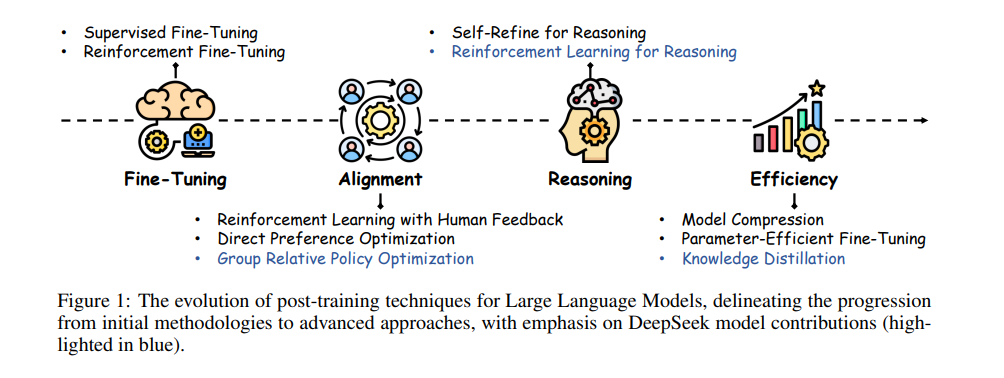

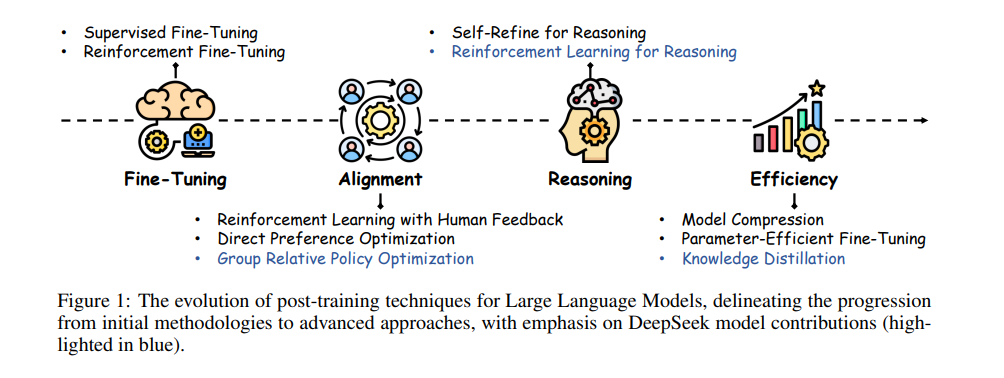

国内外14家机构的研究人员,用87页文章,对LLM的后训练方法(Post-training Language Models,PoLMs)进行了全面综述该文章追溯了追踪从GPT-3(2020年)→ChatGPT(2022年)→DeepSeek-R1(2025年)的后训练进展,时间线如下:2018-2021年(LLM基础时期)• BERT和GPT确立了预训练和微调范式。• 基于Transformer的

国内外14家机构的研究人员,用87页文章,对LLM的后训练方法(Post-training Language Models,PoLMs)进行了全面综述该文章追溯了追踪从GPT-3(2020年)→ChatGPT(2022年)→DeepSeek-R1(2025年)的后训练进展,时间线如下:2018-2021年(LLM基础时期)• BERT和GPT确立了预训练和微调范式。• 基于Transformer的

Lagent 是一个轻量级开源智能体框架,旨在让用户可以高效地构建基于大语言模型的智能体。同时它也提供了一些典型工具以增强大语言模型的能力。Arxiv 搜索Bing 地图Google 学术搜索Google 搜索交互式 IPython 解释器IPython 解释器PPTPython 解释器。

国内外14家机构的研究人员,用87页文章,对LLM的后训练方法(Post-training Language Models,PoLMs)进行了全面综述该文章追溯了追踪从GPT-3(2020年)→ChatGPT(2022年)→DeepSeek-R1(2025年)的后训练进展,时间线如下:2018-2021年(LLM基础时期)• BERT和GPT确立了预训练和微调范式。• 基于Transformer的