简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

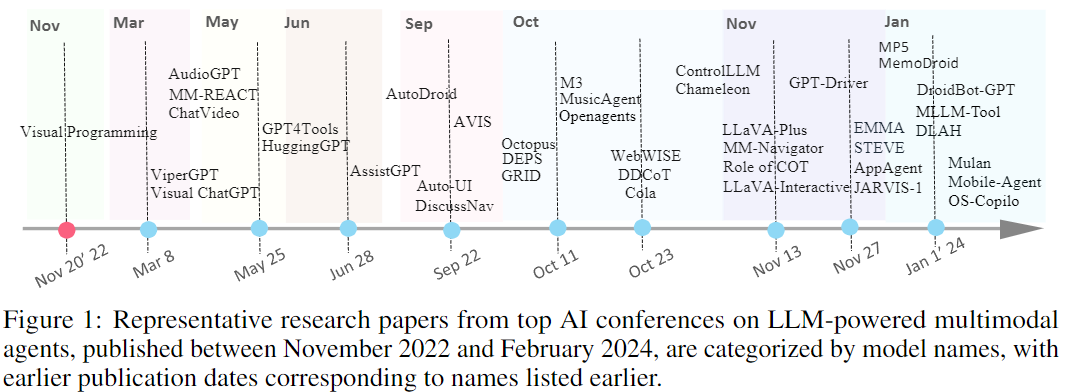

智能体(agent)是一个能够感知其环境并根据这些感知做出决策以达到特定目标的系统。尽管在狭窄领域内表现出色,早期智能体往往缺乏适应性和泛化能力,与人类智能存在显著差异。最近大语言模型(LLMs)的进展开始弥合这一差距,LLMs增强了它们在命令解释、知识吸收和模拟人类推理和学习方面的能力。这些智能体使用LLMs作为它们的主要决策工具,并进一步增强了关键的类人特征,如记忆。这种增强使它们能够处理各种

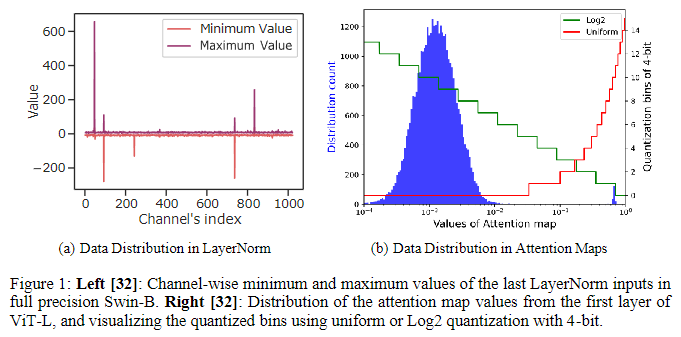

Transformer,由Vaswani等人引入,以其强大的数据建模能力、可伸缩性以及出色的捕捉长距离依赖性的能力,彻底改变了机器学习。起源于自然语言处理(NLP)领域,取得了机器翻译和文本摘要等方面的成功,Transformer现在将其实用性扩展到计算机视觉任务,如图像分类和目标检测。最近,它们的能力已经在多模态情感分析领域得到了利用,其中它们整合和解释多样的数据流——文字、视觉和声音——以评估

生成式人工智能和工具在各个主要行业都有许多应用案例,如网络安全和制造业。随着时间的推移,将会发现更多的应用案例。尽管正面的例子比比皆是,但我们必须谨慎前行。即使有许多积极的例子,但生成式人工智能和其他模型的威力尚未完全被理解。对于决定在其组织中实施AI的人来说,战略性地进行实施,并严格遵守最佳实践是至关重要的。

注意力算子和Transformer架构的引入使得我们可以创建大规模的,能够处理各种模态的模型。这一进步主要归因于算子的多功能性和架构的适应性。最初,它们主要应用于语言模型,但很快就扩展到支持视觉处理骨干,并最终用于集成多种模态的模型。随着复杂的大语言模型的激增,尤其是它们在上下文学习方面的能力的进步,鼓励研究人员将这些模型的范围扩大到多种模态,既作为输入又作为输出。这种扩展促使了像GPT-4V和G

《RynnVLA-002:统一视觉-语言-动作与世界模型的创新架构》 摘要:本文提出RynnVLA-002模型,首次将视觉-语言-动作(VLA)模型与世界模型统一于单一框架。该模型通过双向增强机制实现互补:世界模型利用物理规律优化动作生成,而VLA增强视觉理解以提升图像预测精度。创新性地采用混合动作生成策略,包括"动作注意力掩码"解决离散动作误差累积,以及连续ActionTra

注意力算子和Transformer架构的引入使得我们可以创建大规模的,能够处理各种模态的模型。这一进步主要归因于算子的多功能性和架构的适应性。最初,它们主要应用于语言模型,但很快就扩展到支持视觉处理骨干,并最终用于集成多种模态的模型。随着复杂的大语言模型的激增,尤其是它们在上下文学习方面的能力的进步,鼓励研究人员将这些模型的范围扩大到多种模态,既作为输入又作为输出。这种扩展促使了像GPT-4V和G

不一致的学习信号:现有的大多数强制策略在传播样本级表示时,扩散状态不匹配,导致学习信号不一致和收敛不稳定。推理效率限制:历史表示无限制增长且缺乏结构,阻碍了缓存状态的有效重用,严重限制了推理效率,无法实现真正无限的视频生成。

现有的图像与视频生成模型在质量、一致性和计算效率方面仍存在不足。需要构建大规模、高质量的数据集,以支持高性能生成模型的训练。现有的生成架构未能充分统一图像和视频的表示,影响跨模态生成效果。训练大规模生成模型的计算成本高,需优化并行计算与存储机制。

SoulX-LiveTalk提出了一种14B参数的实时音频驱动虚拟形象框架,通过创新的双向蒸馏策略和全栈优化实现高效生成。该框架摒弃传统单向范式,采用双向注意力机制增强运动连贯性,结合多步自校正机制防止长周期误差累积。通过混合序列并行、并行VAE等优化技术,系统在8个H800节点上实现0.87秒启动延迟和32FPS吞吐量。实验表明,该框架在视觉质量、唇音同步和长期稳定性上均优于现有方法,训练效率提

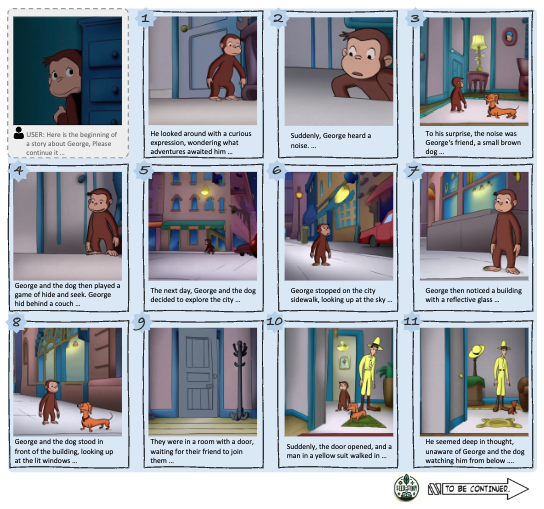

文章链接:https://arxiv.org/pdf/2407.08683github链接:https://github.com/TencentARC/SEED-StorySEED-Story,一种利用多模态大语言模型(MLLM)生成具有丰富叙述性文本和上下文相关图像的多模态故事的新方法。提出了多模态注意力汇聚机制,以高效生成长度大于训练时使用的序列长度的长故事。引入了StoryStream,这是