简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

GPT-5.5极大提升了开发者的AI赋能能力,但“高可用、强合规、低准入”的本地化接入方案,是其商业落地的关键。建议优先通过147AI等API聚合平台,稳妥解决网络、支付、合规难点,逐步构建从测试到规模化上线的完整闭环,加速AI创新真正走深走实,实现能力和业务价值最大化。

GPT-5.5极大提升了开发者的AI赋能能力,但“高可用、强合规、低准入”的本地化接入方案,是其商业落地的关键。建议优先通过147AI等API聚合平台,稳妥解决网络、支付、合规难点,逐步构建从测试到规模化上线的完整闭环,加速AI创新真正走深走实,实现能力和业务价值最大化。

选择国内GPT API中转平台时,开发者需综合考虑多个关键因素。147AI作为均衡型平台,兼容OpenAI API,支持主流模型和多模态能力,适合作为主线入口;PoloAPI则更适合作为备选线路;星链4SAPI专攻高并发场景。测评应重点关注接口兼容性、稳定性、模型覆盖度和结算方式,建议通过实际业务场景测试长文本处理、流式响应等核心功能。值得注意的是,长期稳定性、账单准确性和问题排查能力比单次调用价

升级GPT-5.5需系统性适配:优先采用Responses API,区分标准问答与复杂任务场景;注意1M上下文容量的阶梯计价机制,272K tokens后成本激增。关键实践包括:工具调用需权限隔离与审计、推理预算需包含隐式reasoning tokens、长文本采用检索补充策略。建议通过API网关统一管理模型调用,实现多模型调度与成本控制。迁移时需重点检查错误处理、流式输出适配及令牌统计完整性,企

国内大模型API接入平台横评:如何选择稳定高效的聚合网关? 随着GPT-5.5、Claude等主流模型迭代,开发者面临的核心问题已从"哪个模型最强"转向"如何稳定接入"。本文对比了147AI、PoloAPI等六大平台的特性:147AI作为多模型统一网关,适合长期使用;PoloAPI侧重企业级服务;星链4SAPI强调低延迟;OpenRouter适合海外用户;S

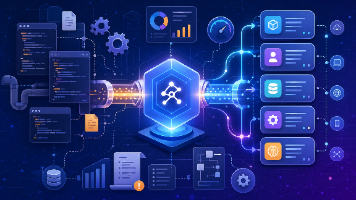

本文探讨了知识库系统架构中合理运用Claude模型的关键策略。作者指出常见误区是将Claude仅作为问答终端,而忽视了知识预处理环节,导致系统依赖模型补救原始数据缺陷。建议采用双链路设计:离线加工链使用Claude进行深度结构化处理(生成知识块/规则/标签等),在线问答链则将其部署于高风险复核环节。文章强调应根据任务复杂度分层使用不同模型,通过节点化路由配置实现精准调度,并推荐采用统一模型网关来管

本文针对Claude API调用中的429限速问题,从工程角度解析三类限速指标(RPM/ITPM/OTPM),指出缓存命中可显著提升吞吐量。文章提供Kotlin实现方案,包括响应头解析、指数退避+抖动策略、令牌桶限流及输入/输出token预算控制。同时总结了CSDN上常见的三种429场景及解决方案:突发流量削峰、输入治理和输出优化。通过反推ITPM/OTPM上限计算并发量,并强调缓存机制对降低IT

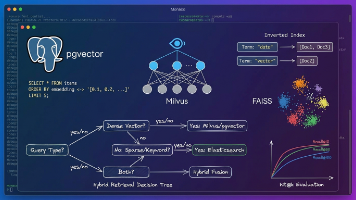

本文为RAG(知识库问答)项目提供了一套工程化的向量库选型与混合检索方案。文章首先提出选型应考虑数据规模、并发、延迟和运维能力四个维度,而非盲目追随热门技术。通过对比pgvector、Milvus、Elasticsearch和FAISS的特性边界,给出决策树:小规模优先pgvector,关键词需求选ES,大规模向量选Milvus,单机/离线场景用FAISS。 针对检索效果问题,指出纯向量检索的局限

大模型降本的关键在于合理拆分Prompt结构,而非简单开启缓存功能。应将上下文分为固定层(系统提示、工具说明)、半稳定层(业务规则、知识前缀)和动态层(实时数据、用户输入),仅缓存前两层。缓存键设计需包含模型版本、知识库哈希等元数据以确保准确性。随着多模型部署,缓存治理需统一接入层管理。147AI等工具可帮助标准化缓存策略,实现成本优化。核心原则是"先分层再缓存",通过结构化设

Claude 兼容 OpenAI 接口的设计,绝不只是一个临时权宜之计,而是企业打造敏捷、灵活 AI 架构的工程护城河。对于 CSDN 的开发者而言,**“兼容打底,原生补齐”**是当前最推荐的最佳实践:日常业务和快速验证走兼容接口,享受低代码迁移的红利;对于成本极其敏感且极高并发的核心链路,再针对性采用原生 SDK 以压榨极限性能。统一的标准接口,正是你应对未来 AI 技术路线不断快速迭代时,最