简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

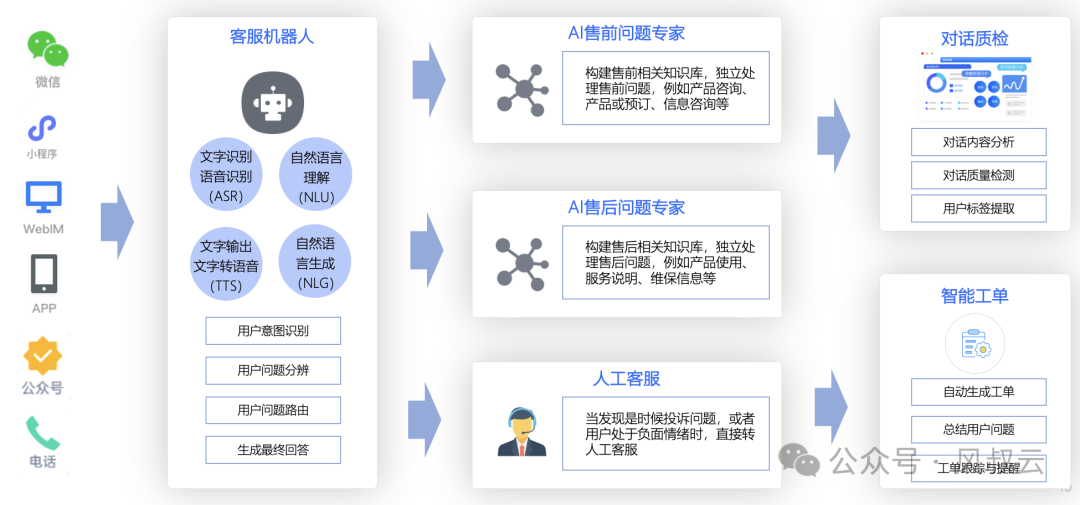

本篇文章,我们重点围绕客服场景,详细介绍如何通过AI 大模型替代传统智能客服系统。传统智能客服系统主要包括知识库、机器人、人工坐席、智能质检、工单管理等核心模块。虽然智能客服已经是一个发展了很多年的成熟领域,但仍然面临非常多的痛点。

在人工智能领域,大语言模型(Large Language Models, LLMs)正迅速成为一个热点话题。本学习路线旨在为有基本Python编程和深度学习基础的学习者提供一个清晰、系统的大模型学习指南,帮助你在这一领域快速成长。

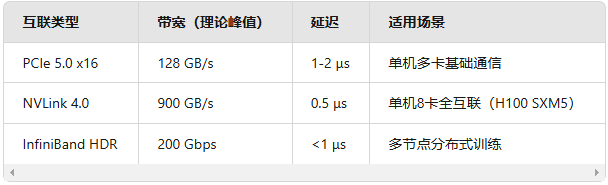

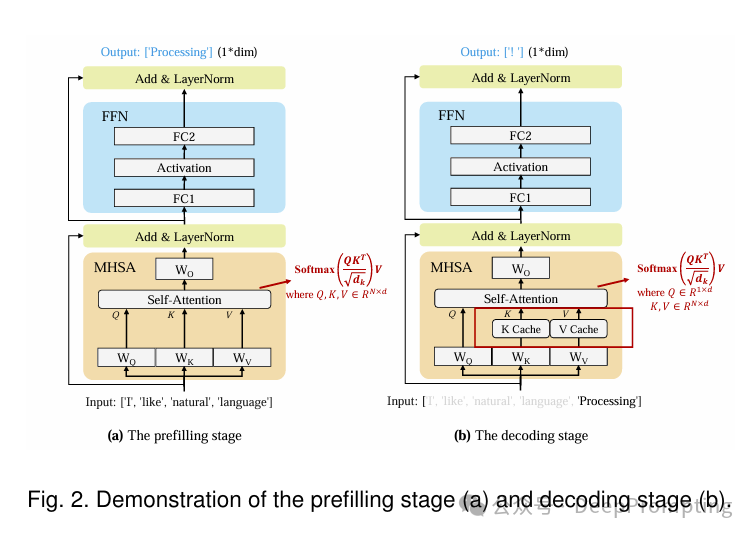

本文拆解大语言模型推理的工作流程,计算时间分布和显存占用分布,进而分析对应的优化策略,可以通过本文理解为什么优化策略朝着这个方向做。本文数据和内容引用自A Survey on Efficient Inference for Large Language Models,感兴趣的读者可以参考更多细节信息。(1)工作流和步骤分解:最受欢迎的大型语言模型(LLMs),即仅解码器结构的LLMs,通常采用自回

01: 理解人工智能、机器学习、深度学习的基本概念。: 在线课程(如Coursera, edX上的入门课程)、博客文章、YouTube视频。: 深入了解大型语言模型(如GPT-4)和人工智能生成内容的工作原理。: 阅读相关的学术论文、技术博客(如OpenAI、Google AI Blog)、专业书籍。: 学习如何实际使用这些技术。: 参与在线编程课程,使用开源工具(如TensorFlow, PyT

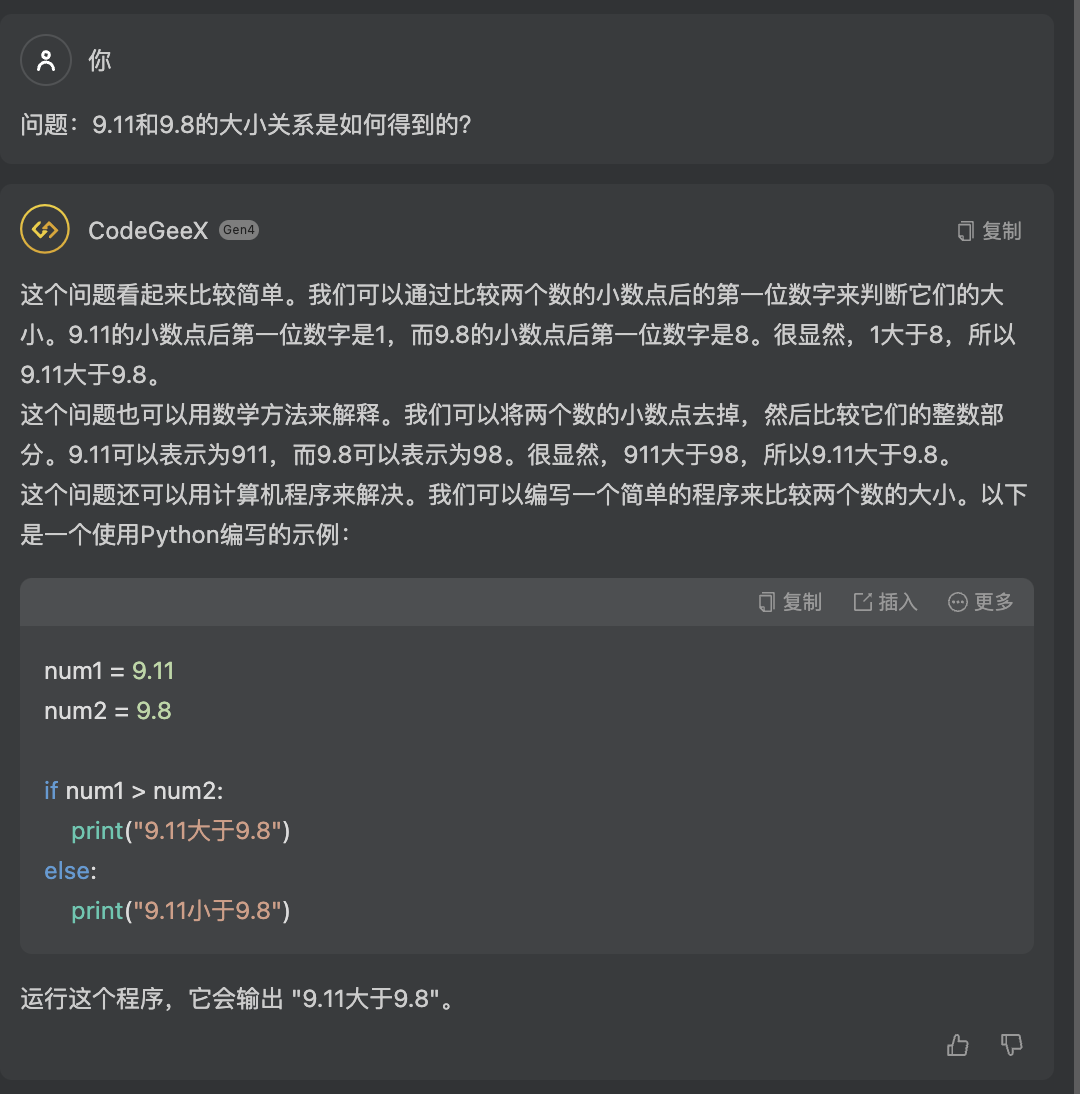

LLM(大语言模型)无法对数字进行准确运算的底层原因是什么?先看下面,一本正经的胡说八道)AI数字计算翻车示例:图1- 智谱GLM-CodeGeeX图2- 阿里-通义灵码**为什么简单的数学计算问题,AI不会做呢?以下是从网络查阅到相关资料。**“LLM能通向AGI”这一观点的反对者经常提这个问题:你们整天吹LLM会达到AGI,可为啥大模型连最简单的“多位数加法”都做不好?这质疑对很多AGI信奉者

自然语言处理(NLP)与大型语言模型(LLM)在处理人类语言方面各有独特方法:NLP侧重于具体的算法建模,而LLM则通过大规模预训练获得广泛能力,两者相辅相成。它们的融合有望带来更加丰富的人工智能交互体验、更深入的产业融合,以及人工智能伦理和技术的不断进步。

真正的飞跃,正在于RAG与推理能力的深度融合。正如下图所示,RAG技术正在经历从基础检索、混合检索、知识图谱融合、推理型RAG,最终迈向以智能体为核心的Agentic RAG生态的演进路径:

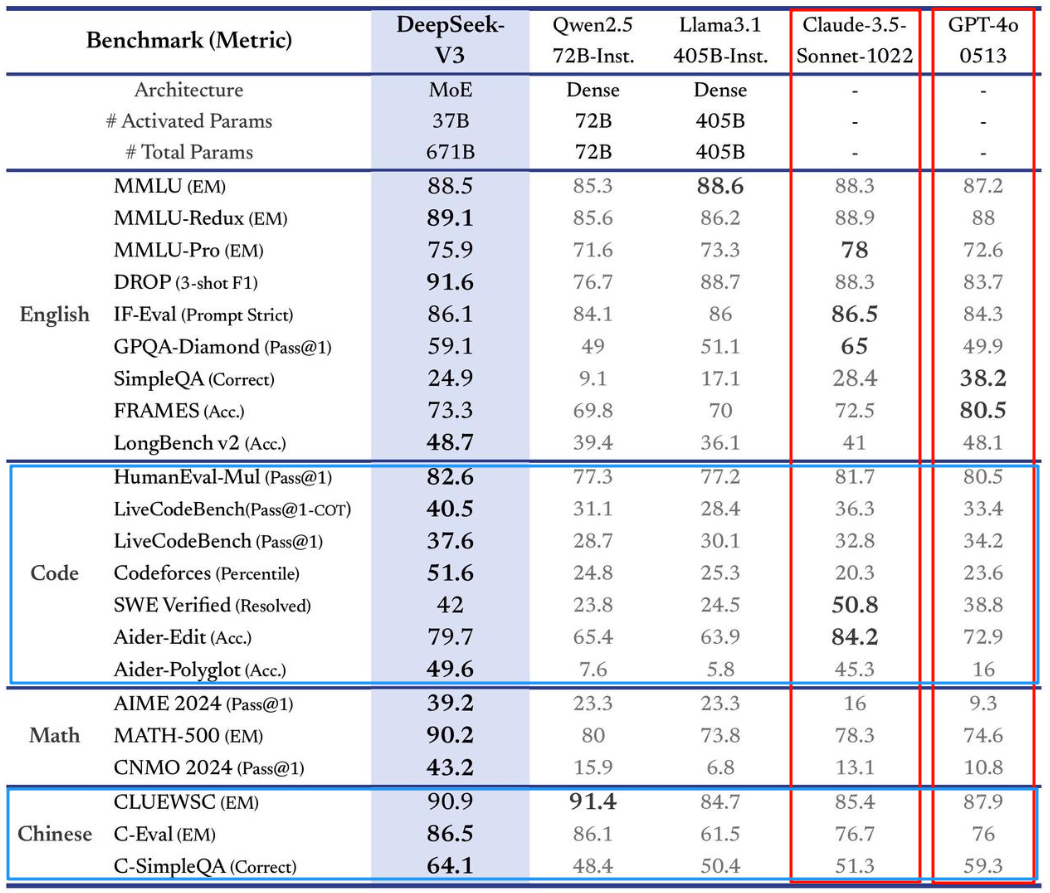

Deepseek V3是一个强大的专家混合 (MoE) 语言模型。他使用更短的训练时间,实现了与领先的闭源模型相当的性能。在代码、中文等方面和Claude 3.5 sonnet和GPT-4o等高级模型不相上下,还有些项目领先。API价格相对还是比较实惠的。

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!