简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

文章介绍了23个AI领域的核心概念和术语,包括人工智能、机器学习、深度学习、神经网络、生成式AI、大语言模型等,用通俗易懂的语言和实例解释了这些概念,旨在帮助普通人了解AI基础知识,避免在使用AI工具时遇到坑和损失。文章强调,理解这些基础概念对于与AI工具打交道的普通人来说非常重要,可以降低使用风险,提高学习效率。

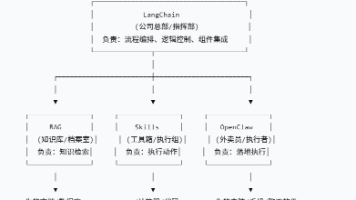

本文通过"总指挥+调度中心"的比喻,介绍了LangChain框架如何定义AI流程、集成RAG知识库和Skills工具箱,并控制其逻辑。RAG作为"查资料"模块,为模型提供信息;Skills作为"干活的"模块,执行具体功能。OpenClaw则是一个集成RAG和Skills的完整AI助手框架,可直接与用户对话、执行任务。通过本文,小白或程序员可快速理解并掌握大模型开发的核心要素。

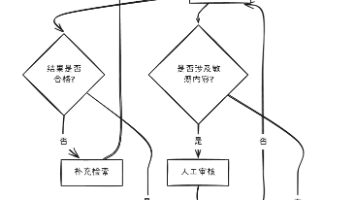

本文深入剖析了LangChain和LangGraph在开发LLM应用中的核心区别。LangChain擅长快速串接Prompt、LLM、Retriever、Tools等能力,适合快速开发简单应用。而LangGraph则专注于复杂流程的运行控制,解决分支、回退、人工审核等问题,是构建真正Agent系统的关键。文章强调,理解两者的区别在于抽象层级不同:LangChain是组件层,LangGraph是运行

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。真诚无偿分享!!!vx扫描下方二维码即可加上后会一个个给大家发【附赠一节免费的直播讲座

大模型技术已演化为涵盖模型架构、数据工程、训练与后训练、推理服务、推理时计算、应用系统及评测安全的复杂系统工程。本文从七大技术板块出发,详细解析了Transformer架构及其优化、数据工程要点、训练与后训练技术、推理与服务优化策略、推理时计算方法、应用系统开发以及评测、安全与基础设施建设,旨在为程序员和小白提供一份全面的大模型学习资源。通过掌握这些核心技术,读者将能更好地理解和应用大模型,提升自

大模型技术已演化为涵盖模型架构、数据工程、训练与后训练、推理服务、推理时计算、应用系统及评测安全的复杂系统工程。本文从七大技术板块出发,详细解析了Transformer架构及其优化、数据工程要点、训练与后训练技术、推理与服务优化策略、推理时计算方法、应用系统开发以及评测、安全与基础设施建设,旨在为程序员和小白提供一份全面的大模型学习资源。通过掌握这些核心技术,读者将能更好地理解和应用大模型,提升自

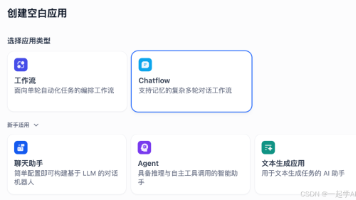

作者为创建小学英语口语陪伴智能体,对国内9大主流AI Agent平台(Dify、Coze、豆包、腾讯元器、文心智能体、通义、智谱清言、讯飞星辰、纳米)进行了详细评测。从提示词长度、语音输入支持、AI绘图功能、移动端体验等多维度对比,最终选择智谱清言作为解决方案,因其提示词支持长度适中、支持AI绘图、移动端体验良好且支持语音交互,是短板最少、整体体验最佳的平台。

AnythingLLM是一个本地部署LLM的隐私友好平台,支持本地处理文档,无需联网,确保数据安全。它提供多种LLM选项、文档交互、音频支持和AI智能体功能,特别适合教育、营销、金融和人力资源领域。通过NVIDIA RTX集成实现高效本地处理,让用户在保护敏感信息的同时享受先进AI能力,弥合了技术门槛与AI应用之间的差距。

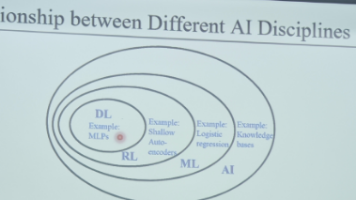

文章系统梳理了人工智能(AI)、机器学习(ML)、表征学习(RL)、深度学习(DL)和大语言模型(LLM)的概念与层级关系。AI是让机器模拟人类智能的宏大目标,ML是实现AI的核心路径,RL是让机器自动学习特征的子领域,DL是多层神经网络实现的深度表征学习,而LLM则是基于Transformer架构处理人类语言的最新成果。通过类比和实例,清晰展示了这些技术之间的演进与区别。

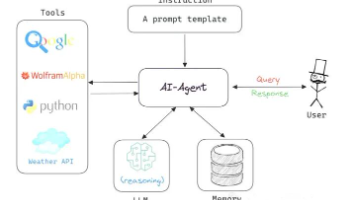

本文详细解析了构建AI智能体的8大核心技术,分为基础层(核心工作流、工作流引擎、RAG增强检索、模型微调、函数调用)和协作层(多Agent协作、MCP协议、A2A协议)。这些技术确保了AI智能体能够自主运行、高效执行任务,并实现多智能体间的协同工作,共同构成了现代AI智能体的完整技术体系,是开发下一代强大AI应用的关键。