简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在互联网时代,技术是推动社会发展的驱动,云计算则是一个包罗万象的技术栈集合,通过网络提供IAAS、PAAS、SAAS等资源,涵盖从数据中心底层的硬件设置到最上层客户的应用。给我们工作生活提供服务!

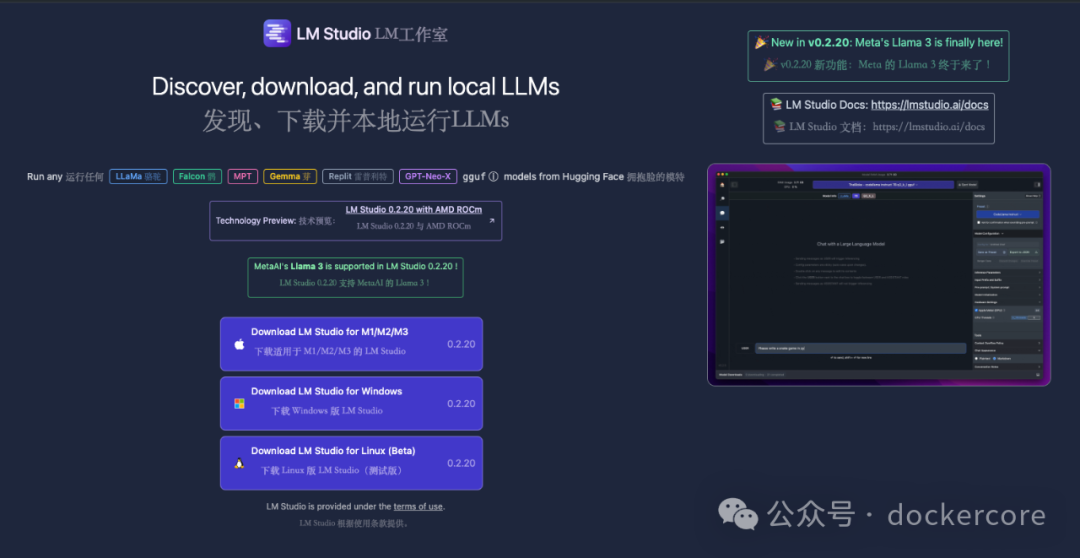

随着大语言模型 (LLM) 在各种场景中的广泛应用,许多人希望能在本地运行这些模型,从而享受更低的延迟、隐私保护和无需支付 API 费用等好处。

在大语言模型(LLM)的语境之下,“幻觉”(hallucination)指的是模型在没有足够证据支持的情况下,生成的错误或虚构的信息。

今天推荐的这本书——《从零构建大模型》(原书名 Build a Large Language Model (From Scratch))正好填补了这一空白。

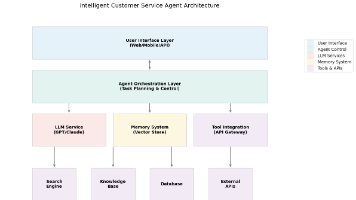

知识库是智能客服系统的"大脑",高效的知识检索和管理直接影响响应质量。这里我们实现一个基于向量数据库的知识库系统。

这篇文章讲介绍个人开发者和组织级别的大语言模型(LLM)产品开发流程参考。

Dify 是一款开源的大语言模型(LLM)应用开发平台,旨在帮助开发者快速从原型迭代到生产环境,轻松构建具备企业级能力的 AI 应用。

langchain-chatchat是一个基于 ChatGLM 等大语言模型与 Langchain 等应用框架实现,开源、可离线部署的检索增强生成(RAG)大模型知识库项目,采用Apache License,可以免费商用。

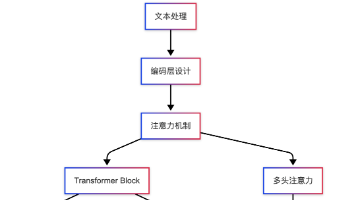

真的想入门大语言模型,只看这一个文章应该是可以入门的。但是修行下去,还是要靠自己的了!

chatgpt已经成为了当下热门,github首页的trending排行榜上天天都有它的相关项目,但背后隐藏的却是openai公司提供的api收费服务。