简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

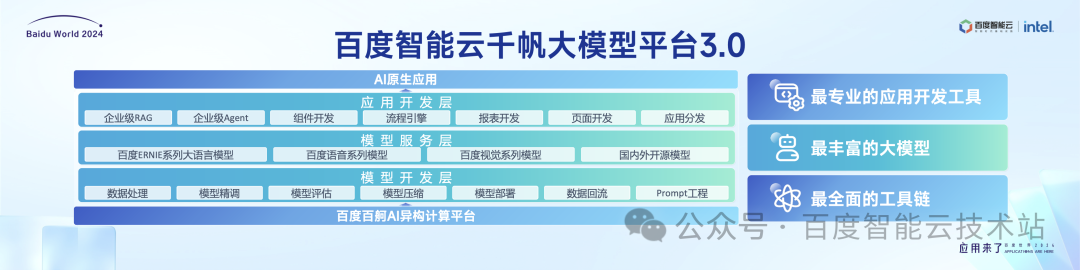

提供了最专业的应用开发工具、最丰富的大模型、最全面的工具链。千帆 ModelBuilder 提供的就是全流程的、模型训练和模型精调的工具链,包含:数据管理、训练模式、开发工具、评估优化、推理部署、大模型周边系统。除了智能体作为应用载体之外,还有非常多的企业级传统应用,过去是通过写代码的方式开发,今天我们通过大模型也实现了零代码分钟级开发,它就是 AI 速搭平台。今天我的发布到此结束,非常希望通过千

在百度百舸 · AI 计算平台的全方位支持下,Dolphin V1.0 成功上线。Dolphin V1.0 在胎儿标准切面识别上的准确率超过 90%,在乳腺病灶分型任务中准确率达到 86%。与上一代仅能执行单任务的专用模型相比,Dolphin 实现了“一模多能”的通用能力,模型复用效率显著提升。未来,海豚智能将不断深化与百度智能云的合作,基于百舸平台全周期的 AI 工程支持,持续训练、提升模型能力

从手动排查到自动化诊断,从资源监控到耗时透视,Btune 2.0 的演进反映了我们对 AI 基础设施性能调优理解的深化。在算力成本高企、模型规模激增的背景下,每一毫秒的耗时优化都意味着巨大的成本节约与效率提升。Btune 2.0 不仅是一个工具,更是一套标准化的性能治理方案。我们通过开源百度在生产级别验证过的代码与技术理念,希望帮助更多开发者跨越异构计算的复杂性陷阱,让算力释放更加高效、透明。

从公开学术成果的统计趋势来看,运动控制策略的训练通常基于小卡开展,而小卡的核心痛点是显存资源珍贵且紧张,我们会针对特定的场景,对显存里的部分内容 offload 到 Host 的内存,释放出更多显存空间,这些空闲显存可用于开启更多仿真环境的并行数。我们详细评测了此类中型尺寸模型所需的算力、显存带宽以及多机之间的互联带宽,针对这类模型,在当前的算力供应背景下,我们提供了一套高性价比的服务器算力配置,

从公开学术成果的统计趋势来看,运动控制策略的训练通常基于小卡开展,而小卡的核心痛点是显存资源珍贵且紧张,我们会针对特定的场景,对显存里的部分内容 offload 到 Host 的内存,释放出更多显存空间,这些空闲显存可用于开启更多仿真环境的并行数。我们详细评测了此类中型尺寸模型所需的算力、显存带宽以及多机之间的互联带宽,针对这类模型,在当前的算力供应背景下,我们提供了一套高性价比的服务器算力配置,

官方网页地址:https://baidu-baige.github.io/LoongForge/GitHub 地址:https://github.com/baidu-baige/LoongForge。

LoongForge 的异构并行方案系统性地解决了多模态大模型训练中编码器与解码器的「算力异构」难题,通过三级递进策略逐步释放训练效率:渐进式优化:三级方案可根据模型规模和集群配置灵活选择,无需一步到位;最小侵入性:通过 hook、并行状态切换、细粒度调度节点等机制实现,对模型代码无侵入;配置驱动:用户只需添加 1-2 个 CLI 参数即可开启,无需修改训练脚本逻辑;广泛兼容:与 pretrain

这需要构建一条完整的信任链,从来源接入、安全检测、权限声明、上架审核、运行监控,到风险处置,形成六段式的闭环治理流程。此时,安全也从辅助能力,变成下一代 AI 基础设施的核心。整体来看,我们的 Agent 安全护栏具备全流程覆盖、实时拦截、多维防护和可观测可审计四项核心能力,从而实现高召回、低误伤的防护效果,并在实际场景中得到验证。在检测能力上,我们实现了从静态分析、动态分析以及智能分析的全方位覆

这需要构建一条完整的信任链,从来源接入、安全检测、权限声明、上架审核、运行监控,到风险处置,形成六段式的闭环治理流程。此时,安全也从辅助能力,变成下一代 AI 基础设施的核心。整体来看,我们的 Agent 安全护栏具备全流程覆盖、实时拦截、多维防护和可观测可审计四项核心能力,从而实现高召回、低误伤的防护效果,并在实际场景中得到验证。在检测能力上,我们实现了从静态分析、动态分析以及智能分析的全方位覆

同时,LoongForge 内置 20 + 标准化组件,新模型仅需通过 YAML 极简配置,即可快速接入上线,直接把原本要数周的适配周期,压缩到几天,高效解决了全模态模型在国产算力上的训练适配难题。我们的目标就是要把百度深耕多年的 AI 基础设施能力,真正开放给每一家企业,让国产算力用得起、用得稳、用得好,让更多企业轻松搭上 AI 发展的快车道,实现效率提升、业务升级、高质量增长。一旦发生异常,系