简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

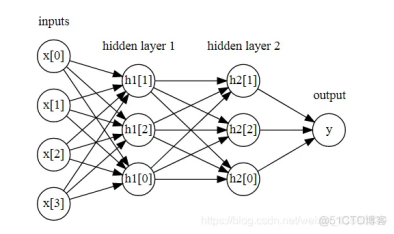

最常用的人工神经网络(Artificial Neural Network,ANN)主要包括以下四种:前馈神经网络(Feedforward Neural Network,FNN)、循环神经网络(Recurrent Neural Network,RNN)和卷积神经网络(Convolutional Neural Network,CNN),还有当前最流行的大模型常用的Transformer神经网络。前馈神

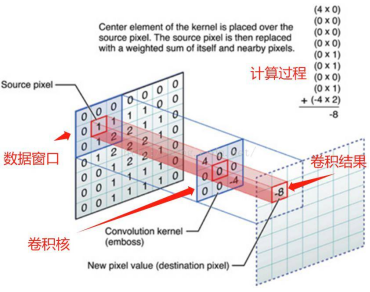

max pooling在前向传播中,把一个patch中最大的值传递给下一层,其他值会被舍弃掉。因此,在反向传播中,就是将当前梯度直接传递给前一层的某个像素,而让同一个patch中的其他像素值为0。《【CNN基础知识】一文详解反向传播(Backpropagation)在CNN中如何具体实现——卷积、池化(上)》开始推导反向传播原理之前,先回顾一下偏导数(Partial Derivatives)的链式

最常用的人工神经网络(Artificial Neural Network,ANN)主要包括以下四种:前馈神经网络(Feedforward Neural Network,FNN)、循环神经网络(Recurrent Neural Network,RNN)和卷积神经网络(Convolutional Neural Network,CNN),还有当前最流行的大模型常用的Transformer神经网络。前馈神

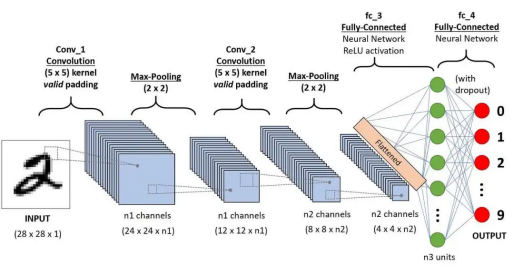

test_loader = DataLoader(test_dataset, shuffle=False, batch_size=Batch_Size)#下载测试集 MNIST 手写数字测试集。self.fc = torch.nn.Linear(20*4*4, 10)# 全连接层将它展平flatten,分成10类(0-9)classification。torch.nn.MaxPool2d(2),#

如果一个图像的尺寸是(28,28,1),即代表这个图像的是一个长宽均为28,channel为1的图像(channel也叫depth,此处1代表灰度图像)。如果使用全连接的网络结构,即,网络中的神经与与相邻层上的每个神经元均连接,那就意味着网络有28 * 28 =784个神经元,hidden层采用了15个神经元,那么需要的参数个数(w和b)就有:784*15*10+15+10=117625个,这个参