【AI大模型前沿】MobileCLIP2:苹果开发端侧大模型,让手机秒变AI神器、拍照就能写文案、搜图片零误差

MobileCLIP2是苹果公司研究人员推出的一种高效端侧多模态模型,旨在优化图像和文本的多模态理解能力。它通过多模态强化训练和对比知识蒸馏技术,显著提升了模型的性能与效率,同时保持了较小的模型规模,适合在移动端和边缘设备上部署。这一模型不仅在零样本图像分类任务中表现出色,还在多种下游任务中展现了良好的性能,包括视觉语言模型评估和密集预测任务等。

系列篇章💥

目录

前言

随着人工智能技术的不断发展,多模态模型在图像和文本处理领域的重要性日益凸显。苹果公司推出的MobileCLIP2,作为MobileCLIP的升级版本,旨在为移动端和边缘设备提供高效、低延迟的多模态解决方案。本文将对MobileCLIP2项目进行详细解析,探讨其核心功能、技术原理、应用场景及性能表现。

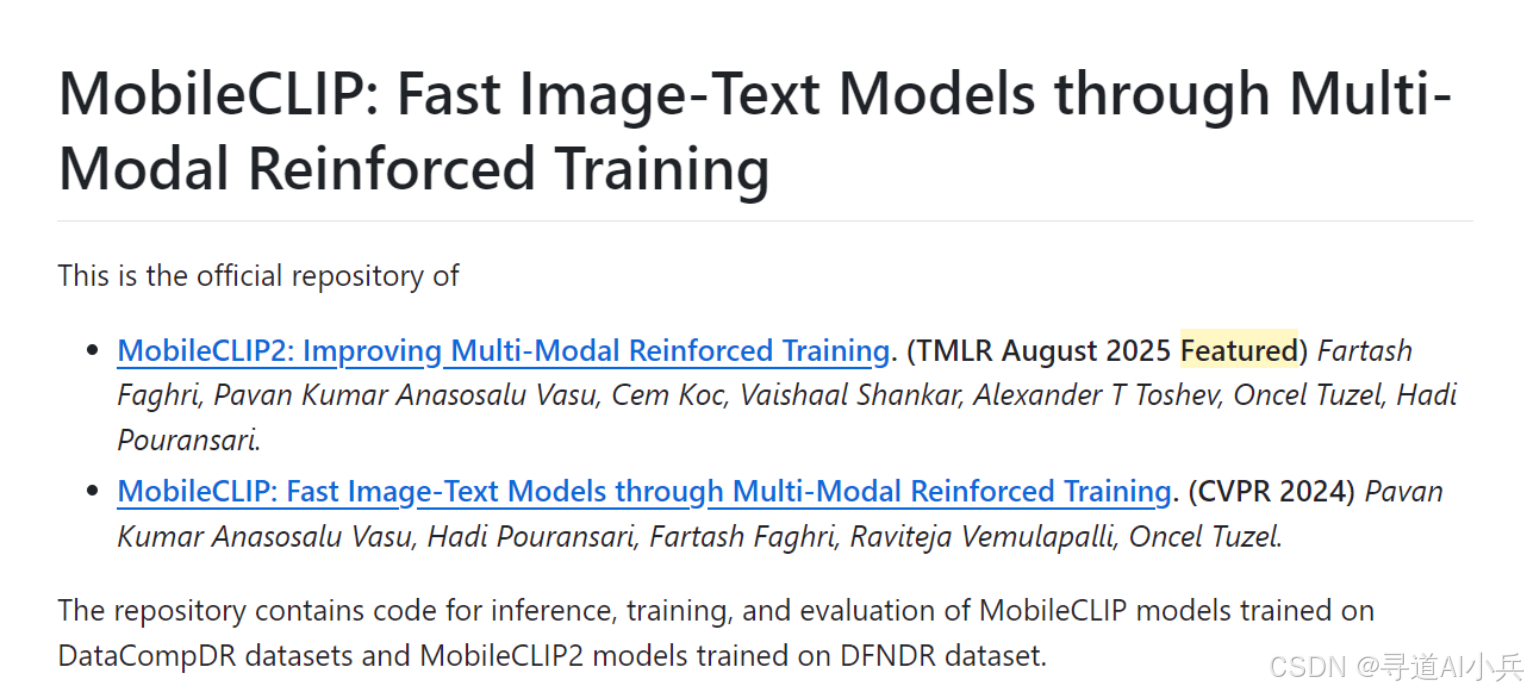

一、项目概述

MobileCLIP2是苹果公司研究人员推出的一种高效端侧多模态模型,旨在优化图像和文本的多模态理解能力。它通过多模态强化训练和对比知识蒸馏技术,显著提升了模型的性能与效率,同时保持了较小的模型规模,适合在移动端和边缘设备上部署。这一模型不仅在零样本图像分类任务中表现出色,还在多种下游任务中展现了良好的性能,包括视觉语言模型评估和密集预测任务等。

二、核心功能

(一)零样本图像分类

MobileCLIP2能够利用预训练的多模态特征直接对图像进行分类,无需额外训练数据。这一功能使得模型能够快速适应新任务,无需大量的标注数据进行微调。

例如,在实际应用中,零样本图像分类可以用于快速识别和分类新的图像类别,例如在智能相册中自动分类照片,或在内容审核中识别不合规图像。

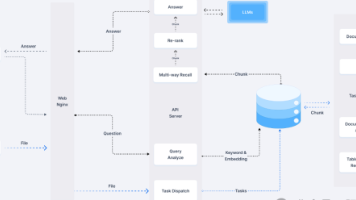

(二)文本到图像检索

根据输入的文本描述,从图像库中检索出与之最相关的图像。这一功能通过计算文本和图像的相似度,实现精准的图像搜索。

例如,在搜索引擎中,用户可以通过输入文本描述来查找相关的图像;在智能相册中,用户可以通过输入关键词来检索特定的照片。

(三)图像到文本生成

基于输入图像生成描述性的文本,为图像添加合适的标题或描述。这一功能不仅能够辅助内容理解和创作,还能为图像生成丰富的语义信息。

例如,在社交媒体平台上,用户可以利用这一功能自动生成图像的描述;在智能相册中,系统可以自动生成照片的标题。

(四)图文一致性判断

评估图像与文本描述之间的匹配度,确保图文相符。这一功能通过计算图像和文本的相似度,判断它们是否匹配。

例如,在内容审核中,可以用于检测图文是否一致,防止虚假信息的传播;在智能相册中,可以用于自动分类和整理照片。

(五)多模态特征提取:

为图像和文本提取高质量的多模态特征,支持下游任务如图像分类、目标检测、语义分割等。这一功能通过提取图像和文本的特征,为后续任务提供强大的支持。

例如,在计算机视觉任务中,可以利用这些特征进行目标检测和语义分割;在自然语言处理任务中,可以利用这些特征进行文本分类和情感分析。

三、技术原理

(一)多模态强化训练

通过优化CLIP教师模型集成和图文生成器教师模型的训练,提升模型对图像和文本的联合理解能力。这一过程不仅增强了多模态特征的表达,还提高了模型的泛化能力。

(二)对比知识蒸馏

采用对比知识蒸馏技术,从大型教师模型中提取关键信息,传递给小型学生模型。这一技术实现了模型性能与效率的平衡,使得小型模型能够继承大型模型的性能。

(三)合成文本生成

利用改进的图文生成器生成高质量的合成文本,丰富训练数据,提升模型对文本多样性的理解和生成能力。

(四)高效模型架构

设计轻量级的模型架构,如MobileCLIP2-B和MobileCLIP2-S4,在保持高性能的同时,显著降低模型的计算复杂度和推理延迟,适合端侧部署。

(五)微调与优化

在多样且高质量的图像-文本数据集上进行微调,进一步提升模型在特定任务上的表现,增强模型的实用性和适应性。

四、应用场景

(一)移动应用

在移动设备上,MobileCLIP2可以用于增强现实应用、个人助理、实时照片分类等。通过在本地完成数据处理,模型能够快速响应用户的需求,无需将数据发送到云端。

(二)边缘计算

在带宽和处理能力有限的边缘计算环境中,如无人机、机器人和远程传感器等设备,MobileCLIP2可以执行视觉识别任务,实现实时决策。

(三)物联网设备

在物联网设备中,如安全摄像头或智能家居助手,MobileCLIP2可以执行本地视觉识别,具有隐私保护、低延迟和在互联网连接不稳定环境中运行的优势。

(四)图像分类

作为轻量级的零样本图像分类解决方案,MobileCLIP2即使没有见过某类图像,只要提供文字类别标签,也能判断图片属于哪个类别。

(五)特征提取

作为特征提取器,MobileCLIP2可以为图像和文本提取高质量的多模态特征,支持下游任务如扩散模型(如Stable Diffusion)和多模态大语言模型(如LLaVA)。

五、快速使用

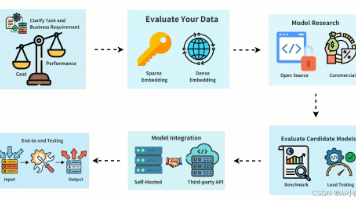

要使用MobileCLIP2模型,可以按照以下步骤进行操作:

(一)环境设置

conda create -n clipenv python=3.10

conda activate clipenv

pip install -e .

(二)安装OpenCLIP支持

git clone https://github.com/mlfoundations/open_clip.git

pushd open_clip

git apply ../mobileclip2/open_clip_inference_only.patch

cp -r ../mobileclip2/* ./src/open_clip/

pip install -e .

popd

pip install git+https://github.com/huggingface/pytorch-image-models

(三)下载预训练模型

for model in S0 S2 B S3 L-14 S4

do

hf download apple/MobileCLIP2-$model

done

(四)运行推理

import torch

import open_clip

from PIL import Image

from mobileclip.modules.common.mobileone import reparameterize_model

model, _, preprocess = open_clip.create_model_and_transforms('MobileCLIP2-S0', pretrained='/path/to/mobileclip2_s0.pt')

tokenizer = open_clip.get_tokenizer('MobileCLIP2-S0')

# For inference/model exporting purposes, please reparameterize first

model = reparameterize_model(model.eval())

image = preprocess(Image.open("docs/fig_accuracy_latency.png").convert('RGB')).unsqueeze(0)

text = tokenizer(["a diagram", "a dog", "a cat"])

with torch.no_grad(), torch.cuda.amp.autocast():

image_features = model.encode_image(image)

text_features = model.encode_text(text)

image_features /= image_features.norm(dim=-1, keepdim=True)

text_features /= text_features.norm(dim=-1, keepdim=True)

text_probs = (100.0 * image_features @ text_features.T).softmax(dim=-1)

print("Label probs:", text_probs)

通过上述代码,您可以快速加载MobileCLIP2模型并进行图像和文本的推理,获取图像与文本的相似度概率。

六、结语

MobileCLIP2作为苹果公司开源的端侧多模态模型,凭借其卓越的性能和高效的架构,在图像和文本处理领域展现出巨大的应用潜力。它不仅在零样本图像分类、文本到图像检索等任务上表现出色,还通过优化的多模态强化训练和对比知识蒸馏技术,实现了模型性能与效率的完美平衡。对于关注移动端和边缘计算应用的开发者来说,MobileCLIP2无疑是一个值得关注和探索的项目。

项目地址

- GitHub仓库:https://github.com/apple/ml-mobileclip

- HuggingFace模型库:https://huggingface.co/collections/apple/mobileclip2-68ac947dcb035c54bcd20c47

🎯🔖更多专栏系列文章:AI大模型提示工程完全指南、AI大模型探索之路(零基础入门)、AI大模型预训练微调进阶、AI大模型开源精选实践、AI大模型RAG应用探索实践🔥🔥🔥 其他专栏可以查看博客主页📑

😎 作者介绍:资深程序老猿,从业10年+、互联网系统架构师,目前专注于AIGC的探索(CSDN博客之星|AIGC领域优质创作者)

📖专属社群:欢迎关注【小兵的AI视界】公众号或扫描下方👇二维码,回复‘入群’ 即刻上车,获取邀请链接。

💘领取三大专属福利:1️⃣免费赠送AI+编程📚500本,2️⃣AI技术教程副业资料1套,3️⃣DeepSeek资料教程1套🔥(限前500人)

如果文章内容对您有所触动,别忘了点赞、⭐关注,收藏!加入我们,一起携手同行AI的探索之旅,开启智能时代的大门!

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)