程序员必学!大模型推理加速神器KV Cache原理与实战代码解析

KV Cache是大型语言模型推理的核心加速技术,通过缓存历史Key和Value值避免重复计算,将Transformer自回归推理的复杂度从O(n²)降至O(n)。本文详细解析了其工作原理、技术细节、内存优化策略,并通过PyTorch代码展示实现方式。理解KV Cache对提升大模型推理效率、解决实际部署挑战具有重要意义,是优化大模型性能的关键技术之一。

在大型语言模型(LLM)的推理过程中,KV Cache 是一项关键技术,它通过缓存中间计算结果显著提升了模型的运行效率。本文将深入解析 KV Cache 的工作原理、实现方式,并通过代码示例展示其在实际应用中的效果。

01 为什么需要 KV Cache?

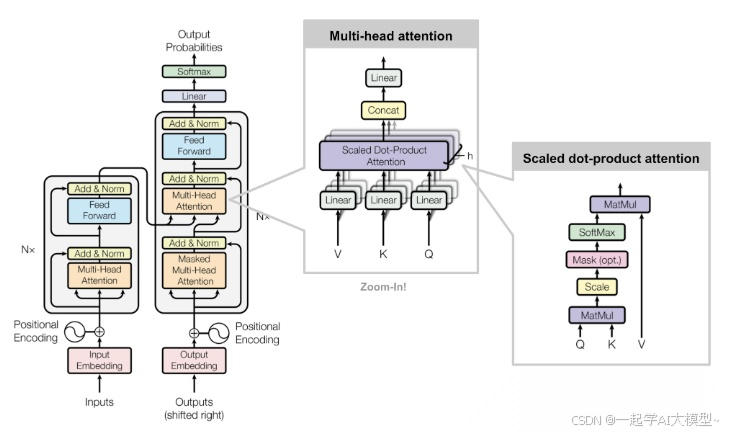

在 Transformer 进行自回归推理(如文本生成,每次生成一个 token 的时候需要结合前面所有的 token 做 attention 操作)时,计算注意力机制时需要存储 Key(K) 和 Value(V),以便下一个时间步可以复用这些缓存,而不必重新计算整个序列。

在标准 Transformer 解码时,每次生成新 token 时:

- 需要 重新计算所有之前 token 的 K 和 V,并与当前 token 进行注意力计算。

- 计算复杂度是 O(n²)(对于长度为

n的序列)。

而 KV Cache 通过存储 K 和 V 的历史值,避免重复计算:

- 只需计算 新 token 的 K 和 V,然后将其与缓存的值结合使用。

- 计算复杂度下降到 O(n)(每个 token 只与之前缓存的 token 计算注意力)。

02 KV Cache 的工作原理

KV Cache 的核心思想是缓存历史计算中的键(Key)和值(Value)矩阵,避免重复计算。具体来说:

- 在生成第一个 token 时,模型计算并缓存所有输入 token 的 K 和 V 矩阵;

- 生成后续 token 时,只需要计算新 token 的查询(Query)矩阵;

- 将新的 Q 矩阵与缓存的 K、V 矩阵进行注意力计算,同时将新 token 的 K、V 追加到缓存中。

这个过程可以用伪代码直观展示:

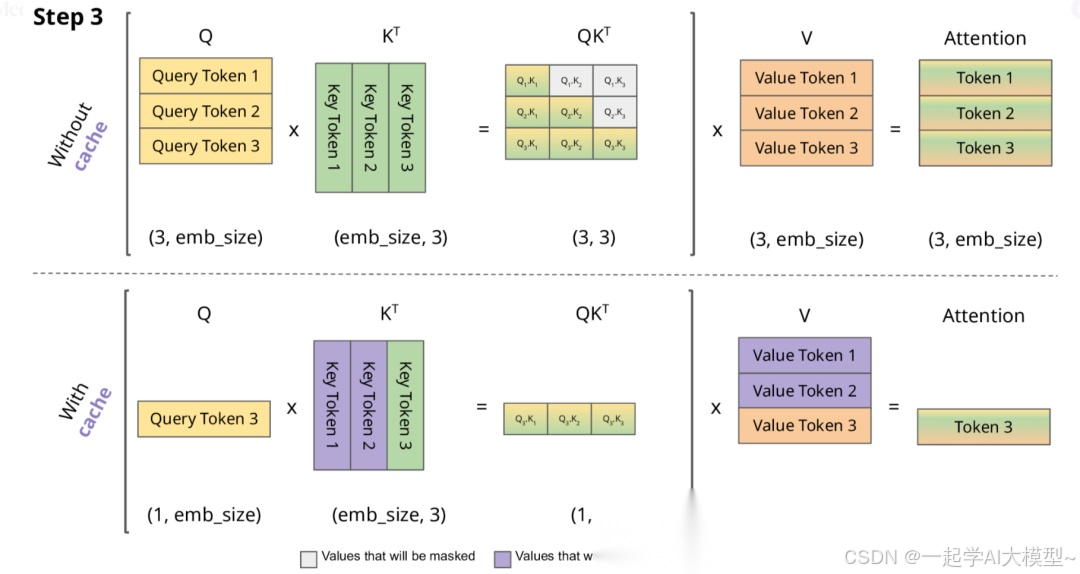

初始输入: [t0, t1, t2]首次计算: K=[K0,K1,K2], V=[V0,V1,V2] → 生成t3缓存状态: K=[K0,K1,K2], V=[V0,V1,V2]第二次计算: 新Q=Q3注意力计算: Attention(Q3, [K0,K1,K2]) → 生成t4更新缓存: K=[K0,K1,K2,K3], V=[V0,V1,V2,V3]第三次计算: 新Q=Q4注意力计算: Attention(Q4, [K0,K1,K2,K3]) → 生成t5更新缓存: K=[K0,K1,K2,K3,K4], V=[V0,V1,V2,V3,V4]...

通过这种方式,每次新生成 token 时,只需计算新的 Q 矩阵并与历史 KV 矩阵进行注意力计算,将时间复杂度从 O (n²) 降低到 O (n),极大提升了长序列生成的效率。

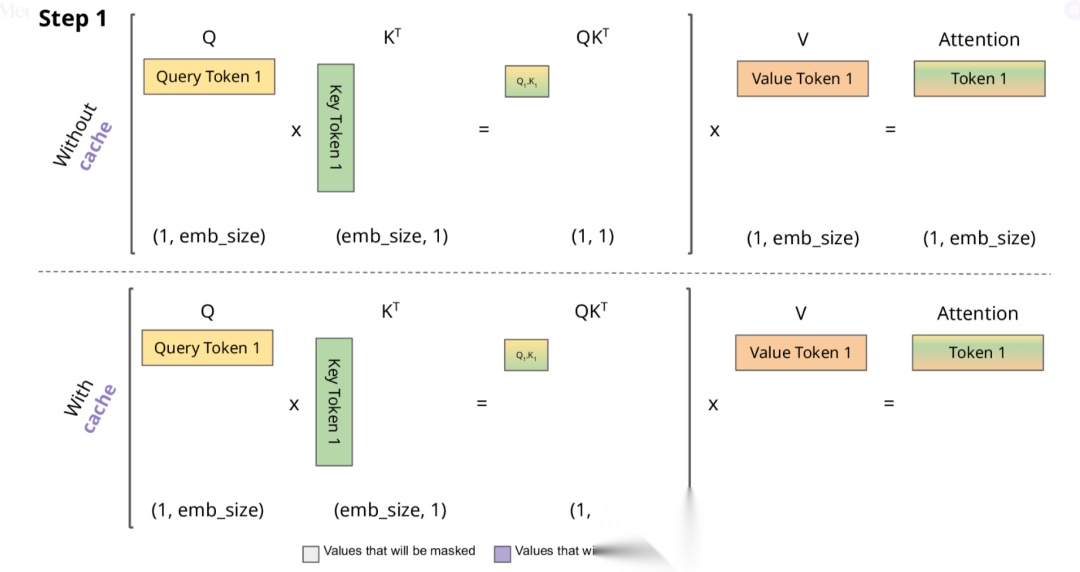

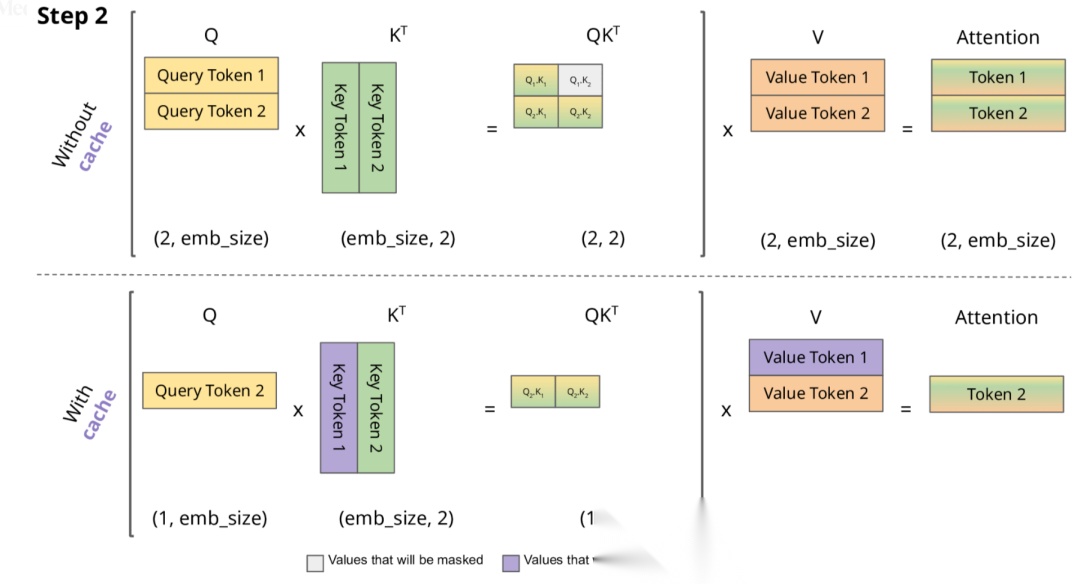

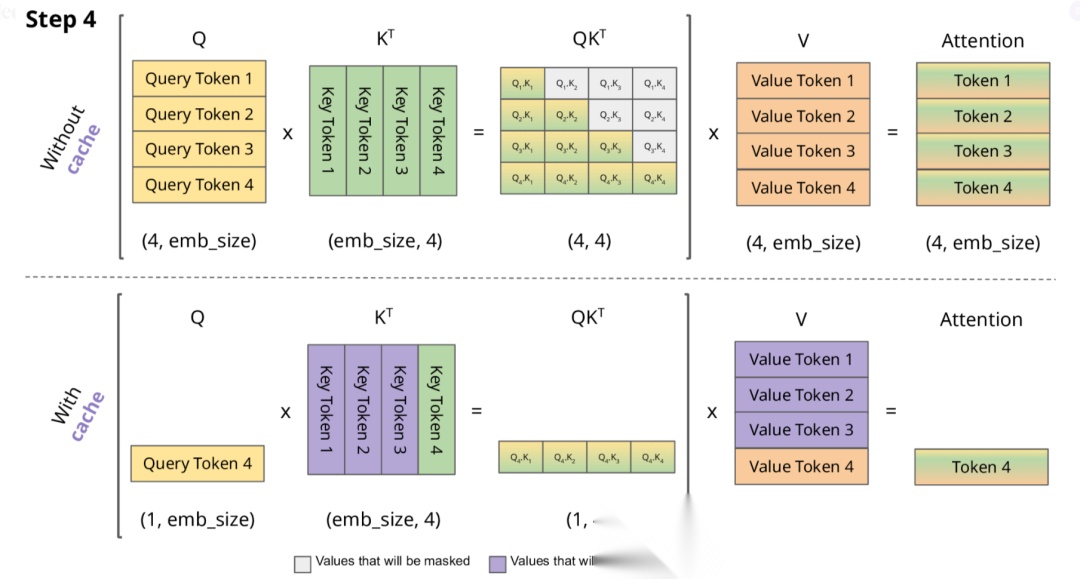

下面,我们结合示意图进一步剖析一下 KV Cache 部分的逻辑。

KV Cache 核心节约的时间有三大块:

- 前面 n-1 次的 Q 的计算,当然这块对于一次一个 token 的输出本来也没有用;

- 同理还有 Attention 计算时对角矩阵变为最后一行,和 b 是同理的,这样 mask 矩阵也就没有什么用了;

- 前面 n-1 次的 K 和 V 的计算,也就是上图紫色部分,这部分是实打实被 Cache 过不需要再重新计算的部分。

这里还有个 softmax 的问题,softmax 原本就是针对同一个 query 的所有 key 的计算,所以并不受影响。

2.1 KV Cache 的技术细节

2.1.1 缓存结构

KV Cache 通常为每个注意力头维护独立的缓存,结构如下:

- Key 缓存:形状为 [batch_size, num_heads, seq_len, head_dim];

- Value 缓存:形状为 [batch_size, num_heads, seq_len, head_dim]。

其中,seq_len 会随着生成过程动态增长,直到达到模型最大序列长度限制。

2.1.2 内存与速度的权衡

KV Cache 虽然提升了速度,但需要额外的内存存储缓存数据。以 GPT-3 175B 模型为例,每个 token 的 KV 缓存约占用 20KB 内存,当生成 1000 个 token 时,单个样本就需要约 20MB 内存。在批量处理时,内存消耗会线性增加。

实际应用中需要根据硬件条件在以下方面进行权衡:

- 最大缓存长度(影响能处理的序列长度);

- 批量大小(影响并发处理能力);

- 精度选择(FP16 比 FP32 节省一半内存)。

2.1.3 滑动窗口机制

当处理超长序列时,一些模型(如 Llama 2)采用滑动窗口机制,只保留最近的 N 个 token 的 KV 缓存,以控制内存占用。这种机制在牺牲少量上下文信息的情况下,保证了模型能处理更长的对话。

03 代码实现解析

下面以 PyTorch 为例,展示 KV Cache 在自注意力计算中的实现方式。

1. 基础自注意力实现(无缓存)

首先看一下标准的自注意力计算,没有缓存机制:

import torchimport torch.nn as nnimport torch.nn.functional as Fclass SelfAttention(nn.Module): def __init__(self, embed_dim, num_heads): super().__init__() self.embed_dim = embed_dim self.num_heads = num_heads self.head_dim = embed_dim // num_heads

# 定义Q、K、V投影矩阵 self.q_proj = nn.Linear(embed_dim, embed_dim) self.k_proj = nn.Linear(embed_dim, embed_dim) self.v_proj = nn.Linear(embed_dim, embed_dim) self.out_proj = nn.Linear(embed_dim, embed_dim)

def forward(self, x): batch_size, seq_len, embed_dim = x.shape

# 计算Q、K、V q = self.q_proj(x).view(batch_size, seq_len, self.num_heads, self.head_dim).transpose(1, 2) k = self.k_proj(x).view(batch_size, seq_len, self.num_heads, self.head_dim).transpose(1, 2) v = self.v_proj(x).view(batch_size, seq_len, self.num_heads, self.head_dim).transpose(1, 2)

# 计算注意力分数 attn_scores = (q @ k.transpose(-2, -1)) / (self.head_dim ** 0.5) attn_probs = F.softmax(attn_scores, dim=-1)

# 应用注意力权重 output = attn_probs @ v output = output.transpose(1, 2).contiguous().view(batch_size, seq_len, embed_dim)

return self.out_proj(output)

2. 带 KV Cache 的自注意力实现

下面修改代码,加入 KV Cache 机制:

class CachedSelfAttention(nn.Module): def __init__(self, embed_dim, num_heads): super().__init__() self.embed_dim = embed_dim self.num_heads = num_heads self.head_dim = embed_dim // num_heads

# 定义投影矩阵 self.q_proj = nn.Linear(embed_dim, embed_dim) self.k_proj = nn.Linear(embed_dim, embed_dim) self.v_proj = nn.Linear(embed_dim, embed_dim) self.out_proj = nn.Linear(embed_dim, embed_dim)

# 初始化缓存 self.cache_k = None self.cache_v = None

def forward(self, x, use_cache=False): batch_size, seq_len, embed_dim = x.shape

# 计算Q、K、V q = self.q_proj(x).view(batch_size, seq_len, self.num_heads, self.head_dim).transpose(1, 2) k = self.k_proj(x).view(batch_size, seq_len, self.num_heads, self.head_dim).transpose(1, 2) v = self.v_proj(x).view(batch_size, seq_len, self.num_heads, self.head_dim).transpose(1, 2)

# 如果使用缓存且缓存存在,则拼接历史KV if use_cache and self.cache_k is not None: k = torch.cat([self.cache_k, k], dim=-2) v = torch.cat([self.cache_v, v], dim=-2)

# 如果使用缓存,更新缓存 if use_cache: self.cache_k = k self.cache_v = v

# 计算注意力分数(注意这里的k是包含历史缓存的) attn_scores = (q @ k.transpose(-2, -1)) / (self.head_dim ** 0.5) attn_probs = F.softmax(attn_scores, dim=-1)

# 应用注意力权重 output = attn_probs @ v output = output.transpose(1, 2).contiguous().view(batch_size, seq_len, embed_dim)

return self.out_proj(output)

def reset_cache(self): """重置缓存,用于新序列的生成""" self.cache_k = None self.cache_v = None

3. 生成过程中的缓存使用

在文本生成时,我们可以这样使用带缓存的注意力机制:

def generate_text(model, input_ids, max_length=50): # 初始化模型缓存 model.reset_cache()

# 处理初始输入 output = model(input_ids, use_cache=True) next_token = torch.argmax(output[:, -1, :], dim=-1, keepdim=True) generated = [next_token]

# 生成后续token for _ in range(max_length - 1): # 只输入新生成的token output = model(next_token, use_cache=True) next_token = torch.argmax(output[:, -1, :], dim=-1, keepdim=True) generated.append(next_token)

# 如果生成结束符则停止 if next_token.item() == 102: # 假设102是[SEP]的id break

return torch.cat(generated, dim=1)

04 KV Cache 的优化策略

在实际部署中,为了进一步提升 KV Cache 的效率,还会采用以下优化策略:

- 分页KVCache(Paged KV Cache):借鉴内存分页机制,将连续的 KV 缓存分割成固定大小的块,提高内存利用率,代表实现有 vLLM。

- 动态缓存管理:根据输入序列长度动态调整缓存大小,在批量处理时优化内存分配。

- 量化缓存:使用 INT8 或 INT4 等低精度格式存储 KV 缓存,在牺牲少量精度的情况下大幅减少内存占用。

- 选择性缓存:对于一些不重要的层或注意力头,选择性地不进行缓存,平衡速度和内存。

05 总结

KV Cache 通过缓存中间计算结果,有效解决了 Transformer 模型在生成式任务中的效率问题,是大模型能够实现实时交互的关键技术之一。理解 KV Cache 的工作原理和实现方式,对于优化大模型推理性能、解决实际部署中的挑战具有重要意义。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

更多推荐

已为社区贡献66条内容

已为社区贡献66条内容

所有评论(0)