基于DeepSeek+RAGFlow的企业知识库搭建,大模型入门到精通,收藏这篇就足够了!

随着大语言模型LLM在各个场景的落地应用,RAG(Retrieval-Augmented Generation,检索增强生成)成为提升模型实用性和准确性的关键技术。

随着大语言模型LLM在各个场景的落地应用,RAG(Retrieval-Augmented Generation,检索增强生成)成为提升模型实用性和准确性的关键技术。企业利用 RAG 开发智能客服,提升响应效率;科研机构整合文献资源,加速知识挖掘;开发者则打造个性化助手,满足多样化需求。如何高效准确构建各自领域的知识库成为影响检索效果的关键,本文介绍基于DeepSeek + RAGFlow的知识库搭建实践,包括以下方面:

-

RAG基本概念

-

RAGFlow框架介绍

-

RAGFlow安装

-

DeepSeek+RAGFlow使用

-

应用场景

一、RAG基本概念

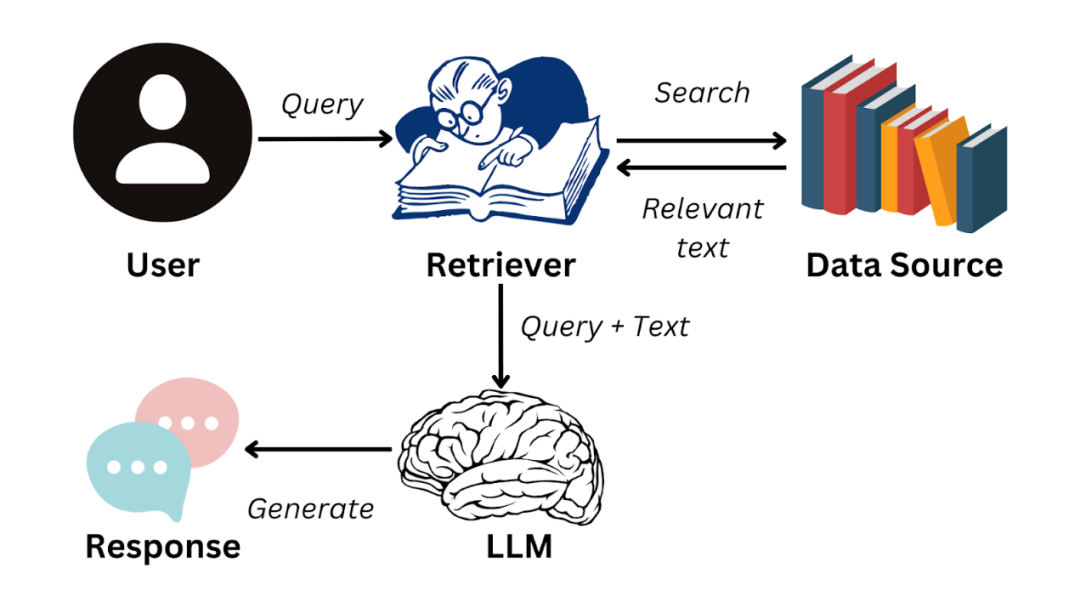

- RAG核心原理

检索增强生成(Retrieval-Augmented Generation,RAG)是当前最受关注的大模型应用范式之一,其核心思想通过「知识检索+模型生成」的组合架构,有效解决传统大模型的幻觉问题和知识更新滞后等痛点。RAG系统工作流程包含:

-

文档预处理:文本分块、向量化存储

-

实时检索:根据输入query匹配相关文档片段

-

增强生成:将检索结果与prompt结合生成最终回答

- RAG技术优势

相比传统问答系统,RAG具备:

(1)知识可追溯:每个回答都可关联原始文档依据

(2)动态知识更新:通过修改知识库即可更新模型知识

(3)成本效益:无需微调即可获得领域专精能力

(4)安全可控:通过检索模块实现内容过滤

二、RAGFlow框架介绍

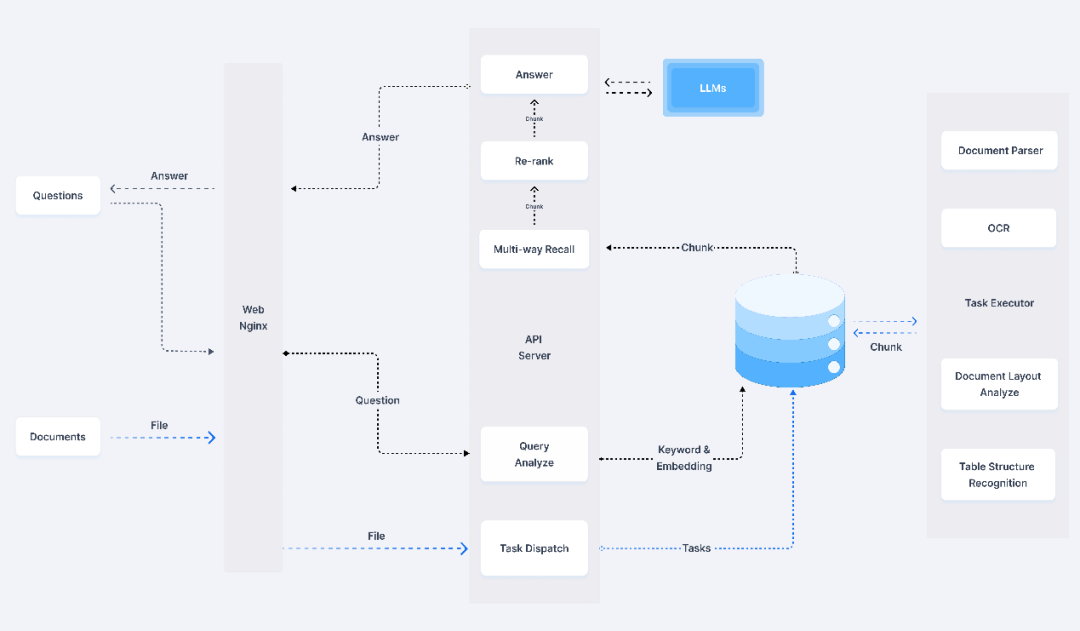

RAGFlow 是一款基于深度文档理解构建的开源 RAG(Retrieval-Augmented Generation)引擎。RAGFlow 可以为各种规模的企业及个人提供一套精简的 RAG 工作流程,结合大语言模型(LLM)针对用户各类不同的复杂格式数据提供可靠的问答以及有理有据的引用。

功能优势

(1)“Quality in, quality out”

- 基于深度文档理解,能够从各类复杂格式的非结构化数据中提取真知灼见。

- 真正在无限上下文(token)的场景下快速完成大海捞针测试。

(2)基于模板的文本切片

-

不仅仅是智能,更重要的是可控可解释。

-

多种文本模板可供选择。

(3)有理有据、最大程度降低幻觉(hallucination)

- 文本切片过程可视化,支持手动调整。

- 有理有据:答案提供关键引用的快照并支持追根溯源。

(4)兼容各类异构数据源

- 支持丰富的文件类型,包括 Word 文档、PPT、excel 表格、txt 文件、图片、PDF、影印件、复印件、结构化数据、网页等。

(5)全程无忧、自动化的 RAG 工作流

- 全面优化的 RAG 工作流可以支持从个人应用乃至超大型企业的各类生态系统。

- 大语言模型 LLM 以及向量模型均支持配置。

- 基于多路召回、融合重排序。

- 提供易用的 API,可以轻松集成到各类企业系统。

三、RAGFlow安装

- 环境要求

· CPU >= 4 核

· RAM >= 16 GB

· Disk >= 50 GB

· Docker >= 24.0.0 & Docker Compose >= v2.26.1

Linux服务器确保 vm.max_map_count 不小于 262144:

查看 vm.max_map_count 的大小:

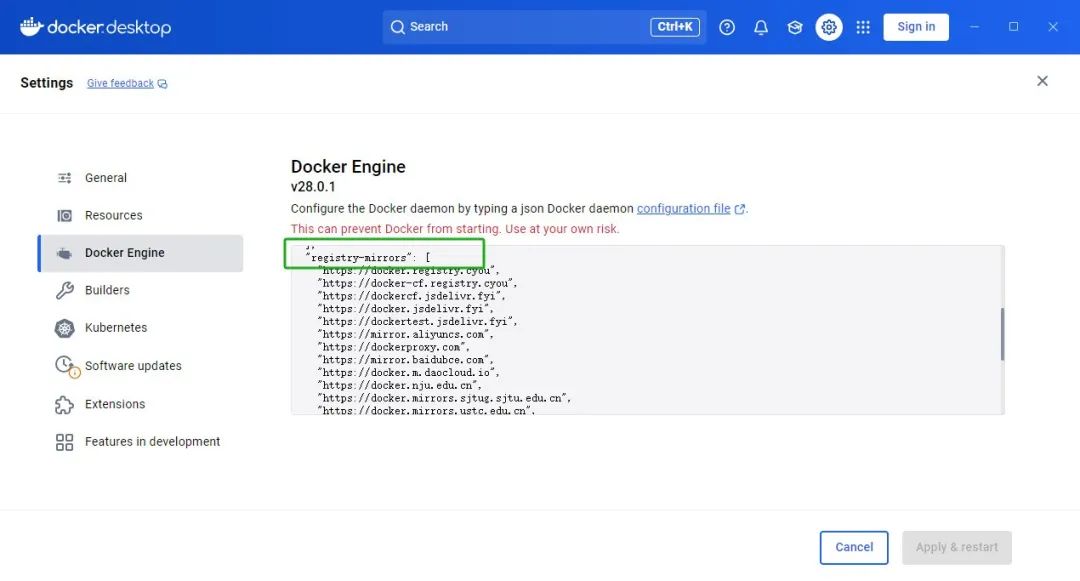

- Docker安装

如果没有在本机安装 Docker(Windows、Mac,或者 Linux), 可以参考文档自行安装。

https://docs.docker.com/engine/install/

安装完成后配置国内镜像源地址:

{

默认镜像保存于C盘,可在 设置 → Resources 中自定义设置。

- RAGFlow安装

(1) 下载安装包

官方GitHub地址:

https://github.com/infiniflow/ragflow

克隆仓库:

$ git clone https://github.com/infiniflow/ragflow.git

(2)配置与启动服务

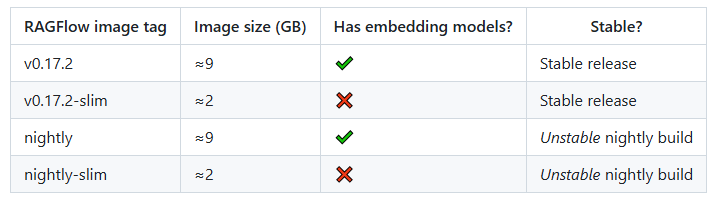

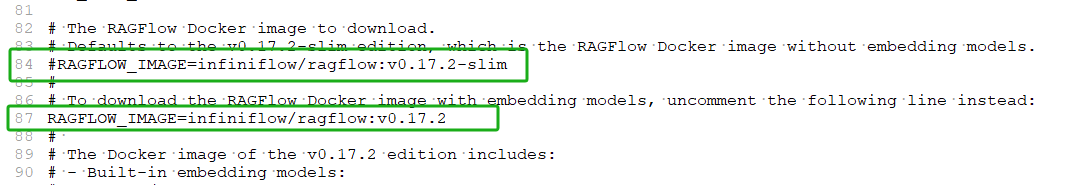

由于默认RAGFlow镜像为v0.17.2-slim,我们需要带Embedding model的完整发行版,需要修改docker/.env文件内的 RAGFLOW_IMAGE 变量,如图第84行和87行变量。

修改完成后即可启动docker服务

$cd ragflow/docker

如果你遇到 Docker 镜像拉不下来的问题,可以在 docker/.env 文件内根据变量 RAGFLOW_IMAGE 的注释提示选择华为云或者阿里云的相应镜像。

华为云镜像名:swr.cn-north-4.myhuaweicloud.com/infiniflow/ragflow

阿里云镜像名:registry.cn-hangzhou.aliyuncs.com/infiniflow/ragflow

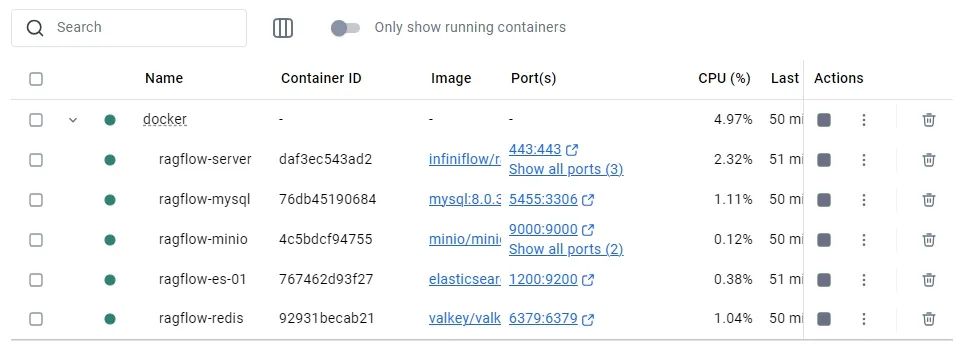

镜像拉取完成后查看是否启动成功:

也可通过命令查看服务运行状态:

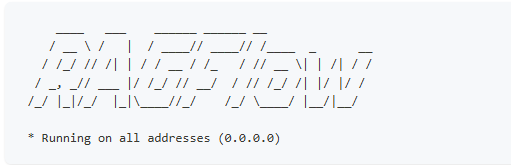

$ docker logs -f ragflow-server

浏览器访问安装服务器地址即可访问RAGFlow服务(未改动过配置则无需输入端口,默认的 HTTP 服务端口 80)。

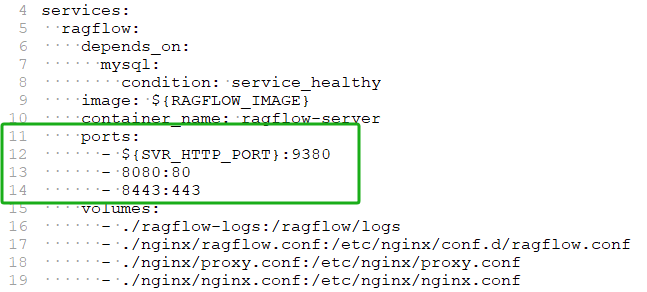

如需更新默认的 HTTP 服务端口(80), 可以在 docker-compose.yml 文件中将配置 80:80 改为:80,如8080:80,访问端口即改为8080。

所有系统配置都需要通过系统重启生效:

$ docker compose -f docker-compose.yml up –d

(3)登录使用

启动成功的登录界面:

注意第一个注册的用户默认是管理员,数据也是保存在本地服务器。

四、DeepSeek+RAGFlow使用

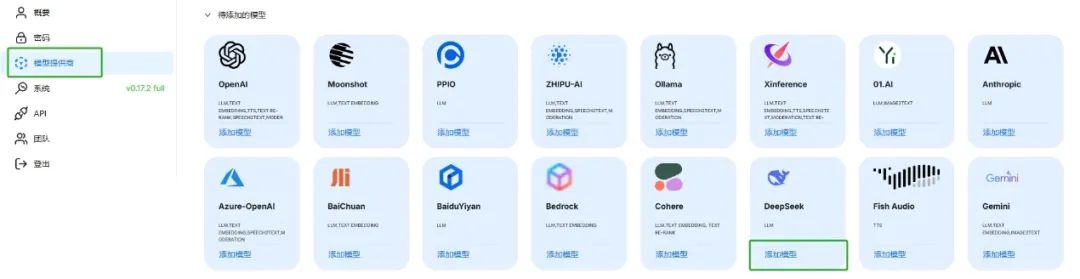

- 配置LLM模型

点击右上角头像即可进行LLM模型配置:

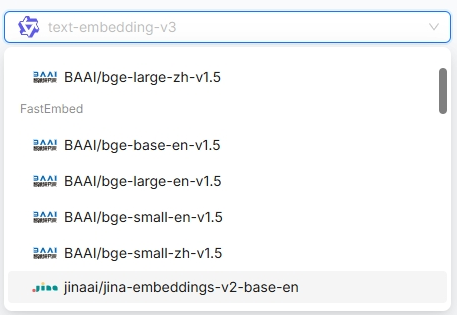

点击“System Model Settings”配置默认模型,包括Chat model、Embedding model、Image-to-text model。Embedding model可以选择内置的BAAI模型,也可根据需要自定义配置。

- 建立知识库

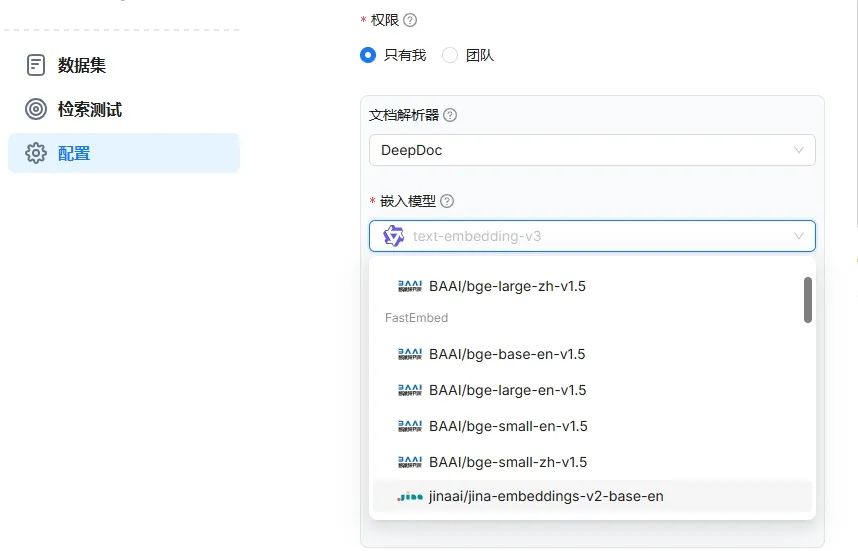

(1)点击“知识库” → “创建知识库”,在配置页面设置embedding model和chunk method。

注意:当选定embedding model并用于解析文档后,该知识库就不再支持修改该参数。

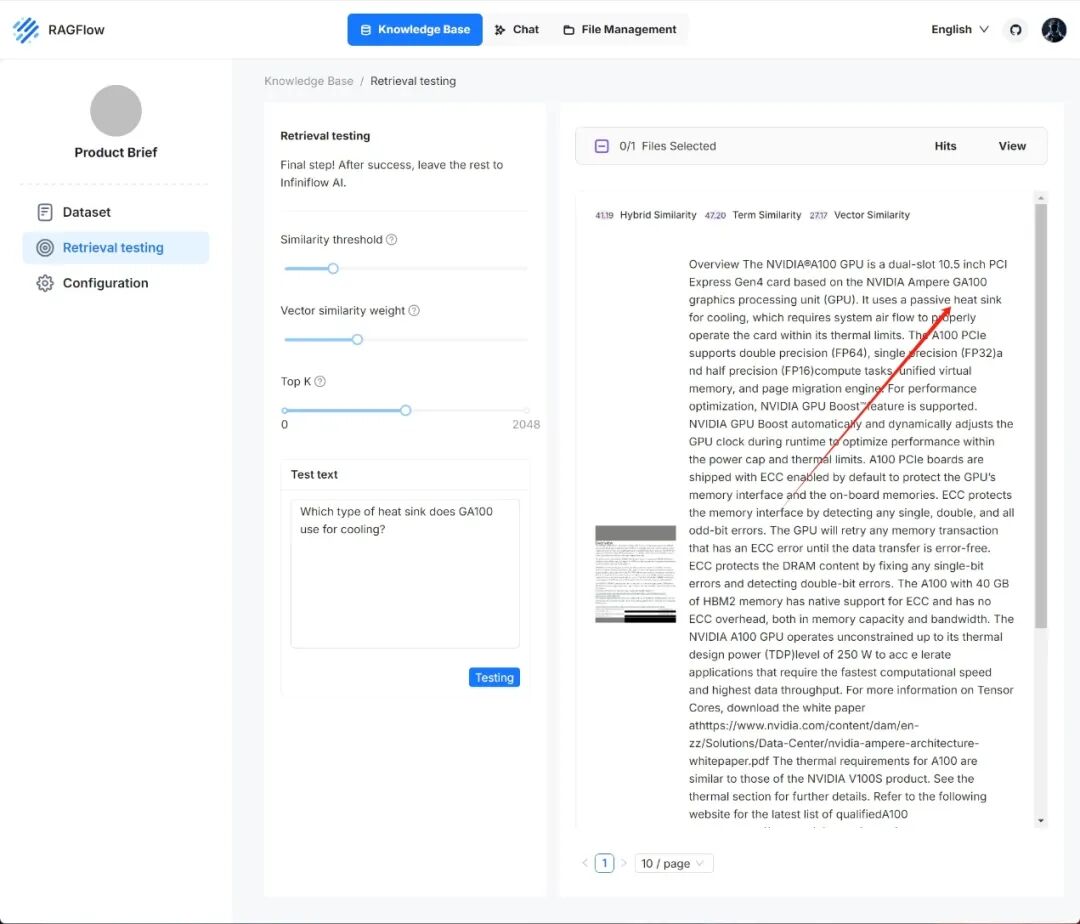

(2)在“数据集”页面上传文档,并点击开始按钮进行文档解析,完成后解析状态为“成功”。

点击解析完成的文档,即可查看其Chunk 详情,并进行检索验证。

- 基于知识库进行问答服务

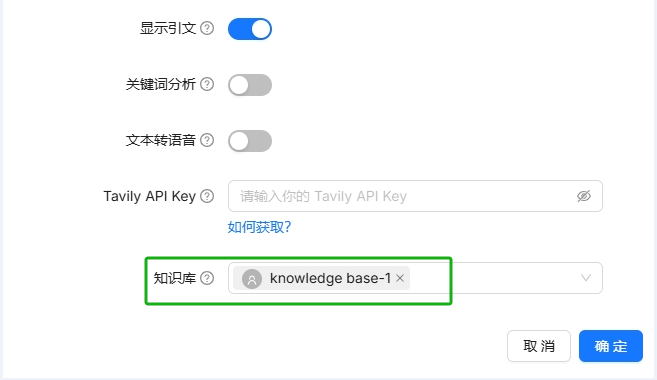

在“聊天” → “创建助手”中创建对话服务,“助理设置”中配置需要引用的知识库:

“模型设置”中配置所需的Chat模型:

测试结果如图,段后 “!” 即显示引用详情:

五、应用场景

-

智能客服:实时从企业知识库中检索相关信息,为客户提供准确、个性化的解答。

-

企业技术文档问答系统:从企业内部多个数据源中检索信息并生成结构化的文档或摘要,适合企业问答知识库管理。

-

医疗知识辅助决策:医疗专业人员可以通过 RAGFlow 快速查找相关医学文献和病例资料,为诊断和治疗提供参考。

-

金融研究报告智能解析:金融机构可以利用 RAGFlow 整合和提炼大量素材,生成金融调研与投资分析报告。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献110条内容

已为社区贡献110条内容

所有评论(0)