简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

【大模型部署】本地部署AI大模型三步走(Ollama+通义千问)

先给大家介绍一下今天的主角Ollama:Ollama是一个强大的工具,它能在本地轻松部署和运行大型语言模型,如Gemma, 助你轻松跨过这道门槛。

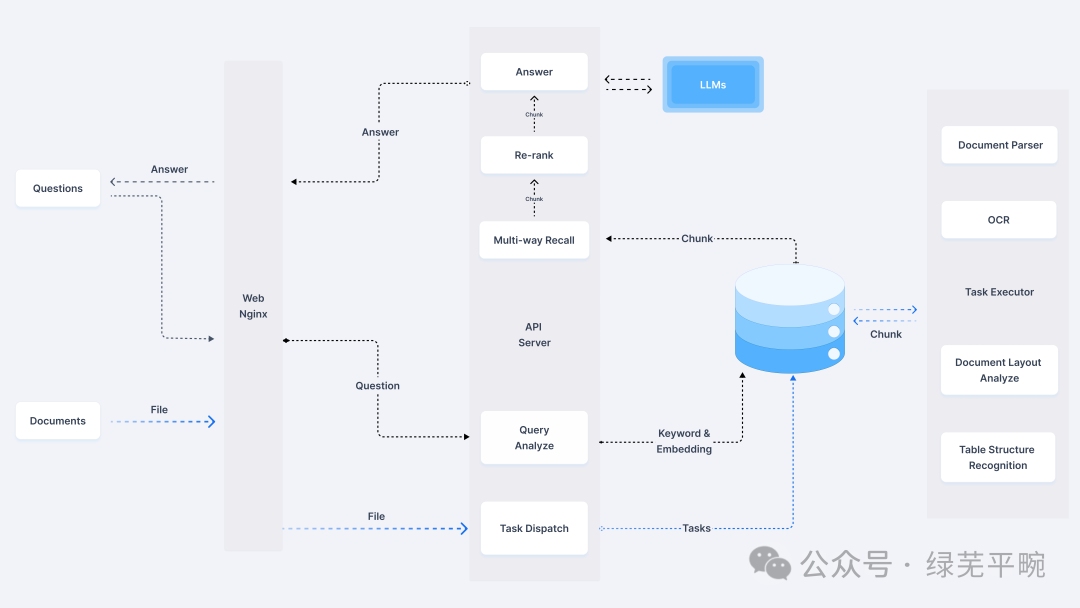

利用ollama + RAGFlow部署千问大模型构建个人知识库AI智能体应用

将开源的大语言预训练模型部署到用户设备上进行推理应用,特别是结合用户专业领域知识库构建AI应用,让AI在回答时更具有专业性,目前已经有很多成熟的应用方案。

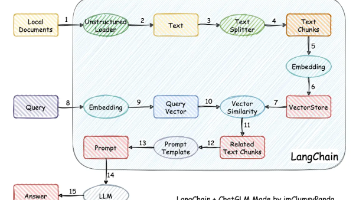

【RAG知识库】本地搭建chatgpt知识库

一种利用 langchain 思想实现的基于本地知识库的问答应用,目标期望建立一套对中文场景与开源模型支持友好、可离线运行的知识库问答解决方案。

无敌了!快去试下,国产大模型deepseek-R1本地部署手册!!

这篇文章介绍下如何快速部署deepseek-R1,本地访问,因为目前提供了最低7B数据集的模型。

使用ollama本地部署deepseek,并实现接口调用,大模型入门到精通,收藏这篇就足够了!

学习大模型的本地部署能够让你对模型的运行流程更加了解,帮助你了解不同平台和部署环境的优劣以及适用场景。

无敌了!快去试下,国产大模型deepseek-R1本地部署手册!大模型入门到精通,收藏这篇就足够了!

这篇文章介绍下如何快速部署deepseek-R1,本地访问,因为目前提供了最低7B数据集的模型。

行业落地分享:Dify在顺丰内部AI Agent落地,大模型入门到精通,收藏这篇就足够了!

Dify 是一个开源的大语言模型(LLM)应用开发平台,融合了后端即服务(Backend as a Service, BaaS)和 LLMOps 的理念,旨在帮助开发者快速构建和部署生成式 AI 应用。

有手就行大模型部署教程:怎样在个人电脑上部署盘古大模型

本文旨在探讨这一过程,为读者提供一个从理论到实践的指南,帮助大家理解大模型部署的基本原理,以及如何克服资源限制,实现个人电脑上的初步应用尝试。

Go + PostgreSQL 搞定向量存储:手把手实现RAG 基础引擎

RAG 这个技术在这几年的热度都一直非常不错,到目前为止 RAG 应该算是开发 AI 应用的必备技能了

Deepseek 本地搭建 知识库 (使用gpu cpu)

因为本地跑模型太慢,此处我就写的很简单了,本文主要以搭建本地知识库为主。