本地知识库:如何手撸一个自有知识库的RAG系统,大模型入门到精通,收藏这篇就足够了!

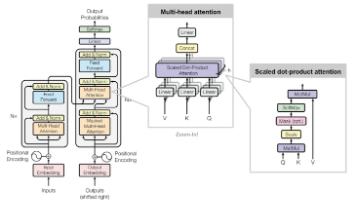

这是一种结合了检索(Retrieval)和生成(Generation)的机器学习模型,通常用于自然语言处理任务,如文本生成、问答系统等。

RAG通常指的是"Retrieval-Augmented Generation",即“检索增强的生成”。这是一种结合了检索(Retrieval)和生成(Generation)的机器学习模型,通常用于自然语言处理任务,如文本生成、问答系统等。

我们通过一下几个步骤来完成一个基于京东云官网文档的RAG系统

- 数据收集

- 建立知识库

- 向量检索

- 提示词与模型

数据收集

数据的收集再整个RAG实施过程中无疑是最耗人工的,涉及到收集、清洗、格式化、切分等过程。这里我们使用京东云的官方文档作为知识库的基础。文档格式大概这样:

{

"content": "DDoS IP高防结合Web应用防火墙方案说明\n=======================\n\n\nDDoS IP高防+Web应用防火墙提供三层到七层安全防护体系,应用场景包括游戏、金融、电商、互联网、政企等京东云内和云外的各类型用户。\n\n\n部署架构\n====\n\n\n[](\"https://jdcloud-portal.oss.cn-north-1.jcloudcs.com/cn/image/Advanced%20Anti-DDoS/Best-Practice02.png\") \n\nDDoS IP高防+Web应用防火墙的最佳部署架构如下:\n\n\n* 京东云的安全调度中心,通过DNS解析,将用户域名解析到DDoS IP高防CNAME。\n* 用户正常访问流量和DDoS攻击流量经过DDoS IP高防清洗,回源至Web应用防火墙。\n* 攻击者恶意请求被Web应用防火墙过滤后返回用户源站。\n* Web应用防火墙可以保护任何公网的服务器,包括但不限于京东云,其他厂商的云,IDC等\n\n\n方案优势\n====\n\n\n1. 用户源站在DDoS IP高防和Web应用防火墙之后,起到隐藏源站IP的作用。\n2. CNAME接入,配置简单,减少运维人员工作。\n\n\n",

"title": "DDoS IP高防结合Web应用防火墙方案说明",

"product": "DDoS IP高防",

"url": "https://docs.jdcloud.com/cn/anti-ddos-pro/anti-ddos-pro-and-waf"

}

每条数据是一个包含四个字段的json,这四个字段分别是"content":文档内容;“title”:文档标题;“product”:相关产品;“url”:文档在线地址

向量数据库的选择与Retriever实现

向量数据库是RAG系统的记忆中心。目前市面上开源的向量数据库很多,那个向量库比较好也是见仁见智。本项目中笔者选择则了clickhouse作为向量数据库。选择ck主要有一下几个方面的考虑:

- ck再langchain社区的集成实现比较好,入库比较平滑

- 向量查询支持sql,学习成本较低,上手容易

- 京东云有相关产品且有专业团队支持,用着放心

文档向量化及入库过程

为了简化文档向量化和检索过程,我们使用了longchain的Retriever工具集

首先将文档向量化,代码如下:

from libs.jd_doc_json_loader import JD_DOC_Loader

from langchain_community.document_loaders import DirectoryLoader

root_dir = "/root/jd_docs"

loader = DirectoryLoader(

'/root/jd_docs', glob="**/*.json", loader_cls=JD_DOC_Loader)

docs = loader.load()

langchain 社区里并没有提供针对特定格式的装载器,为此,我们自定义了JD_DOC_Loader来实现加载过程

import json

import logging

from pathlib import Path

from typing import Iterator, Optional, Union

from langchain_core.documents import Document

from langchain_community.document_loaders.base import BaseLoader

from langchain_community.document_loaders.helpers import detect_file_encodings

logger = logging.getLogger(__name__)

class JD_DOC_Loader(BaseLoader):

"""Load text file.

Args:

file_path: Path to the file to load.

encoding: File encoding to use. If `None`, the file will be loaded

with the default system encoding.

autodetect_encoding: Whether to try to autodetect the file encoding

if the specified encoding fails.

"""

def __init__(

self,

file_path: Union[str, Path],

encoding: Optional[str] = None,

autodetect_encoding: bool = False,

):

"""Initialize with file path."""

self.file_path = file_path

self.encoding = encoding

self.autodetect_encoding = autodetect_encoding

def lazy_load(self) -> Iterator[Document]:

"""Load from file path."""

text = ""

from_url = ""

try:

with open(self.file_path, encoding=self.encoding) as f:

doc_data = json.load(f)

text = doc_data["content"]

title = doc_data["title"]

product = doc_data["product"]

from_url = doc_data["url"]

# text = f.read()

except UnicodeDecodeError as e:

if self.autodetect_encoding:

detected_encodings = detect_file_encodings(self.file_path)

for encoding in detected_encodings:

logger.debug(f"Trying encoding: {encoding.encoding}")

try:

with open(self.file_path, encoding=encoding.encoding) as f:

text = f.read()

break

except UnicodeDecodeError:

continue

else:

raise RuntimeError(f"Error loading {self.file_path}") from e

except Exception as e:

raise RuntimeError(f"Error loading {self.file_path}") from e

# metadata = {"source": str(self.file_path)}

metadata = {"source": from_url, "title": title, "product": product}

yield Document(page_content=text, metadata=metadata)

以上代码功能主要是解析json文件,填充Document的page_content字段和metadata字段。

接下来使用langchain 的 clickhouse 向量工具集进行文档入库

import langchain_community.vectorstores.clickhouse as clickhouse

from langchain.embeddings import HuggingFaceEmbeddings

model_kwargs = {"device": "cuda"}

embeddings = HuggingFaceEmbeddings(

model_name="/root/models/moka-ai-m3e-large", model_kwargs=model_kwargs)

settings = clickhouse.ClickhouseSettings(

table="jd_docs_m3e_with_url", username="default", password="xxxxxx", host="10.0.1.94")

docsearch = clickhouse.Clickhouse.from_documents(

docs, embeddings, config=settings)

入库成功后,进行一下检验

import langchain_community.vectorstores.clickhouse as clickhouse

from langchain.embeddings import HuggingFaceEmbeddings

model_kwargs = {"device": "cuda"}~~~~

embeddings = HuggingFaceEmbeddings(

model_name="/root/models/moka-ai-m3e-large", model_kwargs=model_kwargs)

settings = clickhouse.ClickhouseSettings(

table="jd_docs_m3e_with_url_splited", username="default", password="xxxx", host="10.0.1.94")

ck_db = clickhouse.Clickhouse(embeddings, config=settings)

ck_retriever = ck_db.as_retriever(

search_type="similarity_score_threshold", search_kwargs={'score_threshold': 0.9})

ck_retriever.get_relevant_documents("如何创建mysql rds")

有了知识库以后,可以构建一个简单的restful 服务,我们这里使用fastapi做这个事儿

from fastapi import FastAPI

from pydantic import BaseModel

from singleton_decorator import singleton

from langchain_community.embeddings import HuggingFaceEmbeddings

import langchain_community.vectorstores.clickhouse as clickhouse

import uvicorn

import json

app = FastAPI()

app = FastAPI(docs_url=None)

app.host = "0.0.0.0"

model_kwargs = {"device": "cuda"}

embeddings = HuggingFaceEmbeddings(

model_name="/root/models/moka-ai-m3e-large", model_kwargs=model_kwargs)

settings = clickhouse.ClickhouseSettings(

table="jd_docs_m3e_with_url_splited", username="default", password="xxxx", host="10.0.1.94")

ck_db = clickhouse.Clickhouse(embeddings, config=settings)

ck_retriever = ck_db.as_retriever(

search_type="similarity", search_kwargs={"k": 3})

class question(BaseModel):

content: str

@app.get("/")

async def root():

return {"ok"}

@app.post("/retriever")

async def retriver(question: question):

global ck_retriever

result = ck_retriever.invoke(question.content)

return result

if __name__ == '__main__':

uvicorn.run(app='retriever_api:app', host="0.0.0.0",

port=8000, reload=True)

返回结构大概这样:

[

{

"page_content": "云缓存 Redis--Redis迁移解决方案\n###RedisSyncer 操作步骤\n####数据校验\n```\nwget https://github.com/TraceNature/rediscompare/releases/download/v1.0.0/rediscompare-1.0.0-linux-amd64.tar.gz\nrediscompare compare single2single --saddr \"10.0.1.101:6479\" --spassword \"redistest0102\" --taddr \"10.0.1.102:6479\" --tpassword \"redistest0102\" --comparetimes 3\n\n```\n**Github 地址:** [https://github.com/TraceNature/redissyncer-server](\"https://github.com/TraceNature/redissyncer-server\")",

"metadata": {

"product": "云缓存 Redis",

"source": "https://docs.jdcloud.com/cn/jcs-for-redis/doc-2",

"title": "Redis迁移解决方案"

},

"type": "Document"

},

{

"page_content": "云缓存 Redis--Redis迁移解决方案\n###RedisSyncer 操作步骤\n####数据校验\n```\nwget https://github.com/TraceNature/rediscompare/releases/download/v1.0.0/rediscompare-1.0.0-linux-amd64.tar.gz\nrediscompare compare single2single --saddr \"10.0.1.101:6479\" --spassword \"redistest0102\" --taddr \"10.0.1.102:6479\" --tpassword \"redistest0102\" --comparetimes 3\n\n```\n**Github 地址:** [https://github.com/TraceNature/redissyncer-server](\"https://github.com/TraceNature/redissyncer-server\")",

"metadata": {

"product": "云缓存 Redis",

"source": "https://docs.jdcloud.com/cn/jcs-for-redis/doc-2",

"title": "Redis迁移解决方案"

},

"type": "Document"

},

{

"page_content": "云缓存 Redis--Redis迁移解决方案\n###RedisSyncer 操作步骤\n####数据校验\n```\nwget https://github.com/TraceNature/rediscompare/releases/download/v1.0.0/rediscompare-1.0.0-linux-amd64.tar.gz\nrediscompare compare single2single --saddr \"10.0.1.101:6479\" --spassword \"redistest0102\" --taddr \"10.0.1.102:6479\" --tpassword \"redistest0102\" --comparetimes 3\n\n```\n**Github 地址:** [https://github.com/TraceNature/redissyncer-server](\"https://github.com/TraceNature/redissyncer-server\")",

"metadata": {

"product": "云缓存 Redis",

"source": "https://docs.jdcloud.com/cn/jcs-for-redis/doc-2",

"title": "Redis迁移解决方案"

},

"type": "Document"

}

]

返回一个向量距离最小的list

结合模型和prompt,回答问题

为了节约算力资源,我们选择qwen 1.8B模型,一张v100卡刚好可以容纳一个qwen模型和一个m3e-large embedding 模型

- answer 服务

from fastapi import FastAPI

from pydantic import BaseModel

from langchain_community.llms import VLLM

from transformers import AutoTokenizer

from langchain.prompts import PromptTemplate

import requests

import uvicorn

import json

import logging

app = FastAPI()

app = FastAPI(docs_url=None)

app.host = "0.0.0.0"

logger = logging.getLogger()

logger.setLevel(logging.INFO)

to_console = logging.StreamHandler()

logger.addHandler(to_console)

# load model

# model_name = "/root/models/Llama3-Chinese-8B-Instruct"

model_name = "/root/models/Qwen1.5-1.8B-Chat"

tokenizer = AutoTokenizer.from_pretrained(model_name)

llm_llama3 = VLLM(

model=model_name,

tokenizer=tokenizer,

task="text-generation",

temperature=0.2,

do_sample=True,

repetition_penalty=1.1,

return_full_text=False,

max_new_tokens=900,

)

# prompt

prompt_template = """

你是一个云技术专家

使用以下检索到的Context回答问题。

如果不知道答案,就说不知道。

用中文回答问题。

Question: {question}

Context: {context}

Answer:

"""

prompt = PromptTemplate(

input_variables=["context", "question"],

template=prompt_template,

)

def get_context_list(q: str):

url = "http://10.0.0.7:8000/retriever"

payload = {"content": q}

res = requests.post(url, json=payload)

return res.text

class question(BaseModel):

content: str

@app.get("/")

async def root():

return {"ok"}

@app.post("/answer")

async def answer(q: question):

logger.info("invoke!!!")

global prompt

global llm_llama3

context_list_str = get_context_list(q.content)

context_list = json.loads(context_list_str)

context = ""

source_list = []

for context_json in context_list:

context = context+context_json["page_content"]

source_list.append(context_json["metadata"]["source"])

p = prompt.format(context=context, question=q.content)

answer = llm_llama3(p)

result = {

"answer": answer,

"sources": source_list

}

return result

if __name__ == '__main__':

uvicorn.run(app='retriever_api:app', host="0.0.0.0",

port=8888, reload=True)

代码通过使用Retriever接口查找与问题相似的文档,作为context组合prompt推送给模型生成答案。

主要服务就绪后可以开始画一张脸了,使用gradio做个简易对话界面

- gradio 服务

import json

import gradio as gr

import requests

def greet(name, intensity):

return "Hello, " + name + "!" * int(intensity)

def answer(question):

url = "http://127.0.0.1:8888/answer"

payload = {"content": question}

res = requests.post(url, json=payload)

res_json = json.loads(res.text)

return [res_json["answer"], res_json["sources"]]

demo = gr.Interface(

fn=answer,

# inputs=["text", "slider"],

inputs=[gr.Textbox(label="question", lines=5)],

# outputs=[gr.TextArea(label="answer", lines=5),

# gr.JSON(label="urls", value=list)]

outputs=[gr.Markdown(label="answer"),

gr.JSON(label="urls", value=list)]

)

demo.launch(server_name="0.0.0.0")

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

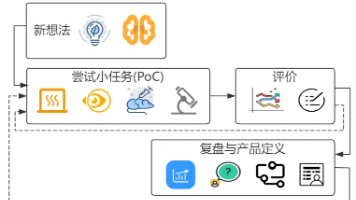

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)