实战教程:8卡4090部署qwen3+embedding+rerank模型,大模型入门到精通,收藏这篇就足够了!

本文基于实际部署项目,详细介绍英伟达4090 GPU环境下的Qwen3大模型部署方案。通过分析项目中的实际脚本和配置文件,提供可操作的部署指南。

摘要

本文基于实际部署项目,详细介绍英伟达4090 GPU环境下的Qwen3大模型部署方案。通过分析项目中的实际脚本和配置文件,提供可操作的部署指南。

- 项目结构概览

1.1 核心文件组成

4090-deployment/

├── readme.md # 部署说明文档

├── 14B_vllm_qwen3.sh # 14B模型启动脚本

├── 32B_vllm_qwen3.sh # 32B模型启动脚本

├── xinferench.sh # 嵌入和重排序服务

├── vllm_openwebui.sh # Web界面服务

└── curl.md # API测试命令

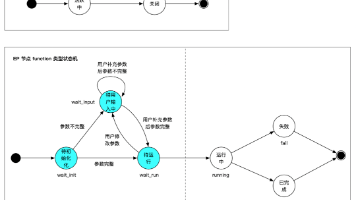

1.2 服务架构

项目采用Docker容器化部署,包含以下服务:

-

vLLM推理服务

:运行Qwen3-14B和Qwen3-32B模型

-

Xinference服务

:提供BGE-M3嵌入和重排序功能

-

OpenWebUI界面

:提供用户友好的对话界面

- 部署流程

2.1 基础环境准备

需要先切换到管理员权限:

sudo -i

2.2 启动模型服务

2.2.1 Qwen3-14B模型部署

查看14B_vllm_qwen3.sh脚本内容:

docker run -d \

--name vllm-qwen14 \

-v /data/models/Qwen3-14B:/data/models/Qwen3-14B \

-p 8014:8000 \

--ipc=host \

--restart=always \

--gpus '"device=2,3"' \

-e VLLM_ATTENTION_BACKEND=FLASHMLA \

-e VLLM_TEST_ENABLE_EP=1 \

-e VLLM_USE_V1=1 \

-e VLLM_USE_MODELSCOPE=True \

-e VLLM_LOGGING_LEVEL=WARNING \

docker.io/vllm/vllm-openai:v0.8.5 \

--model /data/models/Qwen3-14B \

--served-model-name Qwen/Qwen3-14B \

--device cuda \

--tensor-parallel-size 2 \

--enable-reasoning \

--reasoning-parser deepseek_r1 \

--max-model-len 32768 \

--trust-remote-code

关键参数说明:

-

--gpus '"device=2,3"':使用GPU 2和3

-

--tensor-parallel-size 2:2个GPU并行

-

--max-model-len 32768:最大序列长度

-

--enable-chunked-prefill:启用分块预填充优化

2.2.2 Qwen3-32B模型部署

查看32B_vllm_qwen3.sh脚本内容:

docker run -d \

--name vllm-qwen32 \

-v /data/models/Qwen3-32B:/data/models/Qwen3-32B \

-p 8032:8000 \

--ipc=host \

--restart=always \

--gpus '"device=4,5,6,7"' \

-e VLLM_ATTENTION_BACKEND=FLASHMLA \

-e VLLM_TEST_ENABLE_EP=1 \

-e VLLM_USE_V1=1 \

-e VLLM_USE_MODELSCOPE=True \

-e VLLM_LOGGING_LEVEL=WARNING \

docker.io/vllm/vllm-openai:v0.8.5 \

--model /data/models/Qwen3-32B \

--served-model-name Qwen/Qwen3-32B \

--device cuda \

--tensor-parallel-size 4 \

--enable-reasoning \

--reasoning-parser deepseek_r1 \

--max-model-len 32768 \

--trust-remote-code

关键参数说明:

-

--gpus '"device=4,5,6,7"':使用GPU 4,5,6,7

-

--tensor-parallel-size 4:4个GPU并行

-

--port 8032:32B模型使用8032端口

2.3 启动辅助服务

2.3.1 Xinference嵌入服务

查看xinferench.sh脚本内容:

docker run -d \

--name xinference \

-p 9997:9997 \

-v /data/models/bge-m3:/data/models/bge-m3 \

-v /data/models/bge-reranker-v2-m3:/data/models/bge-reranker-v2-m3 \

--gpus "device=1" \

-e XINFERENCE_HOME=/data \

docker.io/xprobe/xinference:v1.6.0 \

xinference-local -H 0.0.0.0

启动后需要在容器内启动具体模型:

docker exec -it xinference bash

xinference launch --model-path /data/models/bge-m3 -t embedding -n bge-m3

xinference launch --model-path /data/models/bge-reranker-v2-m3 -t rerank -n bge-reranker-v2-m3

2.3.2 OpenWebUI界面服务

查看vllm_openwebui.sh脚本内容:

docker run -d \

--name open-webui \

-p 8081:8080 \

-e ENABLE_OLLAMA_API=False \

-v open-webui:/app/backend/data \

--restart always \

ghcr.io/open-webui/open-webui:v0.6.5

配置说明:

-

OPENAI_API_BASE_URL:指向32B模型的API地址

-

HF_ENDPOINT:使用HuggingFace镜像源

2.4 启动顺序

根据readme.md中的说明,正确的启动顺序:

# 1. 启动大模型

bash 14B_vllm_qwen3.sh

bash 32B_vllm_qwen3.sh

# 2. 启动embedding和reranker服务

bash xinferench.sh

# 3. 可选-启动openwebui对话工具

bash vllm_openwebui.sh

# 4. 在xinference容器内启动模型

xinference launch --model-path /data/models/bge-m3 -t embedding -n bge-m3

xinference launch --model-path /data/models/bge-reranker-v2-m3 -t rerank -n bge-reranker-v2-m3

- API接口使用

3.1 对话API测试

根据curl.md文件中的示例:

3.1.1 Qwen3-32B API调用

curl -X POST http://10.3.0.196:8032/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Qwen/Qwen3-32B",

"messages": [

{"role": "system", "content": "你是一个乐于助人的大模型,请一步步思考后作答"},

{"role": "user", "content": "你是谁"}

],

"temperature": 0.6,

"top_p": 0.8,

"stream": false

}'

3.1.2 Qwen3-14B API调用

curl -X POST http://10.3.0.196:8014/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "Qwen/Qwen3-14B",

"messages": [

{"role": "system", "content": "你是一个乐于助人的大模型,请一步步思考后作答"},

{"role": "user", "content": "你是谁"}

],

"temperature": 0.6,

"top_p": 0.8,

"stream": false

}'

3.2 嵌入服务API

3.2.1 BGE-M3嵌入模型

curl -X 'POST' \

'http://10.3.0.196:9997/v1/embeddings' \

-H 'accept: application/json' \

-H 'Content-Type: application/json' \

-d '{

"model": "bge-m3",

"input": "What is the capital of China?"

}'

3.2.2 BGE-Reranker重排序模型

curl -X 'POST' \

'http://10.3.0.196:9997/v1/rerank' \

-H 'accept: application/json' \

-H 'Content-Type: application/json' \

-d '{

"model": "bge-reranker-v2-m3",

"query": "A man is eating pasta.",

"documents": [

"A man is eating food.",

"A man is eating a piece of bread.",

"The girl is carrying a baby.",

"A man is riding a horse.",

"A woman is playing violin."

]

}'

- 性能配置解析

4.1 GPU资源分配

根据脚本配置,GPU资源分配如下:

| 服务 | GPU设备 | 用途 |

|---|---|---|

| Xinference | device=1 | 嵌入和重排序 |

| Qwen3-14B | device=2,3 | 14B模型推理 |

| Qwen3-32B | device=4,5,6,7 | 32B模型推理 |

4.2 关键参数优化

4.2.1 内存优化参数

# 最大序列长度 - 控制内存使用

--max-model-len 32768

4.2.2 推理优化参数

# Flash Attention后端 - 提升推理速度

-e VLLM_ATTENTION_BACKEND=FLASHMLA

# 推理功能 - 支持思维链推理

--enable-reasoning

--reasoning-parser deepseek_r1

- 监控和维护

5.1 服务状态检查

# 检查容器状态

docker ps | grep -E "(vllm|xinference|open-webui)"

# 查看容器日志

docker logs vllm-qwen14

docker logs vllm-qwen32

docker logs xinference

docker logs open-webui

5.2 性能监控

# GPU使用率监控

nvidia-smi

# 实时GPU监控

watch -n 1 nvidia-smi

5.3 API健康检查

# 检查14B模型服务

curl -s http://10.3.0.196:8014/health

# 检查32B模型服务

curl -s http://10.3.0.196:8032/health

# 检查嵌入服务

curl -s http://10.3.0.196:9997/health

- 常见问题排解

6.1 容器启动失败

问题:Docker容器无法启动

解决方案:

# 检查GPU是否可用

nvidia-smi

# 检查端口是否被占用

netstat -tlnp | grep -E "8014|8032|9997|8081"

# 检查磁盘空间

df -h /data

6.2 模型加载失败

问题:模型路径不存在或权限问题

解决方案:

# 检查模型文件是否存在

ls -la /data/models/Qwen3-14B/

ls -la /data/models/Qwen3-32B/

# 检查模型文件权限

chmod -R 755 /data/models/

6.3 GPU内存不足

问题:CUDA out of memory

解决方案:

# 降低最大序列长度

--max-model-len 16384

# 使用更多显卡进

# 提升gpu利用限制

- 总结

本项目提供了一个完整的英伟达4090环境下的大模型部署方案,包含:

-

多模型部署

:Qwen3-14B和Qwen3-32B并行运行

-

完整服务栈

:推理、嵌入、重排序、Web界面

-

GPU资源优化

:合理的GPU分配和参数配置

-

容器化部署

:Docker容器化管理,便于维护

通过本方案,可以快速搭建企业级的大模型服务环境,支持高并发的AI应用场景。

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

更多推荐

已为社区贡献116条内容

已为社区贡献116条内容

所有评论(0)