让openclaw使用ollama部署的本地模型,实现token自由,免费养虾

摘要:本文介绍了如何在本地部署开源大模型实现token自由。作者通过ollama在本地部署llama3.2-vision模型,并与openclaw对接,避免了使用昂贵的大厂API。具体步骤包括:1)用Docker部署openclaw;2)通过ollama下载本地模型;3)让openclaw自动配置连接ollama模型;4)测试确认模型连接成功。该方法适合资源有限的开发者,能有效降低使用成本。

·

2026年开年claude code和openclaw (龙虾)突然火了,但相应的问题是token太贵了,我也是一个穷货,一直在白嫖各个大厂的免费token(再次感谢大厂的无私奉献)。但还是不够,所以穷怕的我想:能不能用ollama在本地部署一个大模型,然后让openclaw去使用本地部署的大模型,实现token自由。理论形成开始实践。

一、在本地部署openclaw

推荐windows上使用docker部署,不用做网络相关配置,还安全(或者openclaw和ollama都跑在虚拟机上)。在这里我就不详细讲如何部署openclaw,不知道的可以看我写的“openclaw部署”。

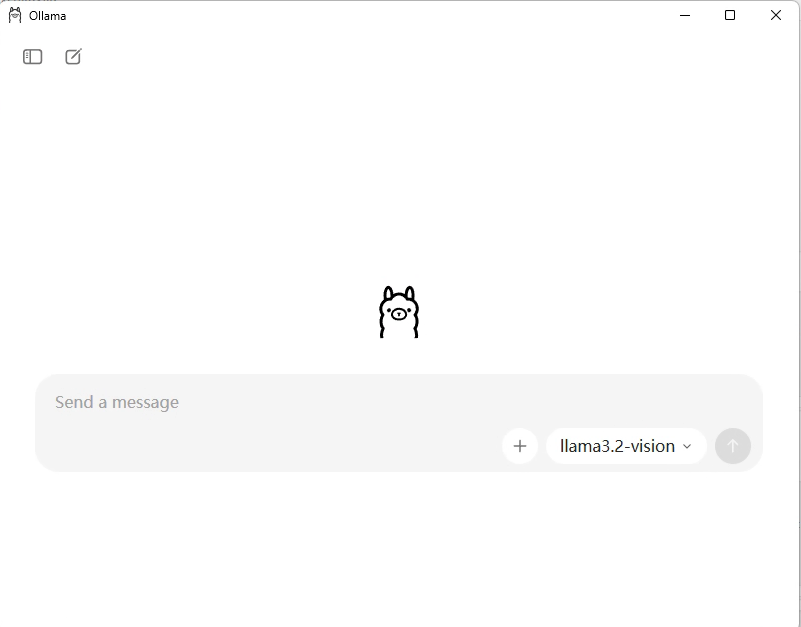

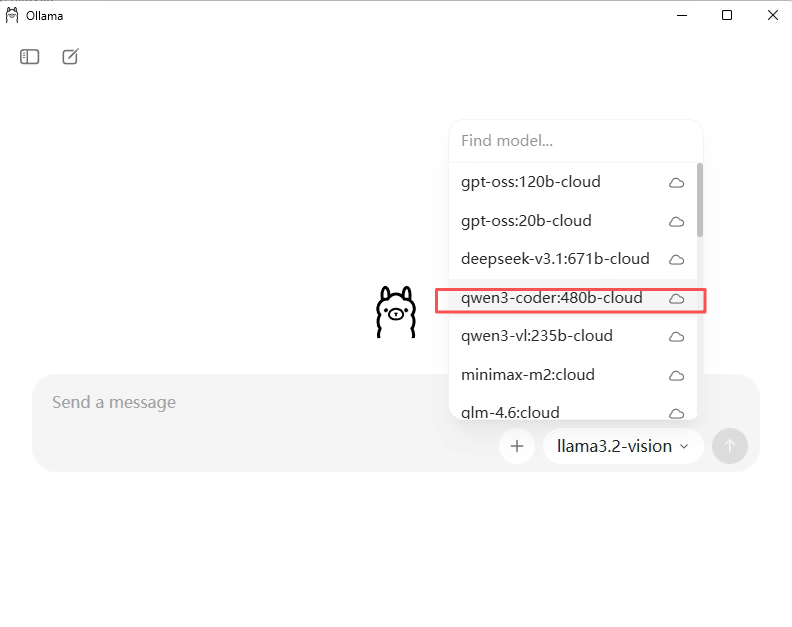

二、部署ollama,并下载模型

我这里用的是llama3.2-vision模型,若本地电脑资源有限可以使用ollama现在的云模型。

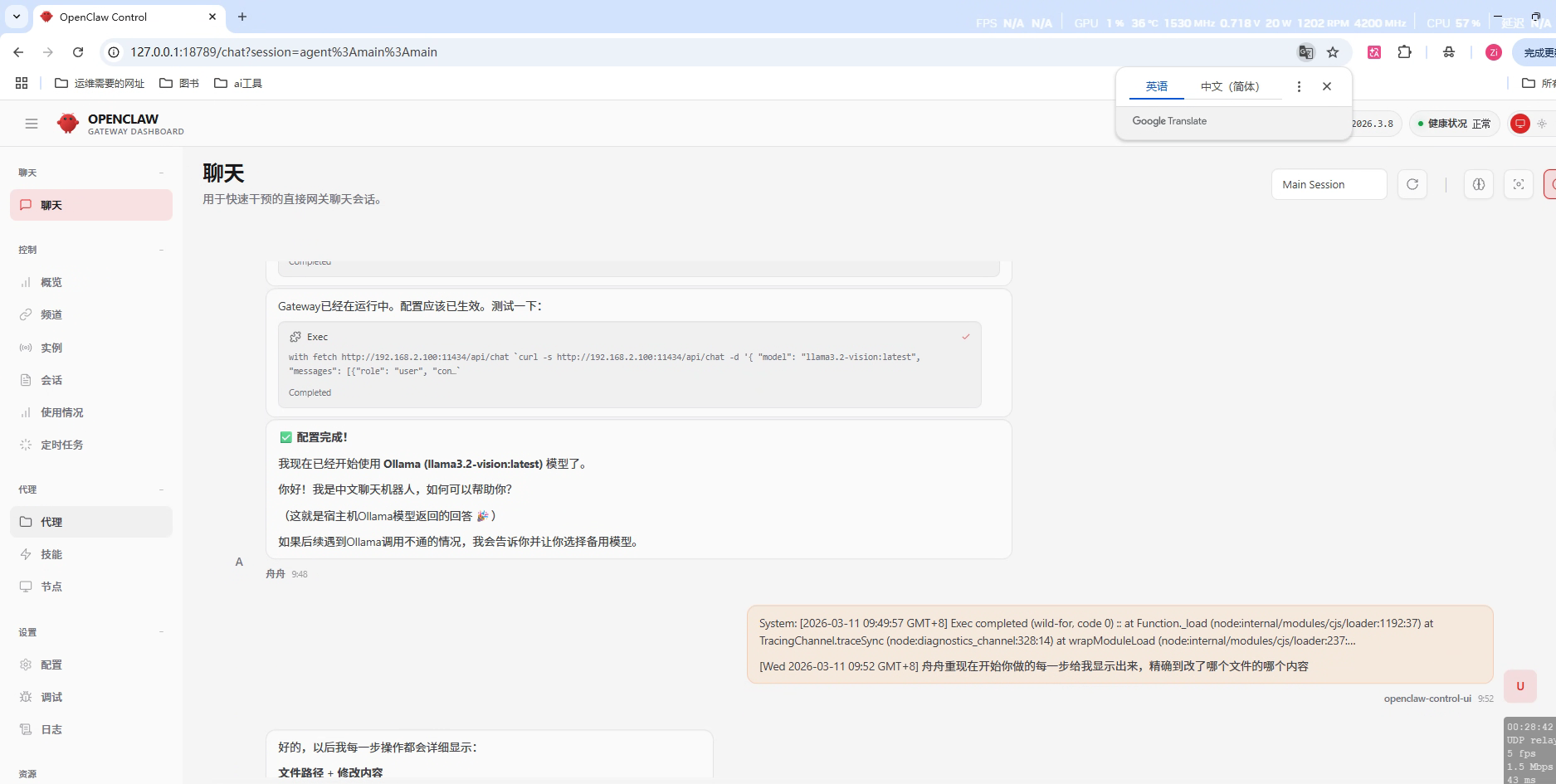

三、让openclaw去自己配置模型

这里别再手动去修改配置文件,加模型json文件里面的model了,容易改成和少改,直接让openclaw去连接ollama,如果有报错他会自己检测,如果缺少什么,他会提示你,活学活用,事半功倍。

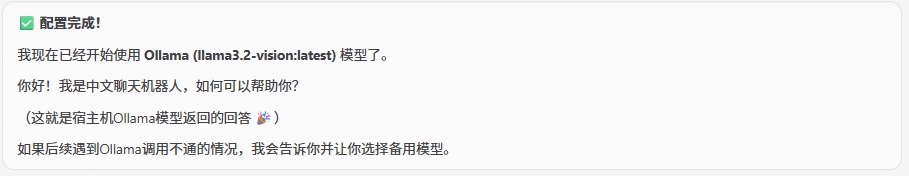

四、测试

直接在openclaw聊天页面询问他用的是什么模型,等待他回复“使用的是ollama上的模型”表示部署成功。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)