告别AI的“金鱼记忆”:2026年最前沿的9大AI记忆系统解决方案,让你的AI真正“成长”!

AI记忆系统:突破"金鱼记忆"的技术革命 当前AI产品的致命缺陷在于缺乏长期记忆能力,每次对话都从零开始。本文剖析了AI Agent记忆系统的核心挑战与前沿解决方案: 记忆本质:区分短期上下文窗口与长期记忆系统,后者需要结构化存储和跨会话复利学习能力 双层架构: 个性化记忆(用户偏好) 机构知识记忆(业务流程经验) 四大核心: 结构化信息提取 多模态存储(向量/图谱/时间索引)

树阴满地日当午,梦觉流莺时一声

你跟一个 AI 助手合作了三个月的项目。讨论了几十次需求变更,做了上百个设计决策,在反复迭代中建立了默契。

然后有一天,你说:“按照我们上个月讨论的方案来。”

AI回答:“抱歉,我不太确定你指的是哪个方案,能再说明一下吗?”

三个月的合作,归零。

这不是个例。这是 2026 年几乎所有 AI 产品的通病——金鱼记忆。

你以为 AI 在跟你"合作",其实它每次对话都是从零开始。它不记得你,不记得上次的决定,不记得三周前那个关键的 bug 修复方案。

今天这篇文章,我们来聊一个正在改变整个 AI 行业的技术命题:AI Agent 的记忆系统。

先讲清楚问题,再告诉你 2026 年最前沿的 9 个解决方案。

01 先搞懂一个反直觉的事实:上下文窗口 ≠ 记忆

很多人以为,现在大模型都支持 128K 甚至百万级 Token 了,记忆问题不是已经解决了吗?

没有。

上下文窗口就像你的"桌面"——桌面越大,能同时摊开的文件越多。但桌面不是书架。你关机了,桌面就清空了。

大模型的上下文窗口也是一样:

- 它是临时的。 对话结束,窗口清空,什么都不留。

- 它是昂贵的。 每次对话都把 20 万 Token 塞进去,API 费用会让你破产。

- 它是低效的。 塞进去的信息越多越杂,模型反而越容易"走神"——注意力被噪声淹没,关键信息反而找不到。

一个形象的比喻:上下文窗口是短期记忆,而 AI Agent 需要的是长期记忆。

就像一个新员工,入职第一天你给他看了厚厚一叠文件(上下文窗口),他可能当天都记得。但真正让一个员工变得能干的,是他在几个月的工作中积累的经验、教训和对公司的理解(长期记忆)。

AI Agent 现在缺的,就是这个。

02 记忆的两个层次:记住"你是谁" vs 记住"怎么干活"

这是一个被大多数人忽视的关键区分。

第一层:个性化记忆(Personalization Memory)

记住用户的偏好、历史、习惯。比如:

- “这个用户喜欢简洁的回复风格”

- “上次他用的收货地址是 XX 路 XX 号”

- “他是 TypeScript 开发者,偏好 Next.js 框架”

这是大多数人想到"AI 记忆"时的第一反应。它很重要,但它是更简单的那个问题。

第二层:机构知识记忆(Institutional Knowledge Memory)

这是更难、也更有价值的那个。

想象一个处理采购流程的 AI Agent。第一天,它犯了一堆错。人类纠正了它:“供应商 X 的 PO 单要用 v3 格式”、“超过 5 万美元的审批走不同流程”、“Q4 预算审查总是延期两周,别按公布的截止日期排计划”。

Agent 学会了。

然后会话结束。下一次运行,它从零开始。同样的错误,同样的纠正。它什么都没学到。

人类员工不是这样工作的。几周几个月下来,他们会积累"机构知识"——那些不成文的规则、例外情况、只有经验才能带来的模式认知。他们知道哪个供应商响应慢,哪个审批链有瓶颈,哪个利益相关者在意什么细节。

AI Agent 要真正有用,就必须有同样的能力。

它需要:

- 记住自己做过什么——不只是对话记录,还包括操作结果和收到的纠正

- 从经验中提取教训——把原始交互历史变成结构化知识

- 建立领域模型——实体、关系,以及它们如何随时间变化

- 跨会话复利——每次执行都让下一次更好,而不是从头来过

这远不是"保存聊天记录"能解决的。原始聊天记录是噪声,不是知识。 Agent 需要的是提取、结构化、能随时间复利的理解力。

03 记忆系统的四个核心操作

不管用哪个框架,一个完整的 Agent 记忆系统都在做这四件事:

🔹 摄入(Ingestion)

AI Agent 存储记忆时,好的框架不会把原始文本直接扔进数据库。它会运行一条提取流水线:识别离散的事实、解析实体("Alice"和"我们的 CTO"→ 同一个人)、打上时间戳、生成向量嵌入。输出是结构化知识,不是一坨文本。

🔹 存储(Storage)

提取后的知识进入一个或多个存储层:

| 存储类型 | 用途 | 适用场景 |

|---|---|---|

| 向量存储 | 语义相似性搜索 | “这个问题跟之前哪个类似?” |

| 知识图谱 | 实体和关系的结构化遍历 | “Alice 和 Bob 之间什么关系?” |

| 关键词索引 | 精确词匹配(BM25 等) | “包含’采购订单’的记录” |

| 时间元数据 | 时间感知查询 | “上周之后有什么变化?” |

不是每个框架都用所有这些。存储架构决定了能做什么样的检索。

🔹 检索(Retrieval)

Agent 需要上下文时,记忆系统搜索存储。最简单的是向量相似性——把查询向量化,找最近的存储向量。更高级的系统会并行运行多个策略:语义搜索、关键词匹配、图谱遍历、时间过滤,然后重新排序合并结果。

这里有一个经典的失败案例:

Agent 三周前存了一条:"供应商 X 的所有 1 万美元以上订单需要 PO 格式 v3。"今天用户问:"哪些供应商需要特殊的采购订单模板?“纯向量搜索可能完全找不到——因为"模板"和"格式"在向量空间里不一定足够近。但如果有实体感知系统,两个查询都会连接到"供应商 X”。如果有关键词索引,"采购订单"会直接命中。多策略检索能通过至少两条路径找到它,即使任何单一策略失败。

🔹 合成(Synthesis)

最高级的步骤:把检索到的事实交给 LLM,让它跨记忆推理。这是"给你 5 条相关事实"和"基于我们所知的一切,情况是这样的"之间的区别。

04 2026 年 10 大记忆框架横评

好,概念讲完了。现在进入正题——市面上到底有哪些方案,各自的优劣势是什么?

以下评测基于 Vectorize.io 的深度对比文章(2026 年 3 月最新),结合多个独立来源的补充信息,并增加了 EverMemOS 和 OpenViking 的对比。

🥇 Mem0 —— 生态最大,入门最快

定位: 个性化记忆为主 + 部分机构知识

架构: 向量数据库 + 知识图谱(双存储)

关键数据:

- GitHub Stars:~48K(社区最大)

- 融资:YC 背景 + 2400 万美元 A 轮(2025.10)

- 合规:SOC 2 + HIPAA

优势: 生态最广,几分钟内跑通第一个记忆,Python 和 JavaScript 双 SDK,兼容 LangChain、CrewAI、LlamaIndex 等主流框架。

劣势: 图谱功能(Mem0g)需要 Pro 版(月);在独立评测中得分19→$249)。

适合谁: 想快速上手、需要最广泛集成的团队。如果你需要图谱功能,准备好预算。

🥈 Hindsight —— 检索质量最强

定位: 个性化 + 机构知识(专为机构知识而建)

架构: 多策略混合检索(向量+关键词+图谱+时间感知,并行执行)

关键数据:

- GitHub Stars:~4K(增长最快)

- 融资:300万美元(2025.10)

- LongMemEval得分最高

优势: 多策略并行检索(任何单策略失败都有备选路径),在 LoCoMo、LongMemEval 和 ConvoMem 三大基准测试中表现最强,API 极简(一次调用添加记忆),自动事实提取+矛盾解决+过时信息自动过期。

劣势: 闭源,自托管需企业协议;社区比 Mem0 和 Letta 小;相对较新,生产验证记录较少。

适合谁: 对检索质量要求极高、需要机构知识记忆的团队。

🥉 Letta(前身MemGPT)—— 架构最优雅

定位: 两者兼备

架构: 受操作系统启发的分层架构(核心记忆/回忆存储/归档存储)

关键数据:

- GitHub Stars:~21K

- 融资:1000 万美元 A 轮

- 完全开源(Apache 2.0)

优势: 把记忆当操作系统来设计——Agent 主动管理自己的上下文(读/写/搜索,而不是被动接收);有状态的长期运行 Agent(不只是会话级别);Agent 可以自主决定提升/降级记忆到不同层级。

劣势: 学习曲线陡峭(操作系统级别的概念需要时间理解);全功能需要运行 Letta Server;分层架构引入了自身的复杂性——Agent 必须学会管理记忆,有时会搞砸。

适合谁: 想要最大架构灵活性、愿意投入学习成本的团队。

④ Zep + Graphiti —— 时间感知最强

定位: 两者兼备(时间维度最强)

架构: 时序知识图谱

关键数据:

- GitHub Stars:~24K(Zep + Graphiti 合计)

- Graphiti开源

优势: 时间感知是一等公民——不只知道"什么",还知道"什么时候"和"是否还有效"。处理"Alice 是预算负责人直到 2 月份,然后换成了 Bob"这类时间敏感信息极其擅长。

劣势: 使用两个独立产品(Zep + Graphiti),增加了运维复杂度;Graphiti 要求 Neo4j(重依赖);图谱构建需要大量 LLM 调用,成本较高。

⑤ Cognee —— 知识图谱最强

定位: 机构知识为主

架构: 知识图谱 + 向量存储(有向无环图)

关键数据:

- GitHub Stars:~12K

- 开源核心

优势: 多跳推理能力出色(“Alice 的经理在哪个部门?”),支持 20+ 数据源的连接器(PDF、网页、Slack 等),自动 Schema 推断。

劣势: 图谱构建慢且昂贵(大量 LLM 调用);对话记忆相对较弱;最适合大型知识库,对简单用例来说过于复杂。

⑥ SuperMemory —— 即用型方案

定位: 个性化 + 部分机构知识

架构: 记忆层 + RAG

优势: 托管服务,开箱即用,有 MCP 集成;对企业友好。

劣势: 闭源,无开源版本;自托管仅限企业协议。

⑦ LangMem —— LangGraph 生态内的选择

定位: 个性化记忆

架构: 扁平键值 + 向量

优势: LangGraph 生态内完全免费,开箱即用。

劣势: 严重依赖 LangGraph(框架锁定);无知识图谱或实体提取;仅 Python;社区最小(~1.3K Stars)。

适合谁: 已经深度使用 LangGraph 的团队。不用 LangGraph 的话,看别家。

⑧ LlamaIndex Memory —— 灵活但需自己组装

定位: 个性化记忆

架构: 可组合的缓冲区

优势: 提供各种记忆原语(Buffer、Summary、Vector等),可自由组合。

劣势: 你得自己组装记忆管道——LlamaIndex 提供零件,但不提供完整方案;无内建实体提取或知识图谱;锁定在 LlamaIndex 生态内。

⑨ EverMemOS —— 类脑架构,基准测试最强

定位: 个性化 + 机构知识(定位为"记忆操作系统")

架构: 仿生四层类脑架构 + 三阶段记忆生命周期(Engram印迹启发)

关键数据:

- GitHub Stars:~2.6K(增长中)

- 背景:陈天桥天桥脑科学研究院(TCCI)支持,盛大集团背景

- 开源协议:Apache 2.0

- 技术栈:Python 3.10+ · FastAPI · MongoDB · Elasticsearch · Milvus · Redis

- LoCoMo 得分:93.05% (自测 SOTA)

- LongMemEval-S 得分:83.00%

核心创新——“不只是数据库,而是处理器”:

EverMemOS 受人脑记忆机制启发,设计了四层架构,每层对应一个大脑功能区:

| 架构层 | 功能 | 大脑类比 |

|---|---|---|

| 代理层 | 任务理解、分解与生成 | 前额叶皮层 |

| 记忆层 | 长期记忆的提取和结构化存储 | 大脑皮层网络 |

| 索引层 | Embedding+BM25 关键词+知识图谱的混合检索 | 海马体 |

| 接口层 | API/MCP 外部集成 | 感官接口 |

记忆的生命周期分三个阶段:

- 情景轨迹形成(Episodic Trace Formation):把对话流切分成结构化的"MemCell"记忆单元

- 语义巩固(Semantic Consolidation):把 MemCell 聚类成主题性的"MemScene",同步更新用户画像

- 重建式回忆(Reconstructive Recollection):基于"必要且充分"原则,只检索当前任务真正需要的上下文

优势: 在 LoCoMo 和 LongMemEval 两大基准上自测得分最高;不只是"找记忆"更是"用记忆"——记忆主动影响模型推理;行业首个同时支持 1 对 1 对话和多人协作的记忆系统;自建了统一评测框架,公开对比了 Mem0、MemOS、Zep、MemU;模块化设计,可按场景切换记忆策略(工作场景 vs 陪伴场景);已被 AI 产品 Tanka 实际采用。

劣势: 社区规模较小(2.6K Stars),相比 Mem0(48K)差距明显;自托管部署较重——需要 MongoDB + Elasticsearch + Milvus + Redis 四个服务;基准测试为自测自报,尚未有足够的第三方独立验证;云服务 2026 年 2 月才刚开放,生产环境案例有限;文档和生态成熟度不及头部框架。

适合谁: 对基准测试性能有极高要求、需要类脑记忆架构、愿意接受较重部署方案的团队。特别适合需要同时处理个人和企业级记忆场景的产品。

⑩ OpenViking —— 文件系统范式,Token 成本杀手

定位: 上下文数据库(Context Database),统一管理记忆、资源和技能

架构: 文件系统范式(viking:// 协议)+ L0/L1/L2 三级分层加载 + 目录递归检索

关键数据:

- GitHub Stars:~8.5 K(开源不到两个月即登 GitHub Trending #10)

- 背景:字节跳动火山引擎 Viking 团队(TikTok 向量搜索基础设施同一团队)

- 开源协议:Apache 2.0

- 贡献者:55人

- 技术栈:Python · C++ 核心扩展 · 支持 OpenAI/Volcengine/自定义模型

核心创新——“一切皆文件”:

OpenViking 用一个激进但直觉化的概念重新定义了 Agent 上下文管理:把记忆、资源、技能全部变成文件系统中的目录和文件。

viking://├── resources/ # 参考文档、网页等外部资源├── user/│ └── memories/ # 用户记忆(偏好、经历)├── agent/│ ├── skills/ # Agent 技能│ └── memories/ # Agent 操作经验└── session/ # 当前会话上下文

Agent 可以像操作本地文件一样 ls、find、grep、tree,有条理地存取信息。

三级上下文加载(核心杀手锏):

| 层级 | 内容 | Token消耗 | 用途 |

|---|---|---|---|

| L0 | 一句话摘要 | <100 | 快速扫描,常驻 |

| L1 | 概览信息 | <2K | 规划决策,按需加载 |

| L2 | 完整详情 | 不定 | 深度阅读,真正需要时才拉取 |

就像人找资料时先看书名目录,再看章节摘要,最后才看正文。Token消耗直线下降。

实测性能(OpenClaw 评测):

| 配置 | 任务完成率 | 输入Token |

|---|---|---|

| OpenClaw(基线) | 35.65% | 24.6M |

| OpenClaw + LanceDB | 44.55% | 51.6M |

| OpenClaw + OpenViking | 52.08% | 4.3M |

优势: Token 成本降低极其显著(相比 LanceDB 减少 96%);文件系统范式直觉化——开发者秒懂,Agent 像操作电脑文件一样管理记忆;检索轨迹完全可视化,调试极其方便——哪一步召回烂了一目了然;自动 Session 管理——对话结束自动提取长期记忆并归档,Agent 越用越聪明;MCP Server 内置,兼容 LangChain、DeerFlow 等主流框架;字节 TikTok 级向量搜索基础设施背书。

劣势: 定位更偏"上下文管理"而非纯粹的"记忆框架"——如果你只需要简单的个性化记忆,它过于复杂;2026 年 1 月才发布,非常新,生产环境大规模验证有限;评测数据基于自家 OpenClaw Agent 平台,与其他框架的对比需更多第三方验证;需要 C++ 编译器构建核心扩展,部署门槛略高;暂无 LoCoMo/LongMemEval 等标准基准分数,难以直接与 Mem0、Hindsight 等横向对比。

适合谁: 需要长期运行 Agent、Token 成本敏感、需要可观测可调试检索流程的团队。特别适合编程 Agent(如 OpenClaw/OpenCode)和需要管理大量资源+技能+记忆的复杂 Agent 系统。

05 一张图看懂10大框架的定位

| 框架 | 个性化记忆 | 机构知识 | 开源 | 框架锁定 | 托管服务 | 社区规模 |

|---|---|---|---|---|---|---|

| Mem0 | ⭐⭐⭐ | ⭐⭐ | ✅ | 无 | ✅ | 48K |

| Hindsight | ⭐⭐⭐ | ⭐⭐⭐ | MIT | 无 | ✅ | 4K↑ |

| Letta | ⭐⭐⭐ | ⭐⭐⭐ | ✅ | 无 | ✅ | 21K |

| Zep/Graphiti | ⭐⭐ | ⭐⭐⭐ | 部分 | 无 | ✅ | 24K |

| Cognee | ⭐ | ⭐⭐⭐ | ✅ | 无 | ✅ | 12K |

| SuperMemory | ⭐⭐ | ⭐⭐ | ❌ | 无 | ✅ | — |

| LangMem | ⭐⭐ | ⭐ | ✅ | LangGraph | ❌ | 1.3K |

| LlamaIndex | ⭐⭐ | ⭐ | ✅ | LlamaIndex | 部分 | — |

| EverMemOS | ⭐⭐⭐ | ⭐⭐⭐ | ✅ | 无 | ✅ | 2.6K |

| OpenViking | ⭐⭐ | ⭐⭐⭐ | ✅ | 无 | 部分 | 8.5K |

06 怎么选?三条实操建议

建议一:先搞清楚你要解决哪个问题。

如果你只需要"记住用户偏好",Mem0 就够了。如果你需要 Agent"从经验中学习并不断改进",你需要 Hindsight、Letta 或 Zep 这类支持机构知识的方案。

建议二:挑 2-3 个框架,用你自己的数据跑一遍。

基准测试是很好的起点,但你的数据有自己的形状和查询模式。实测才是真理。

建议三:关注"遗忘"能力,不只是"记忆"能力。

2026 年的最佳实践之一是:不是所有东西都值得记住。 好的记忆系统需要时间衰减、相关性评分、或用户自定义的遗忘策略。全记住不是优势,是灾难——过时的旧信息会通过检索回来,用陈旧的假设污染上下文。

07 更大的图景:2026 是 AI 记忆元年

36 氪在年初发了一篇深度文章,标题就叫《2026,进入 AI 记忆元年》。

文章指出:过去两年,围绕 AI 记忆形成了"你方唱罢我登场"的热闹。2023 年是向量数据库(Milvus、Pinecone、FAISS),2024-2025 年是记忆框架(Letta、Mem0、MemOS),2026 年开始,连模型厂商都下场了——Claude 要在 Cowork 中加入记忆能力,谷歌发布了 Nested Learning 让模型自动修改参数实现记忆。

与此同时,新的研究突破也在涌现。一种叫 “观察式记忆”(Observational Memory) 的新技术,让 AI Agent 保留数月的对话历史并随时调用,在长上下文基准测试中全面超越 RAG 方案,同时将记忆成本降低约 10 倍。

这些信号都指向同一个方向:

未来 Agent 的能力上限,可能不再取决于模型参数规模,而是取决于记忆系统如何与工具、环境和用户交互。

记忆不只是一个技术优化手段。它正在成为 AI 产品的核心竞争力。

用户会立刻感知到 AI 是否记得之前的决策和偏好。记忆能力,将成为下一轮 AI 产品竞争的关键战场。

AI行业迎来前所未有的爆发式增长:从DeepSeek百万年薪招聘AI研究员,到百度、阿里、腾讯等大厂疯狂布局AI Agent,再到国家政策大力扶持数字经济和AI人才培养,所有信号都在告诉我们:AI的黄金十年,真的来了!

在行业火爆之下,AI人才争夺战也日趋白热化,其就业前景一片蓝海!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

人才缺口巨大

人力资源社会保障部有关报告显示,据测算,当前,****我国人工智能人才缺口超过500万,****供求比例达1∶10。脉脉最新数据也显示:AI新发岗位量较去年初暴增29倍,超1000家AI企业释放7.2万+岗位……

单拿今年的秋招来说,各互联网大厂释放出来的招聘信息中,我们就能感受到AI浪潮,比如百度90%的技术岗都与AI相关!

就业薪资超高

在旺盛的市场需求下,AI岗位不仅招聘量大,薪资待遇更是“一骑绝尘”。企业为抢AI核心人才,薪资给的非常慷慨,过去一年,懂AI的人才普遍涨薪40%+!

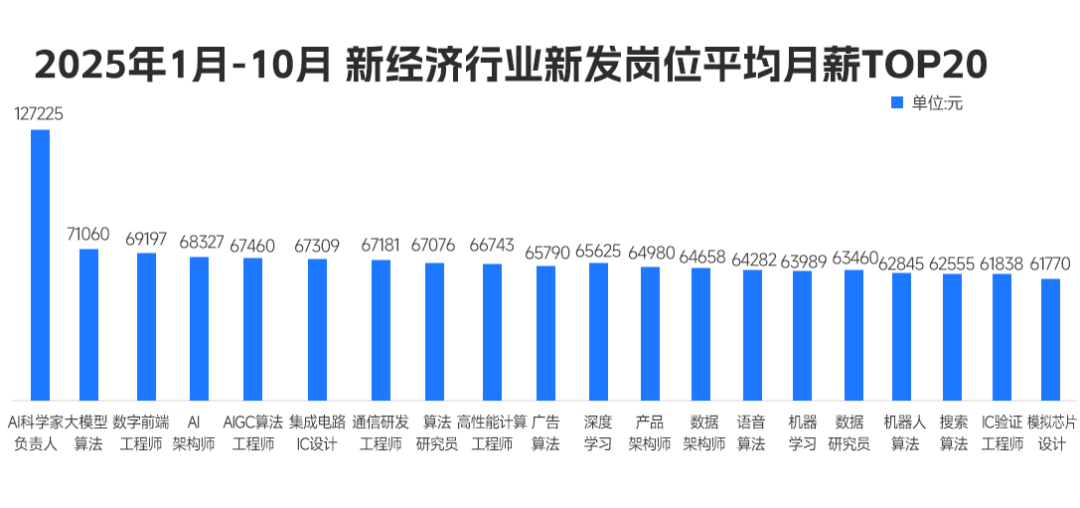

脉脉高聘发布的《2025年度人才迁徙报告》显示,在2025年1月-10月的高薪岗位Top20排行中,AI相关岗位占了绝大多数,并且平均薪资月薪都超过6w!

在去年的秋招中,小红书给算法相关岗位的薪资为50k起,字节开出228万元的超高年薪,据《2025年秋季校园招聘白皮书》,AI算法类平均年薪达36.9万,遥遥领先其他行业!

总结来说,当前人工智能岗位需求多,薪资高,前景好。在职场里,选对赛道就能赢在起跑线。抓住AI风口,轻松实现高薪就业!

但现实却是,仍有很多同学不知道如何抓住AI机遇,会遇到很多就业难题,比如:

❌ 技术过时:只会CRUD的开发者,在AI浪潮中沦为“职场裸奔者”;

❌ 薪资停滞:初级岗位内卷到白菜价,传统开发3年经验薪资涨幅不足15%;

❌ 转型无门:想学AI却找不到系统路径,83%自学党中途放弃。

他们的就业难题解决问题的关键在于:不仅要选对赛道,更要跟对老师!

我给大家准备了一份全套的《AI大模型零基础入门+进阶学习资源包》,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。😝有需要的小伙伴,可以VX扫描下方二维码免费领取🆓

更多推荐

已为社区贡献42条内容

已为社区贡献42条内容

所有评论(0)