deepseek总是服务器繁忙怎么办?试试这些有效解决方法!

使用DeepSeek时,最让人头疼的就是突然弹出 “服务器繁忙,请稍后再试”,正赶着急事的时候简直能急死人!别慌,今天就给大家分享几个超实用的解决办法,让你摆脱服务器依赖,想什么时候用就什么时候用。

使用DeepSeek时,最让人头疼的就是突然弹出 “服务器繁忙,请稍后再试”,正赶着急事的时候简直能急死人!别慌,今天就给大家分享几个超实用的解决办法,让你摆脱服务器依赖,想什么时候用就什么时候用。

一、DS 本地部署大师

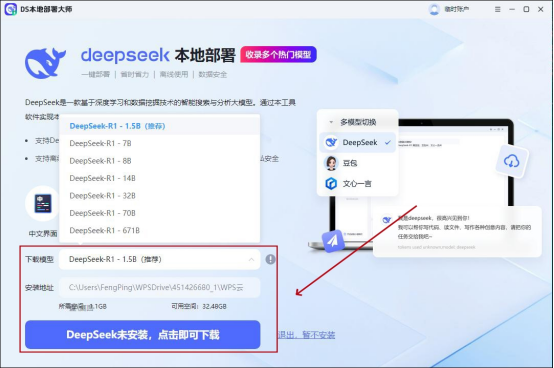

DS 本地部署大师支持多种DeepSeek模型,大家可以在一款软件中选择适合电脑的DeepSeek模型,软件安装模型方法简单,无需繁琐的操作步骤。它支持DeepSeek、豆包、文心一言等多种模型在本地部署,且主流AI模型可随心切换,能满足不同任务需求。

操作步骤:

①先去官网下载DS本地部署大师,下载速度快,一般几分钟就好。随后,按步骤安装软件。

②打开软件后,在左侧模型列表里找到“DeepSeek模型”,选择合适的DeepSeek模型,如DeepSeek-R1-1.5B,点击下方【点击即可下载】选项。

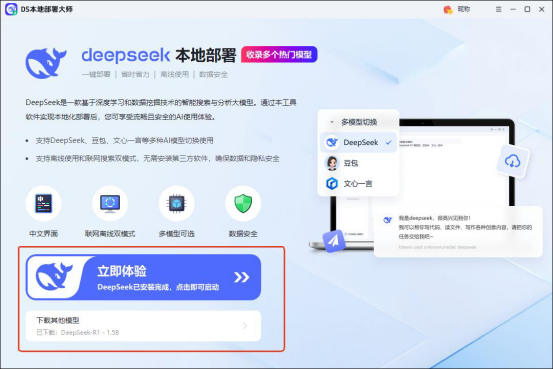

③随后,软件会自动下载DeepSeek模型文件,还会帮你安装需要的各种依赖,不用自己手动安装,耐心等待一会后,可在软件中点击【立即体验】。

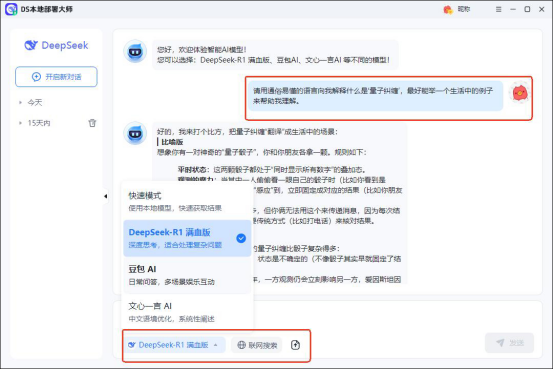

④然后,进入对话界面,跟网页版DeepSeek用法差不多,输入问题就能得到回复,关键是再也不会服务器繁忙了,想聊多久聊多久!软件支持复制文档,还可以替换智能模型,如文心一言、豆包等。

二、Ollama

Ollama是一款轻量级的本地部署工具,体积小但功能强大,安装包只有几兆大小,占用电脑空间少。支持很多主流大模型,对电脑配置要求不高,老电脑也能运行,运行时内存占用低,不会让电脑变卡。

操作步骤:

①去官网下载安装包,官网界面简洁,下载按钮很明显。

②装完打开命令行,输入“ollama run deepseek”自动下载,等几分钟显示“ready”就可以用了。

③输入问题后直接回车就能得到回复,输入“/exit”退出,简单粗暴,没有复杂的操作流程。

三、LM Studio

LM Studio界面做的很精致,像个专业的聊天软件,界面设计美观,色彩搭配舒适,看着很舒服。能手动调节模型参数,比如温度值、最大tokens这些,温度值越高,回复越有创意;温度值越低,回复越严谨,适合想自己微调的用户。

操作步骤:

①安装后打开软件,点击“Discover-DeepSeek-Download”可以选择不同的模型版本。

②下完在“My Models-Load”选个模型版本,加载完成点击“Chat” 就能开始聊。

③聊天界面能设置字体大小、主题颜色,还能保存对话记录,方便后续查看。

四、GPT4All

GPT4All专门为本地运行大模型设计的,有丰富的模型库,里面除了DeepSeek,还有很多其他优质模型可供选择。内置了优化算法,运行速度比同类工具快不少,支持离线使用,没有网络也能正常运行。

操作步骤:

①下载安装后打开,点击“Model-Download Model”在列表里找“DeepSeek”相关模型。

②下完点击“Load-Chat”界面就能用,界面上有“导出对话”按钮。

③能把对话记录导出成文本文件,方便整理和分享。

五、ModelFusion

ModelFusion能同时管理多个模型,在一个软件里就能加载和切换不同的模型,不用来回打开多个软件。支持模型对比功能,输入一个问题让不同模型同时回答,方便选择结果,适合做内容创作的人,能快速找到最满意的回复。

操作步骤:

①下载安装后打开,在“Models”里添加DeepSeek模型,点击“添加模型”选择模型文件路径。

②点击“Compare”进入对比界面,输入问题,勾选要对比的模型,点击“Run”。

③所有模型的回复会并排显示,还能给回复打分,方便筛选,一目了然。

好啦,要是以后再碰到DeepSeek服务器繁忙,别慌,按这一套操作下来,大概率就能顺利解决问题,继续愉快地使用它啦!快把这些小妙招记下来,下次DeepSeek再闹脾气,你就有应对大招啦,快动手试试吧!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)