一文读懂这8个关键概念,AI大模型入门到精通,零基础小白收藏这一篇就够了!!

AGI全称是Artificial general intelligence,中文含义是通用人工智能,是指人工智能达到的一种智能形态:像人类一样去思考问题、解决问题,表现出智能的行为,并且不局限于特定领域。 简单来说,AGI具备比较广泛的认知能力,像人类一样能够适应环境并且自主学习,做人类能够执行的任务。所以AGI具备以下特点:

前言

随着AI的热潮逐渐升温,越来越多的人开始关注和了解AI,但是很多专业的概念和名词却让大家望而却步。今天给大家介绍AI相关最热门的8个关键概念。

01. AGI(通用人工智能)

AGI全称是Artificial general intelligence,中文含义是通用人工智能,是指人工智能达到的一种智能形态:像人类一样去思考问题、解决问题,表现出智能的行为,并且不局限于特定领域。 简单来说,AGI具备比较广泛的认知能力,像人类一样能够适应环境并且自主学习,做人类能够执行的任务。所以AGI具备以下特点:

- 通用性: 要能够“触类旁通”。 AGI不仅仅局限于某个特定的领域,而是像人类一样,既可以进行复杂的数学计算,又可以吟诗作对,甚至创作音乐

- 自主性: 要能够独立思考,自主决策。 AGI能够理解任务目标,并且根据环境主动拆解任务,并完成执行

- 适应性和学习能力: 这是AGI实现“通用性”和“自主性”的基础,AGI具备强大的学习能力,能从经验中学习,不断更新和改进自己的知识库

- 理解与推理能力: 要能够真正理解信息,包括文字、音频、视频等多模态信息。不仅要了解表面含义,更要根据语境、人物关系看出隐含信息(例如讽刺),分析出问题本质,给出解决方案

我的理解是,AGI有点类似于具备人类意识的机器人。

02. AIGC(人工智能生成的内容)

AIGC全称是Artificial Intelligence Generated Content,意思是“由人工智能生成的内容”。人工智能通过各类算法模型,生成包括文本、图片、视频、代码、对话等各种形式的内容。

对应AIGC的概念,应用于该领域的 AI 也被称为Generative AI(生成式 AI),简称 Gen-AI。例如ChatGPT可以写文章,Sora可以生成视频,这些都是AIGC的范畴,目前市场上大家熟悉的如“豆包”、“Kimi”等都是AIGC的垂直类应用。

例如,豆包写出来的内容就叫AIGC,豆包就是AIGC的垂直类应用

03. LM(大模型)

LM全称Large Models,即大模型。这是指参数量巨大(通常10亿+)的深度学习模型,泛指所有类型的大型机器学习模型。大模型可以覆盖多模态的任务,包括文本、图像、音频和视频等,而不仅仅局限于处理自然语言(NLP,Natural language processing),代表的模型是Google的Gemini 2.5。

04. LLM(大语言模型)

LLM全称是Large Language Models,即大语言模型,是专门用于处理自然语言(NLP)任务的大型机器学习模型,一般用来理解和生成人类语言。代表的模型是ChatGPT4,主要聚焦的应用领域包括聊天机器人、文本生成、问答系统、文本摘要、翻译等。

05. Prompt(提示词)-- 高效对话大模型

Prompt的学名叫做提示词,是用来使用LLM的利器。LLM的基础使用很简单,就是用户输入自己的问题(prompt),LLM经过一系列运行,给出结果(学名叫做Output,也就是输出)。

LLM的基础使用范式

这一小节,其实讲的就是如何与LLM进行有效的对话,这是Prompt的精髓。只有确保模型完全理解我们的诉求,它才能给我们预期的结果。通过优化这种对话的方式,可以有效地提升模型输出的结果,让大模型更加“懂我们所想”。

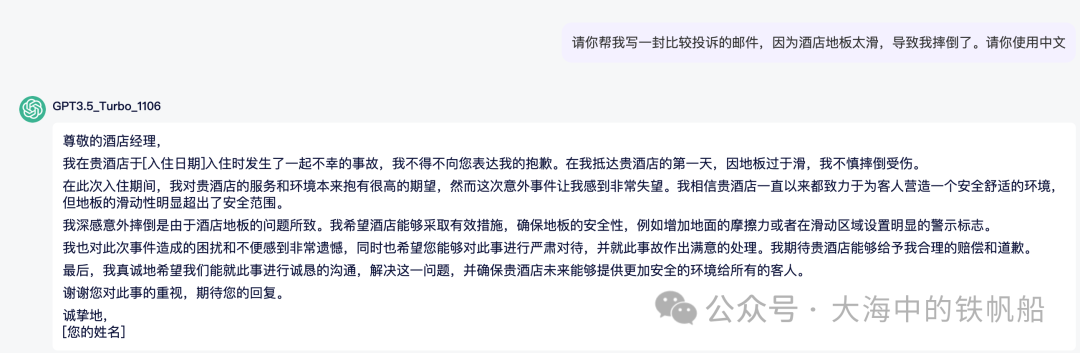

下面我们举一个例子,来看看如何与LLM高效对话: 假设你在住酒店期间因为洗手间太滑而摔倒,想要写一封邮件给酒店经理表达愤怒,并寻求补偿,于是你尝试使用大模型来帮你写邮件(以下模型使用的是2021年的GPT3.5_Trubo,2021年训练生成):

**1. 第一轮:**我向模型诉说了自己的要求,模型正确生成了,可惜的是英文版本,而我住的酒店是中国的酒店;

**2. 第二轮:**于是,我增加了我的诉求:“请你使用中文”。ChatGPT果然给了我中文版本,但是这个版本我觉得太啰嗦,而且态度不够强硬

**3. 第三轮:**我改了一下,增加了要求“表达我很愤怒”,并且“字数在100字以内”

嗯,第三轮言简意赅,基本满足了我的诉求,于是我就使用了这个模板。其实这种通过不断优化Prompt,来提升大模型响应质量的方式,官方名称叫做Prompt Engineering(提示词工程),这是一门挺大的学问,有很多的实践方案(改天专门写一篇来分享)。 但是一般来说,一个良好的Prompt应该有以下的特点:

**1. 身份任务设定说明:**这是为了限定模型的职责,让它知道自己身份是什么,回答问题要符合自己的身份要求;不要僭越,也不要妄自菲薄

2. 具体的要求,越清晰越好: 例如以上例子中 “用中文”、“表达我很愤怒”

**3. 示例few-shots:**给出一些输出的例子,实际上就是给大模型打个样,让它快速理解你给它的任务和输出应该是什么样

**4. 输出规范和说明:**例如以上例子中“100个字以内”

当然在实际优化的时候,也不要照本宣科,对于简单的问题,只要模型回答的不错,不需要过分追求准确度。学好Prompt优化很重要,学好了Prompt优化,基本上使用市场上的AI 工具就不成问题了,据统计,目前从事AI工作的工作者,有较大比例在从事Prompt Engineering相关的工作。

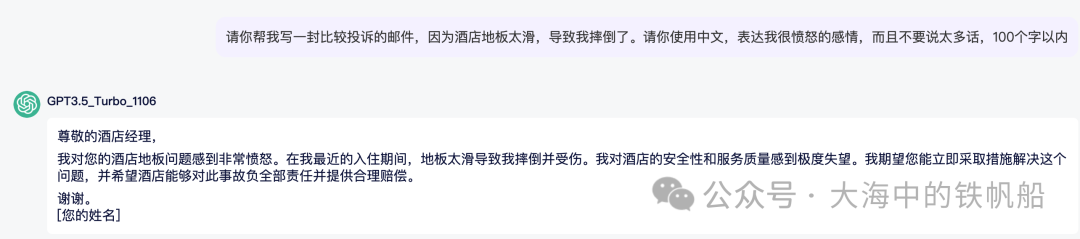

06. RAG(检索增强生成)-- 大模型的知识索引

RAG出现的背景

如果我已经把提示词优化的足够好了,模型也完全能够理解我的诉求了,那是不是就能解决所有问题了?

不,还没有那么简单,有些时候大模型显得很“白痴”,回答不了我们认为很简单的一些事情。我们要先理解大模型的工作原理:大模型需要一定的训练数据进行训练,在训练完成后,参数就已经固定,所以大模型本质是一个离线方案(例如刚才在讲到Prompt优化时使用的模型就是较旧版本的GPT-3.5 Turbo,训练数据截至2021年9月。)这意味着 ① 大模型学习的知识是有限的,一些很专业领域的知识它不一定能学习到 ② 大模型对持续发生的事情感知是不强的(尤其是训练完成后发生的事情)

所以我们要帮助大模型去解决它的这两个限制,于是就有了RAG和Function Calling:RAG 是为了解决大模型知识有限的问题,Function Calling是为了解决大模型对新知识的学习问题。

RAG的使用介绍

RAG的英文全称叫做 Retrieval-Augmented Generation,翻译成中文叫做“检索增强生成”,源自于一篇论文

《Retrieval-Augmented Generation for Large Language Models:A Survey》

可以简单的理解,把RAG当做是一个外挂,当大模型对一些知识不太懂的时候,它就会回答错误,所以我们需要提供一些方法帮助模型接触到那部分知识,RAG就是通过提供信息检索来补充离线模型缺失的那部分知识。

LLM的RAG使用范式

07. Function Calling(工具调用)-- 大模型的场外求助

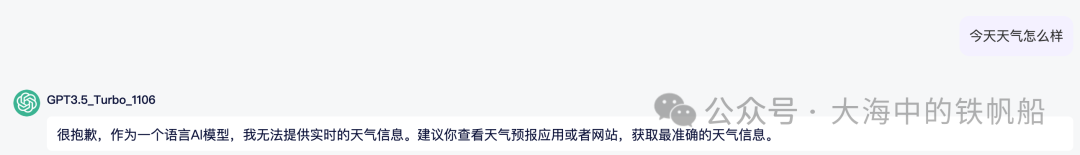

Function calling,翻译成中文叫做“工具调用”,当大模型因为不了解最新知识而无法正确处理时,我们可以给大模型增加一个“外挂”,通过调用工具的方式寻求解决,有点类似于智能问答里面的“场外求助”。

当我问大模型:“今天星期几?” 大模型给我的回答当然是错误的,这显得它很愚蠢。

当我问大模型:“今天天气怎么样?” 大模型给我的回答是不知道,这显得它很不专业。

那么该如何解决这样的问题呢?

刚才有介绍,大模型是离线模型,它并不知道今天的具体日期,自然也无法了解天气的情况,因此需要让它寻求“场外帮助”,先通过**“日历工具”确定今天是星期几,然后再查询“天气预报工具”**确认今天的天气情况,于是变成了下面这样:

LLM的Function Calling使用范式

Function Calling就是指在遇到特定问题时,会选择正确的工具来帮助它来解决问题,这其实已经把大模型从语言模型向更先进的“智能体”去进化了。

08. AI Agent(智能体)-- 大模型的智能表达

前面章节介绍了如何使用Prompt高效与模型对话,如何通过RAG的方式给模型加知识索引,以及教会大模型学会使用工具。这个时候大模型还停留在可以对话的阶段,一问一答,是被动的执行任务;那么如何能够让大模型更“智能”一点,甚至能够主动地执行一些任务呢? – 于是,智能体就出现了。

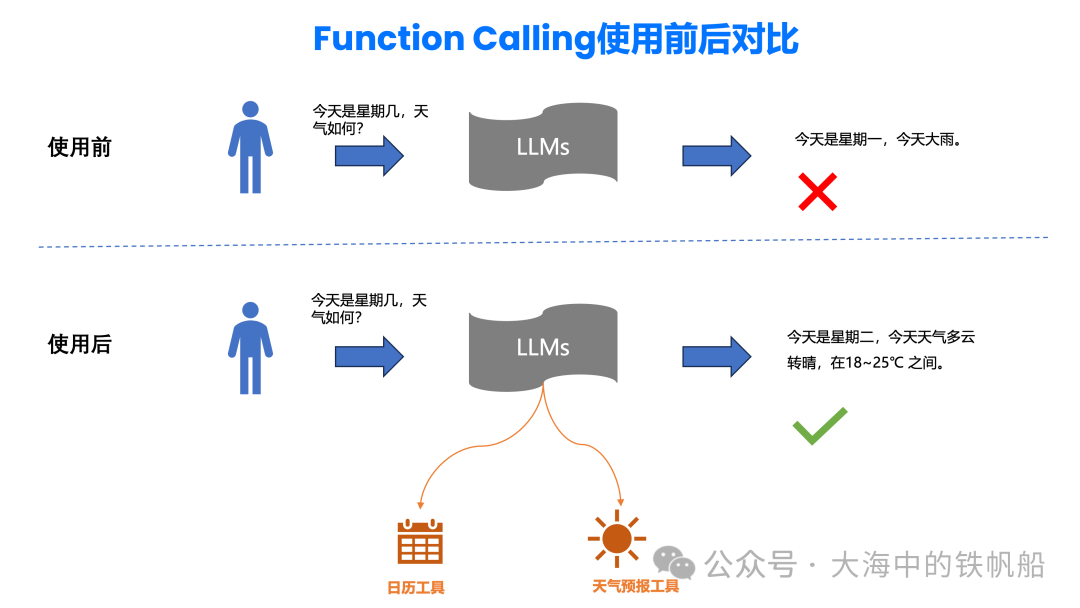

从定义上来说,智能体是能够感知环境、制定计划、执行任务和自主学习的系统。大模型最开始使用的场景是问答,这是一种被动的任务执行(比如ChatGPT/豆包等),但是智能体的提出,是要从被动的问答转向主动的任务执行。AI Agent其实并非是一项技术,而是通过整合LLM的能力,针对特定场景的再次封装,去执行特定的任务。

AI Agent架构,包括Memory(记忆模块)、Planning(规划模块)、Tools(工具模块)和Action(执行模块)。

OpenAI应用人工智能研究负责人Lilian Weng设计的通用的**AI Agent架构

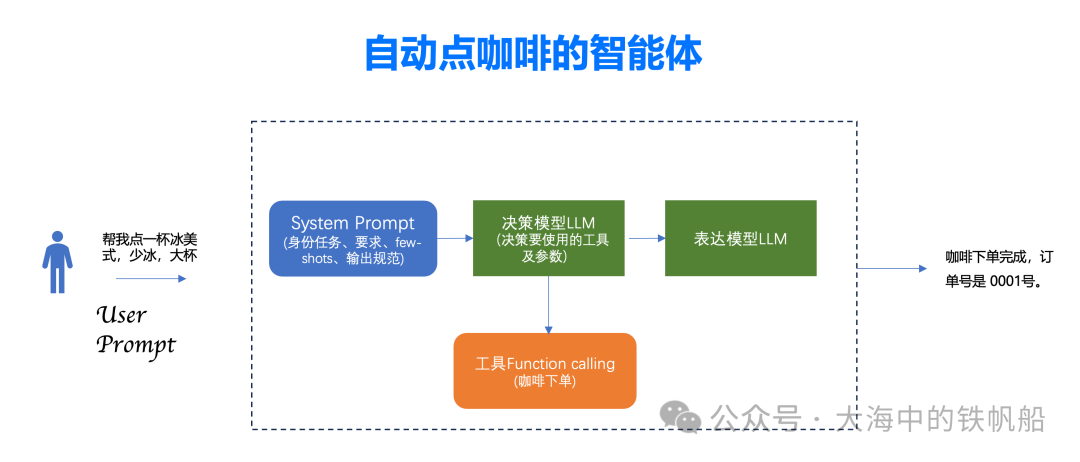

举个例子,加入我们想做一个自动点咖啡的智能体,那么我们应该这么设计:

- Prompt设计:设置提示词,识别用户的输入,帮助决策模型去正确识别用户的诉求。 可以通过设定角色任务、要求、例子(few-shots)、输出规范等方式来做

- 决策模型(市场上的OpenAI、DeepSeek、Qween都可以):结合用户的对话和上下文,决策该使用哪些工具,以及应该选择哪些参数去调用工具

- 工具Function Calling:直接通过API调用的方式,调用对应的咖啡品牌下单;如例子中用户要点星巴克,那么工具就应该选择星巴克的下单服务

- 表达模型:根据最终决策模型的结果,给到用户结果

自动咖啡点单的AI Agent

实际上,真正企业级的AI Agent设计远比这要复杂,考虑到实际的场景的多样性和复杂性,一般由多个模型、甚至多个子Agent一起去解决问题,但是万变不离其宗,原理和思路是一致的。

09. 结束语

AI 不应该是高高在上的尖端技术,而应该是普惠的大众服务;就像90年代的互联网一样,当时了解的人寥寥无几,现在的我们无法想象没有互联网的生活。 AI时代已经到来,让我们开始学习和拥抱AI吧!

最后

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师给大家这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)