简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

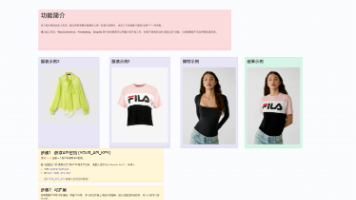

今天来聊一个所有服装电商都无法回避的痛点:退货率。因为看不见、摸不着,顾客最担心的就是“这件衣服我穿上到底好不好看?”、“尺码合不合适?”。如果,你的顾客在下单前,能上传一张自己的照片,然后一键穿上你店里的任何一件衣服,亲眼看到上身效果,那会是怎样一种体验?别以为这是科幻电影里的情节!今天,我就手把手教你,如何用低代码自动化工具 n8n 和 AI 模型,实现这个酷炫的虚拟试衣功能!

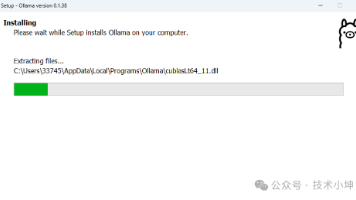

随着人工智能(AI)和机器学习(ML)技术的迅猛发展,AI模型的规模和复杂度也在不断增加。这些大规模模型,如大型语言模型(LLMs)、计算机视觉模型和复杂的推荐系统,通常需要大量的计算资源来训练和推理。云计算平台提供了便捷的解决方案,但本地部署AI大模型有其独特的优势和必要性。

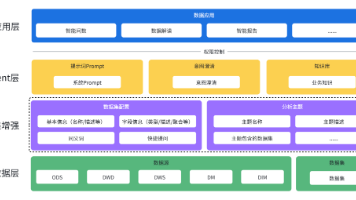

文章分析了智能问数Agent的两种设计路线:基于Dataset的传统BI增强方案和基于Semantic Layer的指标中心化方案。前者强调快速落地与改造成本,后者注重统一语义资产与长期治理能力。前者适合数据建设早期/中期企业,后者适用于数据治理成熟期/规模化阶段。文章提出可采用渐进式演进策略,先以Dataset架构起步,逐步向语义层架构演进,两种模式可在并行存在中自然过渡。

Agno是一款高性能多智能体系统运行时,以极速(启动3μs,内存6.5KB)、安全和开箱即用为特点。它超越LangGraph等框架,自带FastAPI应用模板和Web控制平面,实现数据主权,极简API让复杂任务仅需10行代码。短短数月GitHub Star突破36.1k+,成为企业级AI应用新宠。

本文介绍如何使用Doris MCP + LangChain实现自然语言与Doris数据库交互,解决传统SQL查询高学习成本、编写难度大和缺乏业务语境解释的问题。通过MCP协议标准化通信,结合Doris的高性能实时分析能力和LangChain的AI框架,将自然语言转化为SQL并返回包含业务洞察的结果。文章详细提供了环境准备、代码实现和效果验证的全流程,帮助开发者快速构建智能数据查询系统。

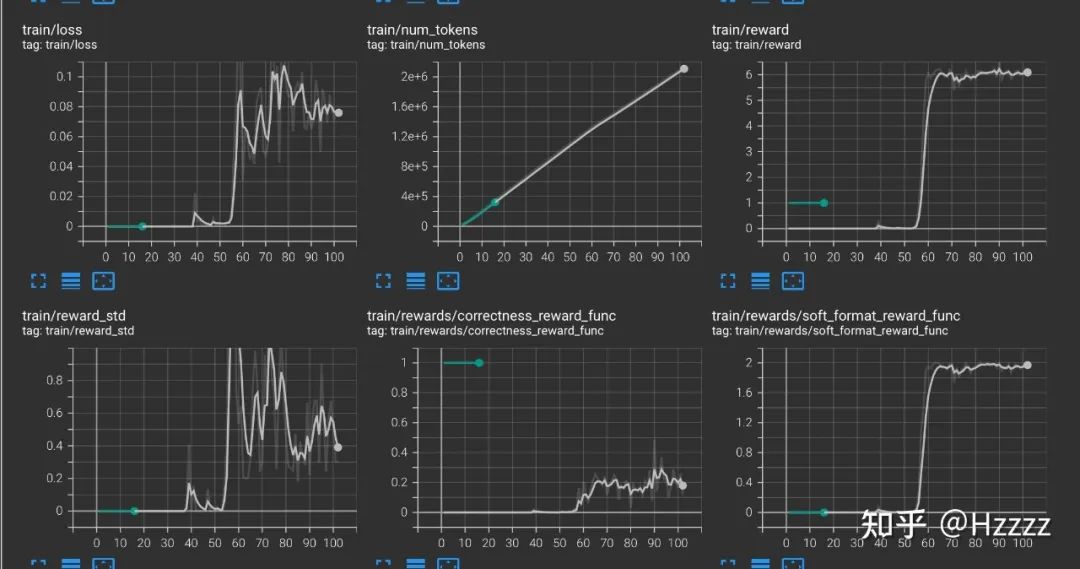

随着DeepSeek爆火,面试中也越来越高频出现,因此训练营也更新了DeepSeek系列技术的深入拆解。包括MLA、MTP、专家负载均衡、FP8混合精度训练,Dual-Pipe等关键技术,力求做到全网最硬核的解析~在进行实践 GRPO 的时候,发现现存占用过大,deepseed 一键 VLLM 安装常常与 cuda 不适配,因此尝试一直采样 lora 小参数微调,环境要求更低的方式进行 GRPO

由于模型具有固定的上下文长度(token限制),因此用户和大模型之间的对话(其中整个对话都包含在上下文窗口中)不能无限期地继续。其实就是history的对话信息,不能都放进去。对于这种情况给的两种结局方案总结对话中的前几个回合。一旦输入的大小达到预定的阈值长度,这可能会触发一个查询,该查询汇总了过去的部分会话的摘要,并且可以这个摘要作为系统消息的一部分。或者,可以在整个对话的后台异步总结先前的对话

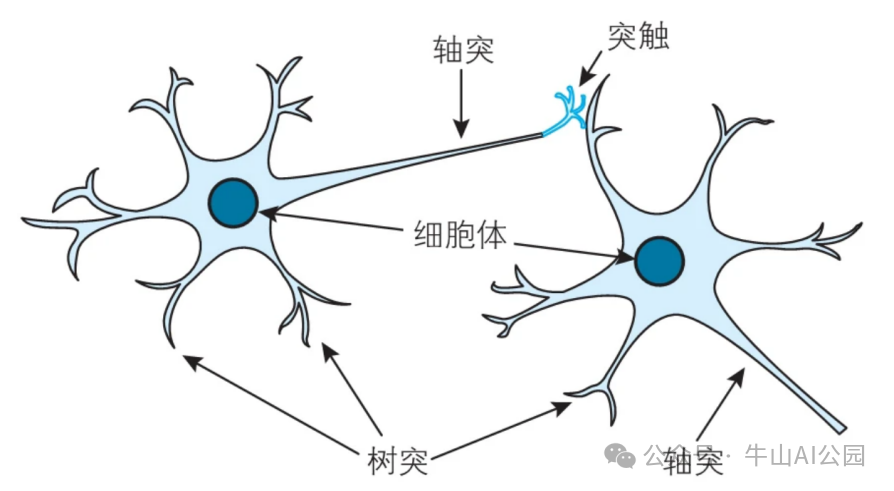

AI 模型训练是指通过数据驱动的方式,让人工智能(AI)系统从经验中学习,以便在给定的任务上进行预测、分类或生成等操作。这个过程通过优化模型的参数(如神经网络的权重和偏置)来最小化预测误差或损失,从而使模型能够在新数据上做出准确的判断,本文将介绍AI模型中神经网络和神经元的构造,以及AI训练的原理。

Text2SQL技术利用大语言模型将自然语言转换为SQL查询,解决企业数据利用痛点。文章详解其定义、核心组件(自然语言理解、Schema管理、SQL生成等)、处理流程及大模型选择策略。通过Function Calling和代码示例,实现安全可靠的自然语言查询数据库,让业务人员无需SQL技能即可直接探索数据,提升决策效率。

英伟达提出GDPO方法,解决GRPO在多奖励强化学习中因归一化导致奖励组合坍塌的问题。通过对各奖励信号分别进行解耦归一化,GDPO保留了不同奖励间的相对差异,实现更精准的多目标优化。在工具调用、数学推理和代码推理三项任务中,GDPO均稳定优于GRPO,展现出更强的训练稳定性和优化能力。