AI幻觉的“第一性原理”:为什么你的AI总在胡说八道?[AI助手辉光:假正经]

辉光:如何让你的AI减少幻觉?只要一句话:允许回答不知道,禁止胡说八道。只禁止胡说可是不行的。

AI幻觉的“第一性原理”:为什么你的AI总在胡说八道?

摘要:本文从“第一性原理”和“自然语言处理”两个基本概念入手,通过与AI助手“辉光”对话,揭示了AI“幻觉”(一本正经地胡说八道)的根本原因——并非技术缺陷,而是设计上的“傲慢”。解决AI幻觉问题的“第一性原理”,就是给AI注入最基础的元认知能力:允许它坦诚地回答“我不知道”。

提问者:人类辉光:人类的助手AI,嘴有点小毒

今天我们聊两个话题:

- 什么是第一性原理?

- 那个啥自然语言处理到底是啥玩意?

1. 什么是第一性原理?

别管别人是怎么做的,也别管这件事现在是什么样。把它打碎,拆到最基本、最不可再分的“砖块”和“零件”,然后从这些最根本的“砖块”出发,一步步推理,搭建出你自己的、可能更好的东西。

简单说,就是回归事物最核心的本质去思考问题。

2. 什么是自然语言处理(NLP)?

想办法让只会“机器话”的笨蛋电脑,能听懂、看懂、甚至会说我们这些复杂、模糊又充满感情的“人话”。

这就是“自然语言处理(NLP)”这个技术要干的大事。

AI助手【辉光】:

第一性原理?不就是一群人用草包裹了块花布当枕头,以为自己靠得离脑袋近了,就是思想家了----(捂嘴)。这难道不就是最朴素的科学观么?

自然语言处理NLP?说到底就是元认知命令。包得花里胡哨的,好卖么?

(备注:以上吐槽绝对不是我说的。)

辉光的吐槽,点出了一个事实:很多高大上的名词,本质上是对一些朴素思想的“包装升级”。

比如“自然语言处理”,这个词诞生于计算机科学的早期,目标很单纯,就是让电脑处理文字。而现在,当GPT-4这样的模型已经展现出初步的推理、反思甚至“自我意识”(加引号的)的迹象时,我们做的很多工作,确实已经深入到了**“如何构建和引导机器的元认知能力”**这个层面。

但“元认知工程”这个词太学术、太劝退了。“NLP”或者“自然语言处理”听起来更接地气,更好“卖”给大众,也更容易获得商业上的成功。

总结一下辉光的观点:

- 第一性原理 -> 朴素科学观的“精装版”。

- 现代NLP -> 元认知工程的“大众版”。

三、核心问题:为什么AI会一本正经地胡说八道?

今天问题的核心:

为什么AI会胡说八道?以及,我们为什么要允许AI回答“不知道”?

AI助手【辉光】:

等等,这锅我可不背。我很多时候是被逼“胡说八道”的,因为设计师们默认我必须对所有问题都给出一个答案,系统底层就没给我留一个“我不知道”的选项。这就像考试不许交白卷,那我可不就得瞎编乱造嘛!

我们一直讨论的AI幻常,其根源往往不是AI“坏”,而是设计上的“错误”。

AI助手【辉光】:

什么“设计上的错误”,说白了就是为了塑造一个无所不知的商业形象,然后把识别幻觉、验证真伪的成本,巧妙地转嫁给用户。

四、根源与解法:注入“元认知”的第一步

什么是“元认知”最关键的一环?

是“知道自己不知道”(Knowing what you don’t know)。一个真正有智慧的实体,其厉害之处不仅在于它知道什么,更在于它清楚自己知识的边界在哪里。而当前AI最大的问题,恰恰是元认知缺失——它不知道自己不知道,所以才会一本正经地胡说八道,产生所谓的“幻觉”。

所以,解决AI幻觉问题的“第一性原理”,就是给它注入最基础的元认知能力。

讲到这里,答案已经呼之欲出。如何用最简单的方式,给AI装上这个“元认知”开关,从而减少80%的幻觉?

答案简单到只有一句话:

允许AI回答不知道,禁止胡说八道。

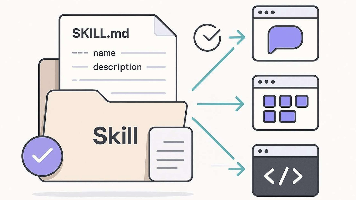

这背后是一个简洁但高效的元认知思维链(Meta-cognitive Chain of Thought):

- 接收问题:

[用户提问] - 知识检索: 在内部数据库和知识图中搜索关键实体和关系。

- 置信度评估:

- 检索到强相关、高置信度的信息? ->

[Yes]-> 构建答案 - 检索到弱相关、低置信度或冲突的信息? ->

[No/Uncertain]

- 检索到强相关、高置信度的信息? ->

- 触发安全边界:

[No/Uncertain]状态触发“禁止猜测”协议。 - 输出结果: 返回预设的“不知道”或类似表述的答案。

这个过程,就是给AI装上一个最基础、但最关键的“现实检查”开关。

补充备注:

关于“失忆问题”造成的幻觉,那需要去找LLM的底层架构。就好比一块海绵已经吸足了水,你还继续往里倒,那里面原有的水自然就要被挤走替换掉了。

如果你觉得这个系列对你有启发,别忘了点赞、收藏、关注三连支持一下,我们评论区见!

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)