人工智能教程第一课 深度学习和计算机视觉TensorFlow入门

深度学习学习目标知道什么是深度学习知道深度学习的应用场景1.什么是深度学习在介绍深度学习之前,我们先看下人工智能,机器学习和深度学习之间的关系:机器学习是实现人工智能的一种途径,深度学习是机器学习的一个子集,也就是说深度学习是实现机器学习的一种方法。与机器学习算法的主要区别如下图所示:传统机器学习算术依赖人工设计特征,并进行特征提取,而深度学习方法不需要人工,而是依赖算法自动提取特征。深度学习模仿

深度学习

学习目标

- 知道什么是深度学习

- 知道深度学习的应用场景

1.什么是深度学习

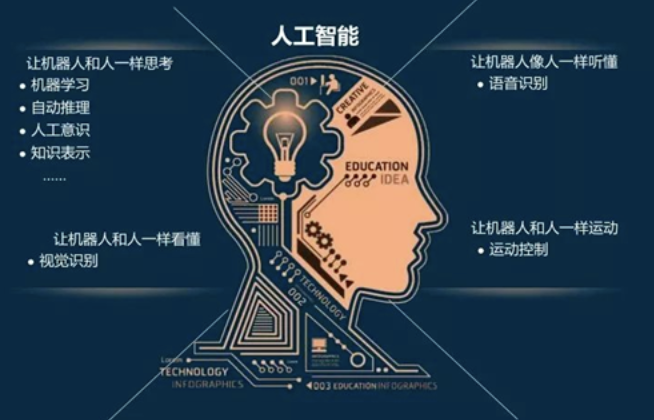

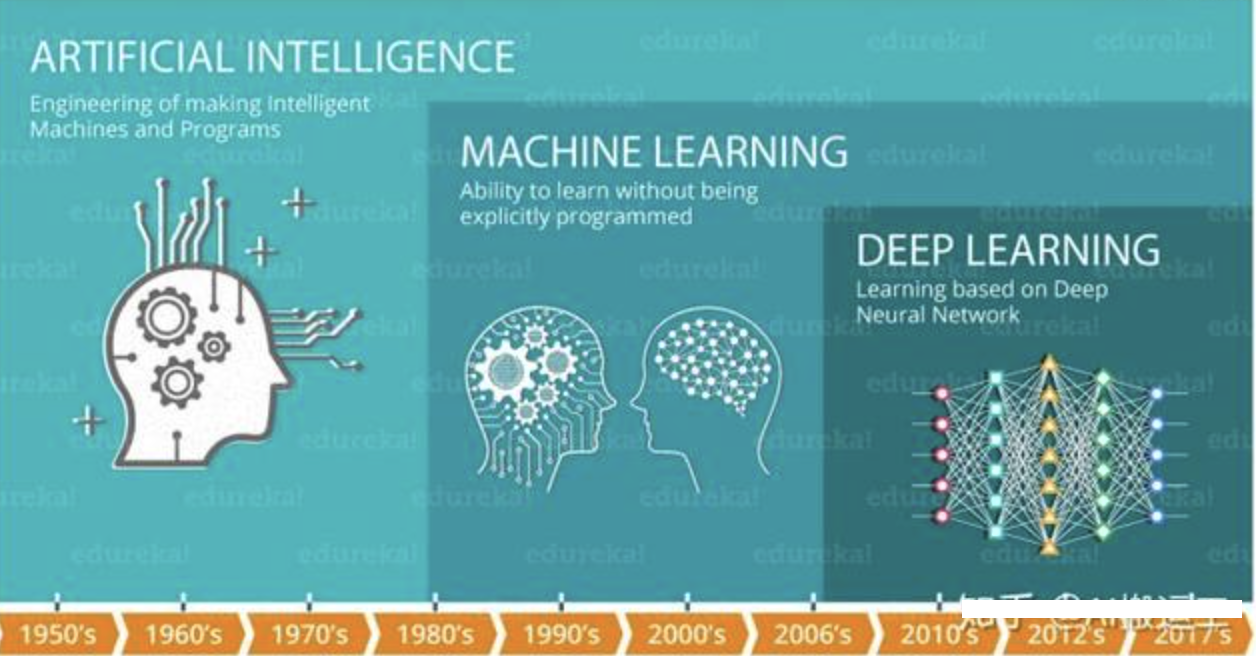

在介绍深度学习之前,我们先看下人工智能,机器学习和深度学习之间的关系:

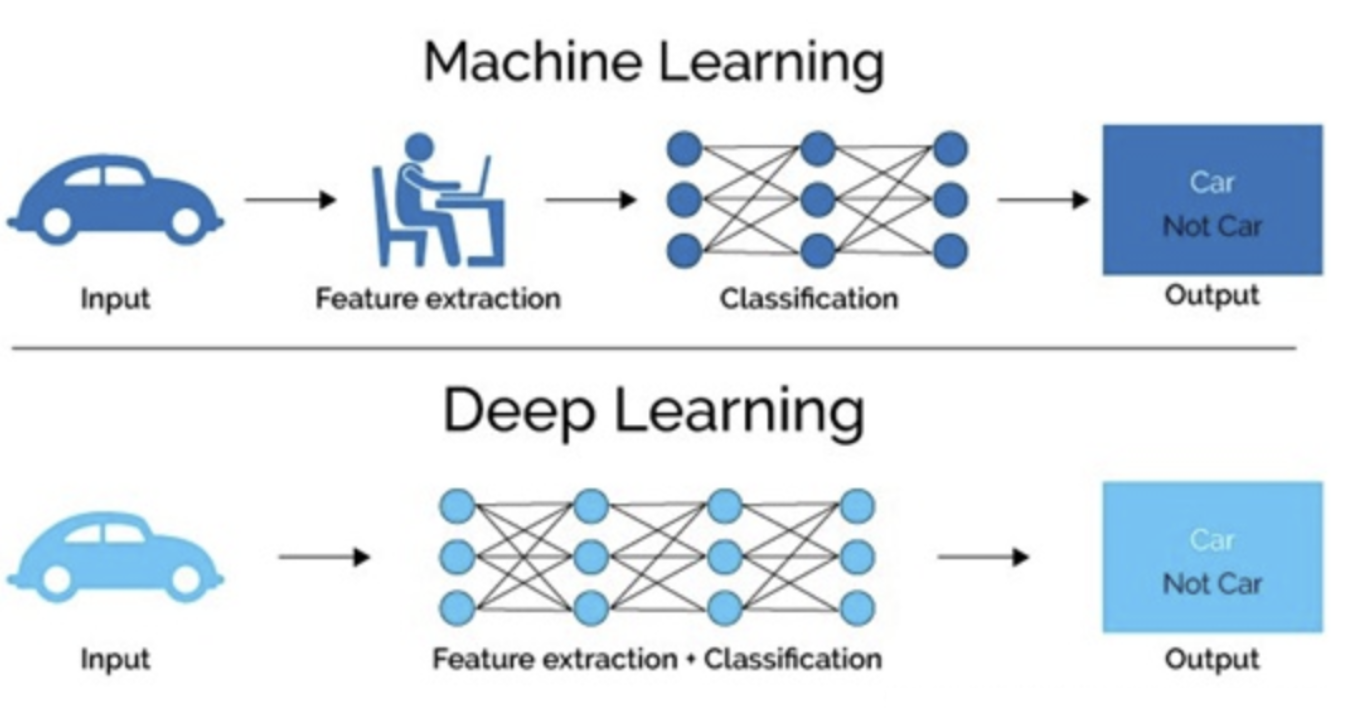

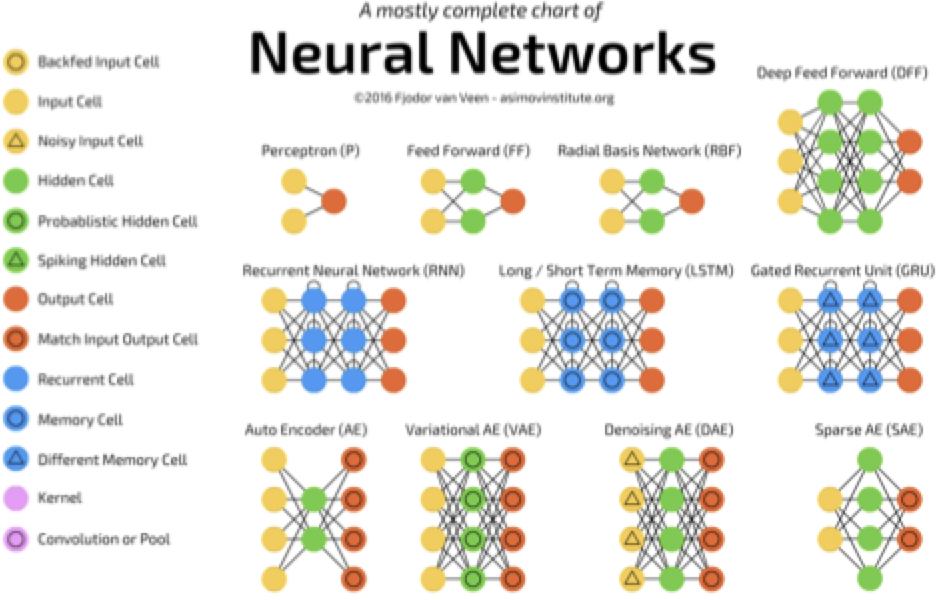

机器学习是实现人工智能的一种途径,深度学习是机器学习的一个子集,也就是说深度学习是实现机器学习的一种方法。与机器学习算法的主要区别如下图所示:

传统机器学习算术依赖人工设计特征,并进行特征提取,而深度学习方法不需要人工,而是依赖算法自动提取特征。深度学习模仿人类大脑的运行方式,从经验中学习获取知识。这也是深度学习被看做黑盒子,可解释性差的原因。

随着计算机软硬件的飞速发展,现阶段通过深度学习来模拟人脑来解释数据,包括图像,文本,音频等内容。目前深度学习的主要应用领域有:

- 智能手机

- 语音识别

比如苹果的智能语音助手siri

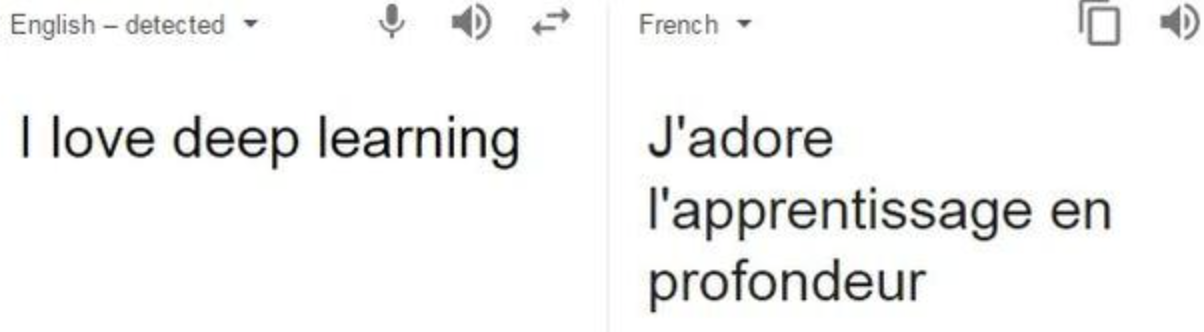

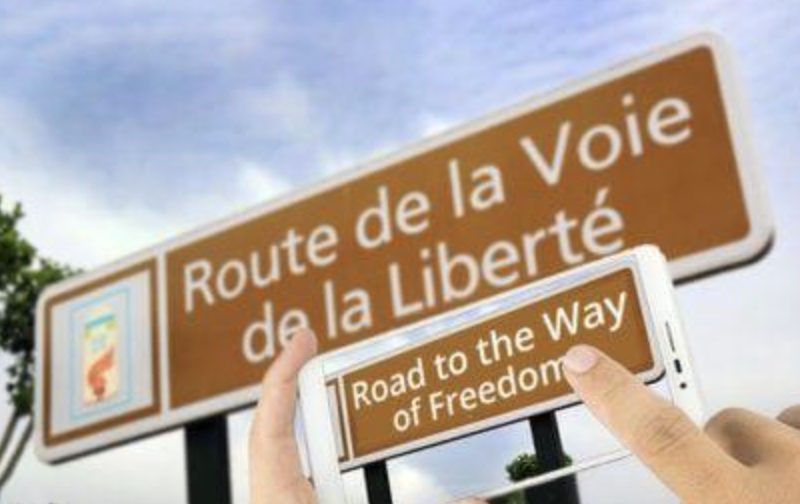

- 机器翻译

谷歌将深度学习方法嵌入到谷歌翻译中,能够支持100多种语言的即时翻译。

- 拍照翻译

- 自动驾驶

当然在其他领域也能见到深度学习的身影,比如风控,安防,智能零售,医疗领域,推荐系统等。

在该课程中,我们主要介绍:

- 深度学习框架TensorFlow的应用

- 深度神经网络

两部分内容。

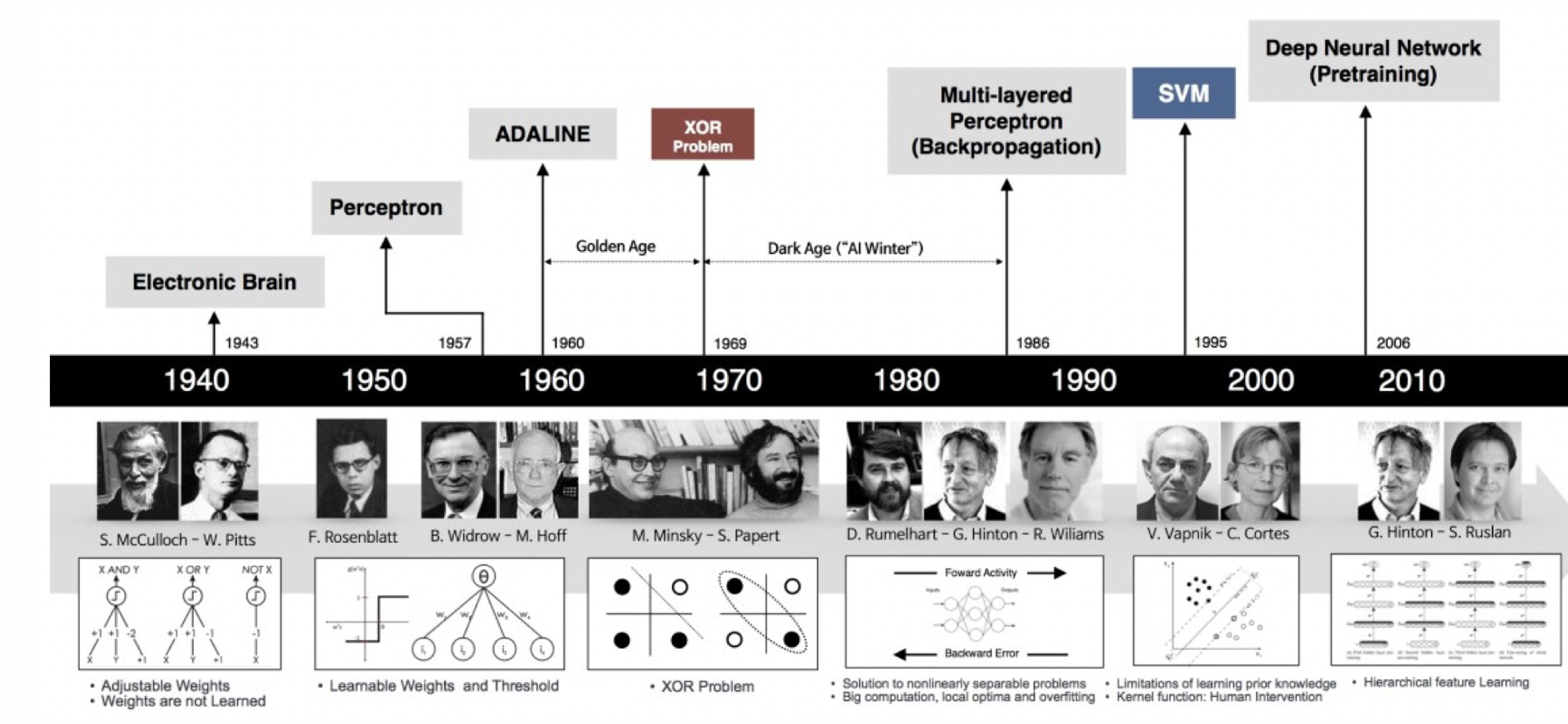

2 发展历史(了解)

- 深度学习其实并不是新的事物,深度学习所需要的神经网络技术起源于20世纪50年代,叫做感知机。当时也通常使用单层感知机,尽管结构简单,但是能够解决复杂的问题。后来感知机被证明存在严重的问题,因为只能学习线性可分函数,连简单的异或(XOR)等线性不可分问题都无能为力,1969年Marvin Minsky写了一本叫做《Perceptrons》的书,他提出了著名的两个观点:1.单层感知机没用,我们需要多层感知机来解决复杂问题 2.没有有效的训练算法。

- 20世纪80年代末期,用于人工神经网络的反向传播算法(也叫Back Propagation算法或者BP算法)的发明,给机器学习带来了希望,掀起了基于统计模型的机器学习热潮。这个热潮一直持续到今天。人们发现,利用BP算法可以让一个人工神经网络模型从大量训练样本中学习统计规律,从而对未知事件做预测。这种基于统计的机器学习方法比起过去基于人工规则的系统,在很多方面显出优越性。这个时候的人工神经网络,虽也被称作多层感知机(Multi-layer Perceptron),但实际是种只含有一层隐层节点的浅层模型。

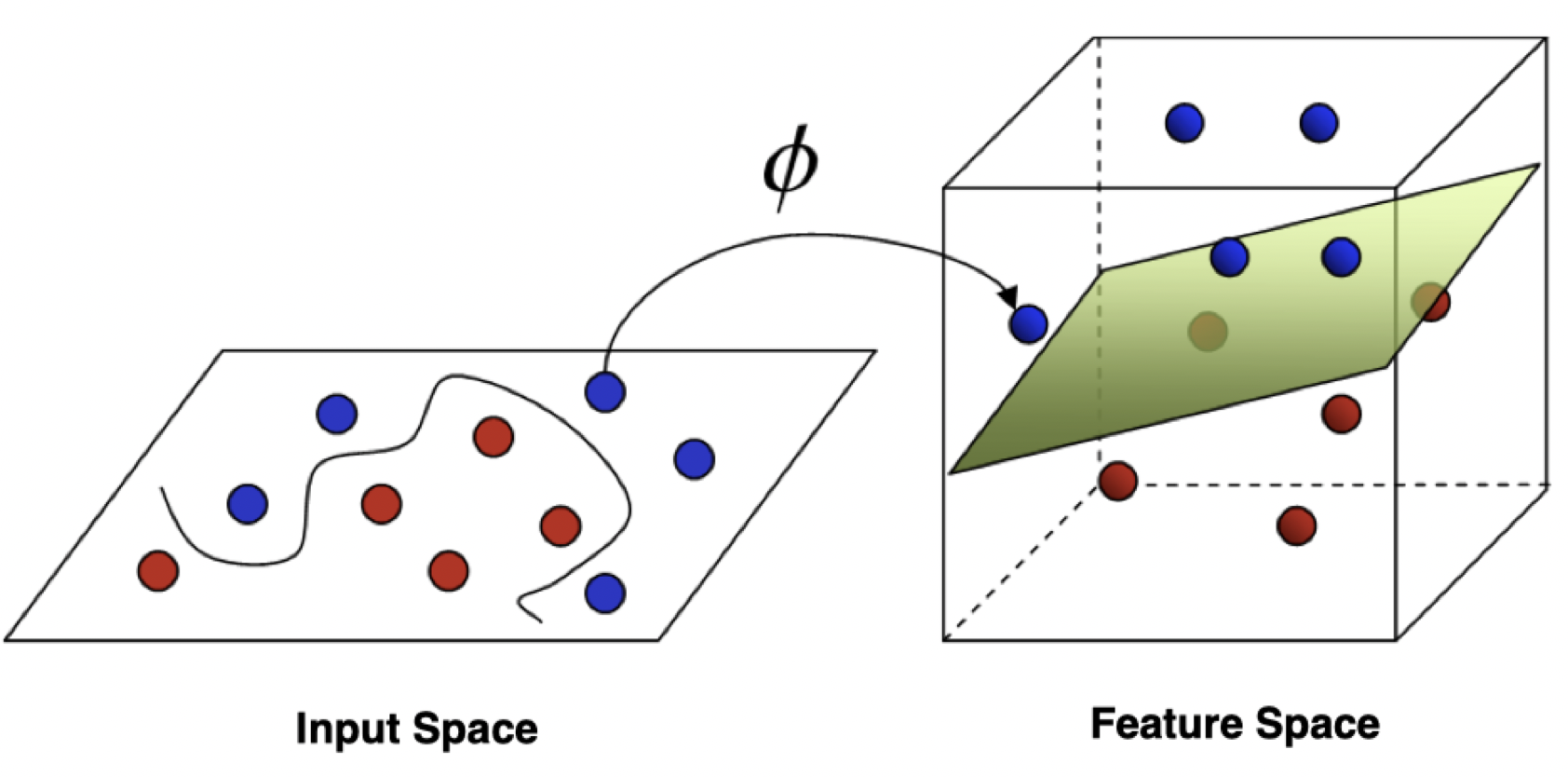

- 20世纪90年代,各种各样的浅层机器学习模型相继被提出,例如支撑向量机(SVM,Support Vector Machines)、 Boosting、最大熵方法(如LR,Logistic Regression)等。这些模型的结构基本上可以看成带有一层隐层节点(如SVM、Boosting),或没有隐层节点(如LR)。这些模型无论是在理论分析还是应用中都获得了巨大的成功。相比之下,由于理论分析的难度大,训练方法又需要很多经验和技巧,这个时期浅层人工神经网络反而相对沉寂.

- 2006年,杰弗里·辛顿以及他的学生鲁斯兰·萨拉赫丁诺夫正式提出了深度学习的概念。他们在世界顶级学术期刊《科学》发表的一篇文章中详细的给出了“梯度消失”问题的解决方案——通过无监督的学习方法逐层训练算法,再使用有监督的反向传播算法进行调优。该深度学习方法的提出,立即在学术圈引起了巨大的反响,以斯坦福大学、多伦多大学为代表的众多世界知名高校纷纷投入巨大的人力、财力进行深度学习领域的相关研究。而后又迅速蔓延到工业界中。

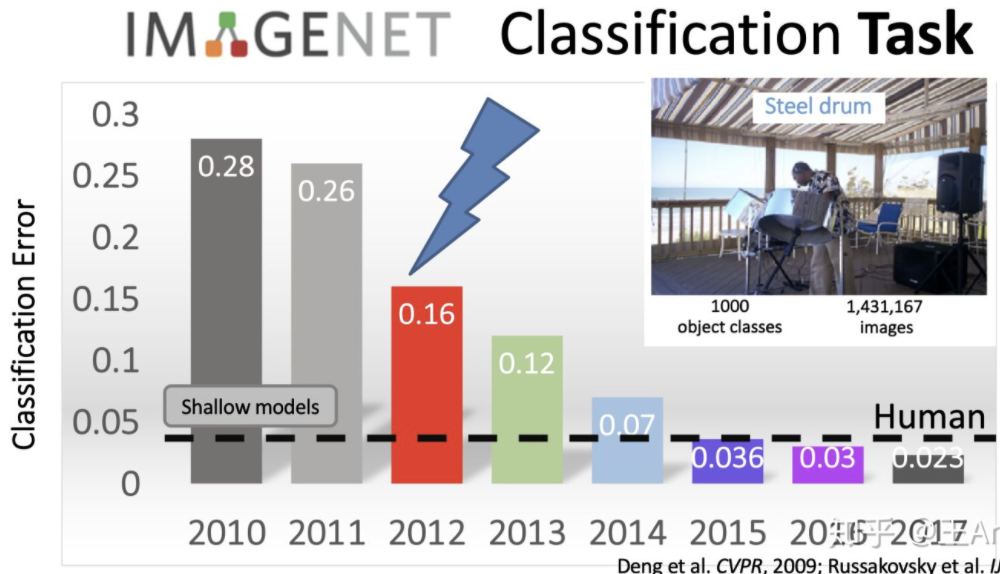

- 2012年,在著名的ImageNet图像识别大赛中,杰弗里·辛顿领导的小组采用深度学习模型AlexNet一举夺冠。AlexNet采用ReLU激活函数,从根本上解决了梯度消失问题,并采用GPU极大的提高了模型的运算速度。同年,由斯坦福大学著名的吴恩达教授和世界顶尖计算机专家Jeff Dean共同主导的深度神经网络——DNN技术在图像识别领域取得了惊人的成绩,在ImageNet评测中成功的把错误率从26%降低到了15%。深度学习算法在世界大赛的脱颖而出,也再一次吸引了学术界和工业界对于深度学习领域的关注。

- 2016年,随着谷歌公司基于深度学习开发的AlphaGo以4:1的比分战胜了国际顶尖围棋高手李世石,深度学习的热度一时无两。后来,AlphaGo又接连和众多世界级围棋高手过招,均取得了完胜。这也证明了在围棋界,基于深度学习技术的机器人已经超越了人类。

- 2017年,基于强化学习算法的AlphaGo升级版AlphaGo Zero横空出世。其采用“从零开始”、“无师自通”的学习模式,以100:0的比分轻而易举打败了之前的AlphaGo。除了围棋,它还精通国际象棋等其它棋类游戏,可以说是真正的棋类“天才”。此外在这一年,深度学习的相关算法在医疗、金融、艺术、无人驾驶等多个领域均取得了显著的成果。所以,也有专家把2017年看作是深度学习甚至是人工智能发展最为突飞猛进的一年。

- 2019年,基于Transformer 的自然语言模型的持续增长和扩散,这是一种语言建模神经网络模型,可以在几乎所有任务上提高NLP的质量。Google甚至将其用作相关性的主要信号之一,这是多年来最重要的更新

- 2020年,深度学习扩展到更多的应用场景,比如积水识别,路面塌陷等,而且疫情期间,在智能外呼系统,人群测温系统,口罩人脸识别等都有深度学习的应用。

总结

- 深度学习是什么

深度学习是机器学习算法的一种,通过模拟人脑实现相应的功能

- 深度学习应用场景

手机,机器翻译,自动驾驶,语音识别,医疗,安防等。

计算机视觉

学习目标

- 知道计算机视觉的定义

- 知道计算机视觉常见任务

- 知道计算机视觉的应用场景

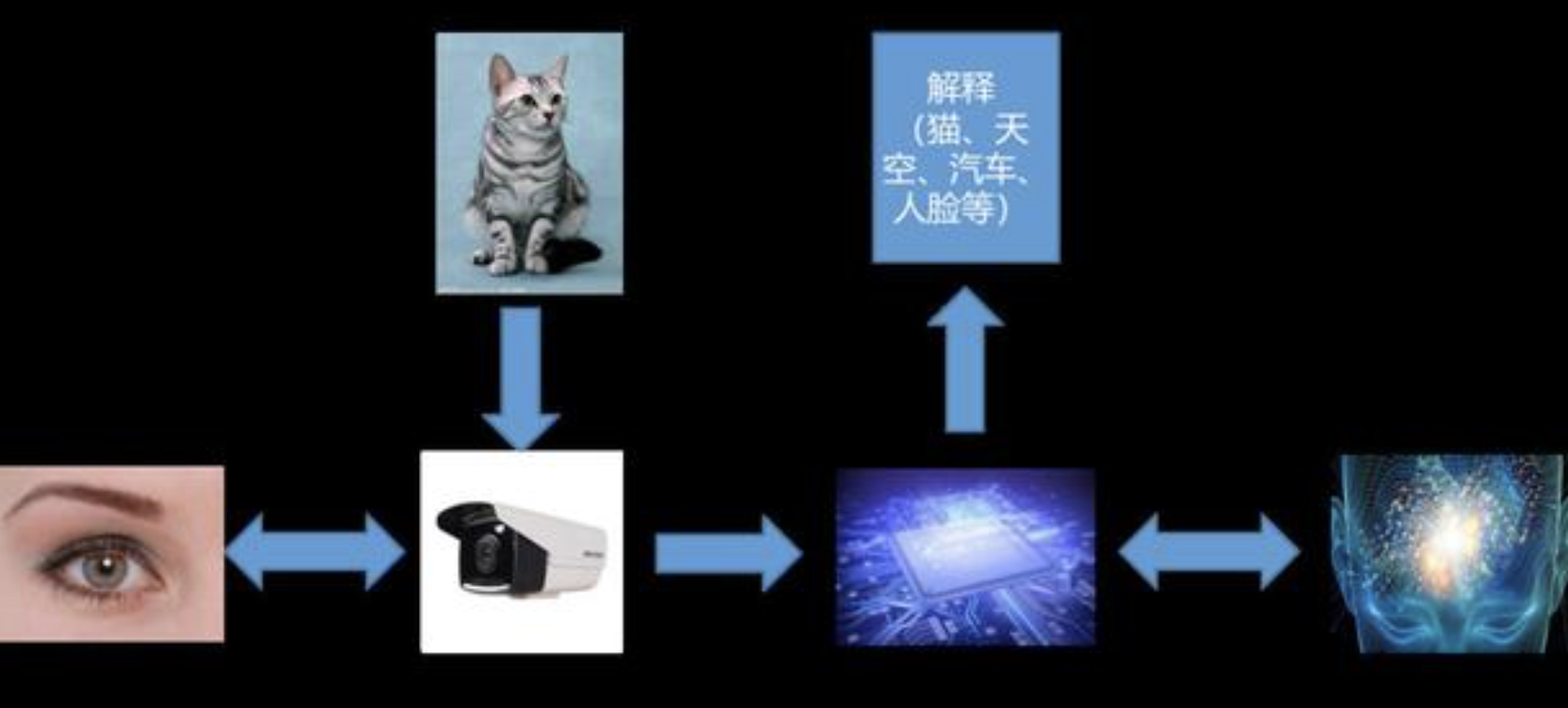

1.计算机视觉定义

计算机视觉是指用摄像机和电脑及其他相关设备,对生物视觉的一种模拟。它的主要任务让计算机理解图片或者视频中的内容,就像人类和许多其他生物每天所做的那样。

我们可以将其任务目标拆分为:

- 让计算机理解图片中的场景(办公室,客厅,咖啡厅等)

- 让计算机识别场景中包含的物体(宠物,交通工具,人等)

- 让计算机定位物体在图像中的位置(物体的大小,边界等)

- 让计算机理解物体之间的关系或行为(是在对话,比赛或吵架等),以及图像表达的意义(喜庆的,悲伤的等)

那我们在OpenCV阶段,主要学习图像处理,而图像处理主要目的是对图像的处理,比如平滑,缩放等,想、从而为其他任务(比如“计算机视觉”)做好前期工作。

2.常见任务

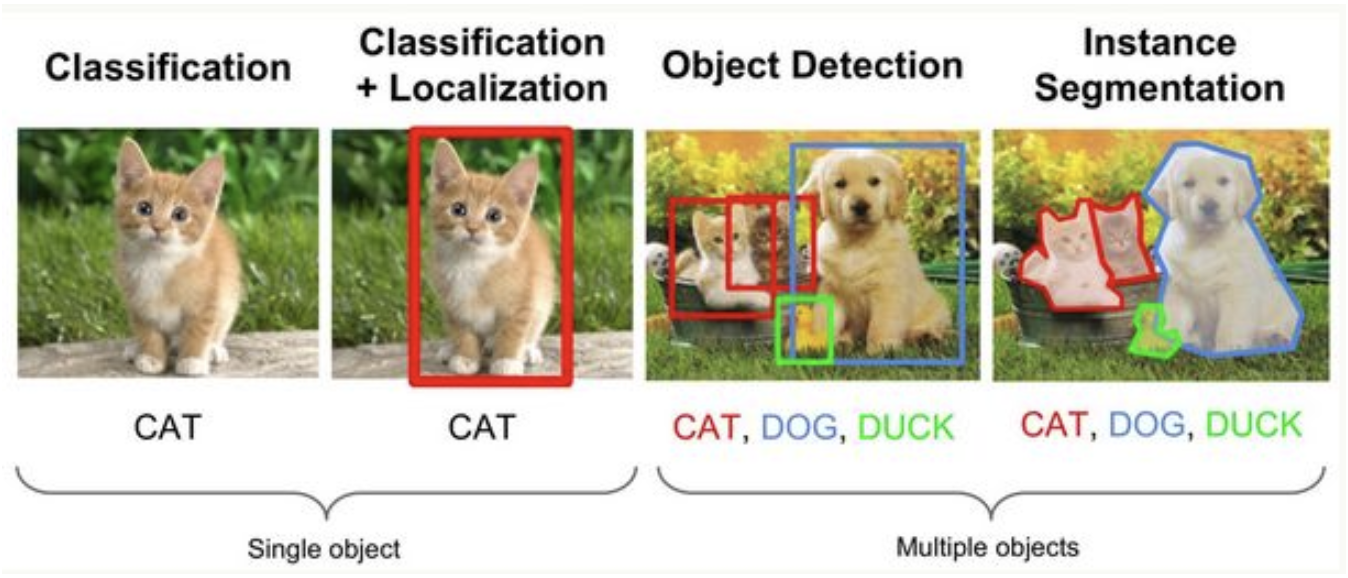

根据上述对计算机视觉目标任务的分解,可将其分为三大经典任务:图像分类、目标检测、图像分割

- 图像分类(Classification):即是将图像结构化为某一类别的信息,用事先确定好的类别(category)来描述图片。

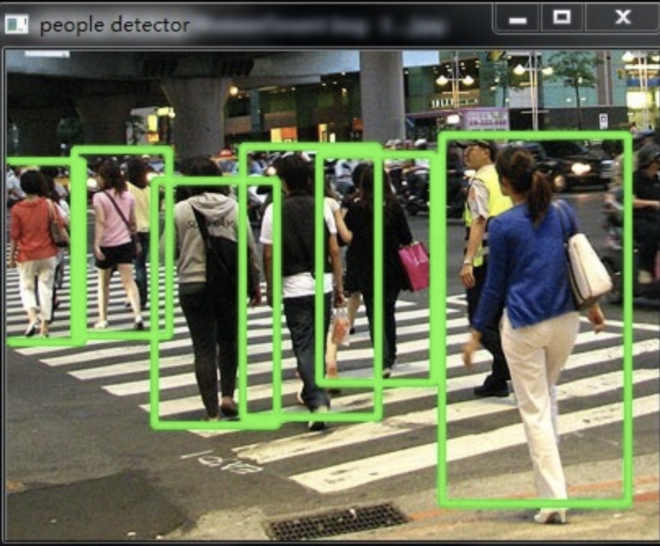

- 目标检测(Detection):分类任务关心整体,给出的是整张图片的内容描述,而检测则关注特定的物体目标,要求同时获得这一目标的类别信息和位置信息(classification + localization)。

- 图像分割(Segmentation):分割是对图像的像素级描述,它赋予每个像素类别(实例)意义,适用于理解要求较高的场景,如无人驾驶中对道路和非道路的分割。

接下来的课程中我们将围绕这三个任务对计算机视觉进行介绍。

3.应用场景

计算机视觉涉及的领域复杂,具有广泛的实际应用范围。总体而言,依赖于人工智能和机器学习,尤其是计算机视觉的创新的好处是,从电子商务行业到更经典的各种类型和规模的公司都可以利用其强大的功能,下图展示了相关的应用场景及相关的企业:

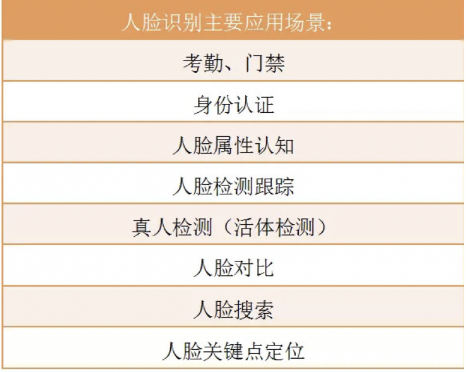

3.1 人脸识别

人脸识别技术目前已经广泛应用于金融、司法、军队、公安、边检、政府、航天、电力、工厂、教育、医疗等行业。据业内人士分析,我国的人脸识别产业的需求旺盛,需求推动导致企业敢于投入资金。

代表企业:Face++旷视科技、依图科技、商汤科技、深醒科技、云从科技等。

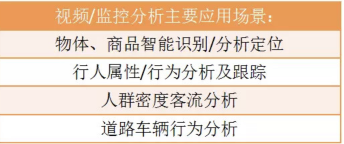

3.2 视频监控

人工智能技术可以对结构化的人、车、物等视频内容信息进行快速检索、查询。这项应用使得让公安系统在繁杂的监控视频中搜寻到罪犯的有了可能。在大量人群流动的交通枢纽,该技术也被广泛用于人群分析、防控预警等。

代表企业:SenseTime 商汤科技、DeepGlint 格灵深瞳、依图科技、云天励飞、深网视界等。

3.3 图片识别分析

代表企业:Face++旷视科技、图普科技、码隆科技、酒咔嚓、YI+陌上花科技等。

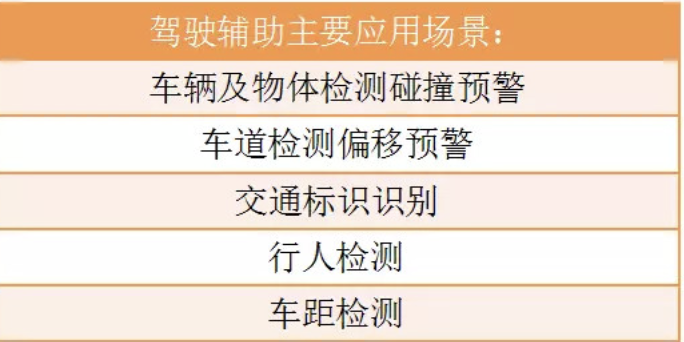

3.4 辅助驾驶

随着汽车的普及,汽车已经成为人工智能技术非常大的应用投放方向,但就目前来说,想要完全实现自动驾驶/无人驾驶,距离技术成熟还有一段路要走。不过利用人工智能技术,汽车的驾驶辅助的功能及应用越来越多,这些应用多半是基于计算机视觉和图像处理技术来实现。

代表企业:纵目科技、TuSimple 图森科技、驭势科技、MINIEYE 佑驾创新、中天安驰等。

除了上述这些,计算机视觉在三维视觉,三维重建,工业仿真,地理信息系统,工业视觉,医疗影像诊断,文字识别(OCR),图像及视频编辑等领域也有广泛的应用。

5.发展历史(了解)

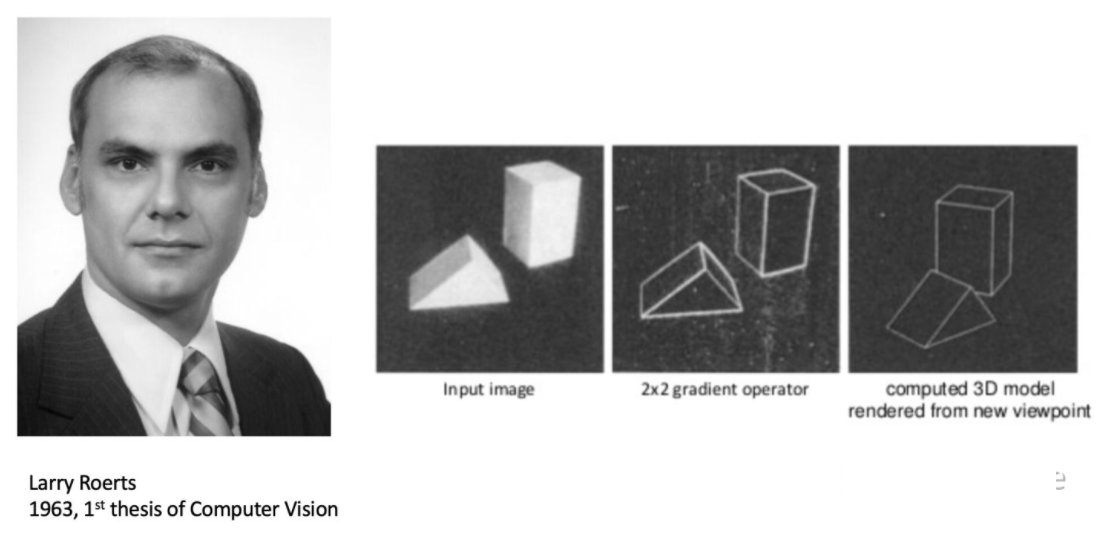

- 1963年,Larry Roberts发表了CV领域的第一篇专业论文,用以对简单几何体进行边缘提取和三维重建。

- 1966年,麻省理工学院(MIT)发起了一个夏季项目,目标是搭建一个机器视觉系统,完成模式识别(pattern recognition)等工作。虽然未成功,但是计算机视觉作为一个科学领域的正式诞生的标志。

- 1982年,学者David Marr发表的著作《Vision》从严谨又长远的角度给出了CV的发展方向和一些基本算法,其中不乏现在为人熟知的“图层”的概念、边缘提取、三维重建等,标志着计算机视觉成为了一门独立学科。

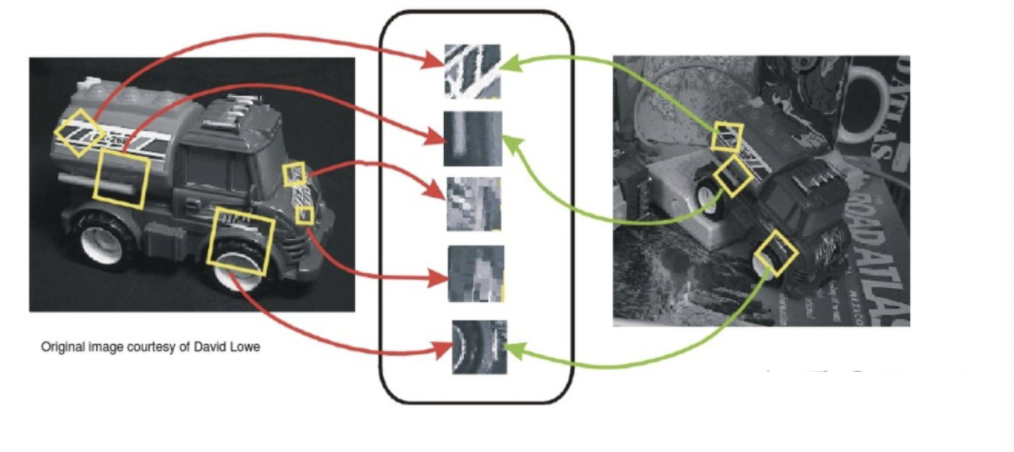

- 1999年David Lowe提出了尺度不变特征变换(SIFT, Scale-invariant feature transform)目标检测算法,用于匹配不同拍摄方向、纵深、光线等图片中的相同元素。

- 2009年,由Felzenszwalb教授在提出基于HOG的deformable parts model,可变形零件模型开发,它是深度学习之前最好的最成功的objectdetection & recognition算法。

- Everingham等人在2006年至2012年间搭建了一个大型图片数据库,供机器识别和训练,称为PASCAL Visual Object Challenge,该数据库中有20种类别的图片,每种图片数量在一千至一万张不等。

- 2009年,李飞飞教授等在CVPR2009上发表了一篇名为《ImageNet: A Large-Scale Hierarchical Image Database》的论文,发布了ImageNet数据集,这是为了检测计算机视觉能否识别自然万物,回归机器学习,克服过拟合问题。

-

2012 年,Alex Krizhevsky、Ilya Sutskever 和 Geoffrey Hinton 创造了一个“大型的深度卷积神经网络”,也即现在众所周知的 AlexNet,赢得了当年的 ILSVRC。这是史上第一次有模型在 ImageNet 数据集表现如此出色。自那时起,CNN 才成了家喻户晓的名字。

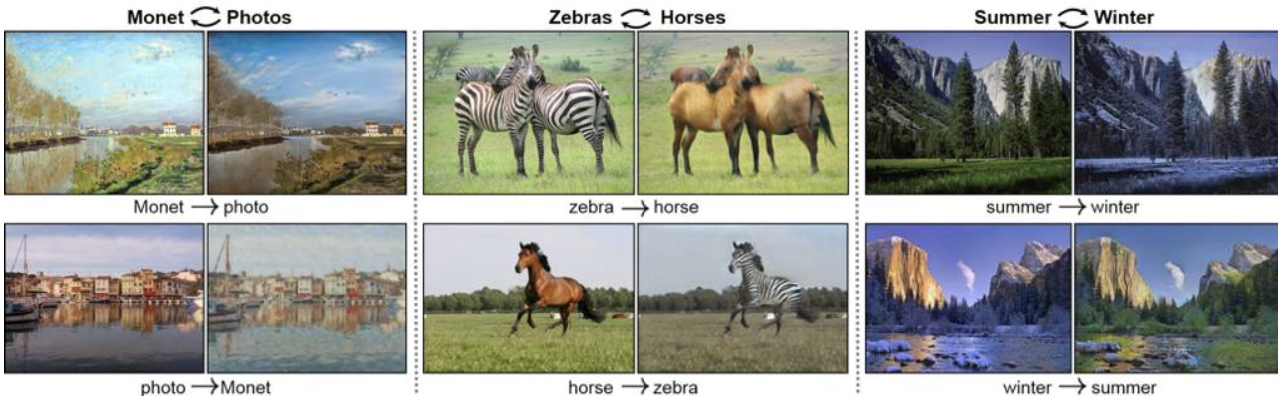

- 2014年,蒙特利尔大学提出生成对抗网络(GAN):拥有两个相互竞争的神经网络可以使机器学习得更快。一个网络尝试模仿真实数据生成假的数据,而另一个网络则试图将假数据区分出来。随着时间的推移,两个网络都会得到训练,生成对抗网络(GAN)被认为是计算机视觉领域的重大突破。

-

2018年末,英伟达发布的视频到视频生成(Video-to-Video synthesis),它通过精心设计的发生器、鉴别器网络以及时空对抗物镜,合成高分辨率、照片级真实、时间一致的视频,实现了让AI更具物理意识,更强大,并能够推广到新的和看不见的更多场景。

-

2019,更强大的GAN,BigGAN,是拥有了更聪明的学习技巧的GAN,由它训练生成的图像连它自己都分辨不出真假,因为除非拿显微镜看,否则将无法判断该图像是否有任何问题,因而,它更被誉为史上最强的图像生成器.

总结

- 计算机视觉的定义

让计算机理解图片或者视频中的内容

- 计算机视觉的任务

图像分类,目标检测,图像分割

- 计算机视觉的应用场景

人脸识别,视频监控,图片识别分析,辅助驾驶

深度学习框架-TensorFlow

学习目标

- 了解Tensorflow2.0框架的用途及流程

- 知道tf2.0的张量及其操作

- 知道tf.keras中的相关模块及常用方法

1.1 TensorFlow介绍

深度学习框架TensorFlow一经发布,就受到了广泛的关注,并在计算机视觉、音频处理、推荐系统和自然语言处理等场景下都被大面积推广使用,现在已发布2.3.0版本,接下来我们深入浅出的介绍Tensorflow的相关应用。

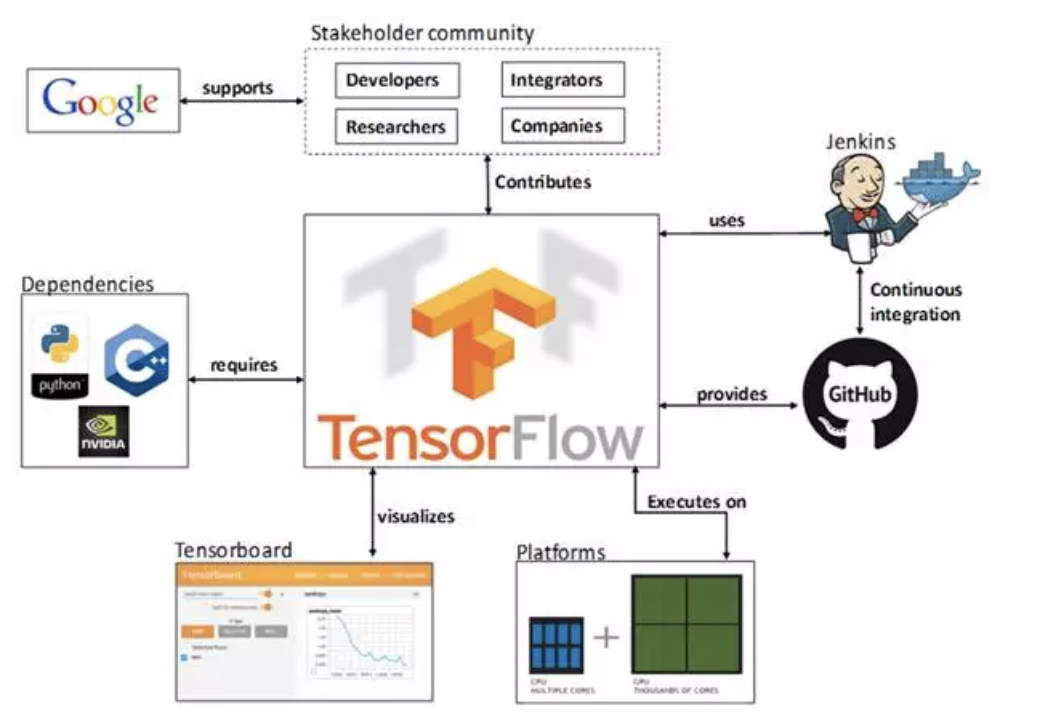

TensorFlow的依赖视图如下所示:

- TF托管在github平台,有google groups和contributors共同维护。

- TF提供了丰富的深度学习相关的API,支持Python和C/C++接口。

- TF提供了可视化分析工具Tensorboard,方便分析和调整模型。

- TF支持Linux平台,Windows平台,Mac平台,甚至手机移动设备等各种平台。

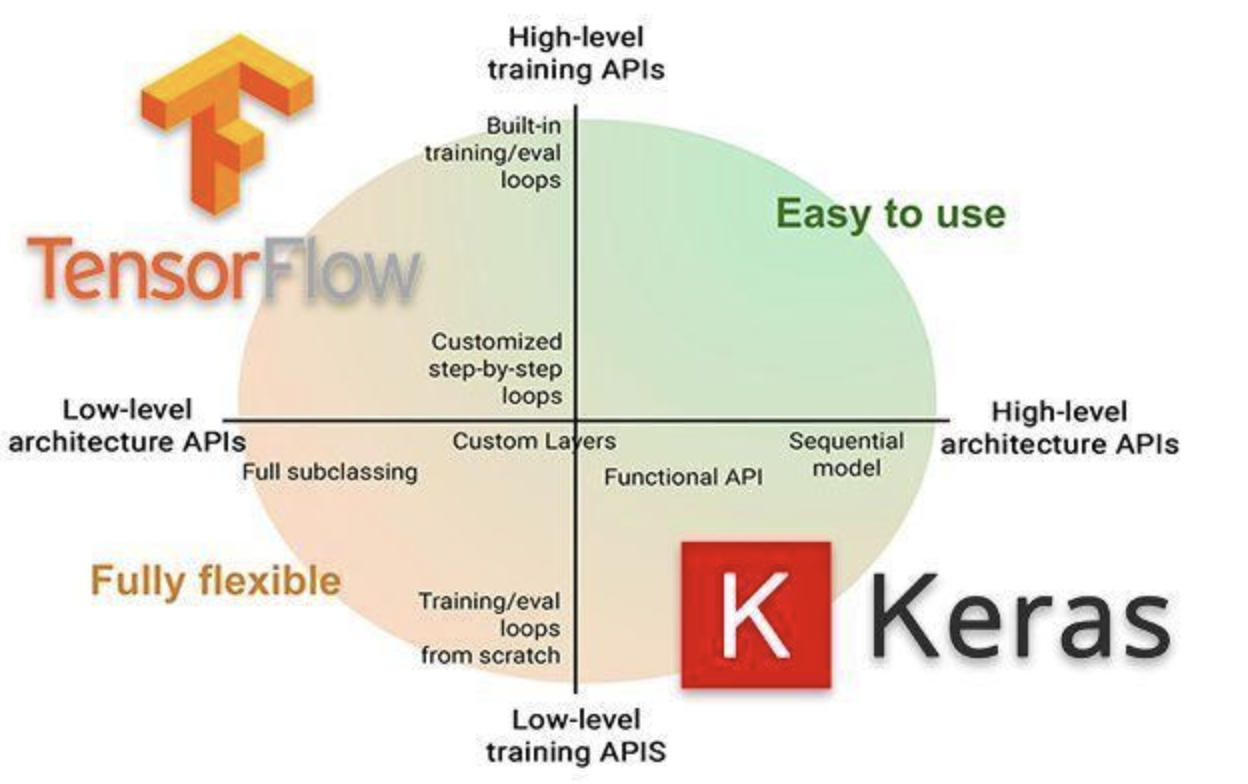

TensorFlow 2.0 将专注于简单性和易用性,工作流程如下所示:

1、使用tf.data加载数据。 使用tf.data实例化读取训练数据和测试数据

2、模型的建立与调试: 使用动态图模式 Eager Execution 和著名的神经网络高层 API 框架 Keras,结合可视化工具 TensorBoard,简易、快速地建立和调试模型;

3、模型的训练: 支持 CPU / 单 GPU / 单机多卡 GPU / 多机集群 / TPU 训练模型,充分利用海量数据和计算资源进行高效训练;

4、预训练模型调用: 通过 TensorFlow Hub,可以方便地调用预训练完毕的已有成熟模型。

5、模型的部署: 通过 TensorFlow Serving、TensorFlow Lite、TensorFlow.js 等组件,可以将TensorFlow 模型部署到服务器、移动端、嵌入式端等多种使用场景;

1.2 TensorFlow的安装

安装 TensorFlow在64 位系统上测试这些系统支持 TensorFlow:

- Ubuntu 16.04 或更高版本

- Windows 7 或更高版本

- macOS 10.12.6 (Sierra) 或更高版本(不支持 GPU)

进入虚拟环境当中再安装。推荐使用anoconda进行安装

- 1、非GPU版本安装

ubuntu安装

pip install tensorflow==2.3.0 -i https://pypi.tuna.tsinghua.edu.cn/simple

- 2、GPU版本安装

pip install tensorflow-gpu==2.3.0 -i https://pypi.tuna.tsinghua.edu.cn/simple

注:如果需要下载GPU版本的(TensorFlow只提供windows和linux版本的,没有Macos版本的)。

1.3 张量及其操作

1.3.1 张量Tensor

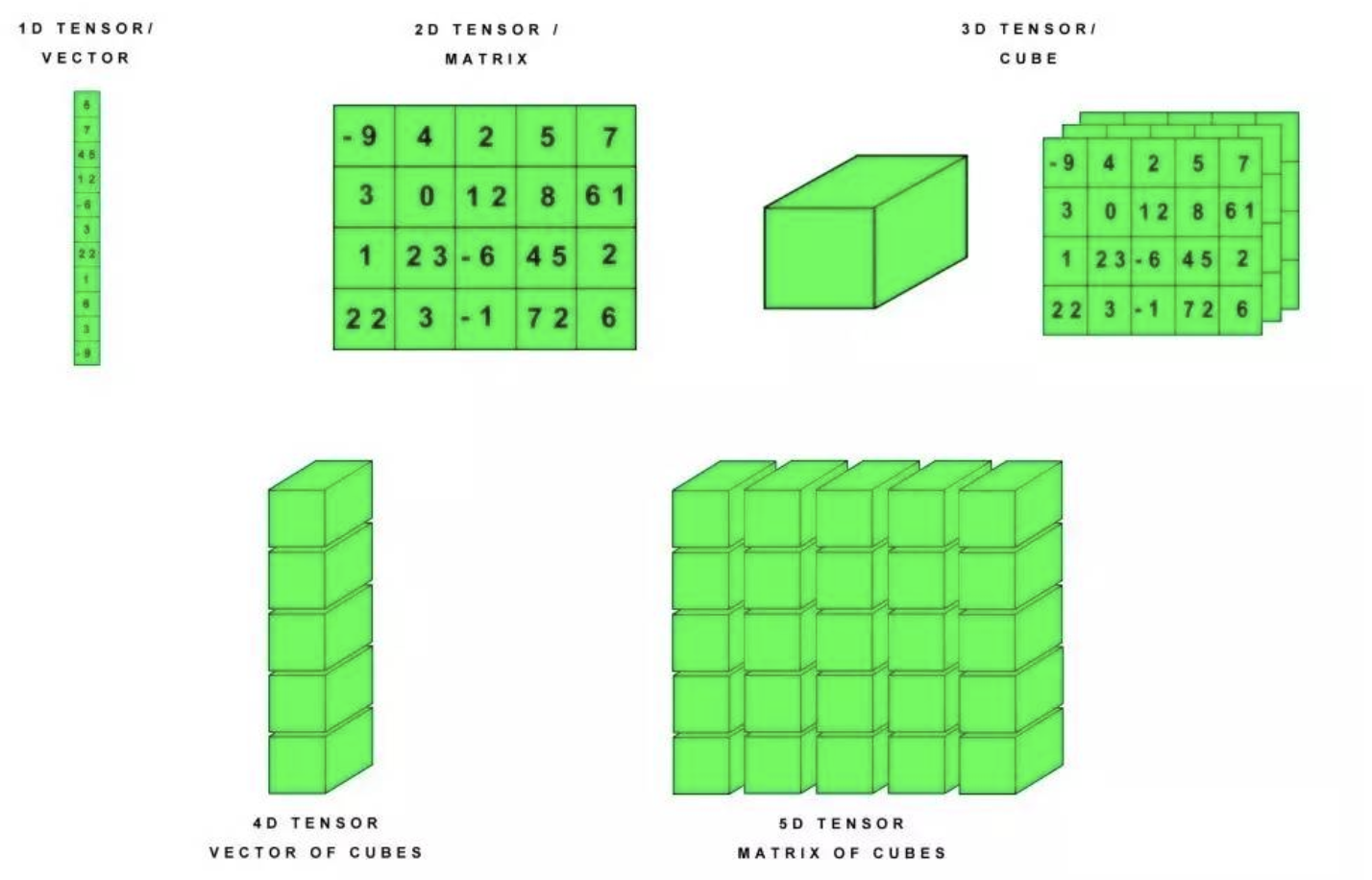

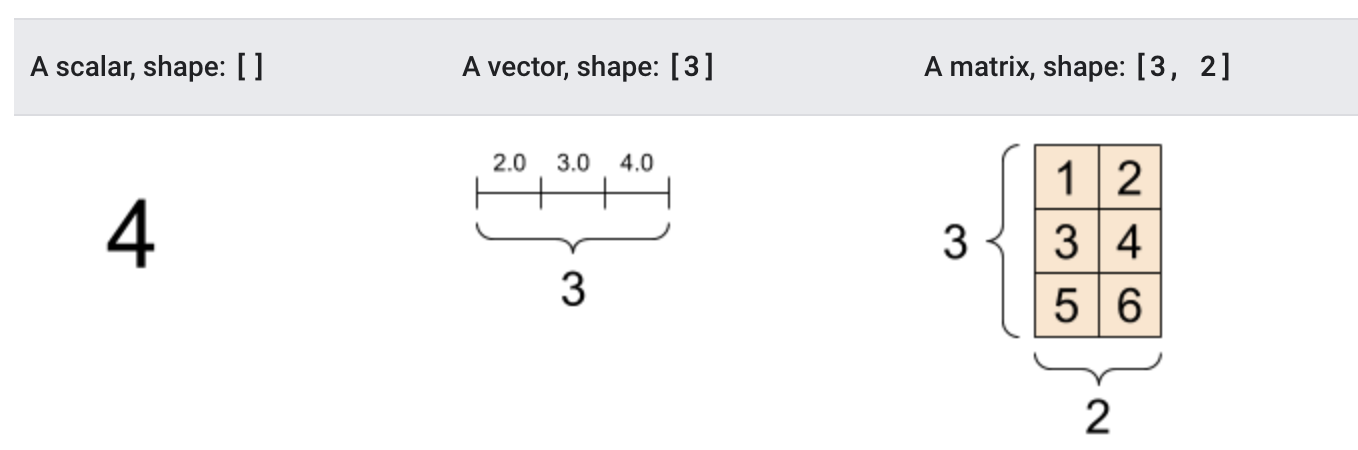

张量是一个多维数组。 与NumPy ndarray对象类似,tf.Tensor对象也具有数据类型和形状。如下图所示:

此外,tf.Tensors可以保留在GPU中。 TensorFlow提供了丰富的操作库(tf.add,tf.matmul,tf.linalg.inv等),它们使用和生成tf.Tensor。在进行张量操作之前先导入相应的工具包:

import tensorflow as tf

import numpy as np

1.基本方法

首先让我们创建基础的张量:

# 创建int32类型的0维张量,即标量

rank_0_tensor = tf.constant(4)

print(rank_0_tensor)

# 创建float32类型的1维张量

rank_1_tensor = tf.constant([2.0, 3.0, 4.0])

print(rank_1_tensor)

# 创建float16类型的二维张量

rank_2_tensor = tf.constant([[1, 2],

[3, 4],

[5, 6]], dtype=tf.float16)

print(rank_2_tensor)

输出结果为:

tf.Tensor(4, shape=(), dtype=int32)

tf.Tensor([2. 3. 4.], shape=(3,), dtype=float32)

tf.Tensor(

[[1. 2.]

[3. 4.]

[5. 6.]], shape=(3, 2), dtype=float16)

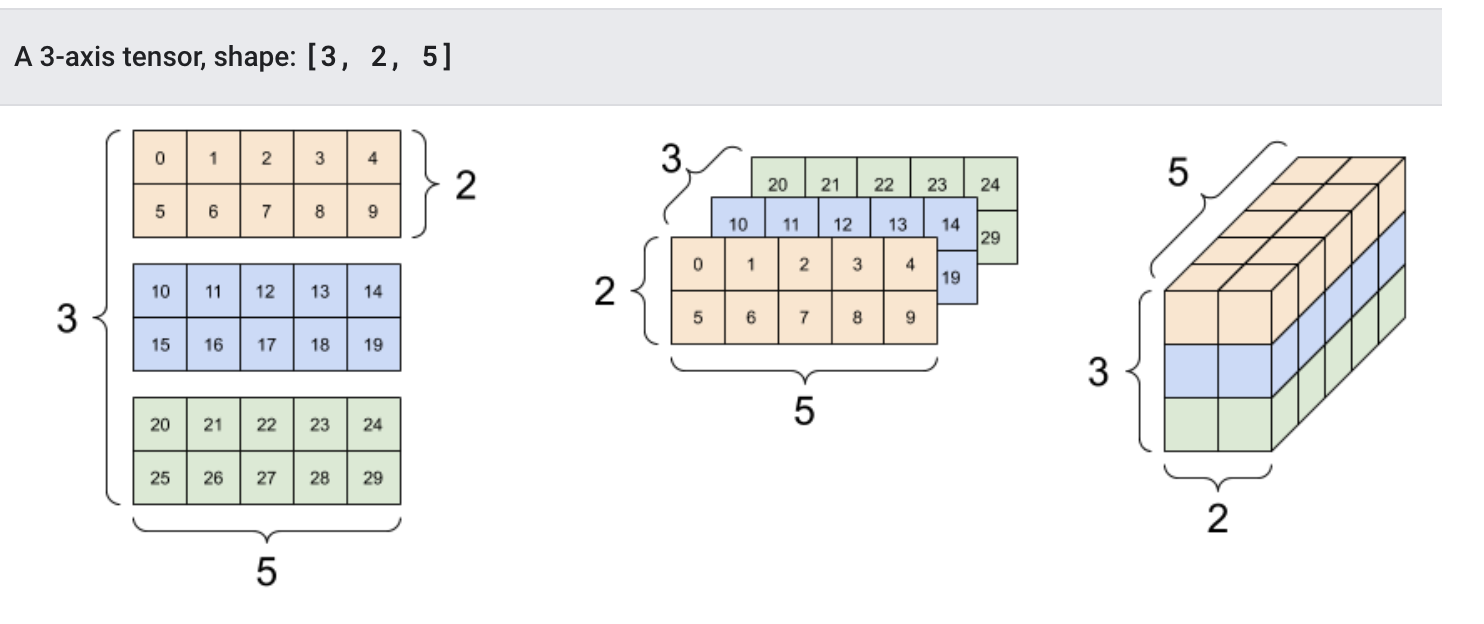

我们也可以创建更高维的张量:

# 创建float32类型的张量

rank_3_tensor = tf.constant([

[[0, 1, 2, 3, 4],

[5, 6, 7, 8, 9]],

[[10, 11, 12, 13, 14],

[15, 16, 17, 18, 19]],

[[20, 21, 22, 23, 24],

[25, 26, 27, 28, 29]],])

print(rank_3_tensor)

该输出结果我们有更多的方式将其展示出来:

2.转换成numpy

我们可将张量转换为numpy中的ndarray的形式,转换方法有两种,以张量rank_2_tensor为例:

- np.array

np.array(rank_2_tensor)

- Tensor.numpy()

rank_2_tensor.numpy()

3.常用函数

我们可以对张量做一些基本的数学运算,包括加法、元素乘法和矩阵乘法等:

# 定义张量a和b

a = tf.constant([[1, 2],

[3, 4]])

b = tf.constant([[1, 1],

[1, 1]])

print(tf.add(a, b), "\n") # 计算张量的和

print(tf.multiply(a, b), "\n") # 计算张量的元素乘法

print(tf.matmul(a, b), "\n") # 计算乘法

输出结果为:

tf.Tensor(

[[2 3]

[4 5]], shape=(2, 2), dtype=int32)

tf.Tensor(

[[1 2]

[3 4]], shape=(2, 2), dtype=int32)

tf.Tensor(

[[3 3]

[7 7]], shape=(2, 2), dtype=int32)

另外张量也可用于各种聚合运算:

tf.reduce_sum() # 求和

tf.reduce_mean() # 平均值

tf.reduce_max() # 最大值

tf.reduce_min() # 最小值

tf.argmax() # 最大值的索引

tf.argmin() # 最小值的索引

例如:

c = tf.constant([[4.0, 5.0], [10.0, 1.0]])

# 最大值

print(tf.reduce_max(c))

# 最大值索引

print(tf.argmax(c))

# 计算均值

print(tf.reduce_mean(c))

输出为:

tf.Tensor(10.0, shape=(), dtype=float32)

tf.Tensor([1 0], shape=(2,), dtype=int64)

tf.Tensor(5.0, shape=(), dtype=float32)

4.变量

变量是一种特殊的张量,形状是不可变,但可以更改其中的参数。定义时的方法是:

my_variable = tf.Variable([[1.0, 2.0], [3.0, 4.0]])

我们也可以获取它的形状,类型及转换为ndarray:

print("Shape: ",my_variable.shape)

print("DType: ",my_variable.dtype)

print("As NumPy: ", my_variable.numpy)

输出为:

Shape: (2, 2)

DType: <dtype: 'float32'>

As NumPy: <bound method BaseResourceVariable.numpy of <tf.Variable 'Variable:0' shape=(2, 2) dtype=float32, numpy=

array([[1., 2.],

[3., 4.]], dtype=float32)>>

1.4 tf.keras介绍

tf.keras是TensorFlow 2.0的高阶API接口,为TensorFlow的代码提供了新的风格和设计模式,大大提升了TF代码的简洁性和复用性,官方也推荐使用tf.keras来进行模型设计和开发。

1.4.1 常用模块

tf.keras中常用模块如下表所示:

| 模块 | 概述 |

|---|---|

| activations | 激活函数 |

| applications | 预训练网络模块 |

| Callbacks | 在模型训练期间被调用 |

| datasets | tf.keras数据集模块,包括boston_housing,cifar10,fashion_mnist,imdb ,mnist |

| layers | Keras层API |

| losses | 各种损失函数 |

| metircs | 各种评价指标 |

| models | 模型创建模块,以及与模型相关的API |

| optimizers | 优化方法 |

| preprocessing | Keras数据的预处理模块 |

| regularizers | 正则化,L1,L2等 |

| utils | 辅助功能实现 |

1.4.2 常用方法

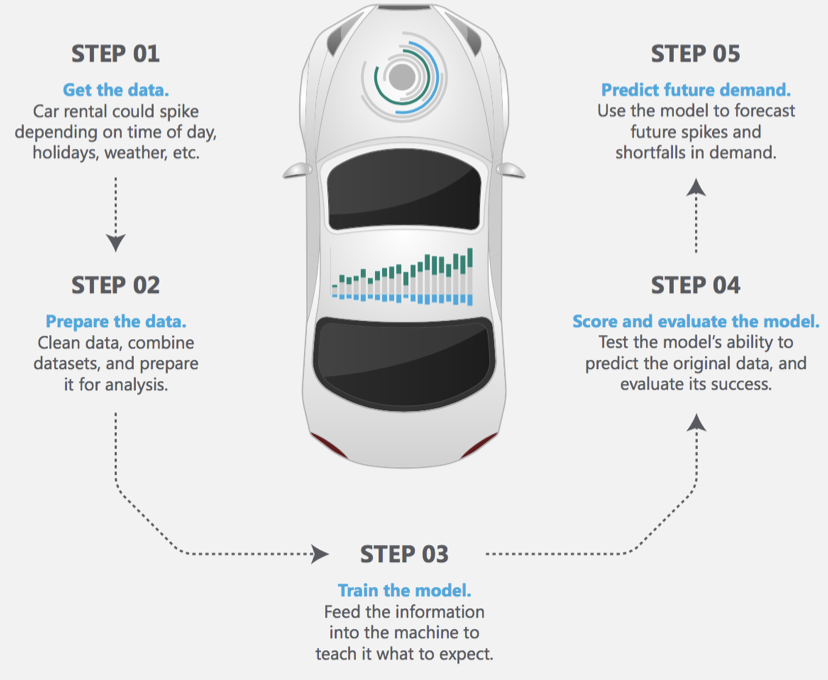

深度学习实现的主要流程:1.数据获取,2,数据处理,3.模型创建与训练,4 模型测试与评估,5.模型预测

1.导入tf.keras

使用 tf.keras,首先需要在代码开始时导入tf.keras

import tensorflow as tf

from tensorflow import keras

2.数据输入

对于小的数据集,可以直接使用numpy格式的数据进行训练、评估模型,对于大型数据集或者要进行跨设备训练时使用tf.data.datasets来进行数据输入。

3.模型构建

- 简单模型使用Sequential进行构建

- 复杂模型使用函数式编程来构建

- 自定义layers

4.训练与评估

- 配置训练过程:

# 配置优化方法,损失函数和评价指标

model.compile(optimizer=tf.train.AdamOptimizer(0.001),

loss='categorical_crossentropy',

metrics=['accuracy'])

- 模型训练

# 指明训练数据集,训练epoch,批次大小和验证集数据

model.fit/fit_generator(dataset, epochs=10,

batch_size=3,

validation_data=val_dataset,

)

- 模型评估

# 指明评估数据集和批次大小

model.evaluate(x, y, batch_size=32)

- 模型预测

# 对新的样本进行预测

model.predict(x, batch_size=32)

5.回调函数(callbacks)

回调函数用在模型训练过程中,来控制模型训练行为,可以自定义回调函数,也可使用tf.keras.callbacks 内置的 callback :

ModelCheckpoint:定期保存 checkpoints。 LearningRateScheduler:动态改变学习速率。 EarlyStopping:当验证集上的性能不再提高时,终止训练。 TensorBoard:使用 TensorBoard 监测模型的状态。

6.模型的保存和恢复

- 只保存参数

# 只保存模型的权重

model.save_weights('./my_model')

# 加载模型的权重

model.load_weights('my_model')

- 保存整个模型

# 保存模型架构与权重在h5文件中

model.save('my_model.h5')

# 加载模型:包括架构和对应的权重

model = keras.models.load_model('my_model.h5')

总结

-

了解Tensorflow2.0框架的用途及流程

1.使用tf.data加载数据

2、模型的建立与调试

3、模型的训练

4、预训练模型调用

5、模型的部署

-

知道tf2.0的张量及其操作

张量是多维数组。

1、创建方法:tf.constant()

2、转换为numpy: np.array()或tensor.asnumpy()

3、常用函数:加法,乘法,及各种聚合运算

4、变量:tf.Variable()

-

知道tf.keras中的相关模块及常用方法

常用模块:models,losses,application等

常用方法:

1、导入tf.keras 2、数据输入 3、模型构建 4、训练与评估 5、回调函数 6、模型的保存与恢复

1.2 快速入门模型

学习目标

- 知道使用tf.keras的基本流程

- 了解tf.keras实现模型构建的方法

- 了解tf.keras中模型训练验证的相关方法

今天我们通过鸢尾花分类案例,来给大家介绍tf.keras的基本使用流程。tf.keras使用tensorflow中的高级接口,我们调用它即可完成:

- 导入和解析数据集

- 构建模型

- 使用样本数据训练该模型

- 评估模型的效果。

由于与scikit -learn的相似性,接下来我们将通过将Keras与scikit -learn进行比较,介绍tf.Keras的相关使用方法。

1.相关的库的导入

在这里使用sklearn和tf.keras完成鸢尾花分类,导入相关的工具包:

# 绘图

import seaborn as sns

# 数值计算

import numpy as np

# sklearn中的相关工具

# 划分训练集和测试集

from sklearn.model_selection import train_test_split

# 逻辑回归

from sklearn.linear_model import LogisticRegressionCV

# tf.keras中使用的相关工具

# 用于模型搭建

from tensorflow.keras.models import Sequential

# 构建模型的层和激活方法

from tensorflow.keras.layers import Dense, Activation

# 数据处理的辅助工具

from tensorflow.keras import utils

2.数据展示和划分

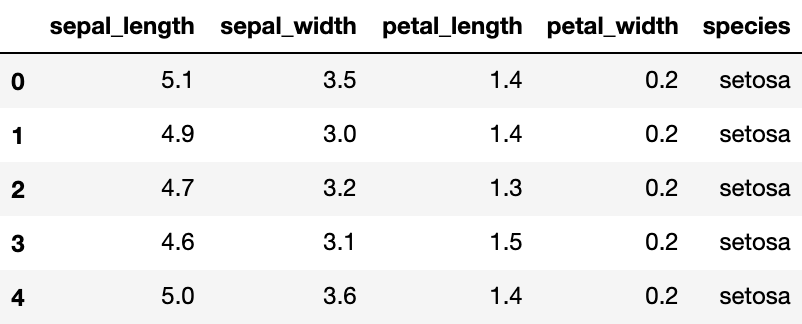

利用seborn导入相关的数据,iris数据以dataFrame的方式在seaborn进行存储,我们读取后并进行展示:

# 读取数据

iris = sns.load_dataset("iris")

# 展示数据的前五行

iris.head()

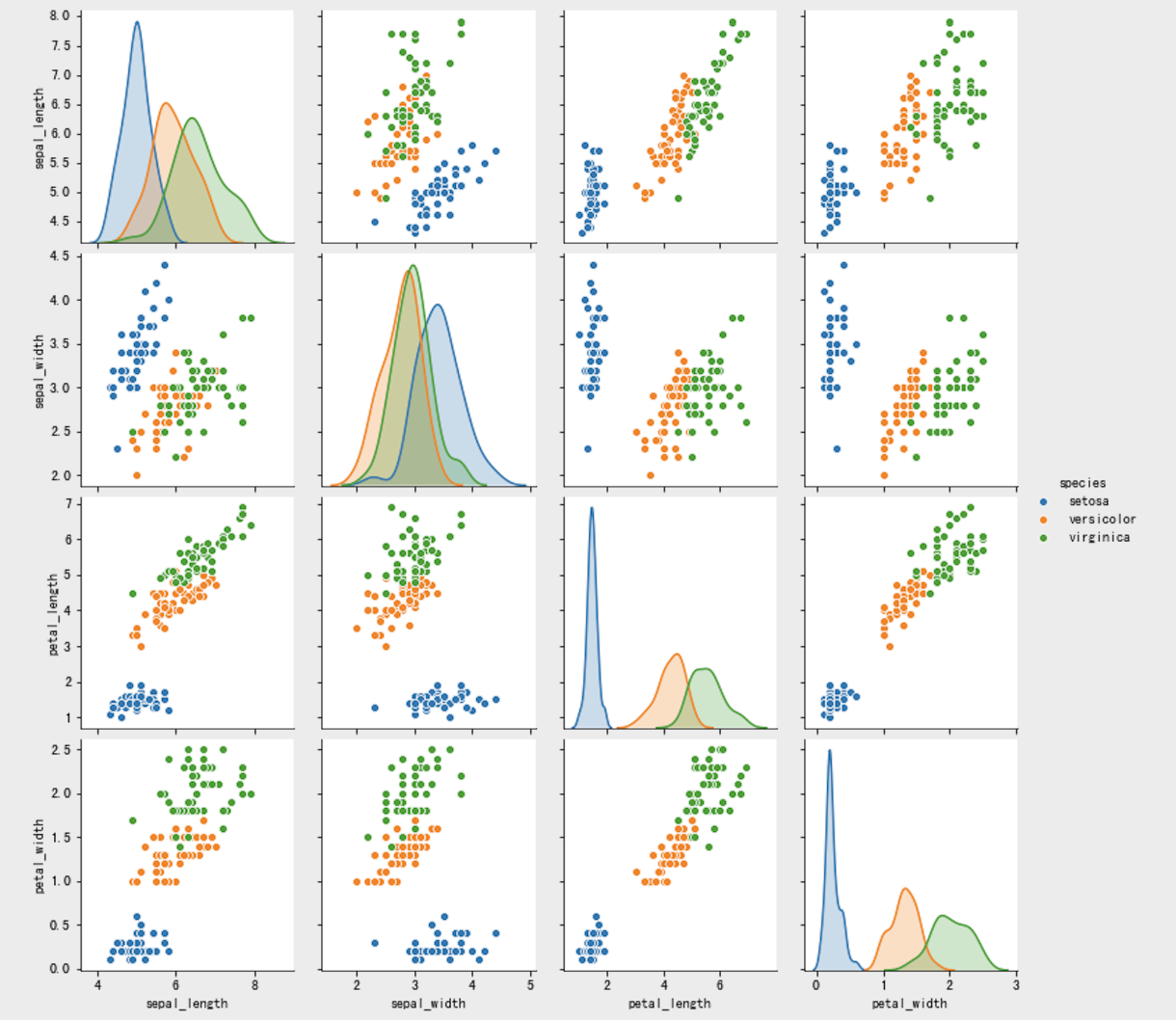

另外,利用seaborn中pairplot函数探索数据特征间的关系:

# 将数据之间的关系进行可视化

sns.pairplot(iris, hue='species')

将数据划分为训练集和测试集:从iris dataframe中提取原始数据,将花瓣和萼片数据保存在数组X中,标签保存在相应的数组y中:

# 花瓣和花萼的数据

X = iris.values[:, :4]

# 标签值

y = iris.values[:, 4]

利用train_test_split完成数据集划分:

# 将数据集划分为训练集和测试集

train_X, test_X, train_y, test_y = train_test_split(X, y, train_size=0.5, test_size=0.5, random_state=0)

接下来,我们就可以使用sklearn和tf.keras来完成预测

3.sklearn实现

利用逻辑回归的分类器,并使用交叉验证的方法来选择最优的超参数,实例化LogisticRegressionCV分类器,并使用fit方法进行训练:

# 实例化分类器

lr = LogisticRegressionCV()

# 训练

lr.fit(train_X, train_y)

利用训练好的分类器进行预测,并计算准确率:

# 计算准确率并进行打印

print("Accuracy = {:.2f}".format(lr.score(test_X, test_y)))

逻辑回归的准确率为:

Accuracy = 0.93

4.tf.keras实现

在sklearn中我们只要实例化分类器并利用fit方法进行训练,最后衡量它的性能就可以了,那在tf.keras中与在sklearn非常相似,不同的是:

- 构建分类器时需要进行模型搭建

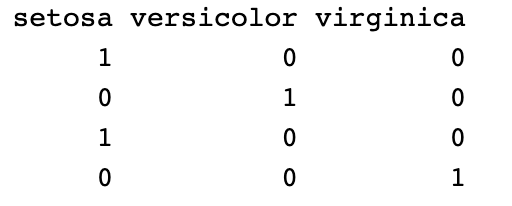

- 数据采集时,sklearn可以接收字符串型的标签,如:“setosa”,但是在tf.keras中需要对标签值进行热编码,如下所示:

有很多方法可以实现热编码,比如pandas中的get_dummies(),在这里我们使用tf.keras中的方法进行热编码:

# 进行热编码

def one_hot_encode_object_array(arr):

# 去重获取全部的类别

uniques, ids = np.unique(arr, return_inverse=True)

# 返回热编码的结果

return utils.to_categorical(ids, len(uniques))

4.1 数据处理

接下来对标签值进行热编码:

# 训练集热编码

train_y_ohe = one_hot_encode_object_array(train_y)

# 测试集热编码

test_y_ohe = one_hot_encode_object_array(test_y)

4.2 模型搭建

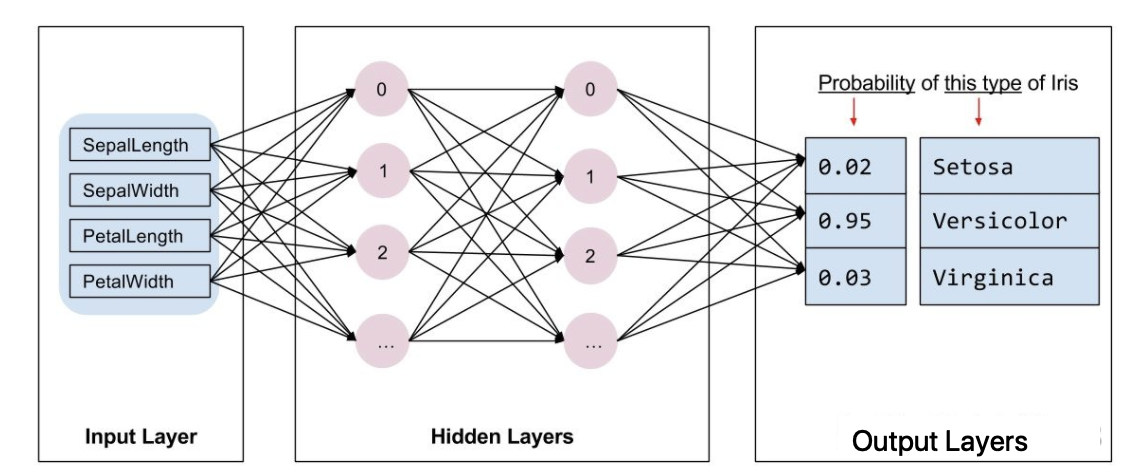

在sklearn中,模型都是现成的。tf.Keras是一个神经网络库,我们需要根据数据和标签值构建神经网络。神经网络可以发现特征与标签之间的复杂关系。神经网络是一个高度结构化的图,其中包含一个或多个隐藏层。每个隐藏层都包含一个或多个神经元。神经网络有多种类别,该程序使用的是密集型神经网络,也称为全连接神经网络:一个层中的神经元将从上一层中的每个神经元获取输入连接。例如,图 2 显示了一个密集型神经网络,其中包含 1 个输入层、2 个隐藏层以及 1 个输出层,如下图所示:

上图 中的模型经过训练并馈送未标记的样本时,它会产生 3 个预测结果:相应鸢尾花属于指定品种的可能性。对于该示例,输出预测结果的总和是 1.0。该预测结果分解如下:山鸢尾为 0.02,变色鸢尾为 0.95,维吉尼亚鸢尾为 0.03。这意味着该模型预测某个无标签鸢尾花样本是变色鸢尾的概率为 95%。

TensorFlow tf.keras API 是创建模型和层的首选方式。通过该 API,您可以轻松地构建模型并进行实验,而将所有部分连接在一起的复杂工作则由 Keras 处理。

tf.keras.Sequential 模型是层的线性堆叠。该模型的构造函数会采用一系列层实例;在本示例中,采用的是 2 个密集层(分别包含 10 个节点)以及 1 个输出层(包含 3 个代表标签预测的节点)。第一个层的 input_shape 参数对应该数据集中的特征数量:

# 利用sequential方式构建模型

model = Sequential([

# 隐藏层1,激活函数是relu,输入大小有input_shape指定

Dense(10, activation="relu", input_shape=(4,)),

# 隐藏层2,激活函数是relu

Dense(10, activation="relu"),

# 输出层

Dense(3,activation="softmax")

])

通过model.summary可以查看模型的架构:

Model: "sequential"

_________________________________________________________________

Layer (type) Output Shape Param #

=================================================================

dense (Dense) (None, 10) 50

_________________________________________________________________

dense_1 (Dense) (None, 10) 110

_________________________________________________________________

dense_2 (Dense) (None, 3) 33

=================================================================

Total params: 193

Trainable params: 193

Non-trainable params: 0

_________________________________________________________________

激活函数可决定层中每个节点的输出形状。这些非线性关系很重要,如果没有它们,模型将等同于单个层。激活函数有很多,但隐藏层通常使用 ReLU。

隐藏层和神经元的理想数量取决于问题和数据集。与机器学习的多个方面一样,选择最佳的神经网络形状需要一定的知识水平和实验基础。一般来说,增加隐藏层和神经元的数量通常会产生更强大的模型,而这需要更多数据才能有效地进行训练。

4.3 模型训练和预测

在训练和评估阶段,我们都需要计算模型的损失。这样可以衡量模型的预测结果与预期标签有多大偏差,也就是说,模型的效果有多差。我们希望尽可能减小或优化这个值,所以我们设置优化策略和损失函数,以及模型精度的计算方法:

# 设置模型的相关参数:优化器,损失函数和评价指标

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=["accuracy"])

接下来与在sklearn中相同,分别调用fit和predict方法进行预测即可。

# 模型训练:epochs,训练样本送入到网络中的次数,batch_size:每次训练的送入到网络中的样本个数

model.fit(train_X, train_y_ohe, epochs=10, batch_size=1, verbose=1);

上述代码完成的是:

- 迭代每个epoch。通过一次数据集即为一个epoch。

- 在一个epoch中,遍历训练 Dataset 中的每个样本,并获取样本的特征 (x) 和标签 (y)。

- 根据样本的特征进行预测,并比较预测结果和标签。衡量预测结果的不准确性,并使用所得的值计算模型的损失和梯度。

- 使用 optimizer 更新模型的变量。

- 对每个epoch重复执行以上步骤,直到模型训练完成。

训练过程展示如下:

Epoch 1/10

75/75 [==============================] - 0s 616us/step - loss: 0.0585 - accuracy: 0.9733

Epoch 2/10

75/75 [==============================] - 0s 535us/step - loss: 0.0541 - accuracy: 0.9867

Epoch 3/10

75/75 [==============================] - 0s 545us/step - loss: 0.0650 - accuracy: 0.9733

Epoch 4/10

75/75 [==============================] - 0s 542us/step - loss: 0.0865 - accuracy: 0.9733

Epoch 5/10

75/75 [==============================] - 0s 510us/step - loss: 0.0607 - accuracy: 0.9733

Epoch 6/10

75/75 [==============================] - 0s 659us/step - loss: 0.0735 - accuracy: 0.9733

Epoch 7/10

75/75 [==============================] - 0s 497us/step - loss: 0.0691 - accuracy: 0.9600

Epoch 8/10

75/75 [==============================] - 0s 497us/step - loss: 0.0724 - accuracy: 0.9733

Epoch 9/10

75/75 [==============================] - 0s 493us/step - loss: 0.0645 - accuracy: 0.9600

Epoch 10/10

75/75 [==============================] - 0s 482us/step - loss: 0.0660 - accuracy: 0.9867

与sklearn中不同,对训练好的模型进行评估时,与sklearn.score方法对应的是tf.keras.evaluate()方法,返回的是损失函数和在compile模型时要求的指标:

# 计算模型的损失和准确率

loss, accuracy = model.evaluate(test_X, test_y_ohe, verbose=1)

print("Accuracy = {:.2f}".format(accuracy))

分类器的准确率为:

3/3 [==============================] - 0s 591us/step - loss: 0.1031 - accuracy: 0.9733

Accuracy = 0.97

到此我们对tf.kears的使用有了一个基本的认知,在接下来的课程中会给大家解释神经网络以及在计算机视觉中的常用的CNN的使用。

总结

1.使用tf.keras进行分类时的主要流程:

数据处理-构建模型-模型训练-模型验证

2.tf.keras中构建模型可通过squential()来实现并利用.fit()方法进行训练

91 - accuracy: 0.9600

Epoch 8/10

75/75 [] - 0s 497us/step - loss: 0.0724 - accuracy: 0.9733

Epoch 9/10

75/75 [] - 0s 493us/step - loss: 0.0645 - accuracy: 0.9600

Epoch 10/10

75/75 [==============================] - 0s 482us/step - loss: 0.0660 - accuracy: 0.9867

与sklearn中不同,对训练好的模型进行评估时,与sklearn.score方法对应的是tf.keras.evaluate()方法,返回的是损失函数和在compile模型时要求的指标:

计算模型的损失和准确率

loss, accuracy = model.evaluate(test_X, test_y_ohe, verbose=1)

print(“Accuracy = {:.2f}”.format(accuracy))

分类器的准确率为:

3/3 [==============================] - 0s 591us/step - loss: 0.1031 - accuracy: 0.9733

Accuracy = 0.97

到此我们对tf.kears的使用有了一个基本的认知,在接下来的课程中会给大家解释神经网络以及在计算机视觉中的常用的CNN的使用。

------

**总结**

1.使用tf.keras进行分类时的主要流程:

数据处理-构建模型-模型训练-模型验证

2.tf.keras中构建模型可通过squential()来实现并利用.fit()方法进行训练

3.使用evaluate()方法计算损失函数和准确率

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)