简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大模型微调,简单来说就是在预训练通用大模型的基础上,用专属业务数据集,二次训练优化模型权重,让模型适配特定业务逻辑。区别于从零训练大模型,微调低成本、短周期、轻量化,是中小企业AI产品最优选择。

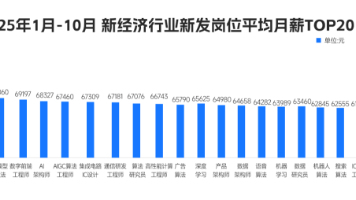

摘要:Skill是连接AI大模型与具体任务的关键桥梁,通过标准化流程、上下文注入和触发机制解决大模型的情境连续性问题。优秀的Skill包含触发条件、前置检查、执行步骤和坑点提示,属于COLD记忆范畴。AI大模型应用开发工程师负责将大模型能力转化为实用产品,核心职责包括需求分析、技术选型、应用开发、测试优化及部署运维。该职业薪资可达月薪60k,是AI技术落地的关键角色。随着AI应用深化,这一复合型人

文章摘要: Harness Engineering(驾驭工程)是新兴的AI工程方法论,旨在通过构建智能体环境(Harness)提升AI可靠性。核心公式为"AI Agent = Model + Harness",强调环境设计比模型本身更重要。该方法解决了AI反复犯错、长任务中断等问题,通过指令集、状态管理、验证机制等设计,使模型智能变得可用。尽管能显著提升任务完成质量,但存在构建成本高、运行开销大等

**摘要:**企业在发展AI Agent时,长期优势不取决于短期项目能力,而在于将项目成果转化为可持续的组织能力。**早期关注点往往是项目启动、试点和成果交付,但真正拉开差距的是企业能否将项目中的有效方法、协同机制等持续沉淀并迭代,形成组织默认能力。项目能力解决"如何完成当前任务",而组织能力经营确保"每次项目后组织变得更强大"。成熟企业更擅长将项目经验转化为长期竞争力,通过不断积累和优化,构建难

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。✅从入门到精通的全套视频教程✅AI大模型学习路线图(0基础到项目实战仅需90天)✅大模型书籍与技术文档PDF✅各大厂大模型面试题目详解✅640套AI大模型报告合集✅大模型入门实

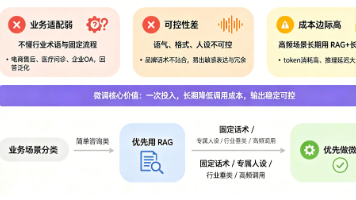

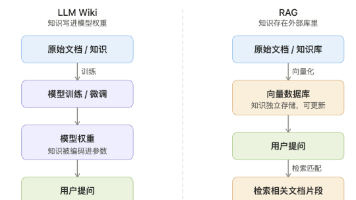

文章分析了AI助手在知识回答上的局限性,并提出RAG(检索增强生成)和LLM Wiki两种解决方案。RAG通过外部文档检索辅助回答,适合频繁更新的知识;LLM Wiki通过知识编辑技术内化知识,适合稳定内容。两者各有优势,可结合使用。同时指出AI人才需求激增,建议技术人员将现有技能与AI结合以提升竞争力,并提供了相关学习资源。

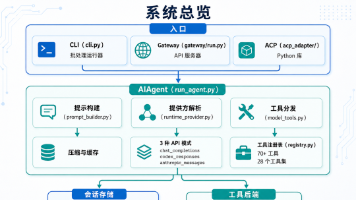

读完这些子系统,可以提炼出 Hermes 背后的六条核心设计原则——它们相互支撑,共同造就了在复杂长任务场景下依然稳定可靠的 Agent 框架。原则具体体现Prompt 稳定性系统提示词在会话内不变,最大化 Anthropic Prompt Cache 命中率,降低约 75% 输入 token 成本可观测执行每次工具调用都通过 callback 实时反馈给用户:CLI 显示 spinner,网关发

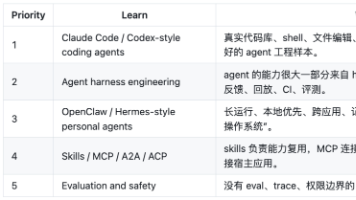

【AI Agent学习路线与资源推荐】开源项目Agent Learning Hub提供了一条系统化的学习路径,涵盖从基础到进阶的完整Agent开发流程。内容分为五个部分:1)入门基础(Agent概念、最小循环搭建);2)进阶技能(工具调用、RAG、多Agent协调);3)工程实践(评测、部署上线);4)项目实战(分阶实践);5)精选资源(官方文档、论文、开源项目)。特别推荐关注Claude Cod

当你和ChatGPT对话的时候,你有没有想过一个问题:它到底是怎么"理解"你说的话,然后给出回答的?很多人把大语言模型(Large Language Model, LLM)想象成一个超级聪明的大脑。但真相可能比你想象的更简单,也可能更令人震撼——。今天我想从数学和工程的角度,把LLM的工作原理彻底讲清楚。不需要你有很深的数学背景,但我会尽量做到准确,不搞模糊的比喻。

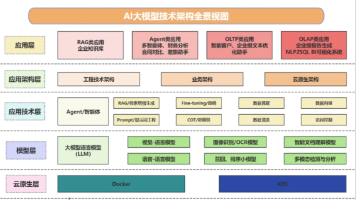

本文详细阐述了AI产品经理的定义、必要性及其核心工作内容。文章首先解释了AI产品并非简单接入大模型,而是由用户交互、应用编排、模型能力、数据、算力和算法共同组成的任务系统。接着,明确了AI产品经理的职责是将AI能力转化为用户价值、业务结果和可持续产品系统,并强调了其在AI时代的重要性。文章进一步介绍了AI产品经理的七步工作闭环,包括判断场景、选择形态、设计上下文、组合技术方案、建立评估体系、推动生