简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

梯度消失和梯度爆炸是由于深层神经网络中反向传播时梯度连乘效应导致的。梯度消失源于激活函数饱和(如sigmoid)或权重过小,使梯度趋近0;梯度爆炸则由于权重过大导致梯度指数级增长。解决方法包括:使用ReLU等激活函数、合理初始化权重(He/Xavier)、批归一化(BatchNorm)、梯度裁剪(Gradient Clipping)、残差连接(ResNet)及自适应优化器(Adam)。这些技术能有

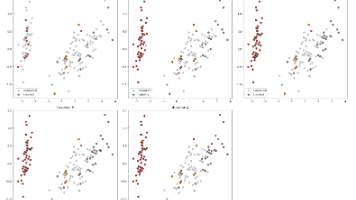

本文系统介绍了机器学习中不同任务的评估指标。分类任务使用准确率、精确率、召回率、F1值和ROC-AUC等指标;回归任务采用均方误差(MSE)、平均绝对误差(MAE)和决定系数(R²);聚类任务则使用轮廓系数、归一化互信息(NMI)和调整兰德指数(ARI)。通过实例分析,详细展示了这些指标的计算方法和适用场景。合理选择评估指标能全面反映模型性能,为模型优化提供依据。

半监督学习结合少量标注数据和大量未标注数据进行模型训练,有效降低标注成本。自训练通过初始模型预测高置信度样本作为伪标签迭代优化,但易受初始误差影响。协同训练则利用多视图特征,让不同分类器互相提供伪标签,提升模型鲁棒性。这些方法广泛应用于文本分类、图像识别等领域,显著提高模型性能。

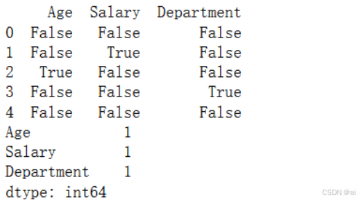

数据预处理是提升机器学习模型性能的关键步骤,主要包括数据清洗、集成、变换和规约。针对缺失值,文章介绍了删除法、均值/众数填充、插值法及基于模型的KNN和MICE插补方法。异常值检测则采用Z-Score和IQR等统计方法识别偏离数据分布的样本。这些预处理技术能有效改善数据质量,为后续建模奠定基础。文中还提供了Python代码示例,帮助读者快速实现相关操作。

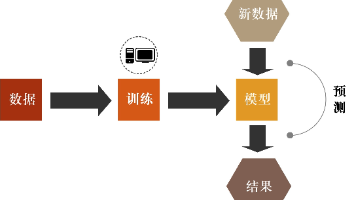

摘要 机器学习是人工智能的核心分支,通过数据驱动方法让计算机自动学习规律,实现预测、分类和决策。主要分为四类:监督学习(利用标注数据训练模型)、无监督学习(挖掘无标注数据的潜在模式)、半监督学习(结合少量标注与大量无标注数据)和强化学习(通过环境交互优化决策策略)。各类方法各有特点,可单独或结合使用解决实际问题,如医疗诊断、推荐系统、自动驾驶等。理解这些基础类型是掌握机器学习的关键。

本文介绍了三种重要的概率图模型及其应用。高斯混合模型(GMM)通过多个高斯分布的线性组合实现软聚类和密度估计,适用于图像分割、异常检测等场景。隐马尔可夫模型(HMM)用于建模序列数据,能处理语音识别、基因分析等时序问题。贝叶斯网络则通过有向无环图表示变量间的条件依赖关系,在医疗诊断、风险评估等领域有广泛应用。这些模型结合概率论与图论,为复杂系统的建模和推断提供了有效工具。

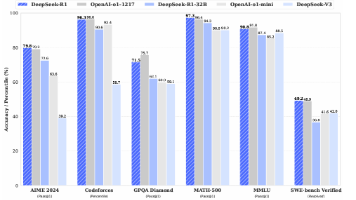

尽管大语言模型已经具备了强大的语言生成能力,但它们在推理(reasoning)任务上仍有明显不足。预训练数据中缺乏结构化推理的明确信号,导致模型难以习得连贯、逻辑严谨的思维链条。为此,DeepSeek 团队提出了新的范式:DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning。该工作以 D

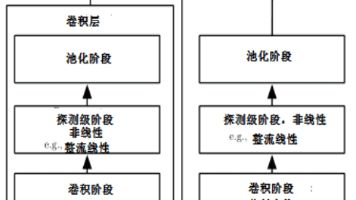

卷积神经网络(Convolutional Neural Network, CNN)是深度学习中最具代表性和影响力的模型之一。它通过局部感受野、权值共享和多层卷积的方式,高效地提取数据的层次化特征,特别适合处理图像、语音以及具有空间结构的数据。CNN 的提出与成功,使得计算机视觉领域从传统的手工特征提取,迈入了端到端的特征自动学习阶段。

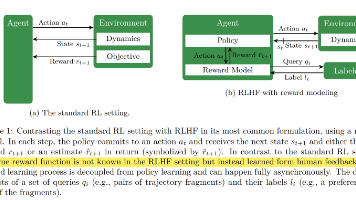

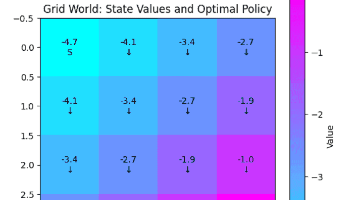

强化学习是一种通过与环境交互学习最优决策策略的机器学习方法,其核心是马尔可夫决策过程(MDP)框架。MDP由状态空间、动作空间、状态转移概率和奖励函数组成,通过动态规划方法如值迭代求解最优策略。本文以网格世界为例,演示了如何使用值迭代算法计算状态价值函数并导出最优策略,展示了强化学习在序列决策问题中的应用价值。该框架为机器人控制、游戏AI等实际问题提供了理论基础和解决方案。

随着大语言模型(LLM)规模和能力飞跃,单纯依赖预训练和监督微调难以让模型完全符合人类期望。RLHF 通过结合人类反馈和强化学习,显著提升模型的对齐性和输出质量,成为当前 AI 安全和性能优化的重要手段。