简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

自然语言处理入门

自然语言处理入门一 如何获取资源?1.ACL学会网站 ACL学会网站建立了称作ACL Anthology的页面(URL:ACL Anthology),支持NLP(自然语言处理)/CL(计算机语言学)领域绝大部分国际学术会议论文的免费下载,甚至包含了其他组织主办的学术会议,例如COLING、IJCNLP等,并支持基于Google的全文检索功能。2.ACL 选集使用什么软件? ACL 选集使用完全

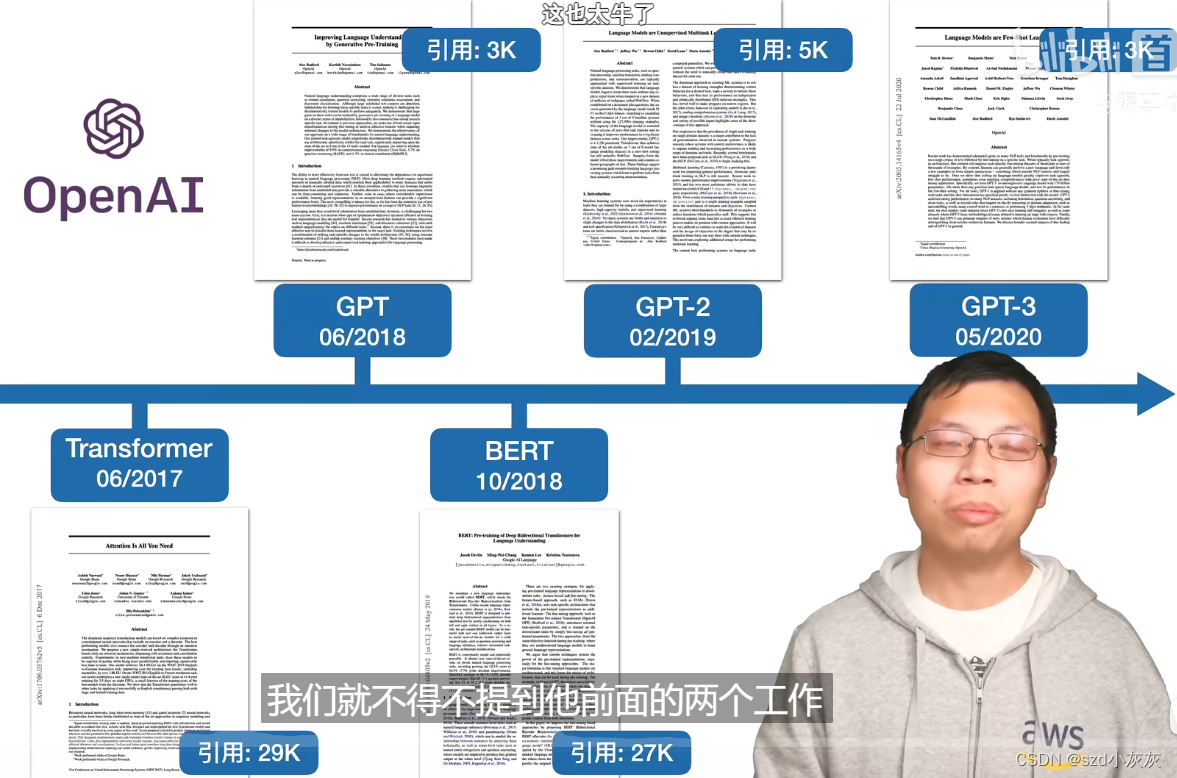

【论文笔记】——从transformer、bert、GPT-1、2、3到ChatGPT

本文介绍了GPT-2模型,与GPT相比,GPT-2模型更大,有12到48层,最大的48层包含1542M的参数量。GPT-2主要测试是zero-shot setting下完成的,它具备强大的语言理解能力,同时也具备了一定的生成能力,测试的一些生成任务如摘要,翻译等已经超过了一些简单的baseline。在一个新数据集WebText上训练,是百万级别的;提出GPT-2,参数量1.5B,15亿;提到zer

到底了