简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

模型训练750个epoch接近收敛,而后震荡收敛,整体效果并不是很好。a、仅使用sar数据,可能会限制算法的能力上线。loss = -微分对象=-Q*log概率。② 编码核心目标函数 及其 loss函数。文章中2.2 策略梯度算法。b、无偏,但是方差比较大。② 思考算法的优缺点。

基于cartPole环境,实验效果,并于比较。PPO通俗理解:不见兔子不撒鹰,兔子代表优势,优势>0就提高动作概率,否则降低动作概率。相较而言,策略梯度未建模优势,朴素AC算法倒是建模了优势,两者区别是:① 朴素AC缺乏Trust-region 保护② 朴素AC的核心是log动作概率;PPO的核心是两个策略的动作比值。似乎PPO更直接粗暴。

定义:是智能体在与环境交互中来实现目标的一种算法,这里的强化是强化智能体的策略 — 让策略更倾向于选择高价值动作最终实现累积奖励期望的最大化。基本过程:智能体agent看到状态St,采取动作At施加到环境中,得到奖励rt,同时环境转移为St+1,简称sars。关键要素:感知、决策、奖励。

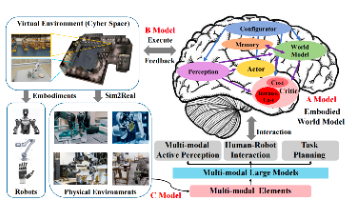

pybullet 是用 Python 免费调用 Bullet 物理引擎的库,用来做机器人、游戏、影视、AI 的刚体/碰撞/动力学仿真。Bullet 的 C++ 内核用 CPython 接口封装,让 Python 用户也能调用工业级物理仿真功能,而不用自己写 C++。pybullet ≈ “Python 版的 Bullet 物理引擎”。类似于强化学习的gym,是更强大的环境,可以用于训练机器人。),

pybullet 是用 Python 免费调用 Bullet 物理引擎的库,用来做机器人、游戏、影视、AI 的刚体/碰撞/动力学仿真。Bullet 的 C++ 内核用 CPython 接口封装,让 Python 用户也能调用工业级物理仿真功能,而不用自己写 C++。pybullet ≈ “Python 版的 Bullet 物理引擎”。类似于强化学习的gym,是更强大的环境,可以用于训练机器人。),

核心关注概率比例优势函数。① 概率比例很简单:就是每个token位置模型的输出概率。② 优势函数从理论上讲,优势函数 A(s,a) 的定义非常简单:Q(s,a):在状态 s 下采取动作 a 的预期长期收益。V(s):在状态 s 下采取平均动作的预期长期收益(由 Critic 模型估计)。

AI 先把任务抽象成一个已知的“经典算法(如:深度优先搜索、动态规划)”,然后一步步模拟这个算法的执行过程。传统的 AI 是一条路走到黑(线性思考),而树搜索让 AI 在遇到困难决策时,像下围棋一样,在脑子里把各种可能性都“推演”一遍。想计划的只管想,干活的只管干,这样哪怕搜网页搜错了,也不会把 AI 的逻辑带坑里去。用成千上万个“有计划、有逻辑”的数据集去喂它,或者让它在环境里试错(RL),做对

EM算法