简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

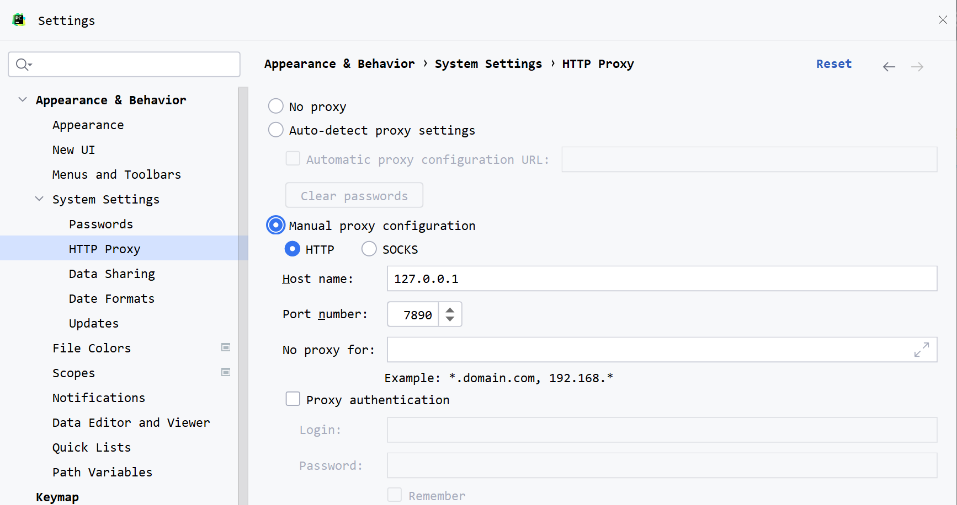

不知道为啥,之前PyCharm的Copilot用的好好的,但是我非要手欠给卸载了,结果在插件市场怎么安装都安装不上了,直接点 install 没有反应,然后在 JetBrains 上将插件下载到本地,然后从本地安装,也一直报错:Connect timed out。PyCharm打开Settings,Appearance - System Settings - HTTP Proxy,选择 Manua

Case Study:AlexNetCase Study:VGGNet

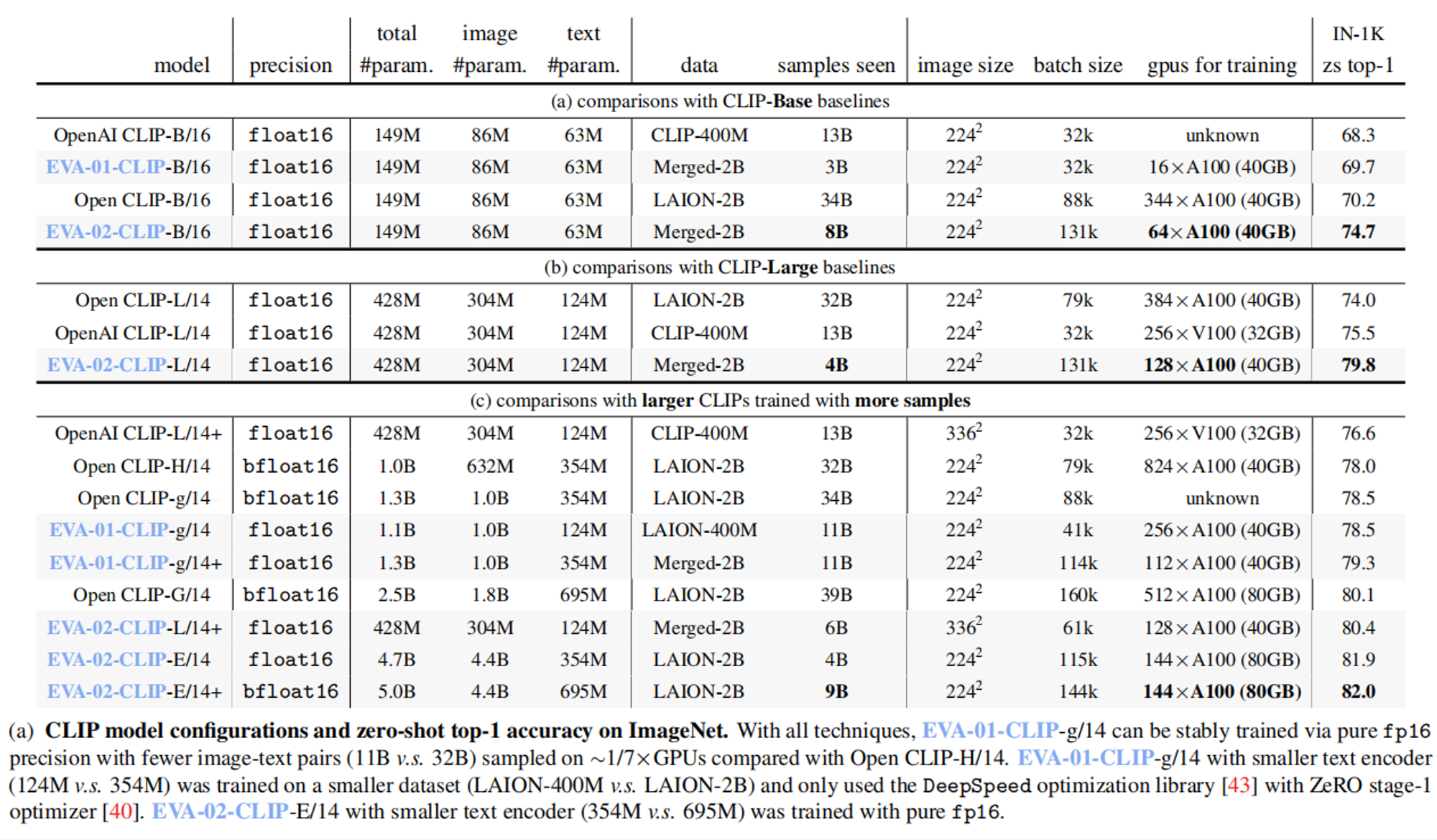

Summary: 作者使用了一系列方法来提升CLIP的训练效率和效果,包括新的表示学习方法、更换优化器和数据增强技术,使得EVA-CLIP相比于具有相同参数量的模型徐连成本更小,性能更优。

一个最大距离2km的局域网,当带宽等于多大时,传播时延(传播速率为2*108m/s)等于100B分组的发送时延?对于512B分组结果又当如何?发送时延(传输时延):节点将分组的所有比特传输链路所需的时间,即从发送分组的第一个比特算起,到改分组的最后一个比特发送完毕所需的时间。—————————————————————————————————传播时延:电磁波在信道中传播一定的距离需要花费的时间,即一

背景:需要做XGB模型增量训练,但是因为一些原因没有得到原来的XGB模型,只有dump文件。XGB模型的dump文件是它的树结构存储为一个相对人类好理解的模型文件,但并不能被重新加载进XGB进行增量训练。嗯,说是那么说,我寻思试一下,看看最新版的XGB有没有增加这个功能,只载入dump文件就可以进行XGB增量训练。一开始加载数据啥的都没问题,但是在训练的时候报错:terminate called

传统神经网络与递归神经网络对比传统神经网络递归神经网络等价于RNN网络细节xt表示第t=1,2,3…step的inputst为隐藏层的第t step的state,它是网络的记忆单元st=f(Uxt+Wst-1),其中f一般是非线性的激活函数ot是第t step的output,如下个单词的向量表示softmax(Vst)RNN的反向传播RNN升级LSTMC:控制参数...

我有两个GPT2的模型,只有1亿参数,并以16位浮点数存储,也就是250MB左右,有35亿参数,同样以16位浮点数存储,也就是7GB左右。我以为推理的时候加载模型到显存中后占用的空间应该也是差不多的大小,但是1亿参数的模型加载到TorchServe中后却占用了957MB,不知道为什么多出来700多MB。

文章目录????声明0、写在前面1、计算机2、机器学习3、深度学习4、Python5、C/C++6、总结????声明本文给出详细的链接,全是干...

欢迎使用Python编程教程学习Carla自动驾驶/自动驾驶汽车的第三部分。在本教程中,我们将利用我们关于Carla API的知识,并尝试将这个问题转化为一个强化学习问题。在OpenAI率先开发了强化学习环境和解决方案的开源之后,我们终于有了一种接近强化学习环境的标准化方法。这里的想法是,你的环境将有一个step方法,它将返回:observation, reward, done, extra_in

欢迎来到自动驾驶汽车的第五部分,并与Carla、Python和TensorFlow加强学习。现在我们已经有了环境和代理,我们只需要添加更多的逻辑将它们连接在一起,这是我们接下来要做的。首先,我们将从强化学习教程中复制粘贴修改后的张量板类:from keras.callbacks import TensorBoard...# Own Tensorboard classclass ModifiedTe