简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

提出基于不确定性的自适应推理框架了AdaNav,通过引入不确定性自适应推理块(UAR Block)和启发式到强化学习(Heuristic-to-RL)的训练机制,使智能体能够在导航过程中根据需要动态地触发推理,解决了固定步长推理导致的性能次优和计算开销问题。

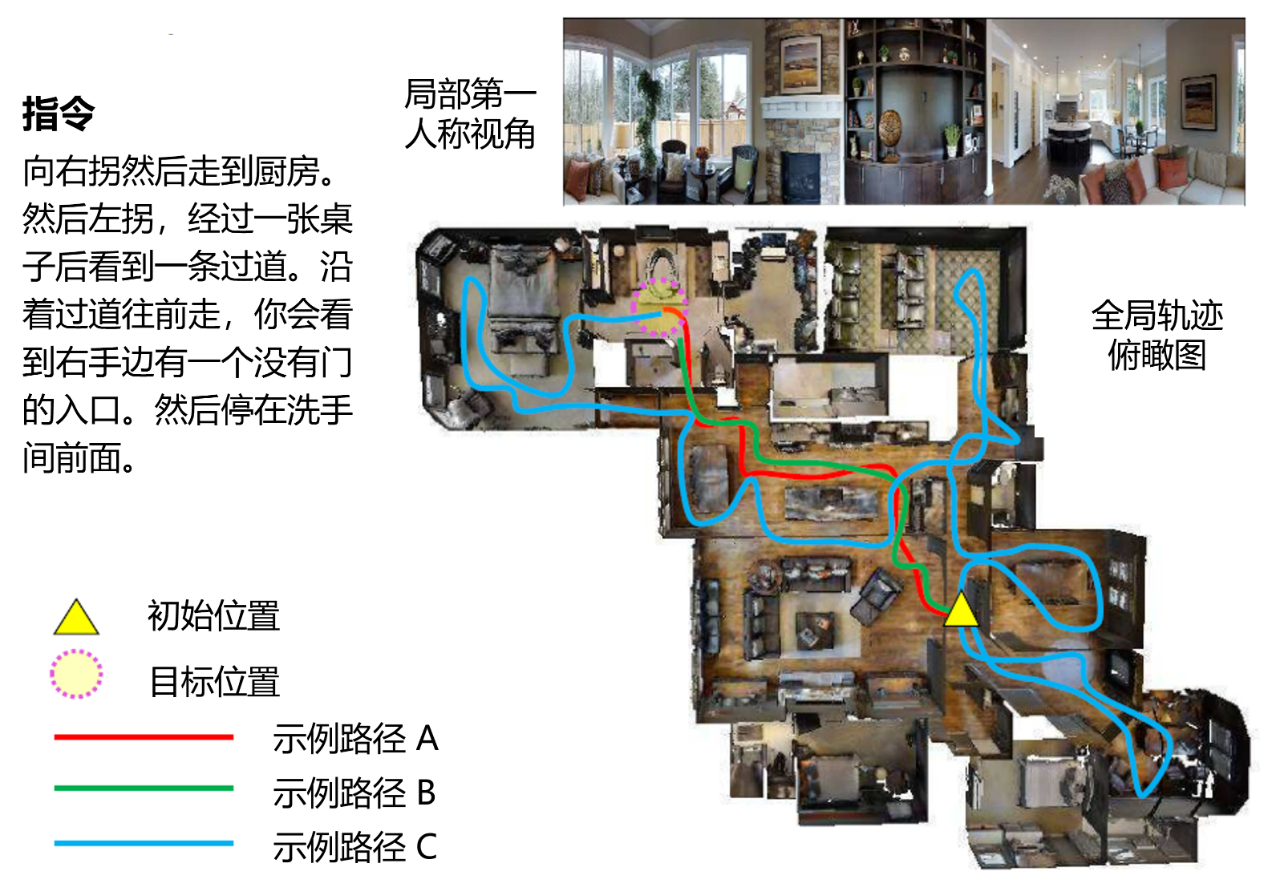

提出新的导航范式,从传统的路径模仿转变为决策理解,旨在培养能够真正理解导航决策的智能体,而不仅仅是模仿专家路径。

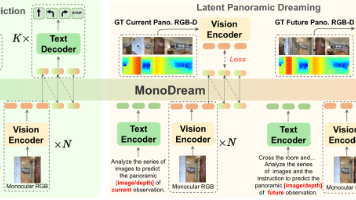

论文提出轻量级单目VLN框架MonoDream,通过引入统一导航表示(UNR)和潜在全景想象(LPD)任务,使单目智能体能够从有限的单目输入中内化全局场景、深度和未来信息。

论文提出了InfiniteWorld,一个基于NVIDIA Isaac Sim的统一且可扩展的模拟器,用于通用视觉-语言机器人交互。InfiniteWorld提供了丰富的3D资产构建接口,支持场景和对象资产的无限扩展,并建立了全面的机器人交互基准,以综合评估具身智能体在感知、规划、执行和交互方面的能力。

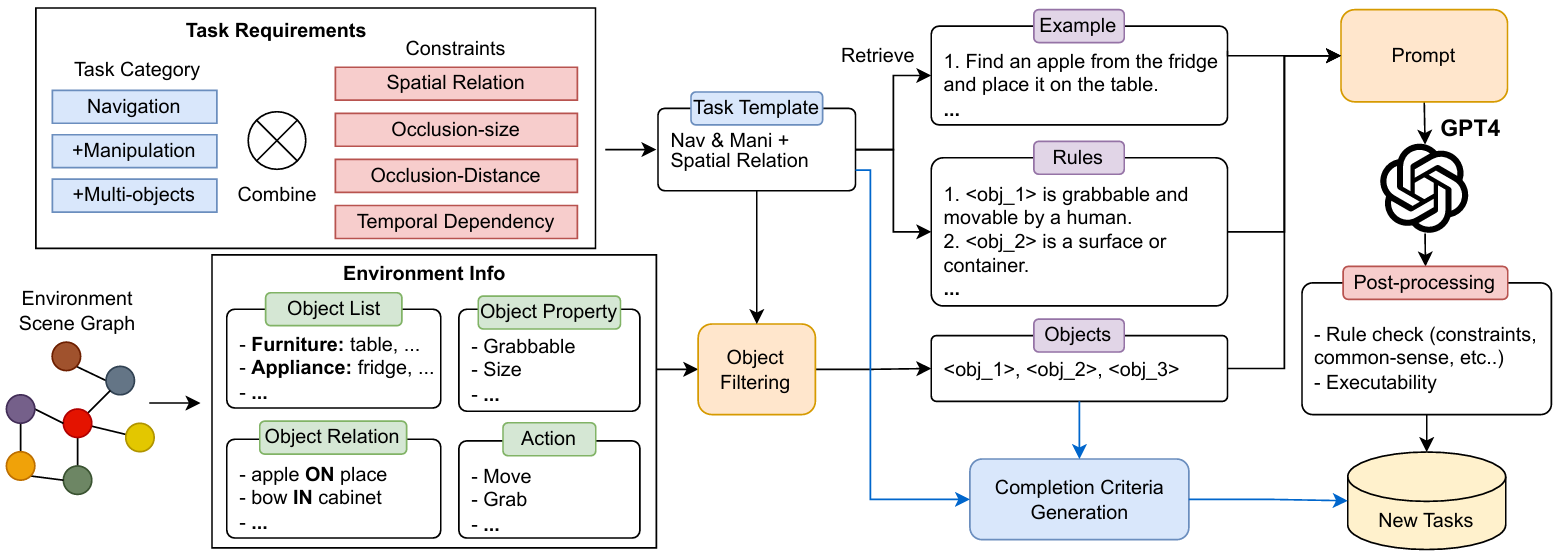

论文提出了一个新的具身任务规划基准ET-Plan-Bench,并展示了现有基础模型在具身任务规划中的挑战和潜力。通过引入空间和时间约束,显著增加了任务的难度,发现SOTA的LLMs在处理这些复杂任务时表现不佳。通过监督微调,较小的模型也可以达到与SOTA模型相当的水平。该基准为未来的具身任务规划研究提供了一个大规模、自动化、细粒度的诊断框架。

视觉语言导航(Vision-Language Navigation, VLN)是一个多学科交叉的研究领域,它涉及到自然语言处理、计算机视觉和机器人导航等多个方面。在这个领域中,研究人员致力于开发能够理解自然语言指令并在复杂环境中进行自主导航的机器人或智能体。

论文总结了具身智能的发展,特别是具身人工智能(EAI)的研究。提出了统一的具身智能框架,强调了形态学、动作、感知和学习之间的协同作用。未来的研究可以从这些组件的内在联系中受益。

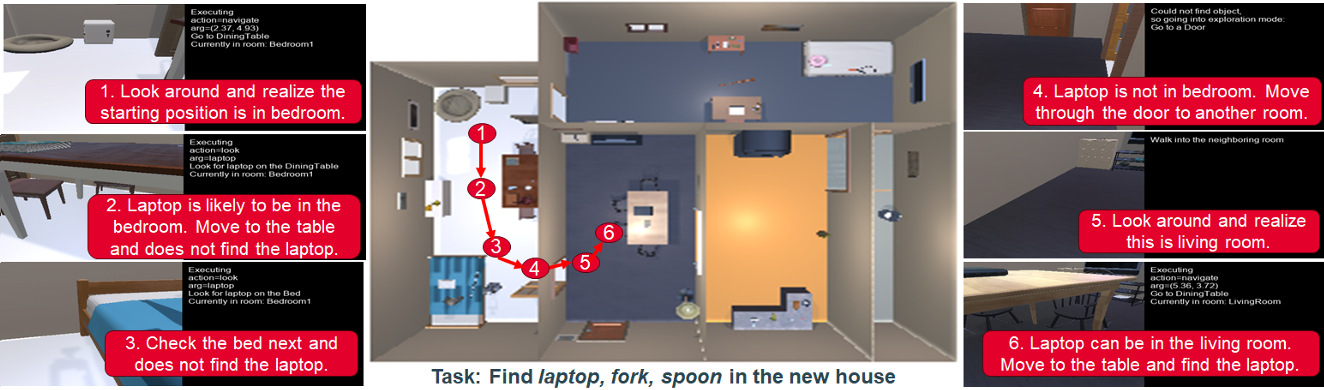

论文提出了SayNav,通过增量构建和扩展3D场景图,并利用LLMs生成动态且上下文适当的高层计划,实现了在大规模未知环境中的复杂导航任务。实验结果表明,SayNav在成功率上优于基于真实信息的基线方法,展示了其在未知环境中的强大导航能力。

论文通过引入障碍物到VLN环境中,解决了指令与现实匹配问题。提出的R2R-UNO数据集和ObVLN方法有效地提高了智能体在障碍环境中的导航能力。研究表明,解决完美指令假设对于VLN在实际应用中的鲁棒性和适应性至关重要。

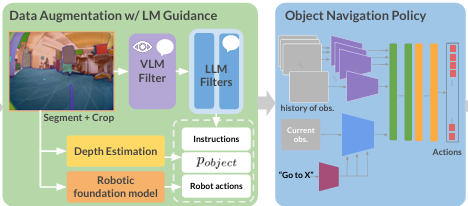

论文提出了 LeLaN,一种利用基础模型从无标签、无动作的第一视角数据中学习可扩展的语言条件对象导航的方法。实验结果表明,LeLaN 在复杂语言指令、动态目标物体和障碍物避让方面表现出色,且在不同机器人类型和摄像头类型下具有良好的泛化能力。