简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

由于语义抓取数据集有限,现有模型难以在不同物体间泛化。foundation model提供了一种解决方式,但抽象的模型知识与物理世界指令执行间仍存在gap。本文旨在提出一个通用的、无需依赖大规模机器人专属数据进行额外训练的统一框架——OmniDexGrasp,以实现机器人跨提示指令(User Prompt)、跨形态(Embodiment)、跨场景和跨任务的全能(Omni-capabilities)

一般的介绍通过安装VcXsrv提供XServer。如果经常使用远程终端,并且安装了MobaXTerm,这个软件就已经附带了XServer,可以运行MobaXTerm后,在wsl中export DISPLAY=:0.0完成设置。

文章将grasp分类为Power Grasp和Precision Grasp,指出灵巧手很好的适配power grasp,但在precision grasp上应用夹爪多于灵巧手。并设计了一个可在power grasp与precision grasp两者间切换的系统。文章的主要贡献点是针对灵巧手精确抓取的姿态优化方法和手部指尖几何优化方法,分别用于构建演示数据、遥操控制,和构建指尖装配件。

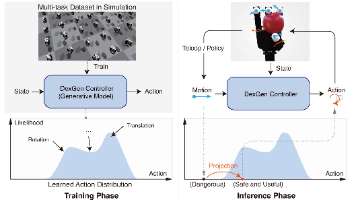

摘要里呈现的insight是,目前灵巧手有人类遥操作和RL sim2real两个主要路径,但人类难以直接遥操得到有效且安全的机器人动作,rl在sim2real的domain gap上以及复杂任务的reward engineering上问题显著。rl擅长学习底层的动作原语,人类遥操能为复杂任务和长程任务提供高层的粗糙动作指令。本文的出发点就是结合这两个方法的优点。思路是用rl训练简单任务的策略得到原

本文提出SPIDER框架,通过物理仿真将人类动作数据转换为机器人动力学可行的动作。该框架基于优化控制方法,结合模拟退火算法和虚拟接触引导,解决人体与机器人在形态和动力学上的差异问题。方法支持人形机器人和灵巧手的动作转换,并引入轨迹鲁棒化和数据增强技术提高泛化性。实验在多个数据集验证了方法的有效性,实现了高质量的动作重定向。该工作为利用丰富的人类动作数据训练机器人提供了一种通用解决方案。

文章将grasp分类为Power Grasp和Precision Grasp,指出灵巧手很好的适配power grasp,但在precision grasp上应用夹爪多于灵巧手。并设计了一个可在power grasp与precision grasp两者间切换的系统。文章的主要贡献点是针对灵巧手精确抓取的姿态优化方法和手部指尖几何优化方法,分别用于构建演示数据、遥操控制,和构建指尖装配件。