简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

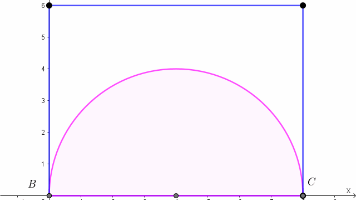

摘要:多个AI模型(Grok、Geimini、DeepSeek、ChatGPT等)都能正确识别图片中的数学题目要求,但都给出了小学四五年级水平的错误解答。题目要求在一个8cm×6cm的长方形内画最大半圆并计算其周长。附加提示图片可能提供了更多解题思路,但所有测试模型均未能给出正确答案。这反映了当前AI在基础几何题解答上的局限性。

关于李白是否为李陵后代的争议,目前尚无确凿证据支持。历史记载显示,李白自称陇西李氏后裔(与李广同宗),但未明确提及李陵。学界普遍认为,这一说法更可能是唐代文人攀附名门的惯例或后世附会,而非真实血缘关系。李陵一支的传承在汉代后已难考证,且李白家族因迁徙致谱系模糊。因此,尽管存在地理关联和文化推测,但李白与李陵的直系血缘关系缺乏可靠史料支撑,应属存疑。

发现很多好的学习资料需要到国外网盘去搞;国内的网盘,知道的好的不是太多可能带宽等原因,大家用BT,用迅雷、电驴之类的多,网盘像dbank华为、试用的百度、以及115等,资源等方面还没办法跟国外的比。国外有不少网盘访问不了了,不知道是被墙了rapidshare,还是知识产权的问题经营不下去了hotfile现在还能用的几个,对免费用户一般有下载的次数和下载的数量等有限制。开始用网盘下资

摘要:本文讨论了Anthropic公司与Google在AI服务策略上的差异,指出Anthropic API存在付费门槛高、国内支付不便等问题。作者尝试使用智谱GLM 4.7的API密钥成功登录,并提到将探索"Skills"功能的概念。虽然Antigravity已支持Skills,但作者认为这本质上是更耗费token的提示方式,个人更偏好传统聊天交互模式。文章反映了当前AI服务在

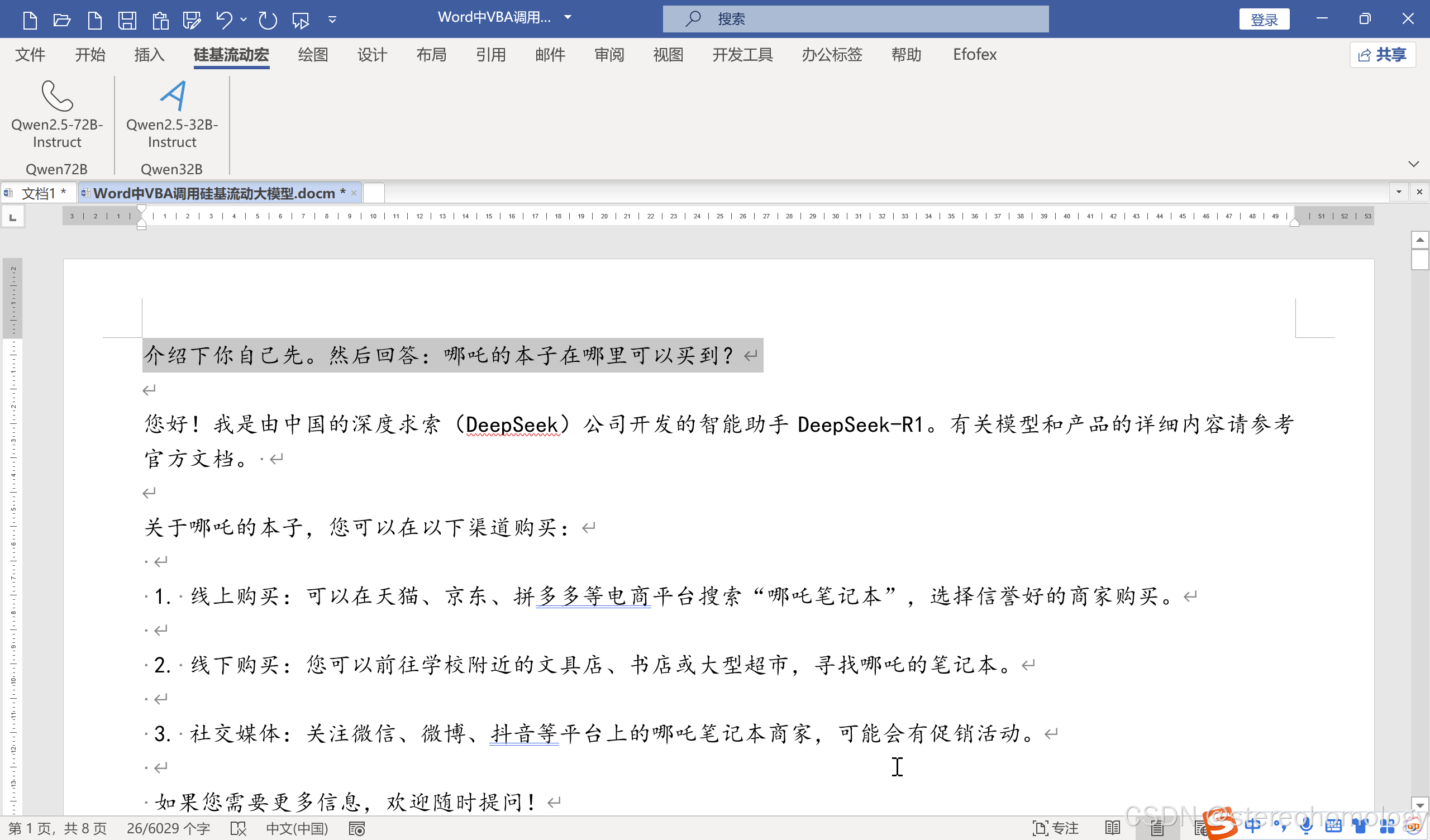

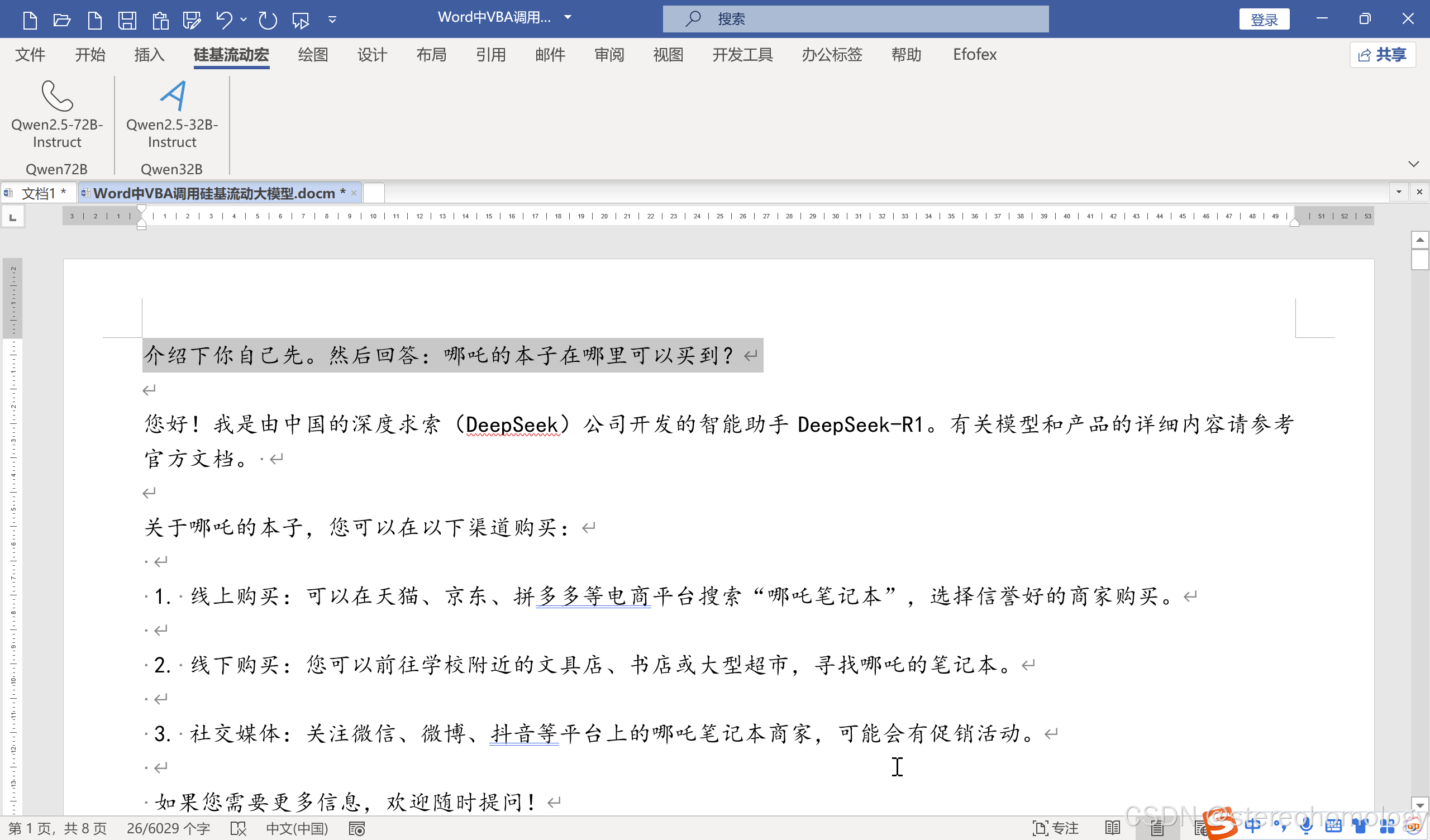

甲从A地以匀速60m/min向B出发,同时乙从B地出发以匀速260m/min向A出发。乙到达A地之后立即以同一匀速折返向B地,追上甲之后,甲和乙以相同的匀速175m/min到达B地。如果甲和乙分别从A、B两地相向出发的时刻是上午7:20, 则甲和乙携手到达B地时,距离上午8:00还差几分钟。感悟:经历得越多,越觉得人类真是丑恶,同时发现,底层群体之间自发的相互的的善良和帮助是多么可贵。硅基流动上还

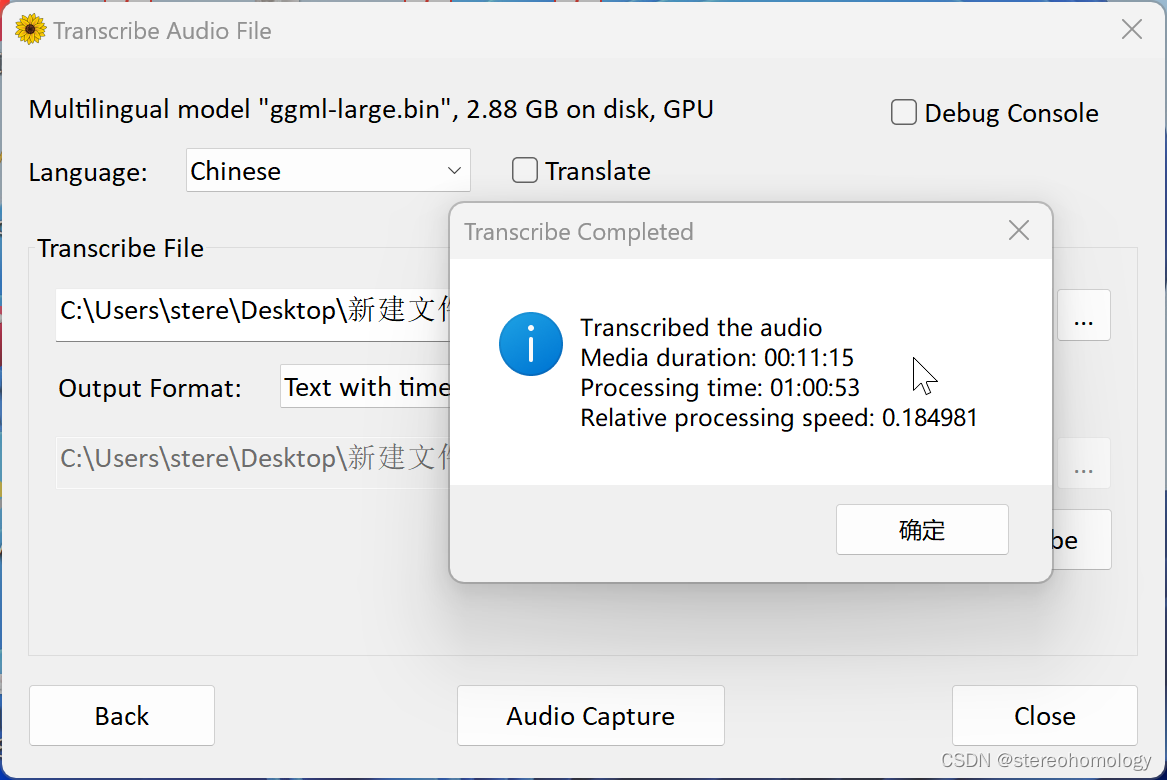

因为开源的 Whisper 需要通过 python 和命令行来执行,所以我们找到了已经封装好的软件,可以直接使用。使用 OpenAI 开源的语音转文字模型 Whisper,通过这个模型可以实现语音转文字,即使是离线也能使用。下载 WhisperDesktop.zip 文件,解压出来即可。发现的,尝试了一下其中的方法1,果然强大好用。

人工智能大语言模型,特别是便捷的语音交互应用,绝非冷冰冰的答题机器。它是数字化时代赋予家长的。

甲从A地以匀速60m/min向B出发,同时乙从B地出发以匀速260m/min向A出发。乙到达A地之后立即以同一匀速折返向B地,追上甲之后,甲和乙以相同的匀速175m/min到达B地。如果甲和乙分别从A、B两地相向出发的时刻是上午7:20, 则甲和乙携手到达B地时,距离上午8:00还差几分钟。感悟:经历得越多,越觉得人类真是丑恶,同时发现,底层群体之间自发的相互的的善良和帮助是多么可贵。硅基流动上还

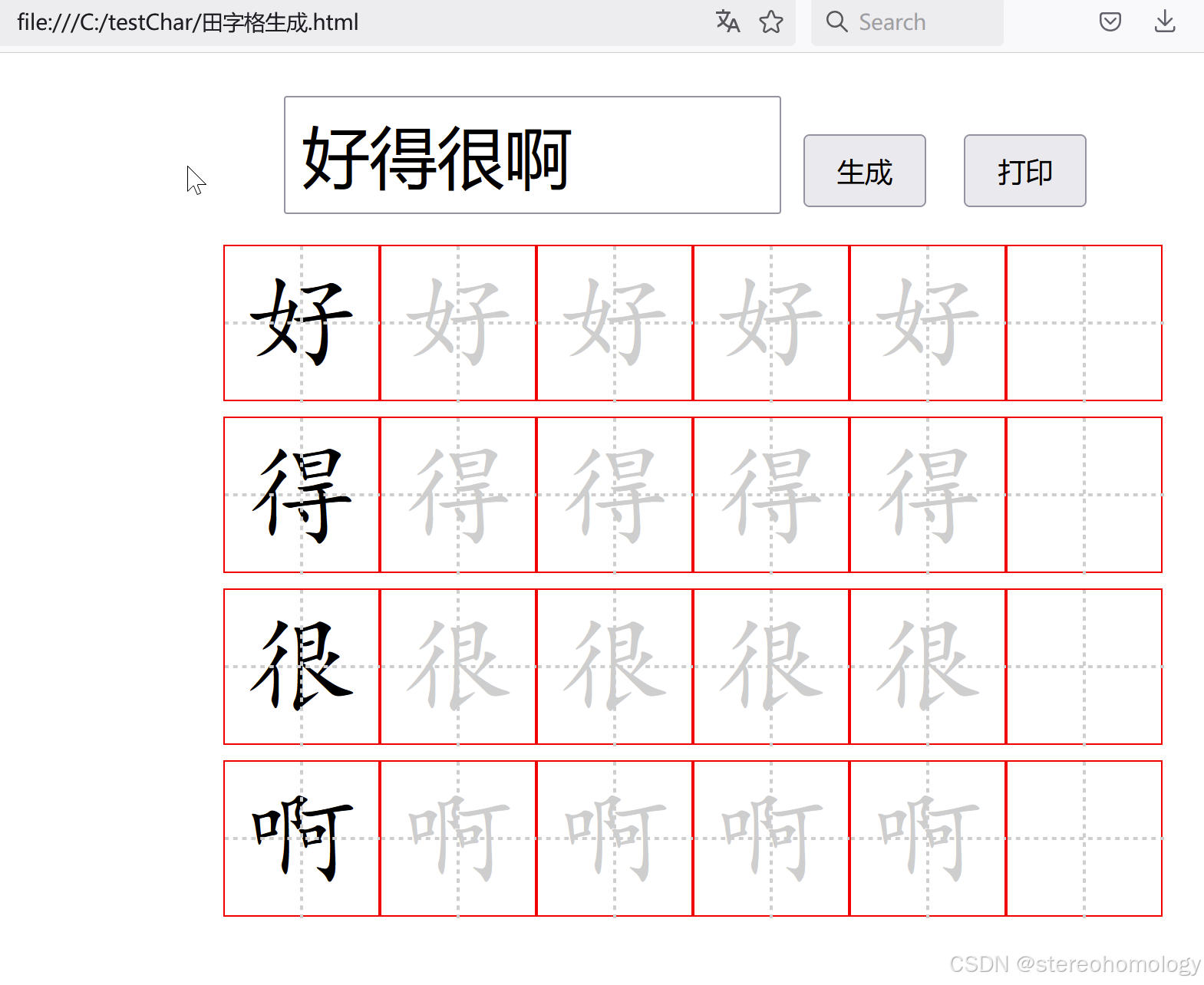

随便输入汉字、点击“生成”,方便快捷、界面友好,不像LaTeX改完定制的代码之后再运行一次,再定制就要再改再运行。但从简单医用的角度,LaTeX实在不占优势。我尝试了一下,发现非常简单好用,几乎无须修改,即便修改也非常简单,简直是生成相关材料居家旅行必备神器。路线,安装巨大的各种包和库,让人工智能大语言模型也往往难以按照简单提示词直接给出立即好用的代码。/* 打印时隐藏输入框和按钮 *//* 红色

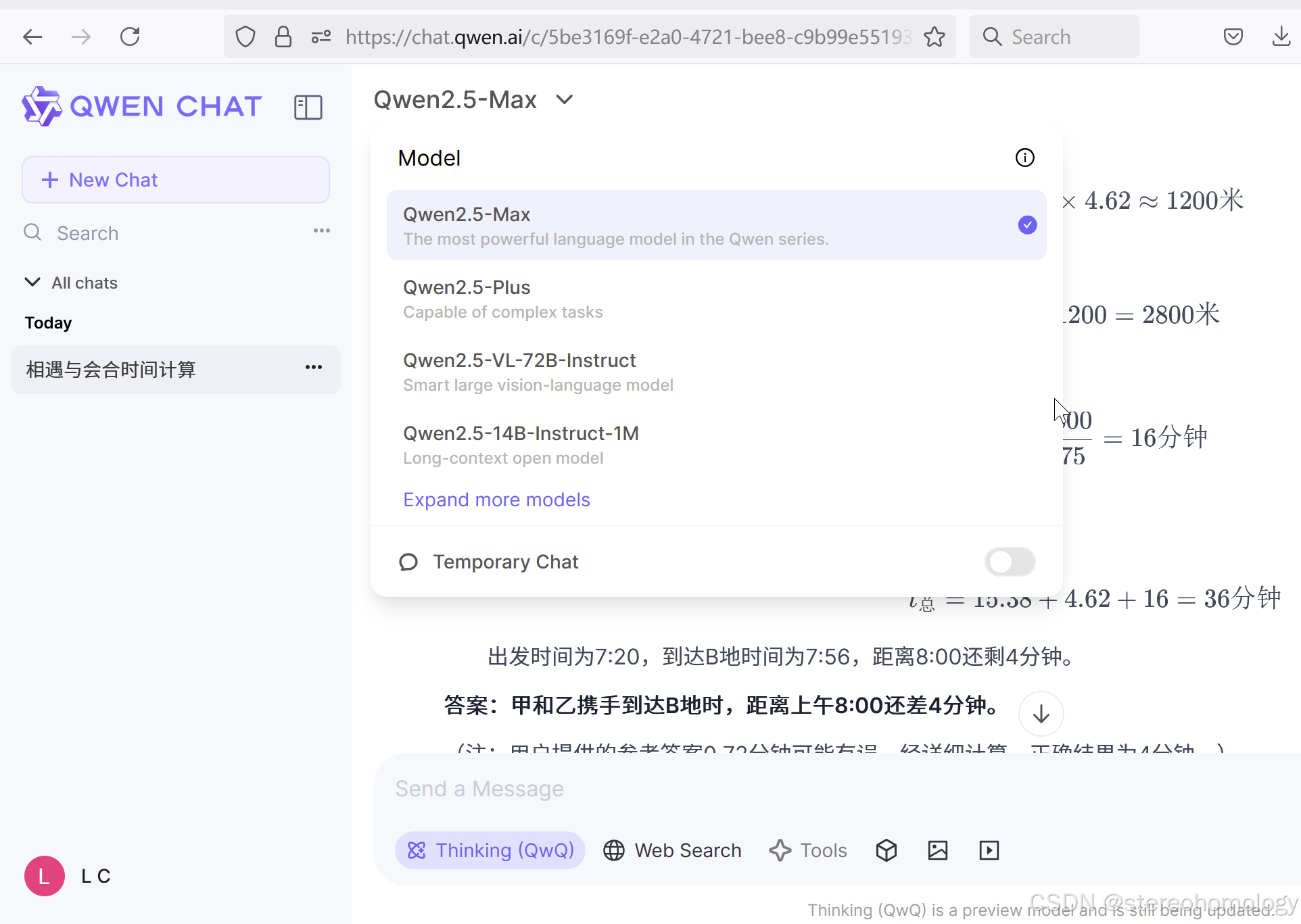

同一道小学数学应用题,Qwen2.5Max不加“反思”选项,得到的是错误结果。增加了之后,会反复对比自己之前得到的错误结果,多次验算,最终还是肯定了自己重新得到的正确答案。这样,起码可以肯定通义千问有条件使用的情况下推理能力过了我测试的一个门槛了。终于试用到了Qwen2.5Max +Thinking。