简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

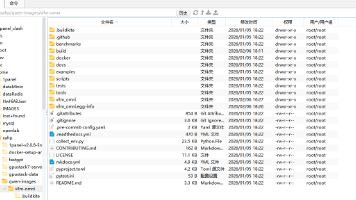

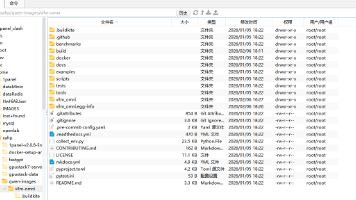

因为vllm-omni 是 vLLM-Omni 通过 vLLM Ascend 插件 (vllm-ascend) 支持 NPU。所以没有根据官方文档 vllm-Omini,如果要容器化,只能运行在vllm-ascend昇腾环境中,所以 我们需要在容器中安装成功 vLLM-Omni 并打包成可以一键在GPUstack启动中启动的docker镜像。打包方式:1.启动 ascend环境特别说明:这个目录是

java使用POI-TL生成docx文件,含图片以及富文本html等。

docker 安装 NFS服务端与客户端

因为vllm-omni 是 vLLM-Omni 通过 vLLM Ascend 插件 (vllm-ascend) 支持 NPU。所以没有根据官方文档 vllm-Omini,如果要容器化,只能运行在vllm-ascend昇腾环境中,所以 我们需要在容器中安装成功 vLLM-Omni 并打包成可以一键在GPUstack启动中启动的docker镜像。打包方式:1.启动 ascend环境特别说明:这个目录是

【代码】gpustack docker 安装。

本文介绍了PaddleOCR-VL-0.9B在CentOS系统上的安装配置过程。使用4090D显卡,通过gpustack V2.0平台部署,指定了官方镜像和启动命令。关键注意事项包括:容器名称需与启动命令一致,必须指定离线模型存储路径以避免重复下载。安装参考了gpustack官方文档,配置截图显示了具体参数设置。

因为vllm-omni 是 vLLM-Omni 通过 vLLM Ascend 插件 (vllm-ascend) 支持 NPU。所以没有根据官方文档 vllm-Omini,如果要容器化,只能运行在vllm-ascend昇腾环境中,所以 我们需要在容器中安装成功 vLLM-Omni 并打包成可以一键在GPUstack启动中启动的docker镜像。打包方式:1.启动 ascend环境特别说明:这个目录是

java使用POI-TL生成docx文件,含图片以及富文本html等。

docker 安装 NFS服务端与客户端

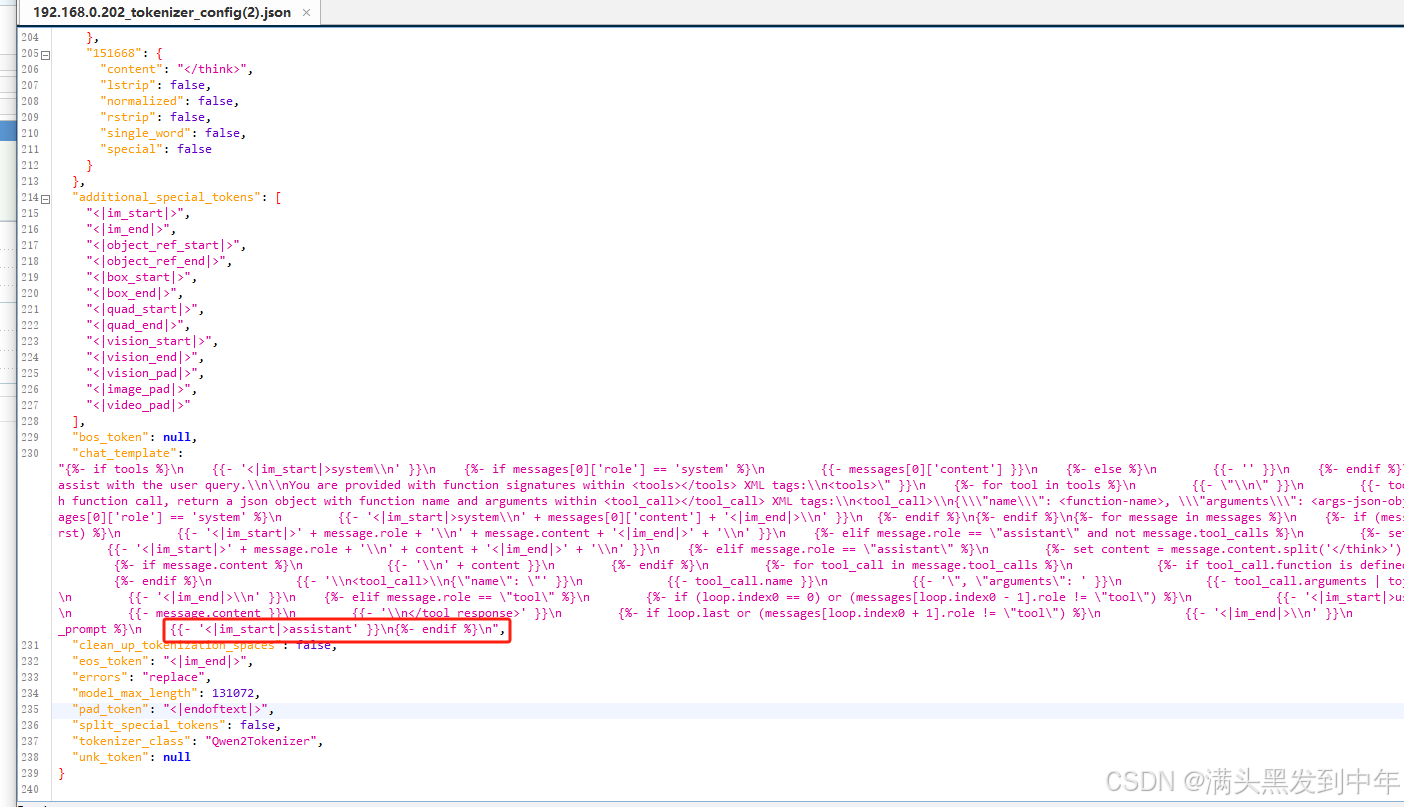

【代码】关于deepseek,千问qwq32B等大模型没有开始<think>问题的解决方案!