简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在语言模型计算概率的时候,我们会碰到概率为0的情况,即计算的单词在语言模型中并没有出现过。这个时候会使用平滑的方法计算概率,一般分为以下几种:Add-One SmoothingAdd-K Smoothing其中Add-One Smoothing可以看作Add-K Smoothing中K为1的变种。概率计算即为(C+k)/(N+kV)其中C为需要计算的情形出现的次数,N为语料库中所有情形的次数,V为

我们在做逻辑回归或是其他线性模型的时候,经常会遇到一个模型衡量指标叫做,网上很多一个普遍的解释是:表达了2个变量间关系的解释程度百分比程度 / 你的你和曲线对于模型variance的减少百分比。那么到底是什么呢,首先计算样本的总平方和TSS(Total Sum of Squares):然后计算残差平方和RSS(Residual Sum of Squares):那么越大,拟合效果越好。最优值为1。若

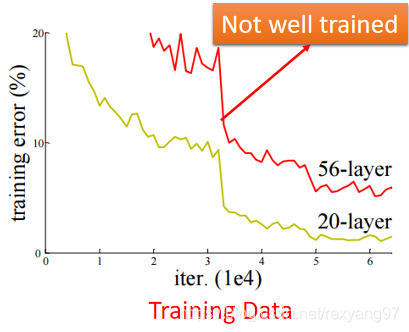

在我们搭建神经网络时,通常的做法是每一层后面都需要添加一个激活函数。它的作用是将一个线性的模型转化为非线性模型。因为现实生活中很多场景需要解决的都是非线性问题。而线性模型是有局限性的。比如一层线性神经网络就无法解决异或问题。Sigmodsigmod:1/(1+e^-x)是最经典的激活函数,一层的神经网络加上sigmod其实就是最传统逻辑回归的做法。它能够把任何数映射到[0,1]之间,十分直观。你可

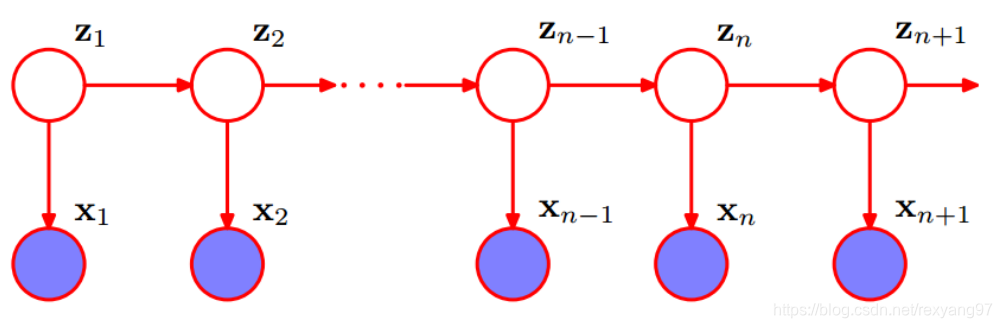

隐马尔科夫模型(HMM, Hidden Markov Model)是一种经典的模型,可用于标注问题,在语音识别、NLP、生物信息、模式识别等领域被实践证明是有效的算法。HMM是关于时序的概率模型,描述由一个隐藏的马尔科夫链生成不可观测的状态随机序列,再由各个状态生成观测随机序列的过程。模型简介我们现在来假设一种情况,一个文明在某个时期有三种状态,黑暗时期,正常时期与黄金时期。在我们接触到文明的时候