简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

这篇博客主要用于记录2026年在人工智能领域顶会顶刊(ICML、NeurIPS、ICLR、CVPR、ECCV、AAAI、IJCAI等)上发表的SNN相关的论文,会附上相关论文的链接及简单介绍,正在更新中…

李宏毅深度学习简介前提假设简单描述结合了激活函数后:使用多个激活函数:前提假设假设机器学习的训练样本是x={x1,x2,…,xn},其中的x1,x2,…,xn分别表示样本的第1个、第二个直到第n个特征。假设学习的函数比较简单,设为y=wx+b,其中w={w1,w2,…,wn},其中的w1,w2,…,wn分别表示对应的样本特征xi所占的权重。其中的b表示bias(偏差),简单描述我们要使用机器学习到

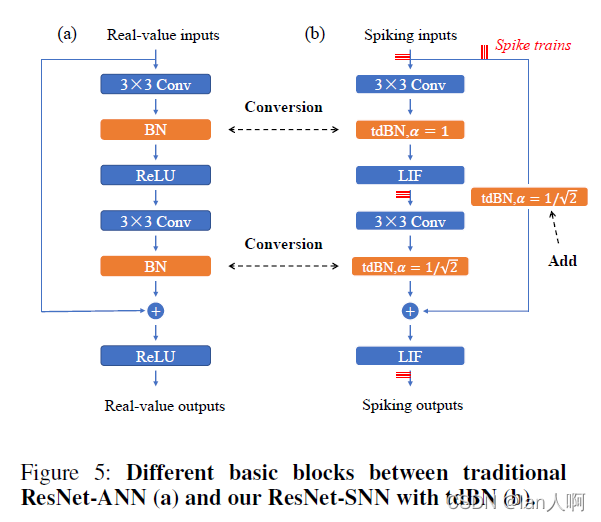

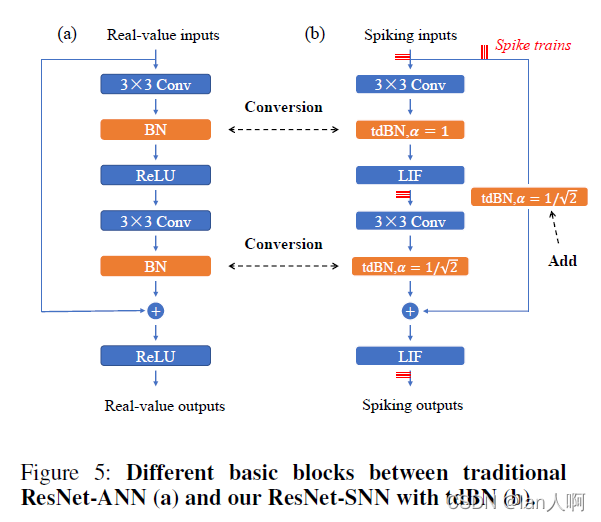

论文提出了一种针对SNN的归一化(regularization)方法,并构建了超过50层的深度脉冲残差网络,在DVS-Gesture数据集上取得了SOTA的结果。

论文提出了STBP算法,构建了迭代的LIF模型能够同时利用空间域和时间域信息对网络进行训练,又介绍了四种近似脉冲活动导数的曲线来进行误差的反向传播。使得不使用任何复杂的训练技巧(如正则化、归一化等)来直接训练SNN就能取得很好的效果。...

李宏毅深度学习简介前提假设简单描述结合了激活函数后:使用多个激活函数:前提假设假设机器学习的训练样本是x={x1,x2,…,xn},其中的x1,x2,…,xn分别表示样本的第1个、第二个直到第n个特征。假设学习的函数比较简单,设为y=wx+b,其中w={w1,w2,…,wn},其中的w1,w2,…,wn分别表示对应的样本特征xi所占的权重。其中的b表示bias(偏差),简单描述我们要使用机器学习到

论文提出了STBP算法,构建了迭代的LIF模型能够同时利用空间域和时间域信息对网络进行训练,又介绍了四种近似脉冲活动导数的曲线来进行误差的反向传播。使得不使用任何复杂的训练技巧(如正则化、归一化等)来直接训练SNN就能取得很好的效果。...

论文提出了一种针对SNN的归一化(regularization)方法,并构建了超过50层的深度脉冲残差网络,在DVS-Gesture数据集上取得了SOTA的结果。

这篇博客主要用于记录2026年在人工智能领域顶会顶刊(ICML、NeurIPS、ICLR、CVPR、ECCV、AAAI、IJCAI等)上发表的SNN相关的论文,会附上相关论文的链接及简单介绍,正在更新中…

2022年顶会、顶刊脉冲神经网络相关优秀论文收集

论文提出了STBP算法,构建了迭代的LIF模型能够同时利用空间域和时间域信息对网络进行训练,又介绍了四种近似脉冲活动导数的曲线来进行误差的反向传播。使得不使用任何复杂的训练技巧(如正则化、归一化等)来直接训练SNN就能取得很好的效果。...