简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文提出UAV-VLA系统,通过结合大语言模型和视觉语言模型,实现基于自然语言指令的无人机航线自动生成。系统包含目标提取、目标搜索和动作生成三个模块,利用卫星图像和地理坐标数据,将文本指令转化为可执行的飞行计划。研究建立了包含30张高分辨率卫星图的评估基准UAV-VLPA-nano-30,实验表明系统生成速度比人工快6.5倍,虽然航线长度平均增加21.6%,但大幅提高了任务规划效率。该工作为语言驱

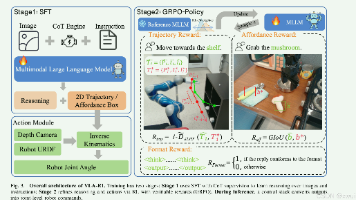

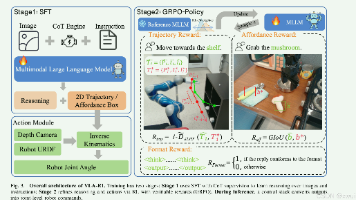

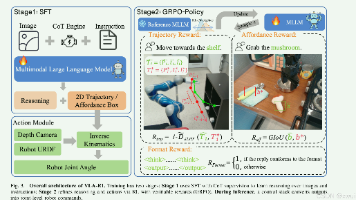

序号1.将大模型的慢思考引入物理具身控制 以前的机器人模型(如RT-2)是“直肠子”,看到画面直接输出动作(端到端),遇到复杂环境(如颜色相近、多个目标)极容易出错。VLA-R1 首创了在具身控制中引入 <think>推理轨迹</think> + <output>7D物理动作</output> 的结构化输出格式。强制机器人“谋定而后动”,先在赛博大脑里用自然语言进行空间消歧和逻辑推演,再将意图降维

序号1.将大模型的慢思考引入物理具身控制 以前的机器人模型(如RT-2)是“直肠子”,看到画面直接输出动作(端到端),遇到复杂环境(如颜色相近、多个目标)极容易出错。VLA-R1 首创了在具身控制中引入 <think>推理轨迹</think> + <output>7D物理动作</output> 的结构化输出格式。强制机器人“谋定而后动”,先在赛博大脑里用自然语言进行空间消歧和逻辑推演,再将意图降维

序号1.将大模型的慢思考引入物理具身控制 以前的机器人模型(如RT-2)是“直肠子”,看到画面直接输出动作(端到端),遇到复杂环境(如颜色相近、多个目标)极容易出错。VLA-R1 首创了在具身控制中引入 <think>推理轨迹</think> + <output>7D物理动作</output> 的结构化输出格式。强制机器人“谋定而后动”,先在赛博大脑里用自然语言进行空间消歧和逻辑推演,再将意图降维

序号1.将大模型的慢思考引入物理具身控制 以前的机器人模型(如RT-2)是“直肠子”,看到画面直接输出动作(端到端),遇到复杂环境(如颜色相近、多个目标)极容易出错。VLA-R1 首创了在具身控制中引入 <think>推理轨迹</think> + <output>7D物理动作</output> 的结构化输出格式。强制机器人“谋定而后动”,先在赛博大脑里用自然语言进行空间消歧和逻辑推演,再将意图降维

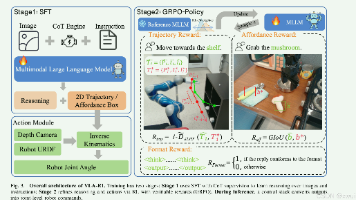

本工作提出了 VLA-AN,这是一个通过结合高保真数据生成、多模态学习、安全感知的动作生成以及高效的机载部署来推进空中机器人自主性的集成框架。利用 3D-GS 方法,我们构建了一个逼真的、以无人机为中心的数据集,缩小了合成观测与现实世界观测之间的域偏差(domain gap)。三阶段训练范式赋予了模型强大的场景理解、时序推理和长视距导航(long-horizon navigation)能力,而轻量

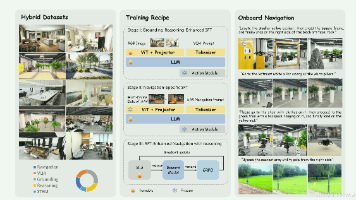

从其他工作都重视的大语言模型,转换思路到动作模型上。利用视觉-语言模型(VLM)来学习语义信息,并采用一个十亿(1 Billion)参数的扩散专家(diffusion expert)来学习鲁棒且可泛化的视觉-运动策略。引入了一种具身课程学习策略(embodied curriculum learning strategy),使网络能够通过三个训练阶段,逐步从与本体无关(embodiment-agno

要实现字符串的拼接,使用占位符是的一种高效、常用的方式。举个例子,下面是不使用占位符的一种写法,直接使用加号拼接字符串age = 24换成占位符,可以写成age = 24其中%s%d便是占位符,顾名思义,其作用就是替后面的变量站住这个位置字符串后面的%是一个特殊的操作符,该操作符会将后面的变量值,替换掉前面字符串中的占位符。对比两种写法,会发现使用占位符可以将字符串中用到变量集中在一起,方便查找和

要实现字符串的拼接,使用占位符是的一种高效、常用的方式。举个例子,下面是不使用占位符的一种写法,直接使用加号拼接字符串age = 24换成占位符,可以写成age = 24其中%s%d便是占位符,顾名思义,其作用就是替后面的变量站住这个位置字符串后面的%是一个特殊的操作符,该操作符会将后面的变量值,替换掉前面字符串中的占位符。对比两种写法,会发现使用占位符可以将字符串中用到变量集中在一起,方便查找和

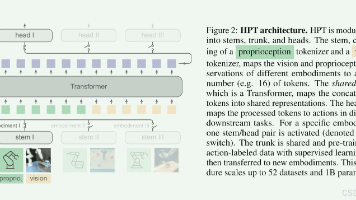

模型还不够大” (Not distinctively large yet):作者承认,虽然 HPT 用了 1B 参数,但在 LLM(大语言模型)动辄 100B+ 的规模面前,这只能算“中等规模”。这也暗示了:机器人领域的数据量(Token 数)相比互联网文本,还是太少了。HPT 使用的是监督学习(也就是行为克隆 BC)。这意味着机器人最好也就是和人类演示者一样好,它无法超越人类(不像 AlphaG