简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Agent for AIDD

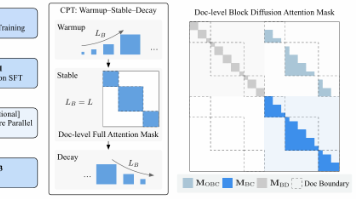

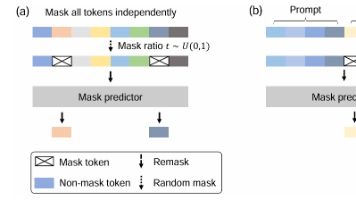

块扩散语言模型

扩散语言模型

目录摘要1.Introduction摘要全局上下文信息(context information)对于遥感图像的语义分割至关重要。然而,现有的大多数方法都依赖于卷积神经网络(CNN),由于卷积运算的局部性(locality),直接获取全局上下文信息充满了挑战性。受具有强大全局建模能力的Swin transformer的启发,我们提出了一种新的 Remote Sensing image 语义分割框架,

本博客为一些简单的个人想法,关于元学习方法(如MAML、Reptile、元梯度优化等)如何启发大规模语言模型(LLM)预训练新范式,以提升基础模型的泛化和适应能力。

本篇内容介绍如何使用多个Visium数据集,以及如何用scRNA-seq数据集进行整合。我们将使用Scanorama来进行整合。首先我们要安装Scanorama:加载相关框架:建议先阅读论文阅读笔记-利用Scanorama高效整合异质单细胞转录组我们将使用两个小鼠大脑的Visium空间转录组数据集,该数据集可从10x genomics website获取。函数从10x genomics下载数据集并

目录背景介绍模型描述模型架构展示计算对象介绍方法DKG通道HF通道双模态融合实验结果背景介绍模型来自文章:“MDNN: A Multimodal Deep Neural Network for Predicting Drug-Drug Interaction Events”,文章提出了一个用于DDI(药物-药物反应,drug-drug interaction)预测的多模态深度神经网络MDNN,即M