简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

下一步,选择解释器(服务器中python.exe),同步文件夹左边为本地项目的名称,右边为服务器项目的名称,为了方便,本地项目名和服务器项目名称最好一致。然后选择SSH解释器,再选择现有服务器配置,下拉选择之前配置的AutoDL服务器。然后,根据AutoDL上的服务器的ssh信息,填写主机、用户名、端口号和密码。2、点配置填写服务器相关信息,包括主机名称、用户名、端口号和密码。接下来就是在本地项目

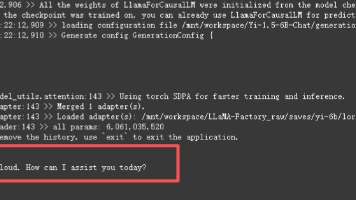

本文详细介绍了使用LLaMA-Factory框架对Yi-1.5-6B-Chat模型进行LoRA微调的全过程。主要包括:1)拉取代码并配置Python虚拟环境;2)通过ModelScope下载模型;3)配置yaml文件设置微调参数;4)执行训练命令完成微调;5)使用对话界面测试微调效果。文章最后预告将介绍如何使用自制数据集进行大模型微调,欢迎对大模型感兴趣的读者一起交流学习。

本文介绍了如何在EasyDataset平台上使用本地部署的大模型制作数据集。首先详细说明了Ollama的安装步骤,包括下载安装程序和模型(如qwen3-vl:4b),并验证API服务是否正常启动。接着指导用户在EasyDataset中配置本地模型,包括设置接口地址、模型名称和API Key(可随意填写)。最后演示了上传PDF文件进行智能分割和问题生成的过程,提示使用本地小模型时速度较慢。作者表示后

摘要:cuda+cudnn+pytorch配置过程

本文介绍了如何在EasyDataset平台上使用本地部署的大模型制作数据集。首先详细说明了Ollama的安装步骤,包括下载安装程序和模型(如qwen3-vl:4b),并验证API服务是否正常启动。接着指导用户在EasyDataset中配置本地模型,包括设置接口地址、模型名称和API Key(可随意填写)。最后演示了上传PDF文件进行智能分割和问题生成的过程,提示使用本地小模型时速度较慢。作者表示后