简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

深度学习笔记之Seq2seq(二)基于Seq2seq注意力机制的动机

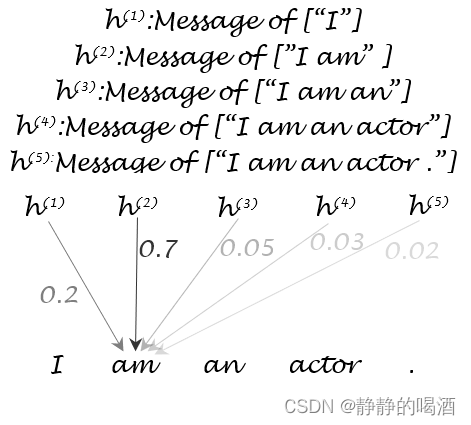

上一节介绍了Seq2seq网络常用的基本结构以及在机器翻译任务中,关于目标函数与预测概率的描述。本节依然以机器翻译任务为例,对Seq2seq中的注意力机制(Attention)进行描述。

机器学习笔记之前馈神经网络(一)基本介绍

从本节开始,将介绍前馈神经网络。

动态规划求解强化学习任务——策略评估[解析解]

上一节我们提到,策略迭代(Policy Iteration)是动态规划(Dynamic Programming,DP)求解强化学习任务的一种方式,共包含两个部分:策略评估,策略改进。本节主要介绍:在策略评估过程中使用解析方式求解最优价值函数。

强化学习之SARSA

目录1. 准备内容1.1 基于动态规划(DP)方法的强化学习介绍动态规划方法(DP)的局限性:1.2 基于蒙特卡洛(MC)方法的强化学习介绍蒙特卡洛(MC)方法的局限性:2. 基于MC的增量更新方式2.1 增量更新和全量更新2.2 基于MC的全量更新方法和增量更新方法2.3 基于MC的增量更新方法的局限性3. 时序差分方法(Temporal Difference,TD)3.1 时序差分和基于MC增

深度学习笔记之BERT(五)TinyBERT

上一节介绍了DistilBERT模型,本节将继续介绍优化性更强的知识蒸馏BERT模型——TinyBERT模型。

深度学习笔记之BERT(四)DistilBERT

本节将介绍一种参数、消耗计算资源少的BERT改进模型——DistilBERT模型。

深度学习笔记之BERT(五)TinyBERT

上一节介绍了DistilBERT模型,本节将继续介绍优化性更强的知识蒸馏BERT模型——TinyBERT模型。

机器学习笔记之优化算法(十一)凸函数铺垫:梯度与方向导数

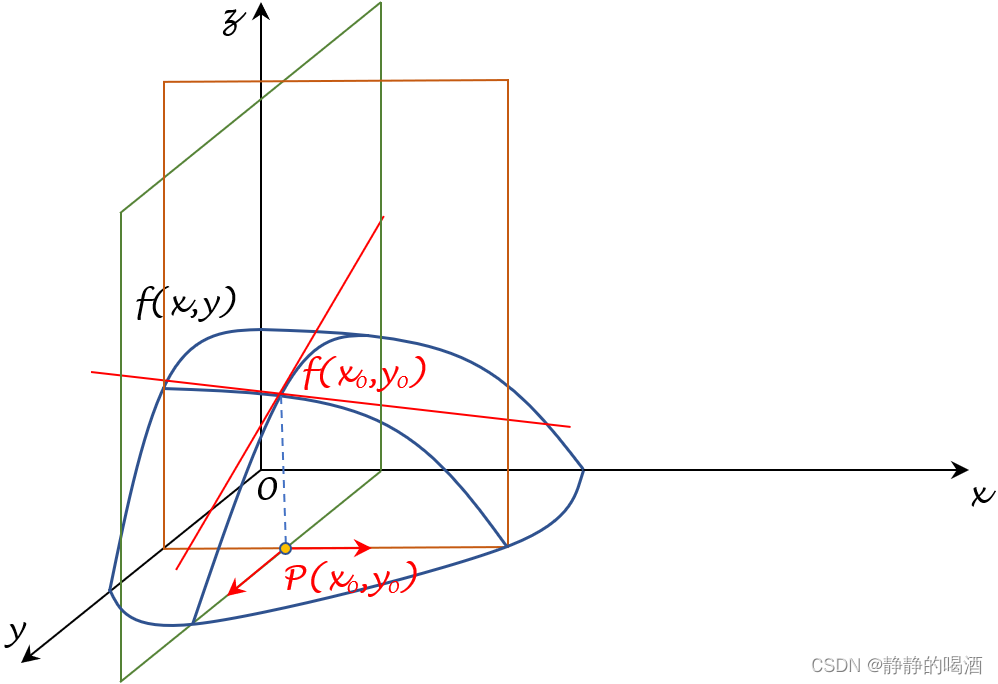

本节作为介绍凸函数的铺垫,简单介绍方向导数与梯度。

分享一个python写日志的方法

分享一个python写日志的函数

机器学习笔记之计算学习理论(二)PAC学习

上一节从霍夫丁不等式为切入点,介绍了样本平均值和全样本期望,本节将继续介绍PAC学习。