简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

这两个任务有助于模型理解上下文关系以及填充缺失的词汇,从而增强其对自然语言的理解能力。

在 Transformer 之前,处理序列数据(如文本)主要用 RNN 或 LSTM。RNN 必须一个词一个词地处理,导致,且在长文本中存在问题。彻底抛弃了 RNN 的循环结构,。一次性看懂整句话,训练速度极快。无论两个词隔得多远,在模型眼里的距离都是O(1),完美解决长依赖问题。这份笔记是前一篇《多头注意力机制》的进阶篇。如果说多头注意力是汽车的,那么 Transformer 就是整辆。它由 G

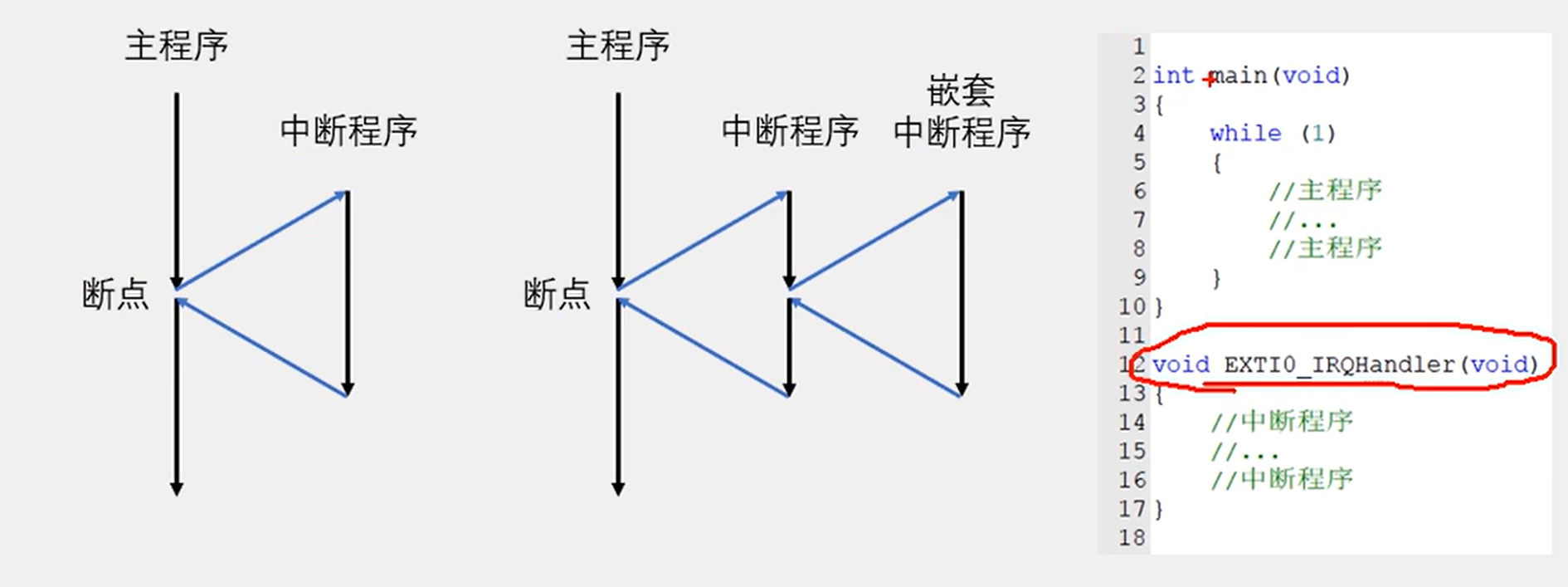

想要获取的信号是外部的很快的突发信号,比如是旋转编码器的输出信号,可能很久都不去拧他,这时候不需要STM32做任何事,但是一旦拧了,就会产生波形,需要STM32去接收,一旦不接受,波形可能会被下一次行为所覆盖。那么(1)这个信号是突发的,STM32不知道什么时候会来,(2)同时是外部的,STM32只能被动读取,(3)信号很快,如果STM32晚一点读取,就会错过很多波形。因此可以考虑使用外部中断,一

串口调试:通过串口通信,将调试信息发送到电脑端,电脑使用串口助手显示调试信息显示屏调试:直接将显示屏连接到单片机,将调试信息打印在显示屏上Keil调试:借助Keil软件调试模式,可以使用单步运行、设置断点、查看寄存器及变量等功能点灯调试:设置多个灯,看能否亮注释调试:对问题代码注释,一行一行取消。

本文采用的是江科大stm32入门套餐,使用的是STM32F103C8T6开发板,通过stlik将第嵌入式开发2中的程序烧录到开发板中。

GPIO,通用输入输出,可以配置8中输入输出模式,具体而言(1)输出模式:控制端口输出高低电平,用以驱动LED、控制蜂鸣器、模拟通信协议输出时序(2)输入模式:读取端口输出高低电平,用于读取按键输入、外界模块电平信号输入、ADC电压采集、模拟通信协议接受数据。1.输入模式介绍上拉输入:默认为高电平的输入模式下拉输入:默认为低电平的输入模式推挽输出:强推输出模式,高低电平都由STM32控制,具有绝对

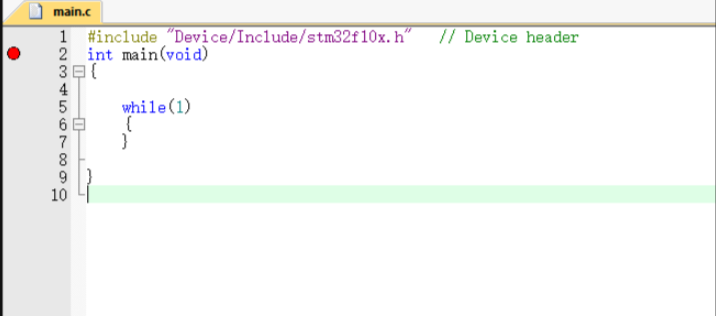

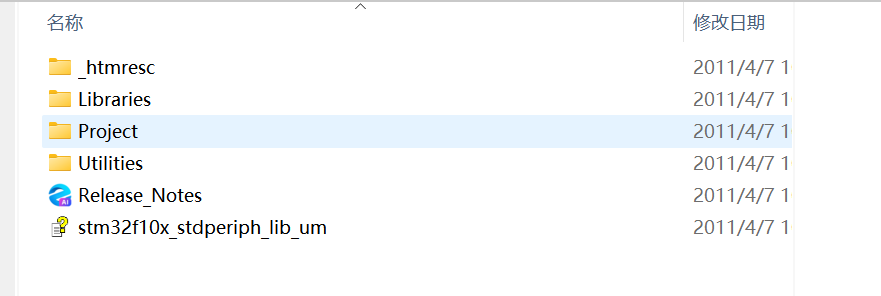

STM32开发方式包括基于寄存器(类似51,用程序直接配置寄存器)、基于库函数(软件已经封装好,可以通过直接调用函数实现功能、基于HAL库(通过图形化界面快速配置,隐藏底层逻辑)。一般新建工程需要以下步骤:①打开软件project-新建工程文件-选择芯片类型②在工程文件夹内添加一些必要文件③在keil软件中添加文件,启动文件+所有.c.h文件。

它是 Transformer 模型(由 Google 在 Attention Is All You Need 中提出)的核心组件。简单来说,就是把“自注意力机制 (Self-Attention)”重复做多次(多个“头”),然后再把结果合并起来。

Seq2Seq 模型的核心思想是将一个输入序列(例如一段话)映射到一个输出序列(例如翻译后的文本)。:接受输入序列,并将其编码为一个固定长度的上下文向量(即隐藏状态)。:根据编码器的上下文向量生成输出序列。在传统的 Seq2Seq 模型中,编码器将输入序列压缩成一个固定长度的上下文向量,然后解码器从这个向量生成输出序列。这种方式可能存在信息丢失的问题,尤其在处理较长的输入序列时。

1. 核心目标:估计联合概率语言模型的本质是计算一个句子(单词序列)出现的概率,或者根据上文预测下一个词。:判断一句话在自然语言中是否通顺(概率越高,越自然),或在生成任务中选择概率最大的下一个词。2. 实现路径:链式法则 (Chain Rule)3. 简化方案:N-gram 模型为了解决长序列参数过多的问题,引入:词与词独立。:只看前1个词。:只看前;2个词。4. 参数估计:通过统计语料库中的词