简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

作为一名Python开发,我一直使用的是国产Deepin操作系统作为我的开发主力,而且是从工作以来唯一使用的Linux开发系统。在2018年左右使用的是deepin20.9,那时deepin还没有控制中心,侧边栏打开展示所有的系统控制。简洁的设计,现代化的UI让人眼前一亮。2023 年开始使用deepinv23的beta版本,deepin v23的整体设计更好,新增了很多原厂APP,比如邮箱就是我

mosaic 是yolov4中提出的一个数据增强的方式,通过将4张图片拼接在一起送入训练,有效提升了模型的map

yolov8 + deeposrt 的代码实现

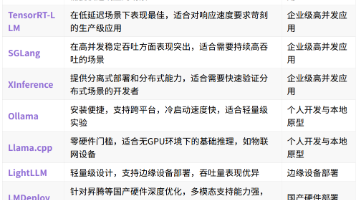

vLLM 的性能优势并非简单的代码优化,而是源于其底层架构的革新。理解下面三个核心概念,你就能明白它为何如此高效。

yolov8 + deeposrt 的代码实现

要从检测到的行人中判断是否有特定目标人物存在,其技术流程和关键技术可以分为以下几个核心环节:整个流程可以概括为:**人脸检测 → 人脸对齐 → 特征提取 → 特征比对与识别**。

LlamaFactory是一个面向AI开发者的大模型训练与微调平台,提供从开发到部署的全流程解决方案。平台通过可视化界面和自动化工作流降低技术门槛,支持训练、导出、推理和评估等核心功能。安装使用uv工具即可完成,提供WebUI和命令行两种操作方式,支持LoRA、QLoRA等多种微调方法。平台兼容Alpaca和ShareGPT数据格式,并可通过国内镜像加速模型下载。典型工作流程包括准备模型与数据、配

Unsloth 是一个专门为 Llama 3.3、Mistral、Phi-4、Qwen 2.5 和 Gemma 等模型设计的微调加速框架。该项目由 Daniel Han 和 Michael Han 领导的团队开发,旨在为开发者提供一个高效、低内存的微调解决方案。Unsloth 支持多种模型,并且提供了免费的笔记本示例,让初学者也能轻松上手。

transformers 是 Hugging Face 提供的一个大模型推理和训练框架。transformers 配合 PEFT 微调库完成原生的大模型微调。PEFT (Parameter-Efficient Fine-Tuning) 是一个用于高效地将预训练模型适配到各种下游应用的库,无需对模型的所有参数进行微调。PEFT 方法仅微调少量(额外的)模型参数——显著降低了计算和存储成本——同时取得

自从Chatgpt横空出世以来,各种智能工具层出不穷,聊天、绘画、视频等各种工具帮助很多人高效的工作。作为一个开发者,目前常用应用包括代码自动填充,聊天助手等。这些是工具层面的使用,有没有将大模型和日常编码的前后端流程相结合使用的切入点呢?今天分享一个使用大模型自动调用api接口的示例,可以作为大模型在开发中的另一种使用场景。